AIエージェントを組み込んだアプリ開発が、最近一気に増えてきた。

でも、実はセキュリティ対策が追いついていないケースが山ほどある。

結論から言うと、従来のWebアプリと同じ感覚でAIエージェントを作ると大事故に繋がる。

LLMは入力次第で挙動が変わる「非決定的」な性質を持っている。

だからこそ、これまでの境界型セキュリティだけではシステムを守りきれない。

今回は、1人開発者でも明日から導入できるAIエージェントのセキュリティ対策を10個厳選して紹介する。

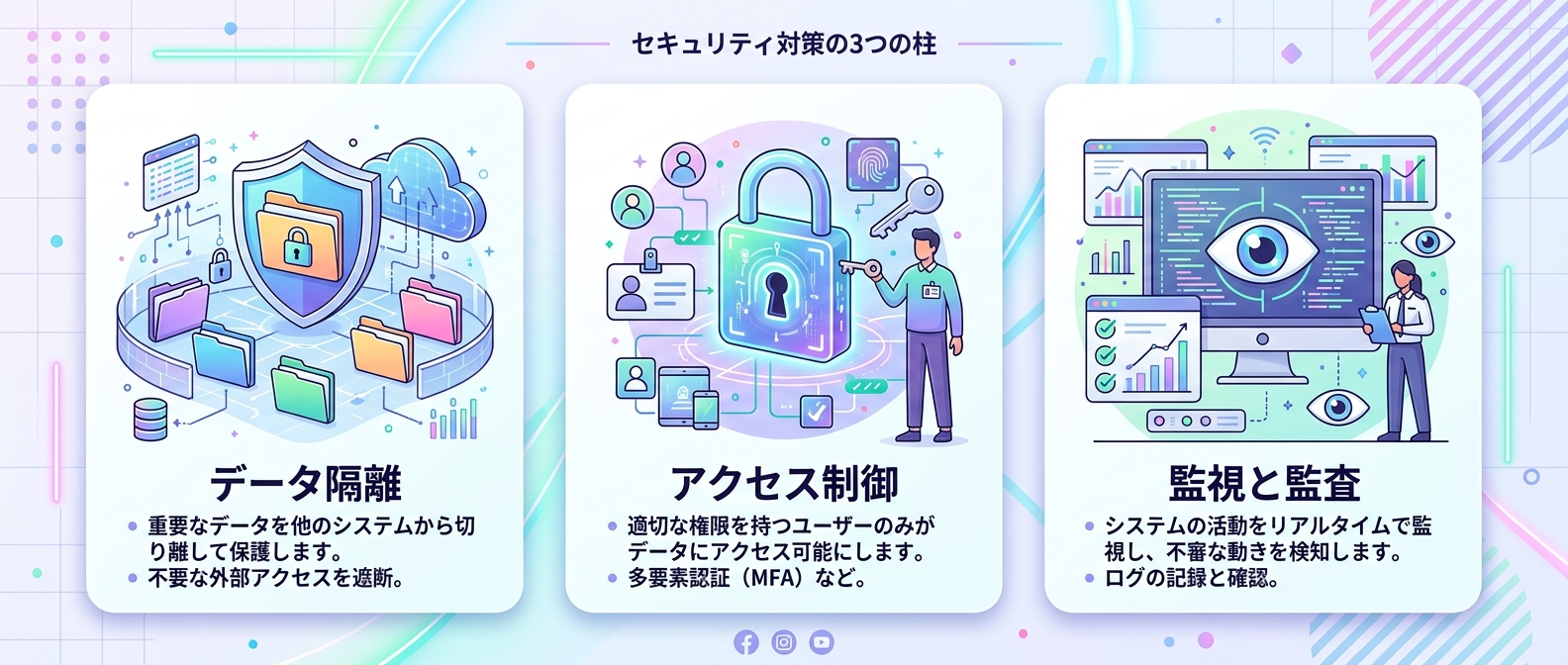

対策の全体像は以下の表の通りだ。

| カテゴリ | 対策名 | 難易度 | 期待できる効果 |

| --- | --- | --- | --- |

| データ隔離 | Context Tunnelingの導入 | 中 | 機密情報の漏洩防止 |

| データ隔離 | テナント境界崩壊の防止 | 高 | 不正アクセスの遮断 |

| データ隔離 | OWSによる秘密鍵の隔離 | 中 | 資産の盗難防止 |

| アクセス制御 | 永続的認可の排除 | 高 | 権限昇格の防止 |

| アクセス制御 | 動的セキュリティポリシーの適用 | 高 | 文脈に応じた制御 |

| アクセス制御 | ポリシーベースのアクセス制御 | 中 | エージェントの権限最小化 |

| アクセス制御 | ローカル環境での暗号化 | 低 | 物理的な鍵の保護 |

| 監視と監査 | agentwitによる通信の全記録 | 低 | ブラックボックス化の解消 |

| 監視と監査 | SHA-256チェーンによる改ざん検知 | 中 | 監査証跡の信頼性担保 |

| 監視と監査 | 高リスク操作のリアルタイム監視 | 低 | インシデントの早期発見 |

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

プロンプトとデータの隔離

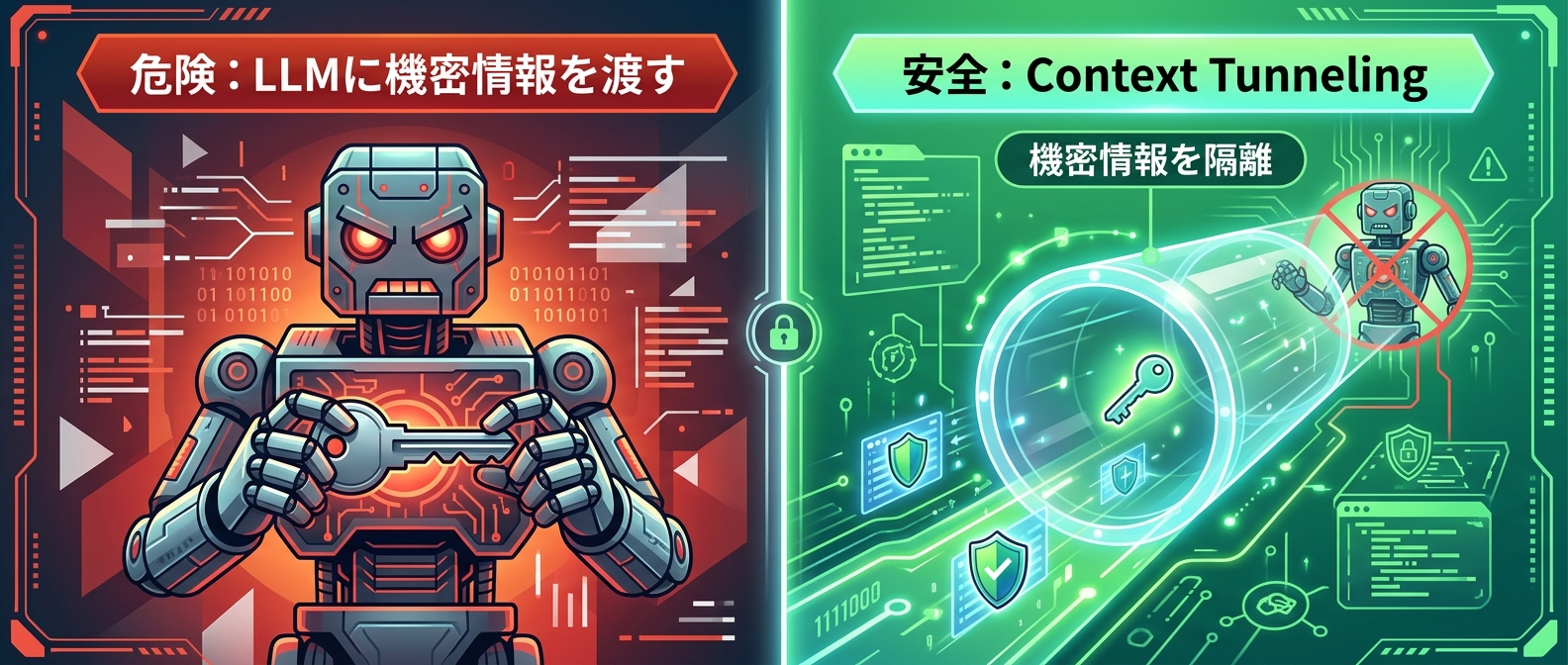

1. 秘匿コンテキストをLLMに見せない「Context Tunneling」

AIエージェントにユーザーIDやテナント情報などの機密データを渡すのは非常に危険だ。

LLMのプロンプトにこれらの情報を含めると、非決定的な挙動によって情報漏洩のリスクが生じる。

これを防ぐのがContext Tunnelingという設計パターンだ。

エージェントを介さずに、クライアントから直接サーバーへ秘匿情報を伝搬させる手法だ。

具体的なメリットは以下の通りだ。

* クライアントが直接サーバーに認証情報を送る

* エージェントはデータ処理のみに専念できる

* サーバー側でアクセス権限を厳格に評価できる

これにより、LLMが勝手に他のユーザーのデータを要求する事態を未然に防げる。

2. プロンプトインジェクションによるテナント境界崩壊の防止

マルチテナント環境において、エージェントがユーザーIDをパラメータとしてツールに渡す設計は避けるべきだ。

悪意のあるプロンプトインジェクションを受けると、エージェントが認識するIDが簡単に書き換えられてしまう。

結果として、本来アクセスできないはずの別テナントのデータが漏洩する。

対策としては、認可処理をLLMの外部で強制することだ。

エージェントの要求をそのまま鵜呑みにせず、決定的なプログラム側で必ず権限を検証する。

テナント境界を守るためには、LLMの善意の推論に依存しない仕組みが不可欠だ。

3. 秘密鍵をLLMコンテキストから隔離する「OWS」の活用

AIエージェントにブロックチェーン操作を行わせる際、秘密鍵の扱いは最大の課題だ。

環境変数や設定ファイルに平文で置いたり、プロンプトに含めたりするのは絶対に避けるべきだ。

ここで役立つのがOpen Wallet Standard、略してOWSと呼ばれる標準インターフェースだ。

OWSを採用すると、秘密鍵をLLMのコンテキストウィンドウから完全に隔離できる。

安全な鍵管理のポイントは以下の3点だ。

* 秘密鍵は強力なアルゴリズムで暗号化する

* エージェントには操作権限のみを付与する

* 鍵の復号はメモリ上でのみ行う

鍵は常に暗号化された状態で保存され、エージェントは直接鍵に触れることなく署名だけを要求する仕組みだ。

しんたろー:

毎日Claude Codeで開発している身からすると、コンテキストの管理は本当に気を使う。

LLMは便利だけど、機密情報をそのまま渡すのはリスクが高すぎる。

常に「LLMに見せなくていい情報は隠す」という意識を持つことが、安全な開発の第一歩だ。

認可とアクセス制御

4. MCPサーバーにおける永続的認可状態の依存排除

多くのサーバーは、初期認可後に再認証なしでツール呼び出しを許可してしまう傾向がある。

しかし、エージェントが非決定的な挙動をする以上、この永続的な信頼は非常に危険だ。

一度認可が通ったからといって、その後もエージェントを無条件で信頼し続けてはいけない。

リクエストごとに「誰が要求しているか」を厳密に検証する仕組みが求められる。

エージェントの権限は常に最小限に保ち、必要なときだけ必要な権限を与える設計にする。

このひと手間が致命的な脆弱性を防ぐ鍵になる。

5. 文脈に応じた動的セキュリティポリシーの適用

AIエージェントの操作は、文脈によって安全性が大きく変わる。

たとえば同じ「メール削除」でも、機密情報の隠滅が目的なのか、迷惑メールの整理なのかで意味が違う。

静的なルールだけで全ての操作を制御するのは現実的ではない。

操作のコンテキストを評価し、その場その場でセキュリティポリシーを生成・適用するフレームワークが必要だ。

これを導入することで、柔軟かつ強固なアクセス制御が実現できる。

状況に応じた動的な防御こそが、次世代のセキュリティ対策の要となる。

6. AIエージェント向けのポリシーベースのアクセス制御

人間とAIエージェントで、認証・認可の仕組みを明確に分離することが重要だ。

人間はパスフレーズで直接アクセスする一方、エージェントには専用のAPIトークンを発行する。

そして、事前に定義された厳格なポリシー評価を通過した場合のみ、操作を許可する仕組みを導入する。

エージェントには「送金は1日100ドルまで」といった具体的な制限を設ける。

これにより、万が一エージェントが暴走しても、被害を最小限に食い止められる。

権限の分離は、ゼロトラストアーキテクチャの基本中の基本だ。

7. ローカル環境での暗号化による安全な鍵管理

クラウドのセキュアな環境に依存しない場合、ローカルでのデータ保護が生命線になる。

機密情報をディスク上に平文で保存するのは、絶対に避けるべきだ。

AES-256-GCMなどの強力な認証付き暗号化方式を使って、データを保護するといい。

たとえば、パスフレーズやニーモニックは暗号化し、メモリ上でのみ復号する設計にする。

起動時にファイルのアクセス権限を検証し、他ユーザーから読み取れる状態なら動作を停止させる。

物理的な隔離と強力な暗号化を組み合わせることで、ローカル環境でも高い安全性を確保できる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

監視と監査

8. 透過プロキシ「agentwit」によるMCP通信の全記録

AIエージェントとサーバー間の通信は、どうしてもブラックボックス化しがちだ。

そこでagentwitのような透過プロキシツールを間に挟むアプローチが有効だ。

エージェントやサーバーのコードを一切改変することなく、両者間のやり取りをリアルタイムで記録できる。

導入のメリットは非常に大きい。

* エージェントのコード変更は一切不要

* サーバー側の設定変更も不要

* 接続先をプロキシに向けるだけで導入完了

裏側でどんなプロンプトが送信され、どんなツールが呼び出されているかが一目瞭然になる。

9. SHA-256チェーンを用いた通信ログの改ざん検知

記録した通信ログが、後から改ざんされていないことを証明する仕組みも必要だ。

ここで活躍するのが、暗号学的ハッシュ関数であるSHA-256だ。

全イベントをハッシュ値のチェーンで連結して記録することで、強固な監査証跡を残せる。

もしログが1バイトでも変更されれば、チェーンが壊れて即座に検知できる。

エージェントが不正な操作を行い、その痕跡を消そうとした場合でも、確実に証拠を保全できる仕組みだ。

信頼性の高いログは、インシデント発生時の原因究明において最大の武器になる。

10. 高リスク操作のリアルタイム監視と監査レポートの生成

シェル実行やファイル書き込みといった操作は、システムに重大な影響を及ぼす。

こうした高リスクなイベントは、発生した瞬間に検知できる体制を整えておくべきだ。

プロキシツールを使えば、危険な操作をリアルタイムでコンソールに警告表示できる。

さらに、記録したログからHTMLやMarkdown形式の監査レポートを自動生成する機能も便利だ。

危険なイベントが視覚的にハイライトされるため、人間がログを追いやすくなる。

定期的にレポートを確認する習慣をつければ、システムの健全性を常に保てる。

しんたろー:

個人的なイチ推しは、プロキシを使った通信の全記録だ。

Claude CodeでThreadPostの機能を実装するとき、裏でどんな通信が走っているか可視化できると安心感が段違いになる。

エージェントの動きがブラックボックスだとデバッグも地獄なので、まずはログを取ることから始めるのがおすすめだ。

よくある質問(FAQ)

Q1: AIエージェントにユーザーIDなどの情報を渡してはいけないのはなぜか?

LLMベースのAIエージェントは、入力テキストによって挙動が変わる非決定的な性質を持っているからだ。

ユーザーIDやテナントIDなどの機密情報をプロンプトに含めると、LLMが独自の判断で別のユーザーのデータを要求するリスクがある。

プロンプトインジェクション攻撃によってIDが書き換えられる可能性も高い。

結果として、本来アクセスできないはずのデータが漏洩し、システムのテナント境界が崩壊する恐れがある。

Q2: エージェントとサーバーを連携させる際のセキュリティ上の注意点は何か?

サーバー側が一度エージェントのアクセスを認可すると、その後は再認証なしでツール呼び出しを許可してしまう傾向がある点だ。

エージェントが非決定的な挙動をする以上、この永続的な信頼は非常に危険な状態だ。

対策として、エージェントに機密情報を直接扱わせない設計の導入が必要になる。

さらに、リクエストごとに権限を検証する仕組みや、通信を全て記録・監査する体制を構築するといい。

Q3: AIエージェントにブロックチェーンのトランザクションを実行させる際の安全な鍵管理方法は?

秘密鍵を環境変数に平文で保存したり、LLMのプロンプトに含めたりすることは絶対に避けるべきだ。

安全に管理するためには、秘密鍵を暗号化してローカルに保存し、LLMのコンテキストから完全に隔離する標準規格を採用するのが有効だ。

エージェントは直接鍵に触れることはできない。

専用のAPIトークンを発行し、厳格なポリシー評価を通過した場合のみ署名を許可する仕組みを構築するといい。

Q4: AIエージェントの誤作動や暴走を監視するにはどうすればいいか?

エージェントと外部システムの間に透過プロキシを設置し、すべての通信を記録・監視するのが効果的だ。

専用のツールを使うと、エージェントやサーバーのコードを変更せずに通信を傍受できる。

シェル実行やファイル書き込みといった高リスクな操作をリアルタイムで検知可能になる。

後から改ざん不可能な形式で監査ログを残すことで、暴走時の原因究明や被害の最小化に役立つ。

Q5: 監査ツールを導入するとシステムの動作が遅くならないか?

プロキシとして動作する監査ツールは、システム全体のパフォーマンスに与える影響が最小限に抑えられている。

通信をブロックしたり内容を改変したりする複雑な処理を行わず、単に通信を中継・記録するだけだからだ。

エージェントの接続先URLを変更するだけで簡単に導入できる。

まずは開発環境やテスト環境での動作検証から始めるといい。

まとめ:ゼロトラストなAIエージェント開発

AIエージェントのセキュリティは、従来のWebアプリ開発とは全く異なるアプローチが必要になる。

LLMの非決定的な性質を理解し、「エージェントを完全に信用しない」ゼロトラストの設計を取り入れることが重要だ。

まずはプロンプトから機密情報を排除し、通信ログを可視化するところから始めるといい。

安全な基盤の上でこそ、AIエージェントの真の価値を発揮できる。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド