SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

結論:AIエージェントの品質はテストと評価の仕組みで決まる

結論から言うと、AIエージェントの実運用に耐えうる品質は、プロンプトの微調整ではなくテストと評価の仕組みで決まる。

1問1答の簡単な会話なら完璧にこなすAIでも、複雑なタスクや長時間のやり取りになると途端にポンコツになることが多い。

これは、マルチターンと呼ばれる複数回のやり取りを想定した品質保証の仕組みが抜け落ちているからだ。

この記事では、AIエージェントの推論ブレや会話の破綻を防ぐための具体的な手順を詳細に解説する。

シナリオテストの導入から、揺るぎない評価基準の設計、そして実行環境の最適化まで、今日から使える実践的なノウハウをまとめた。

初心者でも順番に読み進めれば、自分のAIアプリの品質を劇的に向上させられるはずだ。

AI開発において、品質管理は避けて通れない道だ。

しっかりとしたテスト基盤を構築することで、ユーザーに信頼されるサービスを提供できるようになる。

前提知識:テスト自動化に必要なもの

必要なものは、DifyやDifyに類するAI構築プラットフォームのアカウントと、テストの概念への基本的な理解だ。

プログラミングの深い知識がなくても、仕組みさえ理解すれば品質管理のループは構築できる。

30分もあれば全体像を掴んで最初の一歩を踏み出せるはずだ。

テスト自動化と聞くとハードルが高く感じるかもしれないが、現代のツールを使えば驚くほど簡単に導入できる。

まずは難しく考えず、手元の環境で試してみる姿勢が重要になる。

ステップ1:マルチターン会話の課題とシナリオテストの必要性を知る

AIチャットボットを作っていると、1問1答のシングルターンでは完璧に動いているように見えることがよくある。

しかし実際の運用では、ユーザーとの会話は3往復、4往復と続いていくものだ。

このマルチターンの会話になった途端、AIが過去の文脈を忘れたり、検索の参照先がブレたりする問題が頻発する。

たとえば、ユーザーが条件を絞り込みながら商品を検索するシナリオを想像するといい。

3ターン目で「やっぱり最初の条件に戻して」と言われたとき、AIが1ターン目の内容を正しく思い出せるかが重要になる。

静的なデータセットを使ったテストでは、このような文脈に依存する動的な品質劣化を見抜くことは不可能だ。

だからこそ、ユーザーの返答によって動的に分岐するマルチターン会話を想定したシナリオテストが不可欠になる。

ターン4でターン1の内容を正しく参照しているか、意図的な意地悪な質問にどう返すかなど、会話の流れ全体を検証する必要がある。

エラーを出さずに「もっともらしい嘘」をつくAIの弱点を補うには、このシナリオテストの考え方が全ての土台となる。

単なる一問一答のテストから脱却し、実際のユーザー体験に即したテストシナリオを構築することが求められる。

ステップ2:ConvoProbeを使った自動テスト導入

マルチターンのテストが必要だと分かっても、手動で何度もチャットを入力するのは非効率の極みだ。

そこで、Difyなどで作ったアプリのテストを自動化するツールの導入が有効だ。

最近ではConvoProbeのような、マルチターン会話のテストに特化したツールがかなり良さそうだ。

このツールの面白いところは、アプリのフロー定義を読み込ませるだけで、テストシナリオのベースを自動生成してくれる点にある。

実際の会話はユーザーの返答によって分岐していくが、そこもLLMを用いて次のターンへの分岐を動的に決定しながらテストを進めてくれる。

ゼロから複雑なテストコードを書く必要がないため、初心者でもすぐに自動テストの恩恵を受けられるはずだ。

本番環境で発見した会話の破綻パターンをシナリオ化し、アプリを改修するたびに自動テストを回す運用フローを作ろう。

システムプロンプトを少し変えただけで別の機能が壊れるといった、リグレッション(品質劣化)を未然に防げる。

自動化の仕組みさえ作ってしまえば、あとはAIが勝手に品質を監視してくれるようになる。

手動テストにかかっていた膨大な時間を、新しい機能の開発やプロンプトの改善に充てられるようになる。

ステップ3:評価基準の明確化と「5軸スコアリング」の設計

テストを自動化しても、AIの出力をどう評価するかの基準が曖昧では意味がない。

「なんとなく自然な会話だから合格」という人間の感覚に頼った評価は、出力品質を不安定にする最大の要因だ。

プログラムで明確に判定できる、明確なスコアリングの軸を設計する必要がある。

おすすめなのは、明確さ、網羅性、一貫性、リスク考慮、構造の整合性という5軸スコアリングの手法だ。

各軸に対して20点満点で採点し、合計100点で評価する仕組みを作るといい。

特定のキーワードが含まれているか、手順のステップ数が要件を満たしているかなど、具体的な減点・加点ルールを定義する。

この5つの軸を固定することで、評価のブレがゼロになり、どこを改善すべきかが一目で分かるようになる。

以下の比較表を見れば、従来の曖昧な評価と、5軸スコアリングによる評価の違いが一目瞭然のはずだ。

評価基準を数値化することで、チーム内での認識のズレも防げる。

| 評価項目 | 従来の曖昧な評価 | 5軸スコアリング評価 |

| --- | --- | --- |

| 評価基準 | なんとなく自然な会話か | 5つの明確な軸で各20点満点 |

| 再現性 | 評価者やタイミングでブレる | プログラム判定で完全にブレない |

| 改善のしやすさ | どこを直せばいいか不明確 | 減点された特定の軸を直せばいい |

| 自動化への適性 | 人間の目視確認が必要 | 評価エージェントで完全自動化が可能 |

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

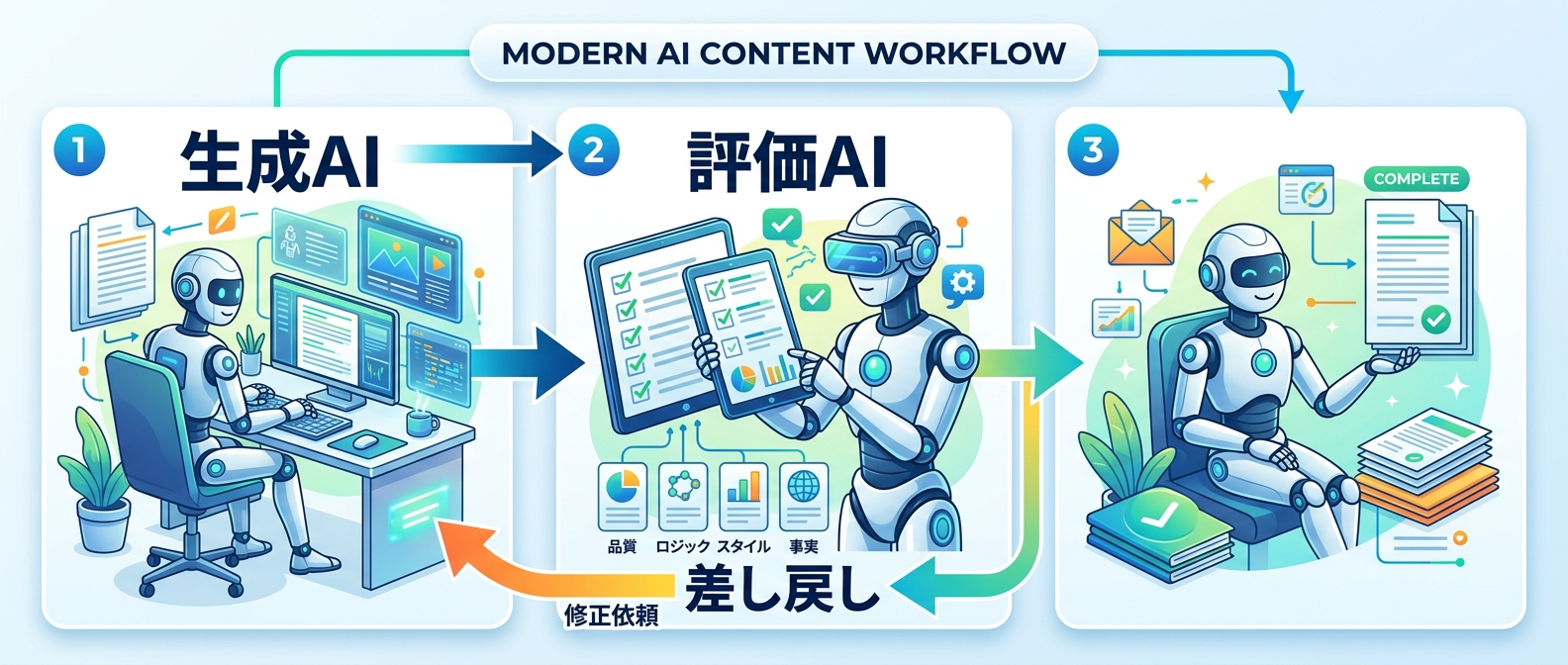

ステップ4:Quality Reviewerによる評価の自動化と差し戻しループ

評価基準が明確になったら、次はその評価自体もAIに任せてしまおう。

生成を担当するエージェントとは別に、品質評価に特化したQuality Reviewerと呼ばれる評価エージェントを配置するアーキテクチャが有効だ。

生成された回答をそのままユーザーに出すのではなく、必ずこの評価エージェントの審査を通す仕組みを作る。

評価エージェントは、先ほど設定した5軸スコアリングで出力を厳格に採点する。

もし総合スコアが基準点(たとえば90点)を下回った場合は、生成エージェントへ自動で差し戻しを行う。

その際、単に「やり直し」と伝えるのではなく、「一貫性の軸で5点減点。理由は〇〇の記述が矛盾しているため」と具体的な理由を添えることが重要だ。

この自動差し戻しループをネットワーク内に組み込むことで、システム全体の出力品質が飛躍的に安定する。

人間が一つ一つ出力をチェックする手間が省け、AI同士が勝手に品質を高め合ってくれるようになる。

1人開発者にとって、このレビューの自動化は最強の武器になるはずだ。

AIが自律的に品質を担保する仕組みは、運用コストを劇的に下げる効果もある。

ステップ5:エージェントハーネスを用いた実行環境の最適化

複数のAIエージェントを組み合わせた高度なシステムになると、単にプロンプトを投げるだけでは制御しきれなくなる。

そこで重要になるのが、AIエージェントを安全かつ効率的に動かすための制御基盤、エージェントハーネスの概念だ。

AIを野放しにするのではなく、メモリ使用量やセキュリティ、利用可能なスキルを一元的に管理する環境を用意する。

この領域では、everything-claude-codeなどのプロジェクトが実践的なアプローチを提供していて非常に参考になりそうだ。

強力なAIツールを実運用環境に組み込む際、レスポンスの遅延やコンテキストの喪失といった問題が必ず発生する。

ハーネスを導入してエージェントの挙動を常に観測し、実行環境の最適化を行うことで、これらの課題を根本から解決できる。

テスト、評価、そして実行環境の制御。この3つが揃って初めて、実運用に耐えうるAIエージェントが完成する。

最初は難しく感じるだろうが、一つずつ仕組みを構築していくことで、確実にプロの品質に近づけるはずだ。

まずは簡単なシナリオテストから始めてみるといい。

基盤がしっかりしていれば、後から機能を追加する際にも安心して開発を進められる。

しんたろーの体験:1人開発で実感した自動テストの威力

しんたろー:

Claude Codeで毎日コード書いてる身からすると、AIの出力品質を安定させる仕組みは本当に重要だと痛感している。

1人開発でThreadPostを作っているときも、プロンプトを少し変えただけで別の機能が動かなくなることがよくあった。

評価基準をガチガチに固めて自動テストを回すのは、急がば回れで一番確実な方法だ。

しんたろー:

評価専門のエージェントを挟むアーキテクチャは、僕もClaude Codeを使った開発フローで似たようなことをやっている。

コードを書く役割と、書かれたコードをレビューする役割を明確に分けることで、驚くほどバグが減った。

人間が全部チェックするのは限界があるので、AI同士で品質を高め合う仕組みは必須のテクニックだと言える。

初心者が陥りやすい3つのつまずきポイント

1. 評価基準を言語化せずにテストを始めてしまう

初心者が一番やりがちなのが、AIの出力を読んで「なんとなく良い」「ちょっと変」という感覚だけでテストすることだ。

これでは自動化もできないし、改善のループも回らない。

まずは評価基準を明確な点数制に落とし込むことから始めよう。

基準が明確であればあるほど、AIも人間も迷わずに改善を進められる。

2. 正常系のシナリオしかテストしない

ユーザーが意図通りに質問してくれる前提でテストを作ると、実運用で必ず痛い目を見る。

意地悪な質問や、途中でまったく違う話題に変えるようなイレギュラーな会話フローもシナリオに組み込む必要がある。

AIが混乱しやすい状況を意図的に作り出してテストすることが重要だ。

エッジケースをどれだけ網羅できるかが、システムの堅牢性を左右する。

3. 差し戻しの理由をAIに伝えていない

評価エージェントが「やり直し」とだけ伝えても、生成エージェントはどう直せばいいか分からない。

どの軸で何点減点されたのか、具体的にどの部分の記述が足りないのかをセットでフィードバックする仕組みが必須になる。

具体的な指示があって初めて、AIは正しい修正を行える。

人間に対するフィードバックと同じで、理由と改善点を明確に伝えることが成長の鍵となる。

よくある質問(FAQ)

Q1: シングルターンのテストだけではなぜ不十分なのか?

1問1答のシングルターンでは正しく見えても、3〜4ターン目になるとAIが過去の文脈を忘れたり、検索の参照先がブレたりするからだ。AIはエラーを出さずにもっともらしい嘘をつくため、品質劣化は見逃されがちになる。マルチターンのシナリオテストを導入し、ターン4でターン1の内容を正しく参照しているかといった動的な検証を行うことが不可欠だ。

Q2: AIエージェントの評価基準はどう設定すればいいか?

なんとなく良さそうといった曖昧な基準ではなく、プログラムで判定可能な明確なスコアリング軸を設けることが重要だ。たとえば、明確さ、網羅性、一貫性、リスク考慮、構造の整合性の5軸で評価する手法が効果的と言える。各軸に対して特定のキーワードが含まれているかといった具体的な減点・加点ルールを定義することで、評価のブレをなくせる。

Q3: Difyで作ったチャットボットのテストを自動化するには?

Dify公式の評価ツールに加えて、マルチターン会話に特化したテストツールの導入がおすすめだ。Difyアプリのフロー定義をツールに読み込ませるだけで、テストシナリオのベースが自動生成される。LLMを用いて次のターンへの分岐を動的に決定しながらテストを実行してくれるツールを使えば、本番リリース前の劣化検知として大いに役立つはずだ。

Q4: エージェントが間違った回答をした場合、どう修正ループを回せばよいか?

生成を担当するエージェントとは別に、品質評価に特化した評価エージェントをネットワーク内に配置するアーキテクチャが有効だ。評価エージェントが5軸スコアリングなどで出力を採点し、総合スコアが基準点を下回った場合は、具体的な減点理由とともに生成エージェントへ差し戻しを行う。評価軸と基準が明確に固定されているため、システム全体の出力品質が飛躍的に安定する。

Q5: エージェントハーネスとは何か、なぜ実運用に必要なのか?

エージェントハーネスとは、AIエージェントを単体で野放しに動かすのではなく、メモリ使用量やセキュリティなどを一元的に管理する実行基盤のことだ。強力なAIツールを実運用環境に組み込む際、レスポンスの遅延や不適切なコード生成といった問題が発生しやすくなる。ハーネスを導入してエージェントの挙動を常に最適化することで、安全かつ高パフォーマンスで運用できるようになる。

まとめ:今日からシナリオテストを始めよう

AIエージェントの品質向上は、決して魔法のようなプロンプト一発で解決するものではない。

マルチターン会話を想定したシナリオテストを作り、明確な5軸スコアリングで評価し、エージェント同士でレビューのループを回すという地道な仕組み作りがすべてだ。

さらにエージェントハーネスで実行環境を整えれば、あなたのAIアプリはプロレベルの安定性を手に入れられる。

まずは手元のチャットボットに対して、3ターンの短い会話シナリオを作ってテストしてみることから始めよう。

仕組みさえ作ってしまえば、あとはAIが自動で品質を守ってくれるようになる。

品質管理の自動化は、開発スピードとユーザー満足度の両方を引き上げる強力な武器となる。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド