最近、AIを使ってコードを書くのが当たり前になってきた。僕も毎日Claude Codeで1人SaaS開発をしているから、その圧倒的な開発スピードの恩恵は痛いほどわかる。数時間かかっていた実装が数分で終わる体験は、一度味わうと元には戻れない。

でも結論から言うと、AIが書いたコードをそのまま本番環境にデプロイするのはかなり危険だ。実は、AIが生成したコードが原因で大規模なシステム障害が起きるケースが現場で急増している。AIは文脈を完全に理解しているわけではなく、一見正しく動くように見えても、セキュリティホールが空いていることがよくあるからだ。

そこで今回は、AIコーディングを安全に行うためのセキュリティ対策を13個に厳選して紹介する。初心者でも今日から実践できるものばかりだから、参考になるはずだ。個人開発者から企業で働くエンジニアまで、すべての開発者が知っておくべき内容をまとめている。

今回紹介する対策は、大きく以下の3つのカテゴリに分かれている。

- 組織・プロセス編:人間によるレビュー体制の構築

- テスト・監視編:自動ツールを活用したリスク排除

- 知識・精度向上編:データベースを使ったAIの弱点補強

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

組織・プロセス編:人間とAIの安全な関係作り

1. AI生成コード専用の承認プロセスの導入

AIが生成したコードは、一見完璧に見えても未知のバグや脆弱性が潜んでいることが多い。だから、ジュニアエンジニアやミドルエンジニアがAIを使って書いたコードは、必ずシニアエンジニアの承認を必須にするプロセスを導入するべきだ。

経験豊富な開発者が「人間のフィルター」として機能することで、大規模なシステム障害を未然に防ぐことができる。AIに任せきりにせず、最終チェックは必ず人間の目で行うのが鉄則だ。特に、認証周りのコードやデータベース操作に関わる部分は、念入りなレビューが必要になる。

2. AI支援コード変更の影響範囲の監視

AIを活用したコード変更は、時にシステム全体に広範囲な影響を及ぼすことがある。これを「影響範囲の大きいインシデント」と呼ぶが、AIの提案をそのまま受け入れると予期せぬトラブルに発展しやすい。

AIが提案した変更がどこまで影響するかを事前に評価し、影響範囲を最小限に抑えるための監視体制を構築することが重要だ。たとえば、変更を加える前にテスト環境で念入りに動作確認を行うルールを徹底するといい。CI/CDパイプラインに自動テストを組み込み、影響範囲を可視化する仕組みを作るのも効果的だ。

3. AI生成コードのベストプラクティスとセーフガードの策定

AIコーディングツールの利用はまだ新しい領域だから、安全に使うためのルールが完全に確立されていない企業も多い。組織内でAIツールの利用ガイドラインをしっかり策定することが求められる。

どのようなコード生成にAIを使用してよいか、本番環境にデプロイする前にどのようなテストが必要かを明確にしておく必要がある。ルールを言語化しておくことで、チーム全体で安全なAI活用が可能になる。社内Wikiやドキュメントにガイドラインをまとめ、定期的に見直す運用がおすすめだ。

テスト・監視編:自動化でリスクを潰す

4. AIエージェントに対する自動レッドチーミングの実施

AIエージェントが自律的にタスクを実行する際、悪意のあるユーザーに操作されるリスクがある。これを防ぐために、攻撃者の視点でシステムをテストする「レッドチーミング」を定期的に実施するといい。

最近はPromptfooのようなツールを使って、このレッドチーミングを自動化するのがトレンドだ。開発段階でAIの脆弱性を発見し、修正する仕組みをデプロイのパイプラインに組み込むと非常に効果的だ。手動でのテストには限界があるため、自動化ツールの導入は必須と言える。

5. プロンプトインジェクションとジェイルブレイクのテスト

ユーザーの入力によってAIの指示を書き換える「プロンプトインジェクション」や、制限を回避する「ジェイルブレイク」は、AIアプリにおける重大な脅威だ。これらを放置すると、機密情報が漏洩する危険がある。

これらの攻撃手法に対する自動セキュリティテストを導入し、継続的に安全性を検証することが不可欠だ。ユーザーの入力とシステムプロンプトを明確に分離する設計を心がけるべきだ。入力値のサニタイズやバリデーションも忘れずに行う必要がある。

6. データ漏洩リスクの監視とコンプライアンス管理

AIエージェントが機密データにアクセスしたり、外部と通信したりするワークフローでは、データ漏洩のリスクが跳ね上がる。エージェントの活動を常時監視する仕組みが必要だ。

誰がいつ、どのデータにアクセスしたかという「監査証跡」をしっかり残すことで、セキュリティリスクの早期発見につながる。規制コンプライアンスを遵守するためにも、ログの管理は徹底するといい。ログ監視ツールを導入し、異常なアクセスがあった場合は即座にアラートが鳴るように設定しておくのが理想的だ。

7. オープンソースのセキュリティ評価ツールの活用

セキュリティ対策にお金をかけられない場合は、オープンソースの評価ツールを活用するのがおすすめだ。たとえばPromptfooが提供しているオープンソースのインターフェースやライブラリは、コストを抑えつつAIの脆弱性をテストできる。

大企業でも広く利用されている実績があるから、自社のAIアプリケーションの安全性を高める第一歩として非常に有効だ。まずは無料で使えるツールから試すといい。GitHubで公開されているリポジトリをクローンして、ローカル環境で動かしてみるだけでも多くの学びがあるはずだ。

8. エージェントワークフロー全体のセキュリティ評価

AI単体のセキュリティだけでなく、複数のAIエージェントが連携して動く「エージェントワークフロー」全体の安全性を評価する必要がある。連携する過程で思わぬ脆弱性が生まれることがあるからだ。

各ステップでの権限を最小限に抑え、異常な動作を検知したら即座に停止するフェイルセーフ機構の導入が推奨される。システム全体を俯瞰してリスクを潰していく視点を持つべきだ。マイクロサービスアーキテクチャのように、各エージェントの責任範囲を明確に分離する設計が求められる。

しんたろー:

セキュリティテストの自動化は、1人開発者にとって本当に救世主だ。

手動で全部の攻撃パターンを試すなんて物理的に不可能だから、自動化ツールでパイプラインに組み込んでしまうのが一番確実でラクな方法だ。

知識・精度向上編:AIの弱点を補う

9. AIエージェントの鮮度と精度のギャップを埋める

AIモデルは学習データが古いため、最新の脆弱性情報などの鮮度を知らないことが多い。また、具体的な実行コマンドの精度を正確に出力できないこともある。

このギャップを埋めるために、AIエージェントが外部の最新情報や正確なコマンドを参照できる仕組みを構築することが重要だ。RAG(検索拡張生成)と呼ばれる技術を使って、常に最新の知識をAIに提供できるようにするといい。これにより、古い情報に基づいた危険なコードの生成を防ぐことができる。

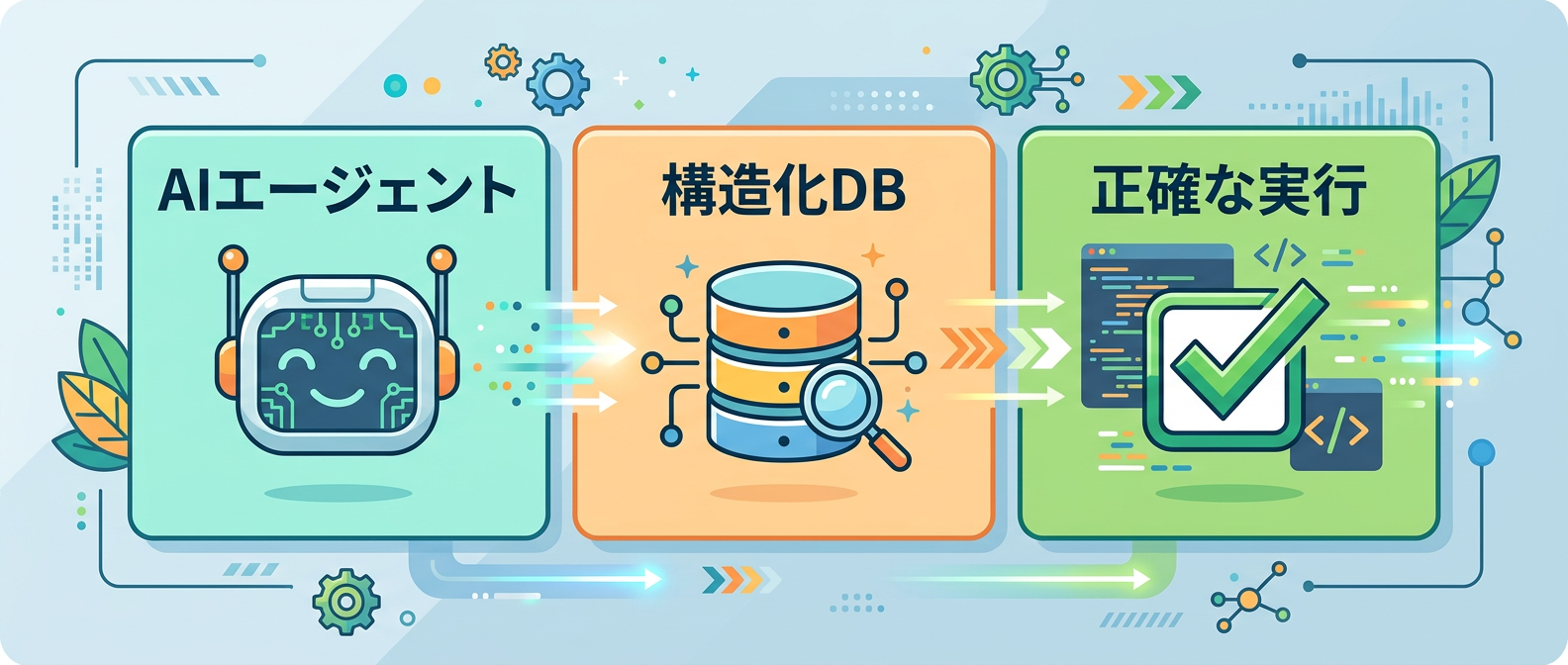

10. 実行可能なコマンドの構造化データベース化

AIエージェントに正確なコマンドを実行させるために、必要な情報を構造化データベースに保存しておくべきだ。名前やプラットフォーム、機能などで厳格にインデックス化するのがポイントだ。

これにより、AIは曖昧な説明ではなく「コピー&ペーストで使える正確なコマンド」を即座に取得できるようになる。結果として、AIの出力精度が劇的に向上し、エラーを減らせる。JSON形式やYAML形式でコマンドリストを管理し、AIが読み込みやすい状態を作っておくのが効果的だ。

11. 方法論や概念のベクトルデータベース化

特定の攻撃手法や概念的な知識をAIに提供するためには、ブログ記事やドキュメントをベクトルデータベースに保存して意味検索を可能にするのが効果的だ。

これにより、AIは直面している問題に関連する過去の事例や方法論を読み込み、推論に活用できる。単なるキーワード検索ではなく、文脈を理解した高度な回答が引き出せるようになる。PineconeやChromaなどのベクトルデータベースを活用し、社内のナレッジをAIに学習させる仕組みを構築するといい。

12. ローカルアセットのフラットなインデックス化

ワードリストやスクリプトなどのファイル群は、複雑なデータベースに格納するのではなく、シンプルなJSONインデックスとして管理するのがおすすめだ。名前とタグを絶対ファイルパスにマッピングするだけでいい。

これにより、AIエージェントは必要なファイルを迅速に見つけ出し、ツールに渡して実行することが可能になる。シンプルで軽量な仕組みを作ることで、処理速度も向上する。ディレクトリ構造を整理し、AIが迷わずファイルにアクセスできる環境を整えることが重要だ。

13. コンテキストウィンドウを考慮したターゲット検索

AIモデルには一度に処理できる情報量に制限があるため、大量のドキュメントをすべてプロンプトに含めることはできない。必要な情報だけをピンポイントで抽出する設計が求められる。

タスクに最も関連性の高い情報だけを素早く抽出し、エージェントがすぐに行動できる形式で提供する「ターゲットを絞った検索」を実装するといい。これでAIのパフォーマンスを最大限に引き出せる。チャンク分割のサイズを最適化し、ノイズの少ない情報をAIに渡す工夫が必要になる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

セキュリティテスト手法の徹底比較

ここで、AI生成コードに対する代表的なセキュリティテスト手法を比較する。結論から言うと、手動と自動の組み合わせが最強だ。

| テスト手法 | 概要 | 自動化のしやすさ | おすすめ度 |

|---|---|---|---|

| 手動コードレビュー | シニアエンジニアによる目視確認と承認 | 低 | ★★★★★ |

| 自動レッドチーミング | 攻撃者視点での自動脆弱性テストの実施 | 高 | ★★★★☆ |

| プロンプトテスト | インジェクションやジェイルブレイクの検知 | 高 | ★★★★★ |

| 監査ログ監視 | エージェントの活動履歴とデータアクセスの記録 | 中 | ★★★★☆ |

しんたろーのイチ推しTips

僕のイチ推しはやっぱり「AI生成コード専用の承認プロセスの導入」だ。ツールに頼るのも大事だけど、最後は人間の目が一番の防御線になる。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、一番怖いのは「動くけど脆弱性だらけのコード」が生成されることだ。

理由はシンプルで、AIは文脈を完全に理解しているわけではないからだ。だから僕は必ず自分で最終レビューをして、影響範囲を小さく保つように徹底している。

よくある質問(FAQ)

Q1: AIが生成したコードはなぜそのまま使ってはいけないのか。

結論から言うと、AIは過去の膨大なコードを学習しているため、古い書き方や脆弱性が含まれている可能性があるからだ。また、AIはシステム全体の文脈を完全に理解しているわけではない。そのため、一見正しく見えるコードでも、本番環境に組み込むと予期せぬバグや広範囲なシステム障害を引き起こすリスクがある。これを防ぐためには、必ず人間のエンジニアによる厳格なコードレビューを通すことが推奨される。

Q2: プロンプトインジェクションとは何か。どう防げばよいか。

プロンプトインジェクションとは、悪意のあるユーザーが特殊な入力を行うことで、AIに対する本来の指示を上書きし、意図しない動作や機密情報の漏洩を引き起こすサイバー攻撃のことだ。これを防ぐには、ユーザー入力とシステムプロンプトを明確に分離する設計が必要になる。さらに、専用のセキュリティテストツールを用いて、開発段階から自動的に脆弱性をスキャンし、継続的に対策を講じることが非常に重要だ。

Q3: AIエージェントのセキュリティテスト(レッドチーミング)とは何か。

レッドチーミングとは、攻撃者の視点に立ってシステムに意図的に攻撃を仕掛け、脆弱性を洗い出すテスト手法のことだ。AIエージェントに対するレッドチーミングでは、制限を回避するジェイルブレイクや不正なデータアクセスを試みる。最近では、これを自動化して多数の攻撃パターンを効率的にテストするツールが普及しており、安全なAI開発には不可欠なプロセスとなっている。手動でのテストには限界があるため、自動化がおすすめだ。

Q4: Promptfooとはどのようなツールか。

Promptfooは、大規模言語モデルやAIアプリケーションのセキュリティ脆弱性をテストするためのプラットフォームだ。プロンプトインジェクションやデータ漏洩のリスクを自動で評価する機能を持ち、オープンソースとしても広く利用されている。大企業でも導入実績があり、企業はこれを使うことでコストを抑えつつ、より安全にAIエージェントを構築・運用できるようになる。セキュリティ対策の第一歩として非常に優秀なツールだ。

Q5: AIエージェントに最新のセキュリティ知識を持たせるにはどうすればよいか。

AIモデルは学習データが古いため、最新の脆弱性情報などを知らないことが多い。これを解決するには、検索拡張生成という技術を使うのが効果的だ。最新のドキュメントや正確なコマンドリストを外部データベースに保存しておき、AIが回答を生成する前にそのデータベースを検索して必要な情報を取得させる。これにより、AIは常に最新かつ正確な知識を活用できるようになり、回答の精度が飛躍的に向上する。

まとめ:AIと人間の強みを掛け合わせる

AI生成コードのセキュリティ対策について、13のTipsを紹介した。

結論として、AIは非常に強力なツールだけど、安全に使うためには「人間のフィルター」と「自動化されたテスト」の両輪が不可欠だ。

今日からできる対策から始めて、安全なAI開発環境を構築するといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド