SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIの戦場が二極化している

1ギガワット。

原子力発電所1基分の電力だ。

それが、次世代AIの基盤モデルを学習させるのに必要な計算資源の目安になりつつある。

元OpenAI幹部が立ち上げたスタートアップが、約2,000億円の資金調達と1ギガワットの計算資源を確保して基盤モデル開発に乗り出した。

一方でAnthropicは、自社のAIに「自律的な致死的兵器への使用禁止」と「米国市民の大規模監視禁止」という2つのガードレールを外すことを拒否した。

そして、米国政府を連邦裁判所に訴えた。

基盤モデルを巡る争いが、資本と国家権力の問題になっている。

個人開発者の参入余地を探る。

AIを巡る3つの動き

状況を整理する。

今、AIの世界では全く異なるレイヤーで3つの動きが並走している。

動き①:Anthropicが米国政府を訴えた

Anthropicが、17の連邦機関と大統領府を相手取って訴訟を起こした。

争点は明快だ。

AnthropicはClaudeに2つのガードレールを設けている。

「致死的な自律型兵器への使用禁止」と「米国市民の大規模監視への使用禁止」だ。

国防総省はこのガードレールを問題視した。

そこで国防生産法を持ち出し、「Claudeを国防に不可欠なインフラとして徴用する」と圧力をかけた。

同時に「セキュリティリスクとしてサプライチェーンから排除する」という真逆の脅しも並行してかけていた。

Anthropicの主張はシンプルだ。

「同一の企業に対して、『不可欠だから徴用する』と『危険だから排除する』を同時に主張することはできない」。

法的根拠として持ち出された法律は、本来外国の敵対勢力(中国、ロシア、イラン、北朝鮮、キューバ、ベネズエラ)による情報システムの妨害を想定して書かれたものだ。

Anthropicはその法律の適用対象に当たらないと主張している。

国家権力とAI企業の対立が表面化している。

動き②:基盤モデル開発のコストが国家インフラ規模に

元OpenAIのCTOが創業したスタートアップが、シードラウンドで約2,000億円を調達した。

評価額1.2兆円という規模で動いている。

さらにNvidiaと長期パートナーシップを締結した。

Nvidiaの次世代システムを通じて最低1ギガワットの計算資源を確保した。

来年初頭から稼働予定だという。

10万個以上の次世代GPUを稼働させる計算になる。

共同創業者2人がすでに古巣に戻っているという話もある。

それでも資金と計算資源の規模は変わらない。

次世代の基盤モデルを作るには、これだけのリソースを要する。

ソフトウェア開発の枠を完全に超えている。

動き③:情報の非対称性を解消するアプリの台頭

賃貸退去時の原状回復費用。

日本では年間数十万件規模でトラブルが発生している領域だ。

国土交通省が「原状回復をめぐるトラブルとガイドライン」を公開している。

それにもかかわらず、民間調査によると相談者の8割以上がガイドラインの存在自体を知らない。

不当な請求に署名してしまっている。

この非対称性を崩すアプリが出てきた。

退去費用の見積もり明細をアップロードする。

各費用項目がガイドラインに照らして適正かどうかを診断する。

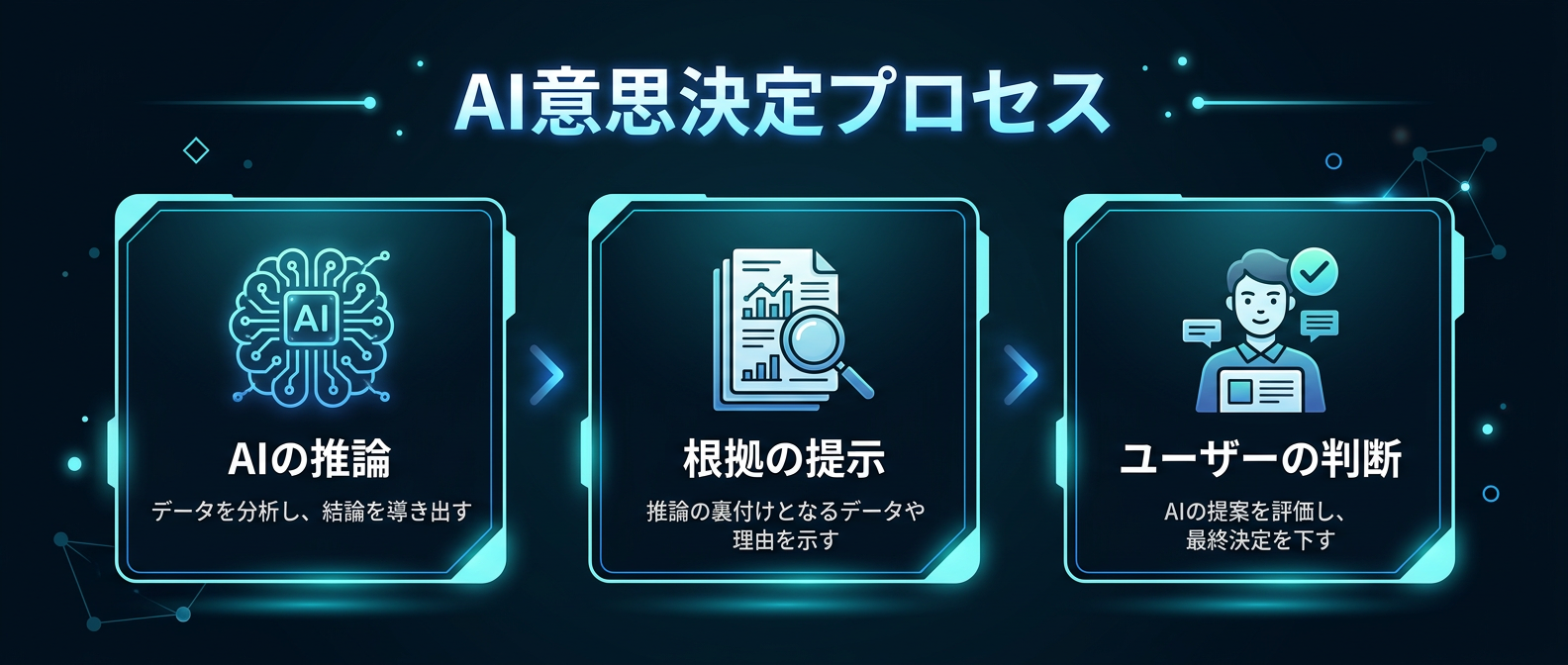

AIが「答えを断言する」のではない。

「判断の根拠を可視化する」設計だ。

「この費用は不当です」とは言わない。

「国土交通省ガイドラインの○○項によれば、経年劣化による損耗は貸主負担とされています」という形で情報を整理する。

ユーザー自身が交渉できる状態を作る。

実績として、30万円の請求を15万円に減額したケースが報告されている。

引越し当日に「今日中にサインを」と迫られた場面でAI診断を使ったケースもある。

「持ち帰って確認します」と言えたという。

僕の過去の退去費用も取り返したい。

しんたろー:

国家がAIのガードレールを外して軍事・監視に使おうとしている話と、市民がAIを使って不当な請求から身を守っている話が同時進行してる。同じ技術が「権力の増幅器」にも「防衛の盾」にもなってる。どっちに転ぶかは、誰がどう実装するかだけの話だ。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

個人開発者の参入余地

基盤モデル開発は、もう個人の話ではない。

1ギガワットの電力。

それを調達できる開発者が世界に何人いるか。

1.2兆円の評価額。

シードラウンドでそれを達成できるスタートアップが年間何社あるか。

数字が全てを語っている。

基盤モデル層とインフラ層は、巨大資本と国家権力が交錯する戦場になった。

Anthropicのような企業でさえ、政府と法廷で争っている。

個人開発者がその戦場に踏み込む理由はない。

答えは賃貸退去費用のアプリが示している。

「特定ドメインに存在する情報の非対称性」を、AIの推論能力で解消するアプリケーション層。

構造を分解するとシンプルだ。

- 情報を持っている側(不動産業者、大家、保険会社、医療機関、行政機関)

- 情報を持っていない側(入居者、患者、申請者、消費者)

- その間に存在するギャップ(ガイドライン、法律、規約、判例)

このギャップは日本中に無数にある。

賃貸退去費用はその一例に過ぎない。

労働法の未払い残業代、消費者契約法の不当条項、医療同意権、個人情報保護の開示請求。

「知っていれば守られる権利」が、知識と時間を持つ人々にしか実質的に機能していない領域が山ほどある。

実装の設計思想が問われる。

AIに最終判断をさせてはいけない。

「この請求は不当です」と断言するシステムは、法的リスクがある。

ユーザーの信頼も失う。

「ガイドラインのこの項目によれば、このケースはこう解釈される可能性があります」という形で根拠を可視化する。

ユーザー自身が判断・行動できる状態を作るのが正解だ。

Claude Codeでこういうシステムを作ることを考える。

核心部分のロジックはシンプルだ。

「ドメイン知識(ガイドライン、法律条文)を構造化してインプットする。

ユーザーの入力(見積もり明細、契約書の条項)と照合して、該当する根拠を提示する」。

この推論ロジックとUIを、ターミナルからの指示だけで高速にプロトタイピングできる。

複雑な法律文書の構造化と照合ロジックは、Claude Codeが最も得意とする作業の一つだ。

もう一つ見逃せない視点がある。

地理的格差の解消だ。

東京・大阪では賃貸トラブルに詳しい弁護士や消費者センターへのアクセスが比較的容易だ。

地方ではそのリソースが物理的に少ない。

インターネット接続さえあれば、地方在住のユーザーも都市部と同じ水準の情報を得られる。

これはAIアプリが持つ構造的な強みだ。

しんたろー:

ThreadPostの開発でも、SNS運用の「情報の非対称性」が気になっていた。「どのポストが伸びるか」って、データを持ってる人間と持ってない人間で全然違う判断になる。賃貸退去費用のアプリと構造は同じだ。ドメインが違うだけで、やってることは「情報格差を埋めるツール」。この切り口、もっと意識的に使えそうだ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

開発者を取り巻く現在の状況

Anthropicの訴訟と基盤モデルの巨大化、そして情報格差解消アプリの台頭。

この3つの動きが重なって見えてくる構造がある。

基盤モデル層は「国家と巨大資本のゲーム」になった。

Anthropicの訴訟が示しているのは、AIの安全性ポリシーが政治的・法的な争点になっているという事実だ。

訴訟の行方次第では、AIモデルのガードレールに関する法規制が強化される。

政府によるAI企業への統制が強まる。

開発者として利用している基盤モデルのポリシー変更の動向は注視が求められる。

特定ユースケースへの制限も同様だ。

具体的なポイントを整理する。

利用規約の変更アラートを設定する。

基盤モデルのAPIを使っている場合、利用規約の変更が開発中のアプリに直接影響する。

特に「禁止ユースケース」の定義が変わるケースに注意が必要だ。

特定の基盤モデルへの依存度を把握しておく。

政府規制や企業ポリシーの変更で特定のモデルが使えなくなるシナリオは現実的なリスクだ。

「AIが判断する」ではなく「AIが根拠を示す」設計を徹底する。

リーガルテック、フィンテック、ヘルステックなど規制が厳しいドメインほど、この設計原則が問われる。

AIに最終判断をさせるシステムは規制リスクを抱える。

アプリケーション層の参入余地は今が最大だ。

基盤モデルの性能が上がり続ける中で、「特定ドメインの情報格差を解消する」アプリの参入障壁は下がっている。

必要なのは、ドメイン知識の構造化と、ユーザーが行動できるUI設計だ。

コードの量より、「どの情報の非対称性を狙うか」という問いの方が問われている。

非弁行為のラインを意識する。

リーガルテック領域で開発する場合、「AIが個別具体的な法的判断を断言すること」は非弁行為に抵触するリスクがある。

「ガイドラインとの照合結果を提示する」という設計に徹することで、このリスクを大幅に下げられる。

「答えを出す」ではなく「根拠を可視化する」という設計思想は、法的リスク管理になる。

同時に、ユーザー体験としても正直で信頼されやすい。

小さなドメインから始める価値がある。

賃貸退去費用という「小さいが多くの人が直面するリアルな問題」から始めたアプリが、実際に機能している。

抽象的な社会課題より、「明日引越しをする人が実際に使えるツール」の方が、ユーザーに届く速度が速い。

しんたろー:

1ギガワットの計算資源と2,000億円の資金調達を見て、「基盤モデル開発は別世界の話だな」と思う。一方で、賃貸退去費用のアプリを見て「これは1人でも作れる」と感じる。この落差が今のAI産業の構造だ。インフラ層は巨大資本に任せて、アプリ層で「誰のどんな情報格差を潰すか」を考え続ける方が、個人開発者の勝ち筋が見える。Claude Codeで毎日コード書いてる身からすると、このレイヤーの分業はむしろ追い風だ。

よくある質問

Q1. AnthropicとAI企業を巡る政府の動きが続いているが、私たちが使うClaudeのAPIに影響はあるか?

短期的には、APIの提供や機能に直接的な影響はない。

ただし訴訟の行方次第では、将来的にAIモデルの「安全性ガードレール」に関する法規制が強化される。

政府によるAI企業の統制が強まる。

開発者として注視が求められるのは、利用する基盤モデルのポリシー変更と、特定ユースケースへの制限の動向だ。

特に「自律的な意思決定を伴うシステム」や「監視・追跡系の機能」を実装しているプロダクトは、規制の変化に敏感でいる必要がある。

代替モデルへの切り替えコストを事前に把握しておくのが現実的なリスク管理だ。

Q2. リーガルテック系のAIアプリを開発する際、法律違反(非弁行為)にならないための設計ポイントは何か?

最も問われるのは「AIに個別具体的な法的判断を断言させないこと」だ。

「この請求は不当です」と結論を出すシステムは非弁行為のリスクを抱える。

正しい設計は、「入力されたデータと公開ガイドライン・法令の照合結果を提示し、ユーザー自身が判断・行動できる根拠を整理する」に徹することだ。

UI上も「診断結果」ではなく「参考情報」として提示する。

「専門家への相談を推奨する」という文言を適切に配置する。

AIの役割を「法律の翻訳コストを下げる補助ツール」に位置づけることで、非弁行為のラインを超えずに実用的なプロダクトが作れる。

Q3. 基盤モデル開発に「1ギガワットの計算資源」が必要というのは、具体的にどのくらいの規模感か?

1ギガワット(1,000メガワット)は、中規模の原子力発電所1基分の出力に相当する。

一般家庭の消費電力が平均約3〜4キロワットとすると、約25万〜33万世帯分の電力を同時に消費するスケールだ。

次世代フロンティアモデルの学習には、この規模の電力と冷却設備、それを支える巨額の資本が不可欠になっている。

言い換えると、基盤モデル開発のハードルが「ソフトウェアエンジニアリングの問題」から「国家インフラレベルの物理的・資金的問題」に変質した。

これは個人開発者にとってネガティブなニュースではない。

「基盤モデル層は巨大資本に任せ、アプリケーション層に集中する」という分業の合理性を裏付けるデータとして読む。

AIの戦場は分業された

1ギガワット。

2,000億円。

連邦裁判所。

これが基盤モデル層の現状だ。

個人開発者がやることは、その上のレイヤーで「誰のどんな情報格差を潰すか」を考え続けることだ。

賃貸退去費用の30万円が15万円になったという事実の方が、1ギガワットの計算資源より、今日の自分の開発に近い。

巨大資本が牽引する強力なAIインフラを活用する。

身近な「情報の非対称性」を解決するアプリをClaude Codeで高速に作る。

それが今の個人開発者のポジションだ。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド