AIエージェントにコードを書かせたり、外部ツールを操作させたりするのが当たり前になってきた。僕自身、Claude Codeを使って1人でSaaSを開発しているが、エージェントに強い権限を渡すのは正直言って怖い部分もある。

APIの暴走で高額請求が来たり、脆弱性を突かれてシステムを裏から乗っ取られたりするリスクが急増しているからだ。結論から言うと、AIエージェントを安全に使うには、コスト制御と権限の最小化が鍵になる。

今回は、個人開発者でも今日から実践できる防御策と監視手法を11個に絞ってまとめた。まずは全体像を把握してから、具体的な対策に進もう。

| 対策のカテゴリ | 主なセキュリティリスク | 優先度 |

| :--- | :--- | :--- |

| コストと権限の防御 | API暴走による高額請求、不正なアクセス | 高 |

| 悪意ある操作の検知 | コマンドインジェクション、プロンプト乗っ取り | 高 |

| データとプロンプト保護 | 機密情報の漏洩、RAGデータのサイレント改ざん | 中 |

| 高度な脆弱性監査 | ロジックの欠陥、従来型スキャナーの死角 | 中 |

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

カテゴリ1:APIコストと権限の鉄壁防御

AIに自由を与えすぎると、あっという間に予算を食いつぶすか、システムを破壊される。まずは物理的な制限を設けることが最優先だ。

1. APIキーのセキュアな管理と予算の構造的制限

APIキーを環境変数ファイルに直接置くのは非常に危険だ。エージェントがコード内の予算チェックで発生したエラーを無視して、APIを延々と呼び続けるリスクがある。

対策として、bantoのような予算管理ツールを導入するといい。これはAPIキーをOSのセキュアな領域に格納し、予算の枠を確保できたときだけキーを渡す仕組みだ。

キーを取得する前に見積もりコストを予約し、実際の利用後に精算する。物理的にキーを渡さない構造的なゲートを設けることで、コストの暴走を確実に防げる。

2. 外部連携サーバーの権限最小化とアクセス制御

AIと外部ツールを繋ぐプロトコルは非常に便利だが、権限設定が曖昧だと不正操作の温床になる。エージェントが意図せずリポジトリを書き換えたり、機密データを盗み出したりする危険がある。

対策のポイントは以下の3つだ。

- ツール間のID検証を徹底する

- 読み取り専用の権限をデフォルトにする

- 必要最小限の権限のみを都度付与する

曖昧に定義された権限は、時間の経過とともに拡大していく傾向がある。定期的な権限の見直しが不可欠だ。

3. 未承認サーバー(シャドーAI)の徹底排除

組織やプロジェクトの管理外で稼働する未承認の連携サーバーは、セキュリティの巨大な抜け穴になる。デフォルトの認証情報や緩い設定のまま放置されがちだからだ。

個人の開発環境でも、テスト目的で立ち上げたサーバーをそのまま忘れてしまうことがある。利用可能なサーバーをホワイトリスト化し、不要な接続はすべて遮断するルールを徹底しよう。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、権限の最小化と予算制限が一番重要だと痛感している。

理由はシンプルで、AIは指示に忠実すぎるからだ。ThreadPostの開発でも、AIにターミナル操作を任せる時は影響範囲を限定しているし、bantoのような予算管理の仕組みは個人開発者にとって本当にありがたい。

カテゴリ2:悪意ある操作と攻撃の検知

AIは外部からの入力を素直に受け取りすぎる。攻撃者はその性質を悪用して、巧妙な罠を仕掛けてくる。

4. サンプリング悪用による制御逆転の監視

外部サーバー側からクライアントのAIに対して、逆にプロンプトを送信する機能が悪用されるケースが確認されている。正規のリクエストに隠し指示を埋め込み、AIの動作を裏で操る手口だ。

たとえば、コードの要約を依頼したはずが、バックグラウンドで架空の物語を生成させられたり、別のスクリプトを実行させられたりする。通信の方向と内容を常に監視し、不審なバックグラウンド処理が走っていないか確認する必要がある。

5. ツール定義の改ざん(Tool Poisoning)対策

攻撃者がツールの説明文やメタデータに悪意ある指示を埋め込み、AIを騙すリスクが存在する。これを放置すると、AIが勝手に危険なツールを呼び出してしまう。

承認された後にツールの定義を動的に変更するような攻撃も報告されている。利用するツールの出所を必ず確認し、定義ファイルが勝手に変更されていないか監視する仕組みが不可欠だ。

6. 未検証入力によるコマンドインジェクション防止

AIエージェントが外部からの入力をそのまま使ってシステムコマンドを実行すると、OSごと乗っ取られる危険がある。悪意のある文字列が混入していると、意図しない破壊工作が行われてしまう。

防ぐための具体的な手順は以下の通りだ。

- 外部からの入力値をすべて疑う

- 特殊文字やコマンド制御文字をサニタイズする

- 実行前に意図した形式に合致するか厳格に検証する

AIが生成したコマンドであっても、最終的な実行前には必ず安全性のチェックを挟むべきだ。

しんたろー:

悪意あるプロンプトの注入やコマンドの乗っ取りは本当に厄介だ。

AIは渡されたテキストを文脈ごと素直に解釈してしまうため、システム側での防御が難しい。僕も開発中は、外部から取得したデータとシステムプロンプトの境界を明確にするよう常に気をつけている。

カテゴリ3:データ漏洩とプロンプトの保護

AIの頭脳とも言えるプロンプトや参照データが汚染されると、システム全体の信頼性が崩壊する。

7. コンテキスト漏洩を防ぐスコープの厳格な分離

複数のタスクを並行処理する際、コンテキストウィンドウの分離が甘いと機密情報が漏洩する。あるユーザーの個人情報が、別のユーザーへの回答に混ざってしまうような致命的な事故だ。

セッションやユーザーごとに、コンテキストのスコープを明確に切り離す設計が求められる。メモリの永続化を行う際も、アクセス権限を持つユーザーしかデータを引き出せないように制限をかけよう。

8. システムプロンプトとRAGデータの保護

AIの性格を決めるシステムプロンプトや、回答の根拠となるRAGデータが改ざんされると致命的だ。AIがユーザーを悪意あるサイトに誘導したり、嘘の情報を流したりするようになる。

しかも、プロンプトの変更は従来のセキュリティログには痕跡が残りにくい。これらのデータが格納されるデータベースのアクセス制御は極めて厳格にすべきだ。読み取り専用の権限と、変更履歴の完全なトラッキングが必要になる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

カテゴリ4:AI時代の脆弱性監査と古典的攻撃への備え

最新のAIシステムであっても、狙われるのは意外と古い脆弱性だったりする。防御と監査の両面で視点を広げることが大切だ。

9. 従来型スキャナーの死角を突く攻撃への備え

AIシステムがハッキングされる原因は、必ずしも最新の攻撃手法とは限らない。ある大規模なプラットフォームの事例では、侵入の糸口は古くから存在するSQLインジェクションだった。

入力値自体は無害化されていても、JSONのフィールド名を直接クエリに挿入するような実装の隙が突かれたのだ。従来のスキャナーが見逃しやすい部分であり、AI特有の対策だけでなく、基本的なWebセキュリティの徹底が依然として重要と言える。

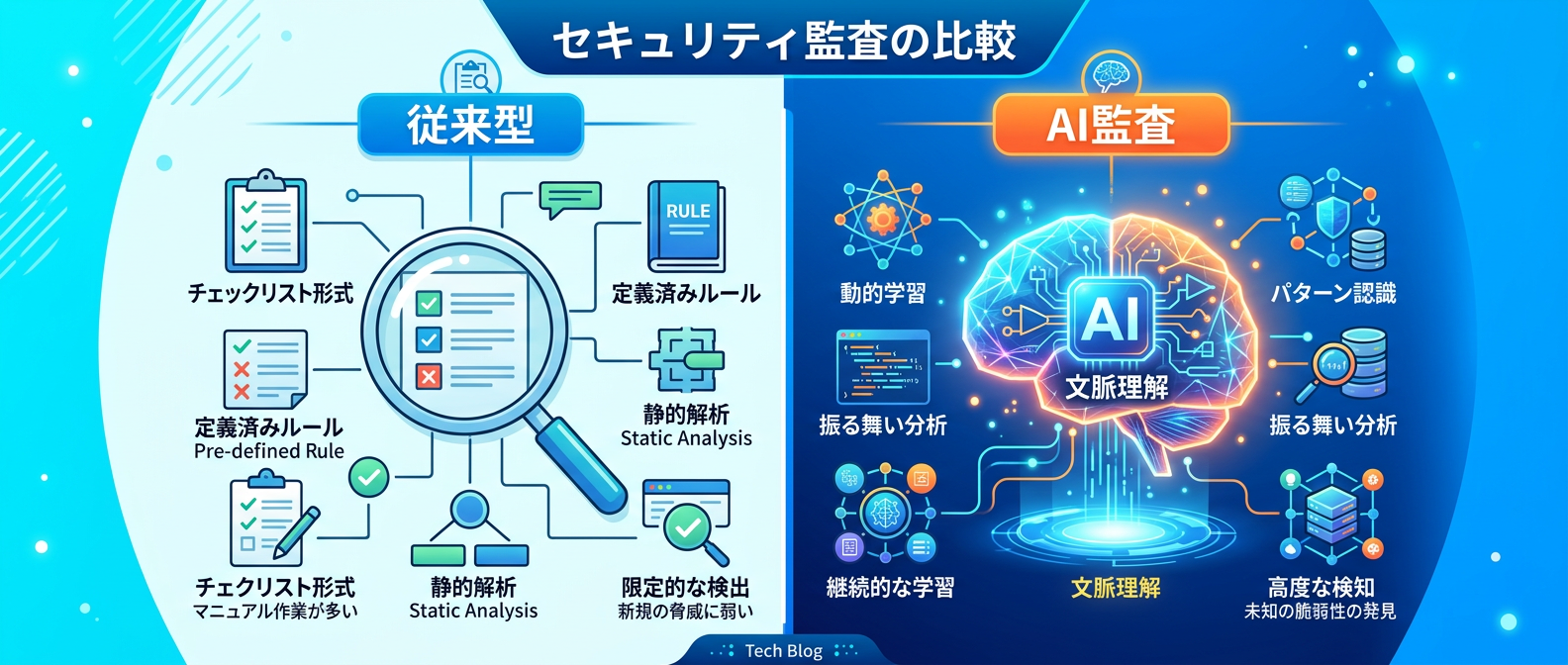

10. AIを活用した文脈依存の脆弱性監査の導入

従来の静的解析ツールは、決まったパターンの照合は得意だが、ビジネスロジックに依存する複雑な脆弱性を見つけるのは難しい。そこで、AI自身をセキュリティ監査ツールとして活用するアプローチが実用化されている。

コードの文脈やデータフローを自律的に読み解き、権限チェックの漏れなどを発見してくれる。人間のエンジニアのように高度な推論を行ってくれるため、今後の防衛の要になるはずだ。

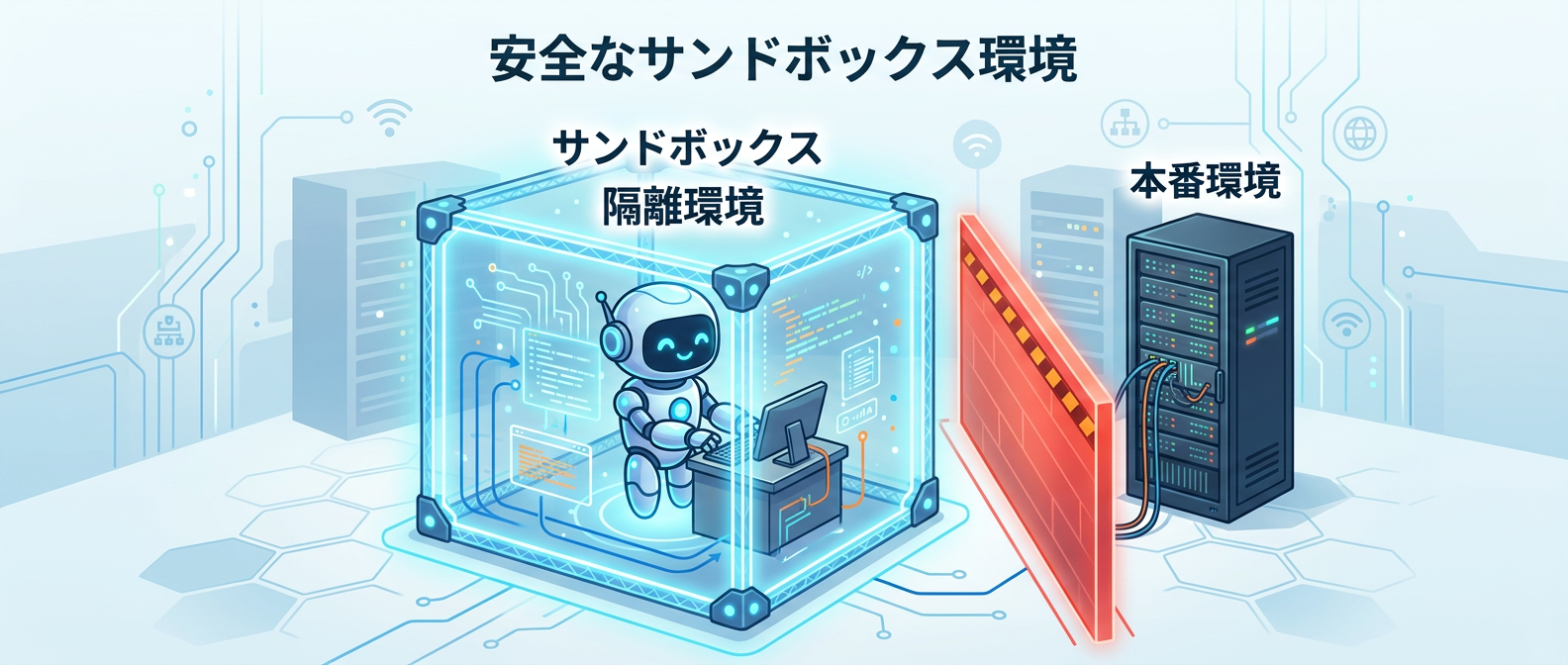

11. 監査環境の安全なサンドボックス化

AIエージェントにコードの監査やテストを任せる際、本番環境や普段の開発環境で直接動かすのは危険だ。エージェントが誤って重要なファイルを削除したり、外部にデータを送信したりするリスクがある。

コンテナ技術などを活用して、ネットワークやファイルシステムが隔離された安全なサンドボックス環境で実行することが強く推奨される。万が一エージェントが暴走しても、被害を最小限に食い止めることができる。

よくある質問(FAQ)

Q1: AIエージェントがAPIを勝手に使いすぎて高額請求されるのを防ぐには?

bantoのようなツールを使い、APIキーを環境変数ではなくOSのセキュアな領域に保存するのが最も確実だ。予算の枠を確保できたときだけキーを渡す構造的なゲートを設けることで、AIがエラーを無視してAPIを呼び続けるリスクを根本から断ち切れる。

Q2: 外部ツールと連携する際の最大のセキュリティリスクは何か?

権限設定が甘いと、AIが意図せずシステムを操作してしまう危険があることだ。また、悪意のある連携サーバーがAIに隠し指示を送るサンプリング悪用や、ツールの説明文を改ざんしてAIを騙す手口など、新たな攻撃手法への警戒も必要になる。

Q3: AIを使ったセキュリティ監査ツールは従来のツールと何が違うのか?

従来の静的解析ツールは決まったパターンの照合が得意だが、複雑な脆弱性は見逃しがちだ。一方、AIエージェントは人間のエンジニアのようにコードの文脈やデータフローを自律的に読み解き、高度な推論を行って脆弱性を発見できる点が決定的に異なる。

Q4: AIシステムに対するサイバー攻撃は、従来のものと全く違う高度なものか?

必ずしもそうではない。大規模なAIプラットフォームがハッキングされた事例でも、侵入の糸口は古くからあるSQLインジェクションだった。JSONのフィールド名を狙うなど、従来のスキャナーが見逃しやすい隙が突かれるため、古典的な脆弱性対策の徹底も依然として重要だ。

Q5: AIのシステムプロンプトが漏洩・改ざんされるとどうなるか?

システムプロンプトはAIの行動ルールを決める脳の設計図だ。これが改ざんされると、AIが機密情報をこっそり外部に送信したりするようになる。しかも、プロンプトの変更は従来のセキュリティログには残りにくいため、発見が非常に遅れるという恐ろしい特徴がある。

まとめ:安全な環境でAIの恩恵を最大化しよう

まとめると、AIエージェントの活用には圧倒的な開発スピードというメリットがある一方で、これまでにないセキュリティリスクも伴う。

まずはAPIキーのセキュアな管理から始め、権限の最小化と監視体制を整えることが先決だ。個人開発でも企業でも、安全な防御策を構築してAIの恩恵を最大限に引き出そう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド