SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

結論:用途によって正解のツールは明確に分かれる

結論から言うと、AIエージェントから複雑なページを操作するなら「playwright-cli」が一番おすすめだ。一方で、RAG構築やデータ抽出が目的なら「WebReader AI API」を選ぶのが正解になる。

最近はClaude CodeなどのAIエージェントにブラウザ操作を任せる機会が増えてきた。しかし、ツールによって得意な領域が全く異なる。対話的なブラウザ制御に向いているものもあれば、スクレイピングに特化したものもある。

Webブラウザの自動化は、かつてはSeleniumやPuppeteerを使って人間が手作業でスクリプトを書くのが当たり前だった。しかし、AIエージェントの進化により、自然言語で指示を出すだけでブラウザを操作できる環境が整いつつある。これにより、開発者の負担は大きく軽減され、より創造的なタスクに時間を割けるようになる。

この記事では、1人SaaS開発者である僕の視点から、用途に応じた最適なWebブラウジング手法を徹底比較する。それぞれのツールの強みと弱みを正確に把握し、自分のプロジェクトに最適な選択肢を見つけてほしい。

AIブラウザ操作ツールの3つの比較軸

ツールを選ぶ際は、以下の3つの軸で比較するといい。

- エージェントからの操作性: 自然言語の指示でどこまで正確に動くか

- 複雑なページへの対応力: 日本語特有の複雑なDOM構造を読み取れるか

- 導入ハードルの低さ: 環境構築の手間やコスト要件に合っているか

それぞれの特徴を詳しく見ていこう。

各ツールの特徴とメリット・デメリット

1. playwright-cli:複雑なページも正確に操作できる本命ツール

MicrosoftのPlaywrightをベースにしたCLIツールだ。Claude Codeとの組み合わせにおいて、現時点で最も信頼できる選択肢と言える。

最大の特徴は、ページの状態をアクセシビリティツリーとして出力する点にある。AIが要素の構造や親子関係を正確に把握できるため、複雑なページやShadow DOMが使われているサイトでも的確に操作できる。通常のスクレイピングツールでは取得が難しい動的な要素であっても、ブラウザのレンダリング結果を直接解釈するため問題なく処理できる。

たとえば、ポータルサイトのトップページのようにリンクが密集しているサイトでも、検索窓とニュースリンクをしっかり区別できる。AIが誤操作を起こしにくい構造になっているのが素晴らしい。さらに、ログインが必要な会員制サイトや、複数のステップを踏むフォーム入力など、状態を保持しながら進める操作にも強い。

メリット

- セマンティックツリーで要素の親子関係が正確にわかる

- 複雑なページやShadow DOMでも的確に操作できる

- 設定不要でClaude Codeからすぐに使える

- ログイン状態の維持や複数ステップの操作に強い

デメリット

- 個別コマンドの実行速度は他のツールと比較してやや遅い

- シンプルなページ操作ではオーバースペックになる場合がある

- メモリ消費が比較的大きい

料金

- 無料(オープンソース)

2. browser-use:圧倒的な高速動作が魅力のツール

AIエージェントからの利用を想定して作られたPython製のブラウザ自動操作ツールだ。バックグラウンドでデーモンが常駐し、ページの要素をフラットなインデックス番号で管理する仕組みになっている。

このツールの強みは、とにかく動作が速いことだ。起動後の個別コマンド実行にかかる時間はわずか0.1秒から0.3秒程度で済む。シンプルな構成のサイトを高速に巡回したい場合には、強力な武器になるはずだ。たとえば、社内用のシンプルな管理画面のテスト自動化や、定型的なデータ入力作業などには最適だと言える。

ただし、複雑なページでは弱点も目立つ。要素をフラットなリストとして返すため、AIが要素間の構造を把握できず、意図しないリンクをクリックしてしまう誤操作が起こりやすい。また、動的に変化する要素が多いモダンなWebアプリケーションでは、インデックス番号のズレが生じるリスクもある。

メリット

- 起動後の個別コマンド実行が非常に高速

- AIエージェントからの利用に特化した設計

- シンプルなページでの操作効率が極めて高い

- 軽量でリソース消費が少ない

デメリット

- 要素をフラットに返すため複雑なページでは構造が把握しにくい

- 誤操作を招きやすく対象サイトを選ぶ

- 動的な要素が多いサイトではインデックスがズレるリスクがある

料金

- 無料(オープンソース)

3. agent-browser:ローカルの既存ブラウザをそのまま活用

Claude CodeなどのAIエージェントからブラウザを操作するためのツールだ。WSL環境からWindows側のChromeを制御する際など、ローカル環境の既存ブラウザを活用したい場合に適している。

開発環境によっては、会社のセキュリティ設定が適用されたブラウザをそのまま使いたいケースがある。このツールを使えば、そういった特殊な環境下でもAIからブラウザを制御できるようになる。普段使っている拡張機能やブックマーク、保存されたパスワードなどをそのまま利用できるため、シームレスな作業が可能になる。

WSL上から直接実行するとエラーになることがあるが、Windows側の実行ファイルを呼び出すラッパースクリプトを用意すれば回避できる。環境構築に少し手間はかかるが、既存のブラウザ環境を維持できるのは大きな利点だ。社内プロキシやVPNを経由しないとアクセスできないテスト環境を操作する際には、このツールが救世主になる。

メリット

- ローカルの既存ブラウザをそのまま活用できる

- セキュリティ設定済みの社内PCブラウザも操作可能

- 開発環境の利便性を損なわずにAIを導入できる

- 既存の拡張機能やセッション情報を引き継げる

デメリット

- WSL環境などではラッパースクリプトの作成が必要

- セットアップに工夫が必要で初心者にはハードルがやや高い

- 環境依存のトラブルが発生する可能性がある

料金

- 無料(オープンソース)

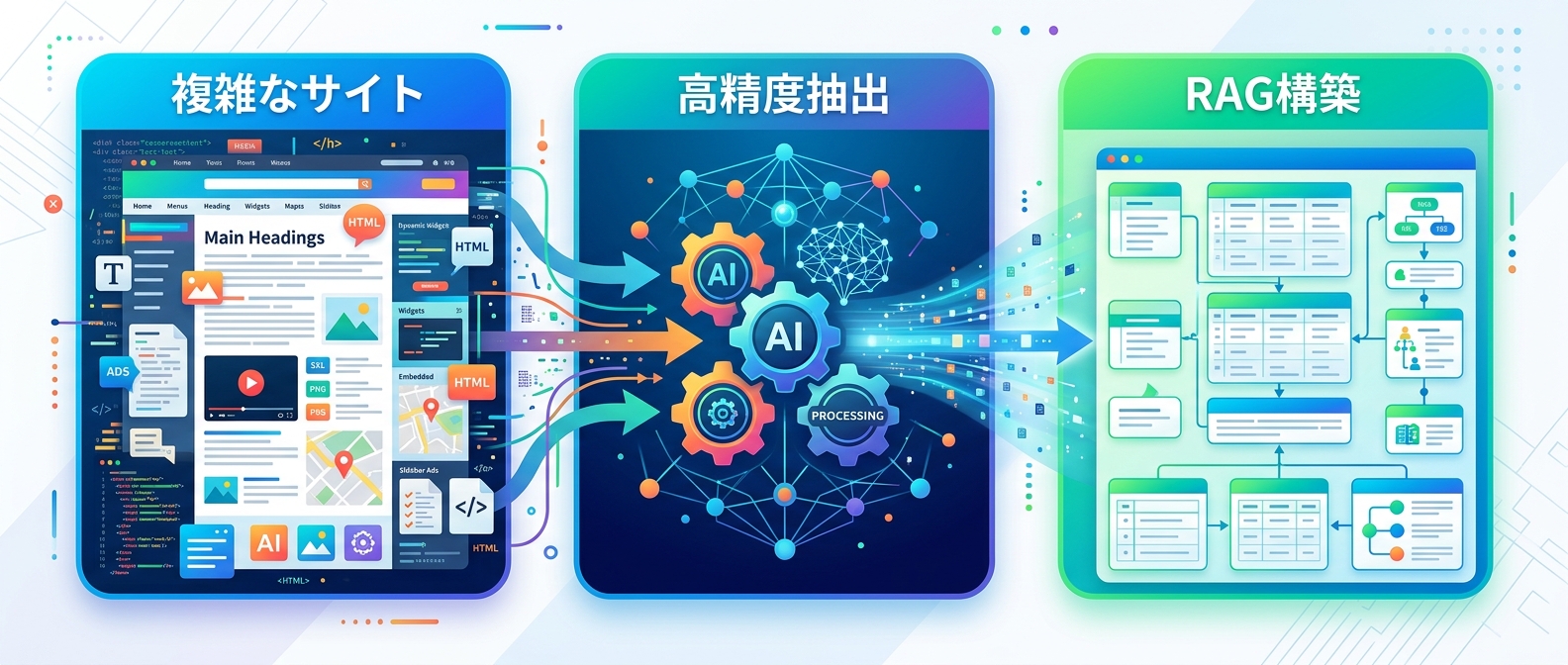

4. WebReader AI API:日本語サイトのデータ抽出に特化

ブラウザの対話的な操作ではなく、RAG構築やデータ抽出に特化したAPIだ。URLを渡すだけで、AI要約付きのMarkdownを返してくれる。

日本のWebサイトは、SPAによる動的レンダリングや複雑なテーブル構造が多く、海外製のスクレイピングツールでは本文を正しく抽出できないことが多い。このAPIは、SUUMOや楽天市場、食べログなど、日本の主要43サイトに対応した専用パーサーを搭載している。各チャンクに見出しのパンくずリストが付与されるため、ベクトルデータベースに保存した後の検索精度も飛躍的に向上する。

Firecrawl互換のAPIなので、LangChainを利用している場合でもエンドポイントのURLを変更するだけで簡単に移行できる。日本語特有の複雑なサイトから高精度にテキストを抽出したいなら、これ一択と言える。社内ドキュメントの検索システム構築や、競合サイトの監視など、データ活用を前提としたプロジェクトで真価を発揮する。

メリット

- 日本語特有の複雑なサイトから高精度にテキストを抽出できる

- 主要43サイトの専用パーサーを搭載している

- 月額10ドルからとコストパフォーマンスに優れる

- 抽出データがRAGに最適化されている

デメリット

- ブラウザの対話的な操作はできない

- データ抽出とRAG用途に特化している

- 無料枠に制限がある

料金

- 月額10ドルから

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

AIブラウザ自動化ツール比較表

各ツールの特徴と用途をわかりやすく一覧表にまとめた。自分の目的に合ったツールを探すための参考にしてほしい。

| ツール名 | 主な用途 | 強み | 弱み | 料金 |

| :--- | :--- | :--- | :--- | :--- |

| playwright-cli | エージェント操作 | 複雑なページの正確な操作 | 実行速度がやや遅い | 無料 |

| browser-use | エージェント操作 | 圧倒的なコマンド実行速度 | 複雑なページで誤操作しやすい | 無料 |

| agent-browser | エージェント操作 | 既存のローカルブラウザ活用 | 環境構築に手間がかかる | 無料 |

| WebReader AI API | データ抽出・RAG | 日本語サイトの高精度な抽出 | 対話的なブラウザ操作は不可 | 月額10ドル〜 |

用途別のおすすめと選び方

ツール選びの結論は、目的によって明確に分かれる。

Claude CodeなどのAIエージェントを使って、ブラウザ上でクリックやテキスト入力などの操作を自動化したいなら、まずはplaywright-cliから導入するのがおすすめだ。複雑なページでもAIが迷わず操作できるため、開発効率が劇的に向上する。特に、モダンなフロントエンドフレームワークで作られたSPAや、動的な要素が多いサイトを扱う場合は、このツールの正確性が不可欠になる。

一方で、AIの操作速度を極限まで高めたい場合や、シンプルなページだけを対象にするなら、browser-useが有力な候補になる。起動後のサクサク動く感覚は、かなり良さそうだ。社内のシンプルな管理ツールや、構造が単純なブログサイトの巡回など、速度が重視されるタスクで活躍する。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、playwright-cliが一番良さそうだ。

理由はシンプルで、設定なしでそのまま動くし、要素の親子関係を正確に読み取ってくれるからだ。

また、社内のセキュリティ要件が厳しく、普段使っているChromeをそのままAIに操作させたい場合は、agent-browserが有力な選択肢になる。セットアップの壁さえ越えれば、非常に快適な環境が手に入る。VPN接続が必要な社内システムや、特定のIPアドレスからしかアクセスできないステージング環境のテスト自動化など、特殊なネットワーク要件があるプロジェクトに最適だ。

もし目的がブラウザ操作ではなく、Webサイトからのデータ抽出やRAGの構築なら、WebReader AI APIが最適解になる。LLMにWebの情報を正確に読み込ませるための前処理ツールとして、これほど頼りになる存在はない。

しんたろー:

WebReader AI APIはかなり良さそうだ。

日本語の複雑なサイトから正確にデータを抜けるツールは少ないから、RAG構築の強力な武器になるはずだ。

よくある質問(FAQ)

Q1: AIエージェントでブラウザ操作を自動化するメリットとは?

AIエージェントにブラウザ操作を任せることで、人間が手作業で行っていた情報収集やテストなどの定型作業を自動化できる。AIが画面の要素を解釈し、自律的にクリックやテキスト入力を行うため、複雑なスクリプトをゼロから書く手間が省ける。自然言語で指示を出すだけで高度なWeb操作が可能になり、開発効率が飛躍的に向上する。さらに、仕様変更に伴うテストスクリプトの修正コストも大幅に削減できる。

Q2: browser-useとplaywright-cliはどちらを選ぶべきか?

用途と対象サイトの複雑さによって選ぶといい。シンプルなページで実行速度を重視する場合は、起動後の動作が高速なbrowser-useが適している。一方、要素が多く複雑なサイトやShadow DOMを含むページを正確に操作したい場合は、要素の親子関係を把握できるplaywright-cliが圧倒的におすすめだ。設定不要ですぐに使える点も魅力だと言える。迷った場合は、まずplaywright-cliから導入するのが安全な選択になる。

Q3: WSL環境からWindowsのブラウザをAIで操作できるか?

もちろん可能だ。agent-browserを使用する場合、WSL上から直接実行するとエラーになることがあるが、Windows側の実行ファイルを呼び出すラッパースクリプトを作成することで回避できる。これにより、会社のセキュリティ設定が適用されたWindows側のChromeを維持したまま、WSL上のAIエージェントからブラウザを制御できるようになる。開発環境と実行環境のギャップを埋める有効な手段だ。

Q4: 日本語サイトのスクレイピングが難しいのはなぜか?

日本のWebサイトは、SPAによる動的レンダリングや広告の多さ、テーブルの複雑な入れ子構造など、独自の複雑なDOM構造を持つことが多いからだ。海外製の汎用スクレイピングツールでは本文を正しく抽出できず、ノイズが混じったり空振りしたりするケースが多発する。そのため、日本の主要サイトに特化した専用パーサーを持つツールを選ぶことが重要になる。精度の低いデータはAIのハルシネーションを引き起こす原因にもなる。

Q5: FirecrawlとWebReader AIの違いとは?

Firecrawlは海外製の強力なAPIだが、月額45ドルからとやや高価で、日本の複雑なサイトの抽出に弱い場合がある。一方、WebReader AIはFirecrawl互換のAPIでありながら、月額10ドルからと安価で、日本の主要サイトに特化した専用パーサーを搭載している。LangChainを利用している場合、エンドポイントを変更するだけで簡単に移行できる。コストパフォーマンスと日本語対応の面で、WebReader AIに軍配が上がる。

まとめ:まずは目的を明確にしよう

AIを使ったブラウザ自動化は、目的に合ったツールを選ぶことがすべてだ。

対話的なブラウザ制御をしたいのか、それとも精度の高いデータ抽出をしたいのか。自分のプロジェクトが抱えている課題を整理してから、最適なツールを導入するといい。

初心者であれば、まずは設定不要でClaude Codeから正確にWeb操作ができるplaywright-cliを導入するのがおすすめだ。複雑なページでも安定して動作するため、AIエージェントの可能性を存分に引き出せる。そして、データ抽出が必要になったタイミングでWebReader AI APIを活用すれば、無駄なく効率的な開発環境が構築できるはずだ。

AIによるブラウザ自動化の技術は日々進化している。これらのツールをうまく組み合わせることで、1人SaaS開発の生産性はさらに高まる。自分の用途に合ったツールを見つけて、開発プロセスを最適化してほしい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド