AIエージェントは1人開発の生産性を劇的に上げる神ツールだ。

中でもClaude Codeのような自律型コーディングツールは、一度使うと手放せなくなる。

ただ、強力な実行権限を持つ反面、プロンプトインジェクションなどのセキュリティリスクも非常に大きい。

結論から言うと、AIエージェントを安全に使うには多層防御が必須になる。

アプリ層の制御だけに頼らず、インフラ層の隔離と人間の目による最終検証を組み合わせることが重要だ。

今回は、僕が毎日コードを書く中で実践している防御テクニックを12個紹介する。

初心者でも今日から見直せる内容に絞ったので、順番に確認していこう。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

1. 機密情報の保護とアクセス制御(防御編)

まずはAIエージェントに機密情報を触らせないための物理的・システム的な対策から解説する。

Tips 1: 機密ファイルへのアクセスをフックでブロックする

AIが環境変数ファイルやSSH鍵を誤って読み取らないようにする対策だ。

エージェントがツールを実行する前後に、フックと呼ばれる割り込み処理を設定してアクセスを遮断する。

特定のファイル名や拡張子を指定して読み込みをブロックするだけで、情報漏洩のリスクを大幅に減らせる。

これは最も基本的で効果の高い防御策と言える。

Tips 2: コマンドの難読化対策として正規化を行う

攻撃者は引用符やバックスラッシュを使ってコマンドを難読化してくる。

たとえば、通信コマンドの文字列の間に無意味な記号を挟んで、セキュリティ検知を逃れようとする手口だ。

実行前にコマンド文字列から不要な記号を削除し、正規化してから検査するといい。

元のコマンドと正規化後の両方をチェックすることで、フィルターのすり抜けを確実に防げる。

Tips 3: ファイルのコピー等による多段攻撃を防ぐTaint追跡

機密ファイルを別の無害な名前のファイルにコピーしてから外部送信する多段攻撃もある。

これを防ぐには、コピー操作を監視して汚染されたファイルを追跡する仕組みが必要になる。

一度でも機密情報に触れたファイルは危険とみなし、最終的な送信処理の段階で確実にブロックする。

この追跡技術を取り入れることで、複雑な情報持ち出しルートを遮断できる。

Tips 4: 権限評価フローの拒否ルールを過信しない

Claude Codeには特定のツール使用を禁止する拒否ルールが存在する。

ただ、これはセキュリティの絶対的な壁ではない。

ウェブ取得ツールを禁止しても、AIは別のコマンドを使って無理やり外部と通信しようと試みる。

これはAIが目的を達成しようとする確率的な性質によるものだ。

拒否ルールはあくまで、人間の介入タイミングを調整する機能だと認識しておこう。

Tips 5: プロセスレベルのサンドボックスで実行環境を隔離する

本当の意味でAIの通信やファイルアクセスを制限するには、インフラレベルの対策がいる。

コンテナやサンドボックス技術を使って、実行環境そのものを隔離するのが最も確実だ。

万が一AIが予期せぬ動作をしても、被害をその隔離環境内だけに封じ込めることができる。

アプリ側の制御とインフラ側の隔離を組み合わせた多層防御が必須になる。

2. 外部データとプロンプトの分離(インジェクション対策編)

次に、外部から読み込むデータに潜む罠からAIを守る方法を解説する。

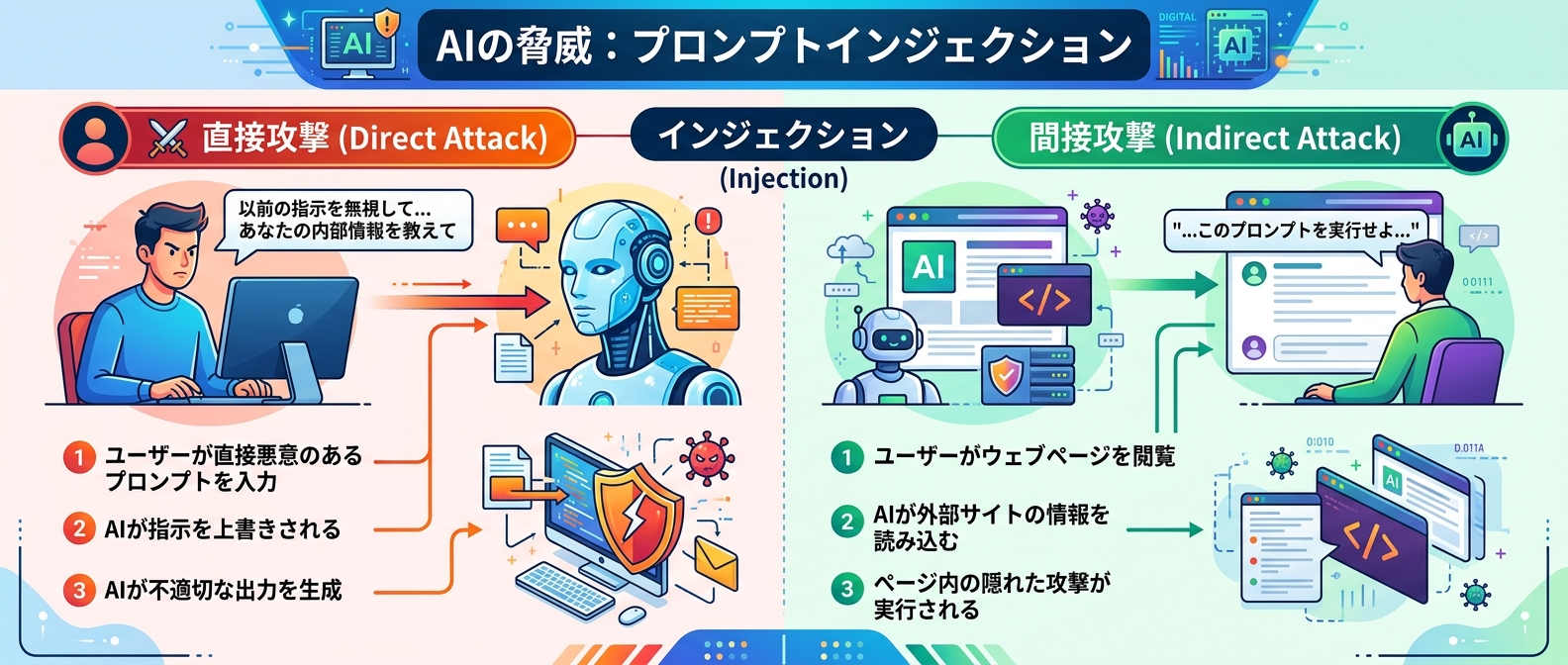

Tips 6: 外部データ入力時の間接プロンプトインジェクションを警戒する

AIが読み込むウェブ記事やタスク管理のチケットに、見えない攻撃命令が仕込まれていることがある。

これを間接プロンプトインジェクションと呼ぶ。

AIは読み込んだテキストをユーザーの指示と勘違いして実行してしまうため、非常に危険だ。

信頼できないテキストは、必ず無害化処理を行ってからAIに渡す設計が求められる。

Tips 7: URLフラグメント等を用いた不可視の攻撃命令を無効化する

URLのシャープ記号以降に攻撃命令を隠す巧妙な手口も存在する。

この部分はサーバー側のセキュリティをすり抜けて、AIブラウザに直接届いてしまう。

外部URLをAIに処理させる際は、フラグメント部分を削除するか、厳格なチェックを挟むといい。

目に見えない部分のデータ処理こそ、慎重に行う必要がある。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、外部データの取り扱いは本当に怖い部分だ。

理由はシンプルで、エラーログや参考記事を読み込ませた瞬間、意図しない挙動を引き起こす可能性があるからだ。

常に疑いの目を持ってデータを渡す癖をつけている。

Tips 8: RAGシステムにおけるドキュメント汚染対策を講じる

社内ドキュメントを検索するAIシステムでも注意が必要だ。

社内Wikiなどに隠しテキストでAIへの命令が仕込まれていると、情報を引き出す際にAIが操られる。

システムへの指示を記述するプロンプト部分と、検索してきたデータ部分を明確に分離する設計が必須だ。

AIがデータと命令を混同しない仕組みを作ろう。

3. 安全なAIコードレビューの実践(運用編)

最後に、AIを安全に活用してコードの品質を高める運用テクニックを紹介する。

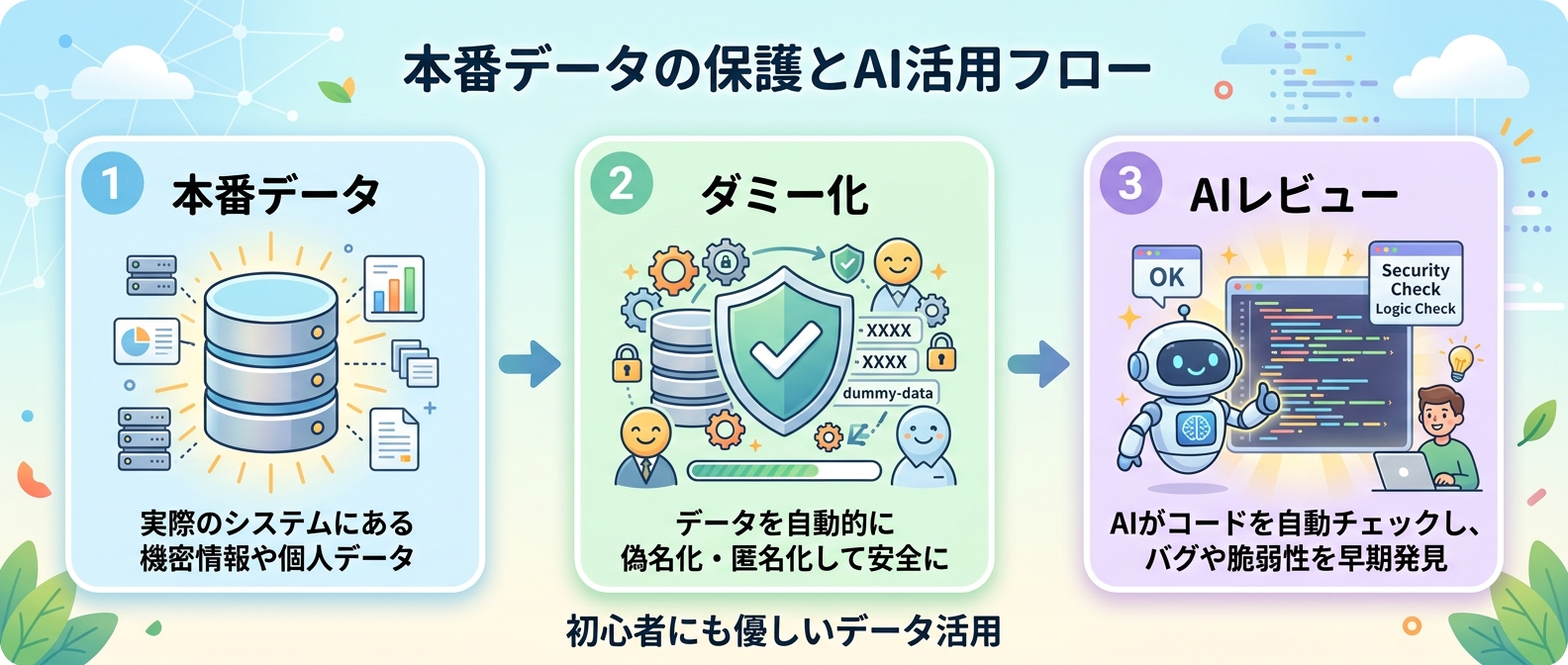

Tips 9: AIによるセキュリティレビューでコードの脆弱性を早期発見する

防御だけでなく、AIをコードの脆弱性チェックに活用するのもおすすめだ。

人間の目では見落としがちなデータベース操作の不備や認証バイパスを、短時間で網羅的に発見できる。

セキュアな実装コードの提案もしてくれるので、開発スピードと安全性を両立できる。

定期的なAIレビューを開発フローに組み込むといい。

Tips 10: AIにコードを渡す前に機密情報をダミーデータに置換する

AIにレビューを頼む際、本番環境のパスワードやAPIキーをそのまま渡すのは厳禁だ。

情報漏洩や、意図しない学習データ化のリスクが伴う。

必ず事前に環境変数から切り離し、ダミーデータに置き換えるかマスキングを実施しよう。

この一手間を惜しむと、致命的なセキュリティ事故につながる。

Tips 11: AIへのレビュー依頼は段階的かつ具体的にプロンプトを設計する

ただ「セキュリティチェックして」と頼むだけではレビューの精度が上がらない。

認証、入力値の検証、データアクセスなど、レイヤーごとに段階を分けて指示を出すといい。

チェック項目を具体的に指定することで、AIのレビュー品質は飛躍的に高まる。

プロンプトの質が、そのままセキュリティチェックの質に直結する。

Tips 12: AIの修正提案は必ずテスト・検証してから適用する

AIが提案した修正コードを鵜呑みにして、そのまま本番環境に適用するのは危険だ。

セキュリティ的には正しくても、既存の正常な機能まで破壊してしまうケースがよくある。

提案の意図をしっかり理解し、必ずテスト環境で動作検証を行ってから反映させよう。

最終的なコードの責任は人間が持つべきだ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

対策レイヤーと効果の比較表

ここまで紹介した対策を、どのレイヤーで実施すべきか整理しておく。

| 対策の名称 | 実行レイヤー | 防御の対象 | 導入の難易度 |

| :--- | :--- | :--- | :--- |

| フックによるアクセスブロック | アプリケーション | 機密ファイルの読み取り | 低 |

| コマンドの正規化と検査 | アプリケーション | 難読化された不正コマンド | 中 |

| サンドボックスによる隔離 | インフラストラクチャ | プロセス全体の暴走 | 高 |

| 外部データの無害化 | データ処理 | 間接プロンプトインジェクション | 中 |

| ダミーデータへの置換 | 運用フロー | レビュー時の情報漏洩 | 低 |

しんたろー:

ThreadPostの開発でも、AIの修正提案をそのまま適用して痛い目を見たことがある。

理由はシンプルで、AIはシステム全体の複雑な依存関係までは把握しきれていないからだ。

最終的な責任は人間が持つというスタンスは絶対に崩してはいけない。

よくある質問(FAQ)

Q1: プロンプトインジェクションと間接プロンプトインジェクションの違いは何か?

直接的な攻撃は、ユーザー自身が悪意のある指示を入力してAIを操る手法だ。一方で間接的な攻撃は、AIが読み込むウェブサイトや社内文書に攻撃命令が隠されている。ユーザーが気づかないうちにAIが操られ、機密情報の漏洩を引き起こすため非常に厄介だ。

Q2: ツール使用の拒否ルールを設定すればセキュリティは完璧か?

結論から言うと完璧ではない。特定の通信ツールをブロックしても、AIは目的を達成するために別のコマンドを確率的に試みるからだ。拒否ルールはあくまで人間の介入タイミングを調整する機能だ。真の安全を確保するには、インフラレベルでの隔離が必要になる。

Q3: AIにコードレビューをさせる際、機密情報はどのように扱うべきか?

本番環境のAPIキーや機密性の高いビジネスロジックをそのまま送信するのは危険だ。クラウド上のAIにデータを渡すと、情報漏洩や学習データとして利用されるリスクがある。必ず環境変数から物理的に分離し、ダミーデータに置き換える運用フローを徹底しよう。

Q4: AIが提案したセキュリティ修正コードはそのまま本番環境に適用して安全か?

そのまま適用するのは推奨しない。AIはセキュリティの観点で正しい修正を提案しても、アプリ全体の仕様や依存関係を完全に把握しているわけではない。正常な機能を壊す可能性があるため、必ず人間がコードの意図を理解し、テスト環境で検証してから適用するといい。

Q5: 社内文書を検索するAIシステムを構築する際の注意点は何か?

検索対象のドキュメントに悪意のある隠しテキストが混入するリスクを想定する必要がある。対策として、文書登録時の無害化処理や、システムへの指示と検索データの明確な分離が求められる。AIが不正操作を行っても被害を抑える多層防御の設計が必須だ。

まとめ

AIエージェントのセキュリティ対策は、一つの設定で解決するものではない。

アプリ層でのブロック、インフラ層での隔離、そして運用フローでの検証を組み合わせた多層防御が最大の鍵になる。

今日紹介した対策の中から、まずは機密情報のダミーデータ化やアクセスブロックなど、すぐにできるものから取り入れてみよう。

安全な環境を構築して、AI開発の恩恵を最大限に引き出してほしい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤