SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

泥沼化するAIの覇権争いと開発者への余波

1,600万回の不正抽出。

24,000個のダミーアカウント。

Anthropicが中国のAIラボを名指しで非難した。

自社の強力なAIモデル「Claude」の能力が、組織的に盗み出されていたという発表だ。

一方で、そのAnthropic自身は米国防総省から「サプライチェーンリスク」として排除された。

さらにNvidiaが260億ドルをオープンモデルに突っ込む。

AIの覇権争いが、単なる技術競争から地政学と倫理の泥沼の戦争に変わった。

僕ら開発者のAPI選定やアーキテクチャ設計に直結する、極めて実務的な問題だ。

AIモデルの「蒸留」と引き裂かれる倫理基準

事の発端はAnthropicの公式声明だ。

DeepSeek、Moonshot、MiniMaxの3社が、Claudeの能力を不正に抽出していたと発表した。

使われた不正アカウントは24,000個にのぼる。

抽出されたデータは1,600万回のやり取りに及ぶ。

これは明確な利用規約違反だ。

強力なAIの出力を、自社の低性能モデルに学習させる「蒸留」と呼ばれる手法が使われた。

蒸留を使えば、開発のコストと時間を大幅にショートカットできる。

ゼロからモデルを訓練するには数千枚の最新GPUと膨大な時間が必要だが、先行する高性能モデルの出力を教師データにすれば、数分の一のリソースで同等の推論能力を模倣できる。

Anthropicはこれを「米国の安全保障上の脅威」と断じた。

正規のモデルには危険な出力を防ぐ厳重なガードレールが組み込まれているが、不正に蒸留されたモデルにはその安全装置が引き継がれない。

ガードレールが外れたAIが拡散するリスクを警告している。

生物兵器の設計や、大規模なサイバー攻撃、権威主義国家による大量監視システムへの転用が懸念される。

Anthropicは米国の技術的優位性を保つため、政府の輸出管理を強く支持する姿勢を打ち出した。

しかし同時に、奇妙な矛盾が起きている。

米国防総省(ペンタゴン)がAnthropicをシステムから排除した。

2億ドル規模の政府契約が白紙になった。

原因はAnthropicの厳格な倫理規定だ。

彼らは契約において「AIを大量監視や自律型兵器に使用しない」という条件を求めた。

ペンタゴンはこれを拒否した。

結果として、Anthropicは国防総省から「サプライチェーンリスク」に指定された。

これは通常、敵対国の企業に対して使われる厳しいレッテルだ。

代わりにOpenAIやxAIが、政府の機密システムに採用されている。

さらに、ハードウェアの巨人Nvidiaが動いた。

今後5年間で260億ドルをオープンウェイトモデルに投資すると発表した。

中国のオープンモデル台頭に危機感を抱いた結果だ。

新作の「Nemotron 3 Super」は1,280億パラメータを持ち、Claude 4.5 Haikuに匹敵する性能を叩き出している。

圧倒的な資金力でオープンモデル市場を制圧し、開発者を自社のGPUエコシステムに縛り付ける狙いがある。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

API依存の終焉とマルチモデル時代の幕開け

この一連の動きは、僕らの開発環境に直結する。

API依存のリスクが、全く新しい次元に突入した。

これまでは「サーバーダウン」や「唐突な料金改定」が主なリスクだった。

今は「地政学」と「倫理ポリシー」が直接的なブロック要因になる。

Anthropicが米国防総省から排除された事実は重い。

エンタープライズ向けのシステム開発で特定のAPIを採用する際、顧客から思わぬ懸念を示される可能性が出てきた。

「政府機関からリスク指定されている企業のAPIを使って大丈夫なのか」という問いだ。

技術的な性能とは全く無関係のところで、採用のハードルが上がる。

しんたろー:

毎日Claude Codeでコード書いてる身からすると、このニュースはかなり複雑な気分になる。

倫理を貫く姿勢はかっこいいけど、結果的にビジネスの選択肢が狭まるのは開発者としても悩ましいところだ。

モデルの蒸留問題も、決して無関係ではない。

AIの出力を別のAIに食わせる処理は、日常的な開発パイプラインでもよく発生する。

高性能なAPIに合成データを作らせて、ローカルの軽量モデルをファインチューニングする手法だ。

Anthropicは不正抽出を検知するシステムを大幅に強化しており、自社サービスのバックエンドで回している自動処理が、誤って「蒸留攻撃」と判定されるリスクがある。

アカウントがBANされれば、サービスは即座に停止する。

プロンプトの自動生成ループや、大量のデータ整形バッチ処理の設計には、これまで以上の注意が必要だ。

そして、Nvidiaのオープンモデル参入はゲームチェンジャーだ。

これまでオープンモデルの選択肢は、事実上MetaのLlamaか中国のDeepSeekだった。

しかしMetaは完全オープンの姿勢を少しずつ後退させている。

そこにNvidiaが260億ドルという規模の資金を投下する。

「Nemotron 3 Super」は、ローカル環境で動かせるClaude 4.5 Haikuだ。

特定のプロプライエタリAPIに依存しないシステム開発が、いよいよ現実的な選択肢になった。

しんたろー:

APIの従量課金に怯えながら開発する日々も、そろそろ終わりが見えてきたかもしれない。

自前のサーバーでNvidiaのモデルをホストする構成、気になってきた。

西側のAI企業がモデルをクローズドにし、中国企業がオープンモデルで攻勢をかける。

それに焦ったNvidiaが、自ら巨大なオープンモデルを作り始める。

このねじれた構造の中で、僕ら開発者はどの技術スタックを選ぶか。

Claude Codeは相変わらず最高だ。

コーディングの相棒として、これ以上のツールは今のところない。

でも、本番環境の推論APIまで特定の1社にフルコミットするのはリスクが高すぎる。

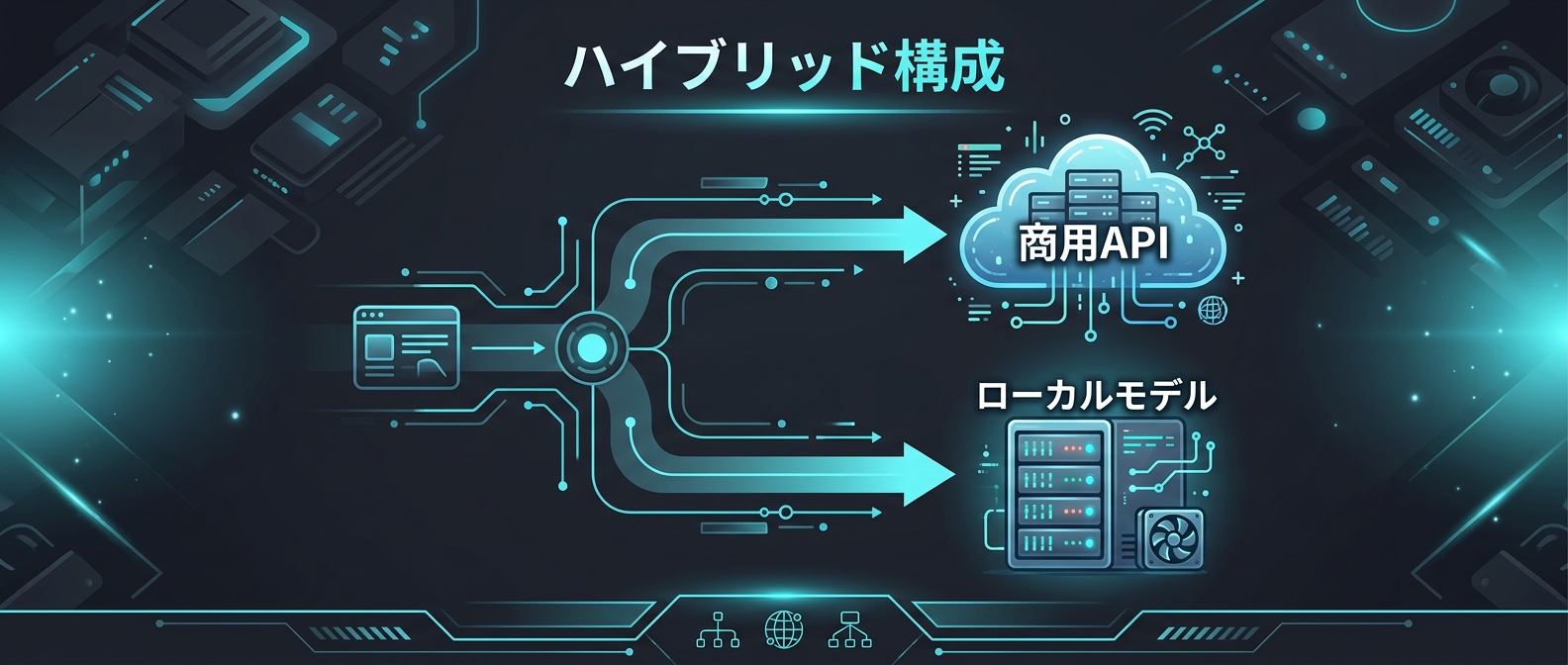

マルチモーダル処理や高度な推論が求められる部分は、強力な商用APIを使う。

定型的なテキスト処理や大量のバッチ処理は、自社ホストのオープンモデルに逃がす。

こういうハイブリッドなアーキテクチャ設計が、これからのシステムの基本になる。

技術の優劣だけでなく、各社の政治的スタンスや地政学的リスクまで考慮して技術選定する局面だ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

開発者が今すぐ備える3つの防衛策

技術選定の基準が根本から変わろうとしている。

特定のAPIへの過度な依存は、もはや技術的負債と同義だ。

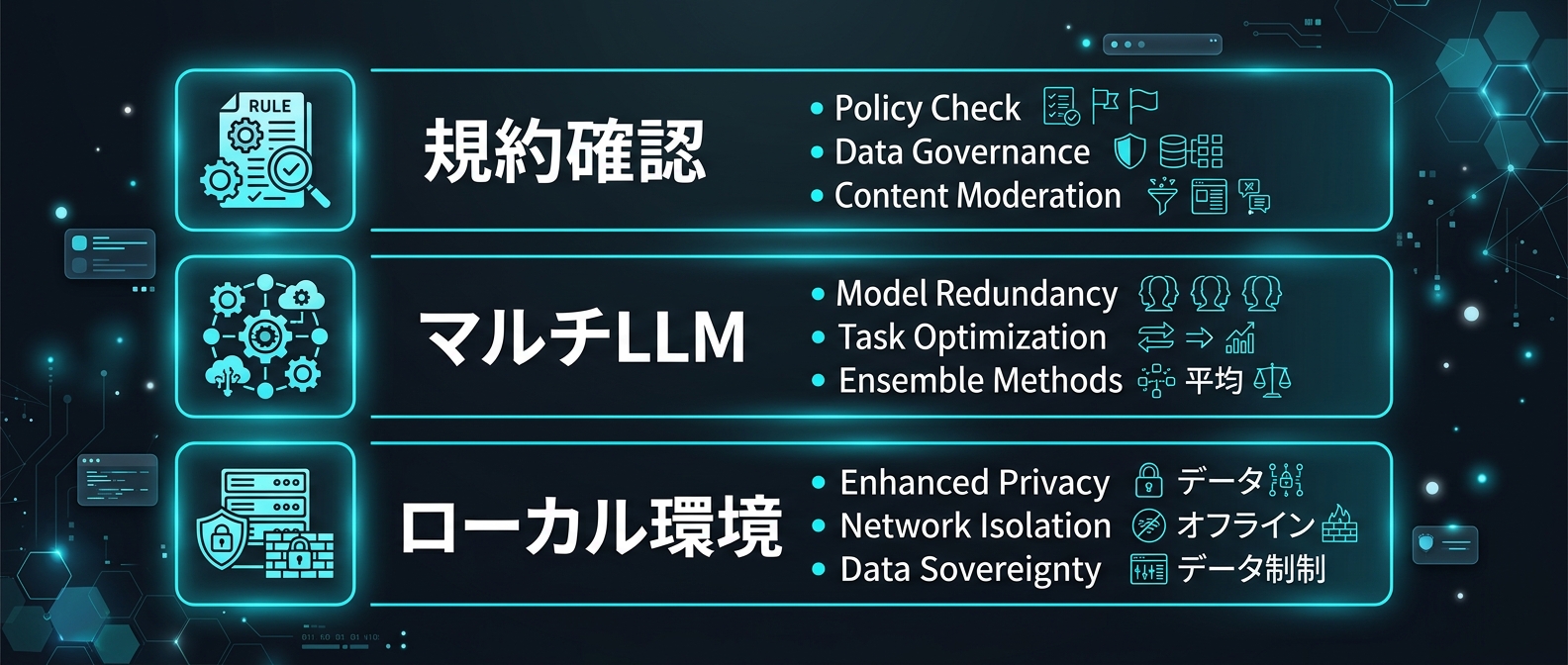

第一に、利用規約とデータフローの再確認だ。

Anthropicは不正抽出の監視を強化しており、自社アプリの裏側でAPIの出力をどのように扱っているか洗い出す必要がある。

- APIの出力を別のLLMの学習データに使っていないか

- プロンプトの自動生成ループが「蒸留」と判定される挙動をしていないか

- 規約違反による突然のAPI停止に対するフェイルセーフはあるか

- 顧客データがサードパーティの学習に利用されない設定になっているか

規約違反によるアカウント停止は、サービスにとって致命傷になる。

特に生成AIを組み込んだSaaSを運営している場合、バックエンドの処理フローを今一度見直しておく価値がある。

第二に、マルチLLMアーキテクチャの前提化だ。

特定のAPIが地政学的な理由や倫理規定で突然使えなくなるリスクがあり、単一のプロバイダーに依存したコードベースは非常に脆い。

- LLM呼び出し部分の抽象化レイヤーの実装

- 複数プロバイダー間での動的なルーティング機能

- プロンプトテンプレートの標準化と互換性の確保

- API障害時の自動フォールバック機構

OpenAI、Anthropic、そしてローカルのオープンモデル。

これらをいつでも切り替えられるように設計しておく。

第三に、ローカルLLMのホスティング環境の準備だ。

Nvidiaの「Nemotron 3 Super」のような強力なモデルが無料で手に入る今、クラウドのGPUインスタンスで自前ホストする選択肢を検討するタイミングだ。

- クラウドGPUインスタンスの月額固定費の算出

- APIの従量課金との損益分岐点のシミュレーション

- 推論サーバーの構築とスケーリング戦略

- 新しいアーキテクチャに対応した実行環境の検証

しんたろー:

うちの環境でも、バックエンドの処理を外部APIにかなり依存してるから他人事じゃない。

規約変更一発でサービスが止まるリスクを考えると、ローカルモデルへのフォールバックは早めに組んでおきたいところだ。

AIモデルの性能差は、徐々に縮まりつつある。

トップクラスの商用モデルと、オープンモデルの差は数ヶ月の遅れでしかない。

無理に最新の巨大モデルを使わなくても、十分な品質が出せるユースケースは多い。

開発者に求められるのは、ビジネスの要件に合わせて適切なサイズとコストのモデルを組み合わせる設計力だ。

地政学リスクや企業の倫理ポリシーという、コードの外側にある変数も計算に入れる局面になった。

よくある質問(FAQ)

Q1: Anthropicが受けた「蒸留(distillation)攻撃」とは具体的にどんな手法ですか?

強力なAIモデルの出力を大量に生成させ、それを教師データとして自社の小規模モデルを訓練する手法だ。

高度な推論の過程やコーディングの出力結果を学習させることで、ゼロから訓練するよりも圧倒的に早く、安くモデルを賢くできる。

Anthropicは、24,000個の規約違反アカウントを使い、1,600万回のやり取りを通じてClaudeの能力が不正に抽出されたと発表している。

Q2: なぜAnthropicは米国防総省(ペンタゴン)のシステムから排除されたのですか?

Anthropicが契約において「AIを大量監視や自律型兵器に使用しない」という厳格な倫理条項を求めたためだ。

ペンタゴン側がこの制限を拒否したことで契約は決裂し、2億ドル規模の政府契約が白紙になった。

その結果、ペンタゴンはAnthropicを「サプライチェーンリスク」に指定し、代わりに制限の緩いOpenAIやxAIのシステムを採用している。

Q3: Nvidiaの新しいオープンモデル「Nemotron 3 Super」は実務にどう影響しますか?

Nvidiaが260億ドルを投じて開発した1,280億パラメータのオープンウェイトモデルで、Claude 4.5 Haikuに匹敵する性能を持つ。

開発者にとっては、特定の商用APIに依存せず、自社のGPUサーバー上で高性能なAIをホストする有力な選択肢となる。

APIの従量課金や規約変更のリスクを回避するための、強力な代替手段として機能する。

まとめ

AIの覇権争いは、技術の枠を超えて国家の安全保障と倫理の対立にまで発展している。

特定のAPIに依存するリスクがかつてなく高まる中、柔軟で堅牢なアーキテクチャ設計が求められている。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド