SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

結論:用途に合わせて使い分けるのが正解だ

結論から言うと、感情表現にこだわるならFish Audio S2-Pro、圧倒的な速度と正確性を求めるならHume AI TADA、そして日常的な動画生成ならOpenAI Soraがおすすめだ。

最近は生成AIの進化がすさまじく、毎日のように新しいモデルが登場している。

個人開発者やクリエイターの中には、結局どれを使えばいいのか、自分の用途に合っているのはどれかと迷っている人も多いはずだ。

今回は、2026年現在で特に注目すべき最新の音声・動画生成モデル3つをピックアップして徹底比較していく。

それぞれのツールの特徴やメリット、デメリットをわかりやすく解説するので、自分のプロジェクトに合ったものを見つけるといい。

比較の軸は「表現力」「速度」「手軽さ」の3つ

ツールを選ぶときは、まず何を作りたいのかという目的を明確にすることが重要だ。

今回は「感情の表現力」「生成スピードと正確性」「普段使いの手軽さ」という3つの軸で比較を行った。

音声生成においては、人間らしい感情の揺れを表現できるかどうかがクオリティに直結する。

一方で、ニュースや解説動画では、読み間違いのない正確性とスピードが求められる。

動画生成においては、いかに日常のワークフローに組み込めるかが鍵になる。

これらの視点から、各ツールの強みと弱みを包み隠さず解説していく。

1. Fish Audio S2-Pro|圧倒的な感情制御とボイスクローニング

Fish Audio S2-Proは、テキストから音声を生成する最新のフラッグシップモデルだ。

最大の強みは、自然言語のタグを使って直感的に感情をコントロールできる点にある。

従来の音声合成ツールでは、声の高低やスピードを細かく数値で設定する必要があり、非常に手間がかかっていた。

しかしこのモデルなら、テキストの中に「ささやき」や「笑い」といったタグを直接書き込むだけでいい。

AIが文脈を理解し、リアルタイムに声のトーンやリズムを調整してくれる。

たとえば、ゲームのキャラクターボイスやYouTubeのナレーションを生成したいとき、別々の感情モデルを用意する必要がなくなる。

悲しいシーンでは声を震わせ、楽しいシーンでは弾んだ声で話すといった演出が、プロンプトの工夫次第で簡単に実現できる。

まるでプロの声優やナレーターが演技しているかのような自然な音声を作れるのは大きな魅力だ。

さらに、150ミリ秒以下という極めて低い遅延で高音質な音声を生成できるため、リアルタイムの対話アプリにも応用しやすい。

また、10秒から30秒の短いクリアな音声データがあれば、その人の声質を再現する「ゼロショット・ボイスクローニング」が可能だ。

従来のように何時間もかけて大量のデータを集め、モデルを再学習させる手間が一切かからない。

誰でも手軽に自分やキャラクターのクローン音声を作れるようになっている。

ただし、高度な感情表現を最大限に引き出すには、適切なタグ付けの試行錯誤が必要になる。

使いこなすには少しコツがいるが、表現力に徹底的にこだわるならこれ一択と言える。

2. Hume AI TADA|ハルシネーションゼロの超高速音声生成

Hume AI TADAは、生成スピードと正確性に特化したオープンソースの音声生成モデルだ。

テキストの単語と音声信号を1対1で厳密に同期させるという、全く新しい仕組みを採用している。

これにより、競合モデルの5倍以上という圧倒的な生成スピードを実現した。

一番のメリットは、単語のスキップや存在しない言葉を捏造する「ハルシネーション」が完全に排除されていることだ。

AIの音声読み上げでよくある、勝手に違う言葉を話してしまうというトラブルが起きない。

実際に1,000回以上のテストが行われたが、ハルシネーションはゼロだったと報告されている。

ニュースの原稿読み上げや、ビジネス向けの解説動画のナレーションなど、一言一句正確に伝える必要がある場面で大活躍するはずだ。

文字起こしと音声が完全に一致するため、字幕付きの動画制作も圧倒的に楽になる。

また、スマートフォンで動作するほどコンパクトに設計されているのも見逃せないポイントだ。

クラウドのサーバーに依存せず、端末のローカル環境でサクサク動かすことができる。

オフライン環境で使いたい場合や、ユーザーのプライバシーを重視するアプリに組み込むのに最適だ。

ただし、長文を連続して読み上げさせると、音声のトーンが不安定になることがあるという弱点もある。

そのため、短い応答や対話型のインターフェースで使うのがおすすめだ。

オープンソースとして公開されているため、開発者ならすぐに手元で試せるのも大きな利点だ。

3. OpenAI Sora|ChatGPT統合で日常に溶け込む動画生成

OpenAI Soraは、圧倒的なクオリティと物理法則の理解を誇る高品質な動画生成AIだ。

これまでは単独のアプリとして提供されていたが、今後はChatGPTのインターフェースに直接統合される計画が進んでいる。

週に約9億2000万人が利用する巨大なプラットフォームに組み込まれることで、使い勝手が劇的に向上する見込みだ。

最大のメリットは、対話形式でシームレスにプロンプトを調整しながら動画を作れるようになることだ。

これまでの動画生成は、一度プロンプトを入力して結果を待ち、失敗したらまた最初から入力し直すという面倒な作業が必要だった。

しかしChatGPTに統合されれば、もっとカメラを右に動かして、背景を夕暮れに変えてといった指示をチャットで伝えるだけで済む。

専用の動画生成ツールを開く手間がなくなり、文章を書いたり調べ物をしたりする日常的な作業の延長で、高品質な動画を生成できるようになる。

デメリットとしては、利用回数の制限が厳しくなる可能性が高いことが挙げられる。

動画生成は、テキストや音声の生成に比べて膨大な計算リソースを消費する。

サーバーにかかる負荷とコストが桁違いに大きいため、無料ユーザーには厳しい制限が設けられるはずだ。

本格的に活用する場合は、有料プラン限定のプレミアム機能として割り切る必要がある。

それでも、普段使っているチャットAIの中で、思いついたアイデアを即座に動画化できる体験は非常に魅力的だ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

3大モデルの徹底比較表

それぞれのツールの特徴や料金体系を一覧表にまとめた。

用途に合わせて最適なものを選ぶといい。

| サービス名 | 得意分野 | 生成速度 | 正確性(ハルシネーション) | 料金・提供形態 | おすすめ度 |

| --- | --- | --- | --- | --- | --- |

| Fish Audio S2-Pro | 感情豊かな音声生成と声の複製 | 速い(150ms以下の低遅延) | タグ付け次第で変動 | クラウドAPI / オープンモデル | ★★★★★ |

| Hume AI TADA | 高速で正確な音声読み上げ | 超高速(競合の5倍以上) | 完璧(ハルシネーションゼロ) | オープンソース(MITライセンス) | ★★★★☆ |

| OpenAI Sora | 高品質な動画生成 | 動画のため時間はかかる | プロンプトへの忠実度が高い | ChatGPTに統合予定(有料の可能性大) | ★★★★☆ |

用途別のおすすめと僕のイチ推し

ここまで3つのモデルを比較してきたが、結局どれを使えばいいか迷う人もいるはずだ。

目的別に整理すると以下のようになる。

* 感情豊かなキャラクターボイスを作りたい:Fish Audio S2-Pro

* ニュースや解説動画の正確なナレーションが欲しい:Hume AI TADA

* チャットしながら直感的に動画を作りたい:OpenAI Sora

しんたろー:

最近は音声や動画の生成AIがどんどん進化していて、個人開発者としてはワクワクが止まらない。

とはいえ、僕自身は普段Claude Codeを使って1人SaaS開発をしている身だ。

毎日ターミナルでコードを書いていると、AIの「正確性」と「手軽さ」がどれだけ重要か身に染みてわかる。

その点、ハルシネーションゼロを謳うHume AI TADAのアプローチはすごく理にかなっていると感じる。

自分のサービスに音声インターフェースを組み込むなら、まずはこれを使ってみたいところだ。

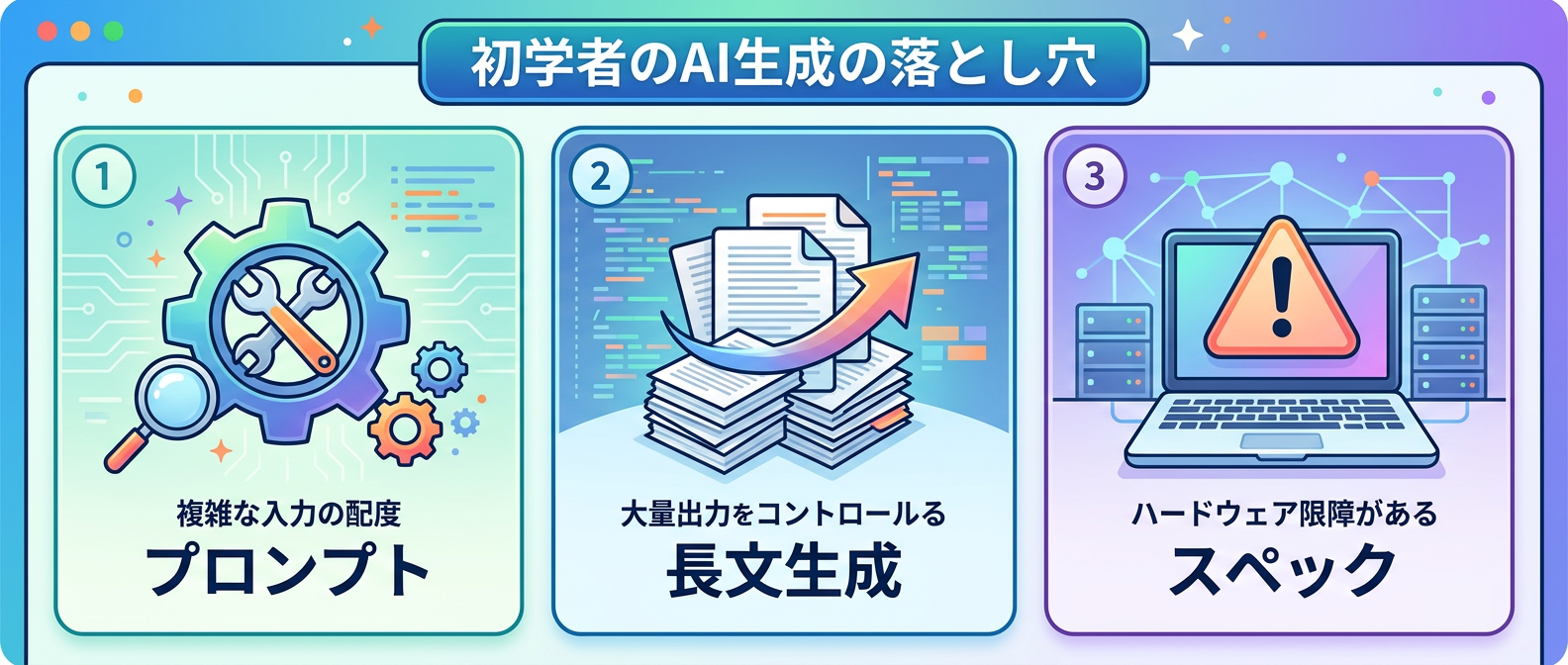

初心者がつまずきやすいポイント

新しいAIツールを触るとき、初心者がハマりやすい罠がいくつかある。

事前に対策を知っておけば、無駄な時間を減らしてスムーズに開発を進められるはずだ。

* プロンプトの調整に時間をかけすぎる

音声の感情制御や動画の構図指定など、思い通りの結果を出そうとしてプロンプトをこねくり回してしまう人は多い。

最初から完璧を目指すのではなく、まずはシンプルな指示で出力の傾向を掴むことから始めるのがおすすめだ。

* 長文や長尺動画を一気に生成しようとして失敗する

AIモデルは、入力が長くなるほど出力が不安定になりやすい。

とくに軽量な音声モデルでは、長文を読ませると後半で声のトーンが変わってしまうことがある。

短い文章や数秒の動画に分割して生成し、後で繋ぎ合わせるのが確実な方法だ。

* ローカル環境のスペック不足で動かない

オープンソースのモデルを自分のPCで動かそうとしたとき、メモリ不足でエラーになることがある。

スマホで動く軽量モデルであっても、環境構築には最低限の知識が必要だ。

まずはクラウドのAPIやデモ環境で動作を確認してから、ローカルへの導入を検討するといい。

よくある質問(FAQ)

Q1: ボイスクローニングを試したいが、どれくらい元の音声データが必要か?

最新のモデルであるFish Audio S2-Proの場合、わずか10秒から30秒程度のクリアな音声データがあれば十分だ。

ノイズの少ない参照データを用意するだけで、その人の声質や話し方の特徴を瞬時に学習して音声を生成できる。

従来のように何時間もの音声データを集めてモデルを再学習させる必要はない。

ただし、他人の声を無断で使用するなど、悪用を防ぐための倫理的な配慮は必須となる。

Q2: AIにテキストを読み上げさせると、感情がこもっていなくて不自然にならないか?

最新モデルでは表現力が劇的に改善されているから安心だ。

たとえばFish Audio S2-Proでは、テキストの中に「ささやき」や「笑い」といった自然言語のタグを直接書き込むだけでいい。

AIがリアルタイムに声の高さや強弱、リズムを調整してくれる。

プロンプトの工夫次第で、まるでプロのナレーターや声優が演技しているかのような自然な音声を生成できる。

Q3: AI音声生成で、入力したテキストの単語が飛ばされたり違う言葉になったりしないか?

従来のAI音声モデルでは単語のスキップや捏造が課題だったが、Hume AI TADAはこの問題を解決している。

テキストの単語と音声信号を1対1で厳密に同期させる仕組みを採用しており、テストでもハルシネーションはゼロだった。

原稿を一言一句間違えずに正確に読み上げる必要がある用途に最適だ。

ニュースの読み上げやビジネス向けのナレーション制作などに安心して使える。

Q4: Soraなどの高品質な動画生成AIは、無料で使い放題になるか?

高品質な動画生成AIが完全に無料で使い放題になる可能性は極めて低いと言える。

動画生成はテキストや音声の生成に比べて膨大な計算リソースを消費するため、サーバーコストが非常に高くなるからだ。

OpenAI SoraがChatGPTに統合された場合でも、無料ユーザーには厳しい利用回数制限が設けられるはずだ。

本格的に使うなら、有料プラン限定のプレミアム機能として割り切る必要がある。

Q5: オープンソースのAIモデルはスマートフォンでも動かせるか?

モデルのサイズや設計によっては、スマートフォンなどのモバイル端末でも十分に動作する。

Hume AI TADAは非常にコンパクトに設計されており、スマホのローカル環境でも実行可能だ。

インターネット接続がないオフライン環境や、プライバシーを重視するアプリでも高速な音声生成が実現できる。

ただし、長文を生成する際には音声のトーンが不安定になる課題もあるため、短い対話用途での利用がおすすめだ。

まとめ:まずは手軽なものから触ってみるのがおすすめだ

今回は、最新のAI音声・動画生成モデルについて徹底比較した。

感情表現のFish Audio S2-Pro、速度と正確性のHume AI TADA、手軽な動画生成のOpenAI Soraと、それぞれに明確な強みがある。

しんたろー:

新しい技術を追うのも楽しいが、結局のところ「自分の手を動かして何かを作る」のが一番の近道だ。

僕はClaude Codeで「ThreadPost」というサービスを作っているが、AIにコードを書かせる体験は本当に快適だ。

今回紹介した音声モデルも、いずれ自分のアプリに組み込んでみたいと企んでいる。

まずは無料で試せるオープンソースのモデルや、普段使っているチャットAIに統合される機能から触れてみるといい。

生成AIの進化のスピードと手軽さを、自分の手で体感するといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド