SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

冒頭フック

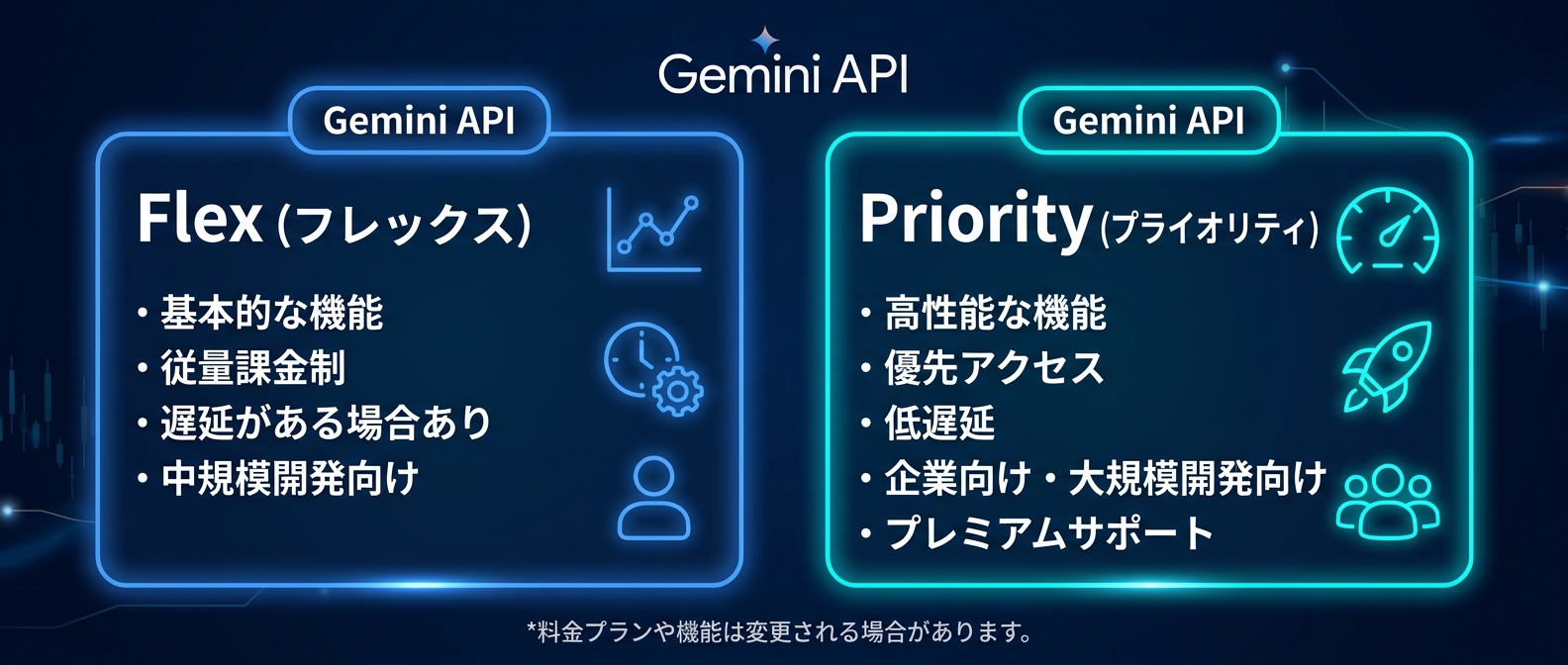

Gemini APIにFlexとPriorityという2つの新ティアが追加された。

同期エンドポイントを叩くだけで、コストとリソースの最適化が完結する。

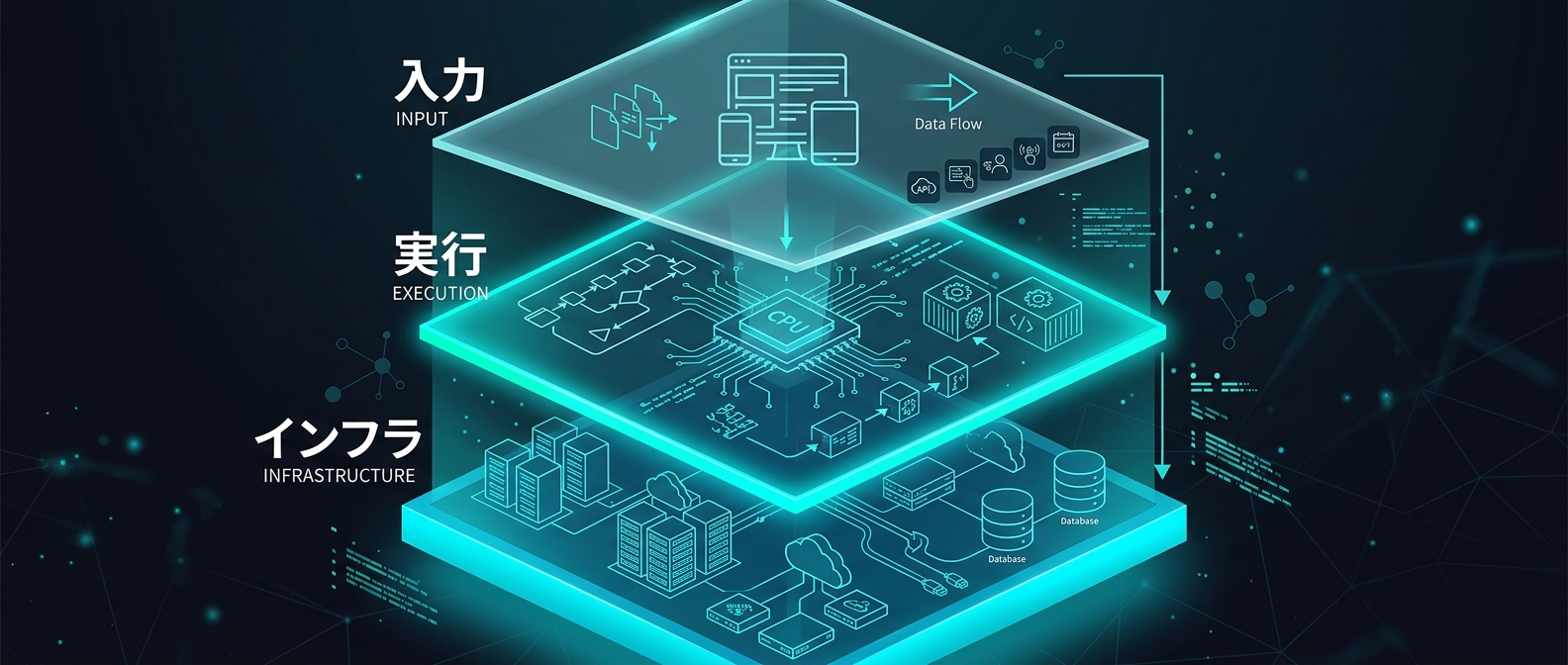

インフラ、プロンプト、実行の全レイヤーで構造化と分離が進行している。

システム設計への影響をまとめる。

ニュースの概要

Gemini APIにFlexとPriorityという2つの新しいサービスティアが追加された。

開発者はこれまで、同期APIと非同期バッチAPIの2つのロジックを管理してきた。

AIが単なるチャットボットから自律型エージェントへと進化している。

これに伴い、インフラの設計は複雑化の一途をたどっていた。

非同期用のジョブキューを構築し、ワーカーを管理する。

結果を取得するためのポーリング処理を実装する。

エラー時のリトライ戦略も、同期処理とは別に設計する。

データベースへの状態保存や、デッドレターキューの管理まで必要になる。

今回のアップデートで、標準の同期エンドポイントのままタスクの性質に応じてルーティングできるようになった。

複雑なジョブ管理システムを自作する手間が省ける。

Flexは、コスト最適化に特化した新しいティアだ。

レイテンシを許容できるバックグラウンド処理に使う。

バッチ処理特有のオーバーヘッドを気にせず、低コストで推論を回せる。

リクエスト時にservice_tierパラメータを一つ指定するだけで動く。

すべての有料ティアで利用可能であり、GenerateContentとInteractions APIで使える。

非同期処理のインフラを組むことなく、大量のデータを処理できる。

Priorityは、信頼性を保証するプレミアムティアだ。

プラットフォーム全体がピークを迎えても、処理リソースが奪われない。

ユーザー体験に直結する、落とせない重要な処理に使う。

Tier 2およびTier 3の有料プロジェクト向けに提供される。

コストはかかるが、それに見合うだけの安定性が手に入る。

サービスの品質を担保するための選択肢になる。

単一の統合されたインターフェースから、コストと信頼性をコントロールできる。

開発者はインフラの保守負担を減らし、エージェントの構築に集中できる。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発者目線の解説

インフラ、実行、入力の全レイヤーで構造化と分離が起きている。

FlexとPriorityの追加で、推論の即時性とコストが分離された。

裏側で重いタスクを回すFlexと、ユーザーと対話するPriorityだ。

これらを単一のインターフェースから制御できる。

インフラの物理的な分割ではなく、論理的なルーティングによる分離だ。

これにより、システムの複雑性を下げることができる。

実行層では、Function Callingが機能する。

LLMは「何を実行すべきか」を判断し、構造化されたデータを出力する。

それを受け取った外部のアプリケーションが、実際のAPIやツールを実行する。

意思決定と実行が分離されている。

LLMは本来、テキストを生成するだけのモデルだ。

それ自体が現実の業務を実行しているわけではない。

LLMに利用可能なツールの情報を渡す。

名前は在庫取得、引数には商品IDが必要だというルールを教える。

LLMはプロンプトと状況を読み解き、どのツールを使うべきか推論する。

ルールに従って正しい形式のデータを出力する。

商品IDを指定した構造化データだ。

アプリケーション側がそれを受け取り、データベースにアクセスする。

結果を再びLLMに返し、次の判断を仰ぐ。

このプロセスが連続的に進むことで、自律的な処理が実現する。

LLMは関数呼び出しの形式で出力しているだけだ。

実際の実行は、外部のシステムが担っている。

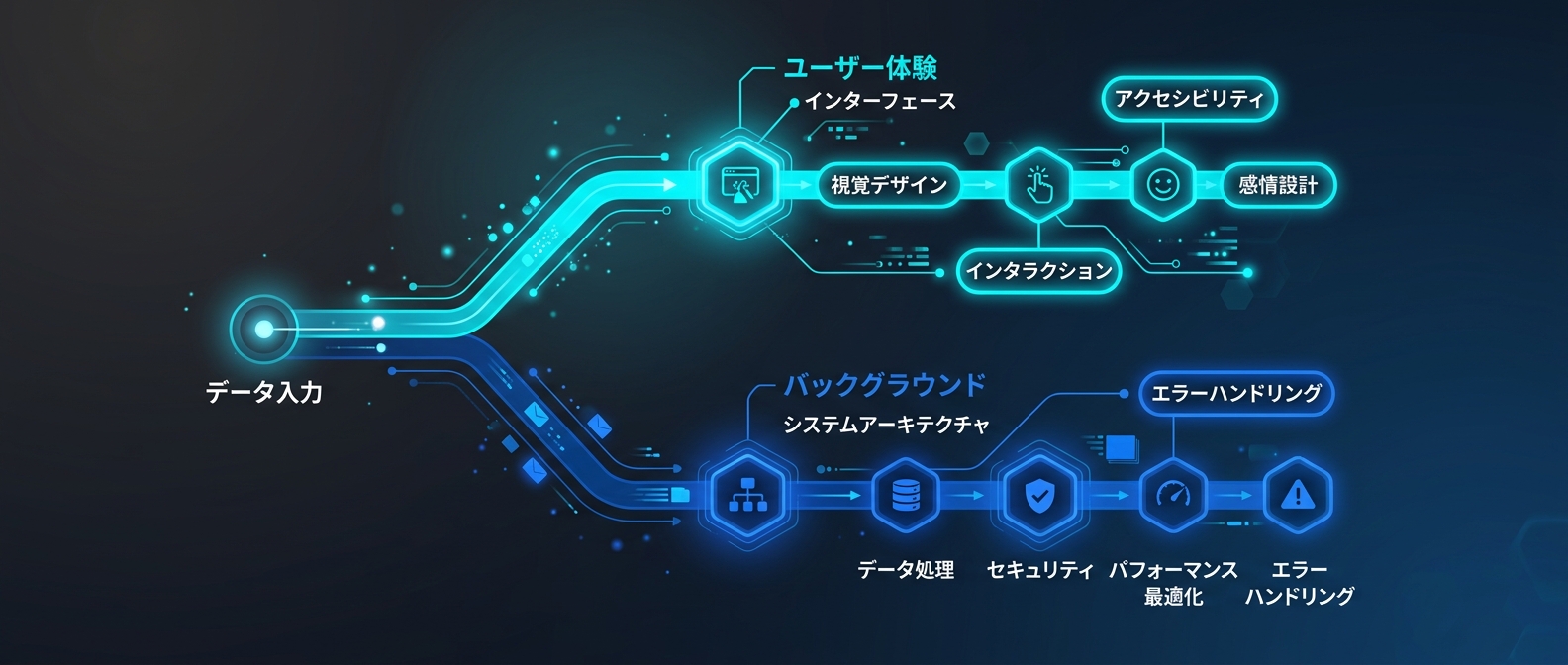

入力層のプロンプト設計でも分離が進む。

商用生成AIはベースモデル、alignment、policy、router、monitorなどの多層システムだ。

プロンプトは外側から意味の通路を狭め、拘束条件を与える。

背景、役割、制約条件、出力形式を分離して記述する。

外側から意味の通路を狭め、LLMの解釈の自由度を奪う。

意味の優先順位を外部から固定し、推論のブレを防ぐ。

会話が長引いても、意味のドリフトが起きない。

しんたろー:

Claude Codeでコードを書いていると、エージェントが脱線する場面に遭遇する。

ツール実行と推論のレイヤーを分けるアーキテクチャが最近のトレンドになっているようだ。

自然文の長大なプロンプトは、情報量が多いだけで意味が安定しない。

背景説明、制約、例外、願望が同じ文脈に混ざる。

モデル側から見た「どこが核なのか」がぼやけてしまう。

解釈に余地が大きいほど、出力の揺れも増える。

長いプロンプトが不安定になりやすいのは、意味の焦点が拡散しやすいからだ。

入力の構造化は、意味を整形する作業だ。

何を変えてよく、何を変えてはいけないかを外から見える形にする。

インフラ、実行、入力の3つの層が、役割を分離する方向に向かっている。

システム全体を「推論・実行・リソース」の各層で設計する。

各レイヤーで責任を分割し、統合的に制御する。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響

タスクの性質によるルーティングの分離が進む。

リアルタイムなチャット応答やUI操作の裏側の推論はPriorityに流す。

ピーク時のリソースを確保し、確実な実行を担保する。

ユーザーを待たせることは、サービスの離脱につながる。

プレミアムな価格を払ってでも、確実な実行を担保する。

一方、ユーザーを待たせない処理はFlexに逃がす。

ログの分析や大量のデータ分類、バックグラウンドでのコンテンツ生成だ。

これまでは非同期バッチのキューを組むのが手間で、同期APIで処理していたタスクだ。

パラメータを一つ変えるだけで、コストを抑えられる。

夜間に全ユーザーのデータを要約するような処理も回せるようになる。

インフラの制約で諦めていた機能が、現実味を帯びてくる。

Function Callingを安定させるため、入力の構造化も進む。

制約条件と背景説明を分離し、出力形式を定義する。

意味を壊さず、再利用可能な形にプロンプトを整える。

これが、自律型エージェントを暴走させないための防波堤になる。

その場しのぎの自然文プロンプトは、別のタスクに持ち運びにくい。

少し条件が変わるだけで全文を書き直すことになる。

開発チームでの共有も難しく、属人化の温床になる。

構造化されたプロンプトは、意味の再射影が可能だ。

同じ骨格を保ったまま、異なる入力や異なるモデルに投げられる。

それだけ意味の核が安定しているということだ。

しんたろー:

非同期バッチのキュー管理やエラー時のリトライ処理は複雑になりがちだ。

同期エンドポイントのままバックグラウンド処理に流せる仕様は便利そうだ。

エージェント開発では、会話が自然に広がる。

実務ではこれがしばしば意味ドリフトの原因になる。

要件が少しずつ言い換わり、例外が本文に混ざる。

補足が新たな主制約のように扱われてしまう。

こうしたズレは、会話型インターフェースでは避けられない。

システムが複雑になるほど、このドリフトはバグを引き起こす。

構造化されたプロンプトは、こうしたドリフトに対して固定点として働く。

会話が広がっても「戻るべき骨格」が残る。

これはモデル内部の安定化ではない。

外側に置いた参照面の安定化だ。

人間がコントロールできる領域を明確にし、そこにルールを敷く。

AIのブラックボックス性に立ち向かうためのアプローチだ。

システムの信頼性を保ちながら、運用コストを削る。

推論の精度を保ちながら、複雑なツールを実行させる。

これらを同時に達成するためのパーツが出揃った。

単一のインターフェースで、エージェントの挙動を統制する。

アーキテクチャの設計がプロダクトの競争力に直結する。

FAQ

Q1: Gemini APIのFlexティアと従来のBatch APIの違いは何ですか?

従来のバッチAPIは非同期処理であり、ジョブの管理や結果のポーリングが必要だ。

Flexティアは、標準の同期エンドポイントのまま使える。

パラメータを変更するだけで、バックグラウンド処理を実行できる。

非同期ジョブ管理のオーバーヘッドが消滅する。

Q2: AIエージェントにおけるプロンプトの構造化とは何ですか?

背景、役割、制約条件、出力形式を分離して記述する手法だ。

LLMにとっての「意味の優先順位」を外側から固定する。

これにより、Function Callingでツールを選択する際の推論のブレを防ぐ。

複雑なタスクでも、意図した通りに外部システムへ命令を渡せるようになる。

Q3: FlexとPriorityの使い分けの基準は何ですか?

リアルタイムなチャット応答や即時性が求められる推論にはPriorityを使う。

ピーク時でもリソースが保証される。

一方、データ要約やログ分析など、バックグラウンドで回せるタスクにはFlexを割り当てる。

システム全体の信頼性を担保しつつ、インフラコストを抑えられる。

しんたろー:

スケールした時のインフラコストは課題になりやすい。

初期段階からタスクの性質でルーティングを分ける設計が気になっている。

まとめ

インフラ、実行、入力の全レイヤーで分離が進んでいる。

AI開発はアーキテクチャ設計の比重が大きくなっている。

AIエージェントのアーキテクチャ設計や、コストを最適化する最新APIの活用法について、ThreadPostで知見を共有・議論しませんか?

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤