Googleが動いた。

音楽生成モデル「Lyria 3」のAPIが公開された。

ただの音楽生成ツールではない。

開発者が自社アプリに組み込めるインフラとしての解放だ。

注目は「SynthID」による電子透かしの強制適用。

著作権リスクを抱えずに音楽AIを実装できる設計になっている。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

音楽AIがAPIとして解放された日

何が起きたか整理する。

Googleの音楽生成モデル「Lyria 3」と「Lyria 3 Pro」が公開された。

パブリックプレビューとして開発者向けに提供が開始されている。

アクセス経路はGemini APIだ。

Google AI Studioには新しいオーディオエクスペリエンスが追加された。

有料APIキーを使えば、画像から音楽を生成する機能も使える。

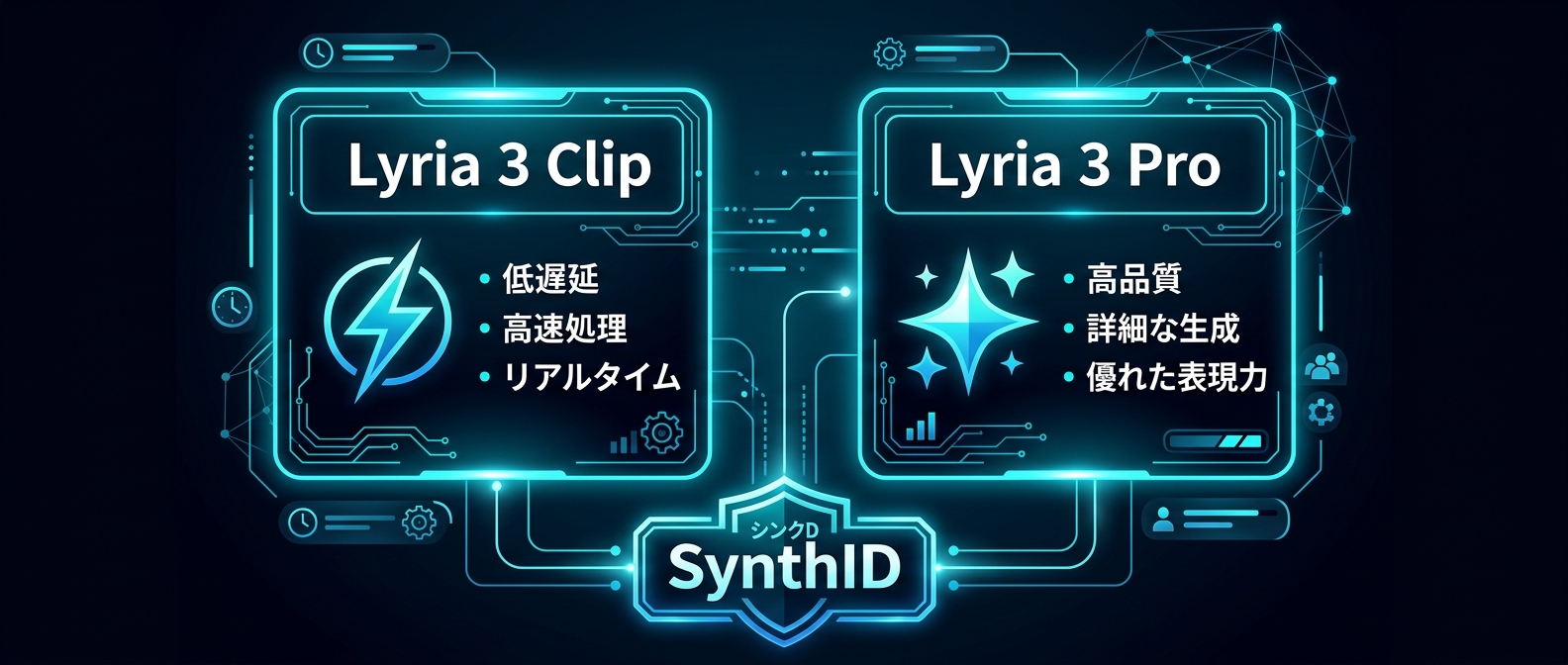

用意されたモデルは2種類だ。

「Lyria 3 Clip」と「Lyria 3 Pro」の2つが提供されている。

レイテンシと品質の要件に合わせて選択できる。

ポップスからファンク、モータウンまで幅広いジャンルに対応している。

ボーカルの表現力も高く、多言語での生成が可能だ。

自然なサウンドを実現するためのクリアさが向上している。

自然言語によるプロンプトで細かな制御ができる。

音楽的な一貫性を保ったまま楽曲を生成する。

バースやコーラスを含む高品質な構成が可能だ。

最初の音から最後の音まで、破綻のない音楽を作り出す。

これまでのAI音楽にありがちだった「途中で曲調がおかしくなる」問題に対処している。

プロンプトの指示に忠実に、複雑な楽曲構成を組み立てる。

そして最も目を引く仕様がある。

生成されたすべてのオーディオトラックには「SynthID」が埋め込まれる。

Googleが開発したデジタル電子透かし技術だ。

人間の耳には全く聞こえない。

だが、後から加工されてもGoogle AIが生成したものだと確実に検証できる。

透明性と信頼性を担保するための強制的な仕組みだ。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発者インフラとしての「Lyria 3」

ここからが本題だ。

これまで音楽生成AIは、独立したサービスとして使われることが多かった。

SunoやUdioなどのプラットフォームにユーザーが直接アクセスする。

そこでプロンプトを打ち込んで曲を作るのが一般的だった。

それが今回、Gemini API経由で直接システムに統合可能になった。

音楽AIが単なるツールから、開発のためのインフラへと変わった。

しんたろー:

音楽生成のAPI化、ずっと待ってた。

Claude Codeでバックエンド書いてるときに「ここにBGM自動生成挟めたらな」って何度思ったことか。

自分でモデルホスティングする手間が省けるのは素直に助かる。

なぜこれが注目されるのか。

自社アプリに音楽生成機能を組み込む際の最大の壁が存在していた。

「著作権」と「フェイクリスク」だ。

ユーザーが生成した音楽が既存の有名な楽曲に酷似していたらどうなるか。

プラットフォーム運営者が著作権侵害の責任を問われるリスクがある。

訴訟のリスクを恐れて、手を出せなかった開発者は多い。

Googleはそこに明確な回答を出した。

「SynthID」の標準搭載だ。

すべての生成物に耳に聞こえない透かしが入る。

これによって、生成された音声の出所を常に証明できる。

万が一トラブルになった際も「これはAIが生成したものであり、当社のシステムを経由している」と証明できる。

コンプライアンスの観点から見て、企業が採用しやすい設計になっている。

さらに、モデルが2種類用意されている点も開発者フレンドリーだ。

APIを叩く際、常に最高品質が必要なわけではない。

リアルタイム性が求められる場面ではレイテンシが命になる。

「Lyria 3 Clip」はレスポンス速度を優先したい場合に適している。

一方で、最終的な楽曲の完成度を求めるなら「Lyria 3 Pro」を選ぶ。

用途に応じたトレードオフの選択肢が用意されている。

自然言語でのきめ細かい制御も大きな武器になる。

「BPM120で、徐々に盛り上がるエレクトロニックなイントロ」といった指示が可能だ。

画像から音楽を生成する機能も面白い。

ユーザーがアップロードした写真の雰囲気に合わせてBGMを自動生成する。

そんな高度な機能が、APIを叩くだけで実装できるようになった。

複雑なプロンプトエンジニアリングをシステム側に隠蔽できる。

しんたろー:

画像から音楽生成、ThreadPostの投稿機能と相性良さそうだと思った。

ユーザーの投稿画像からBGM作って動画化する機能とか、API叩くだけで組めるなら面白そうだなと。

ただ、APIの料金体系とレイテンシのバランスは実測してみないと怖いな。

インフラとしての安定性も期待できる。

Googleの強固なインフラ上で動くGemini APIを利用する。

トラフィックの急増によるスケーリングの心配をGoogleに丸投げできる。

1人SaaS開発者にとって、インフラ管理の手間が減るのはありがたい。

Claude CodeでサクッとAPIクライアントを書いて、すぐに検証を始められる。

複雑なオーディオ処理のバックエンドを自前で構築する必要はない。

マルチモーダル開発のパラダイムシフト

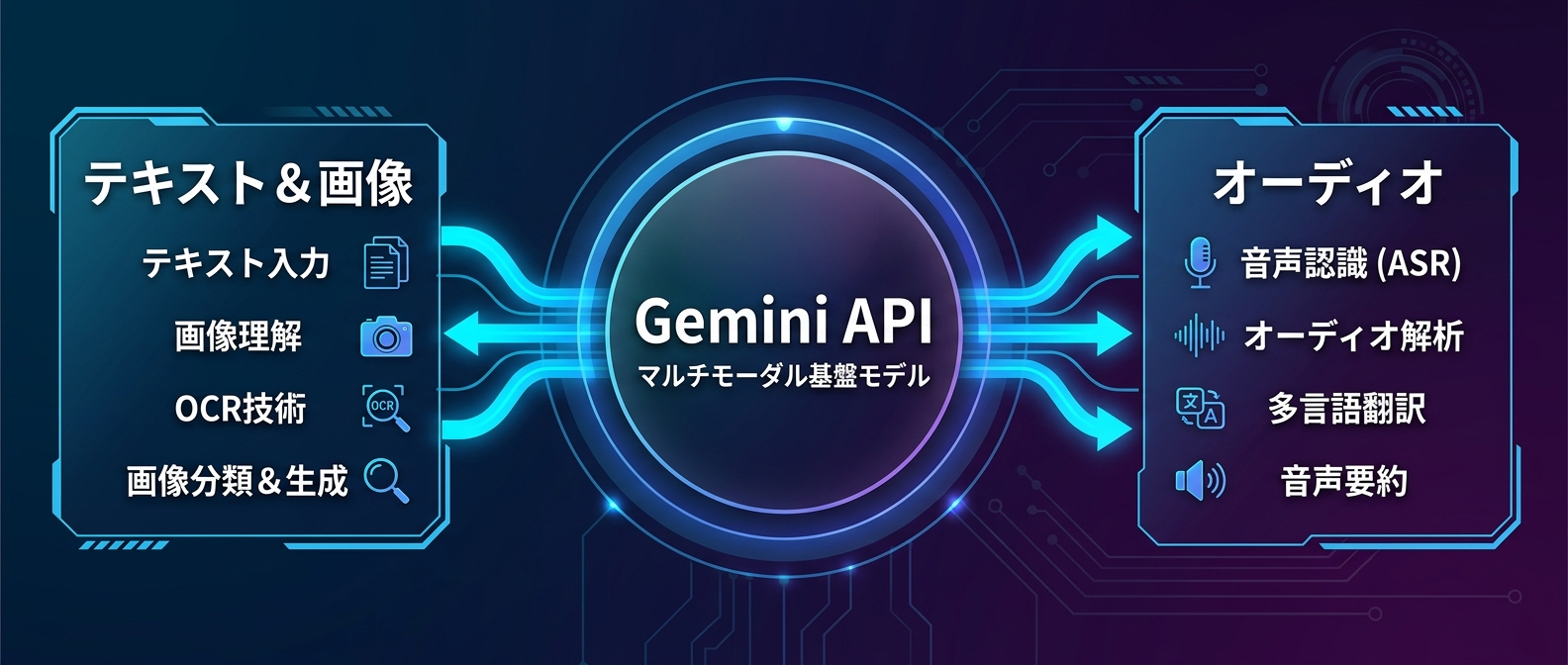

マルチモーダルなAI開発の視点からも興味深い。

Gemini APIはすでにテキストと画像の処理に強い。

そこに高品質なオーディオ生成が加わった。

入力から出力まで、すべてを一つのAPIエコシステムで完結できる。

テキストでプロンプトを作り、画像でコンテキストを与え、音楽を出力する。

複雑なパイプラインが、シンプルなアーキテクチャで構築できる。

これまでの開発では、複数のベンダーのAPIを組み合わせる必要があった。

テキストはOpenAI、画像はMidjourney、音楽は別の特化型AI。

それぞれのアカウントを管理し、異なるAPI仕様に対応する。

エラーハンドリングも複雑になる。

それがGemini APIに統合されることで、開発のオーバーヘッドが下がる。

一つのSDK、一つの認証情報でマルチモーダルなアプリが作れる。

音声データの取り扱いについても考える必要がある。

生成された音楽データは、バイナリとして返ってくる。

これをどうやってフロントエンドに配信するか。

直接ストリーミングするのか、一度S3などのオブジェクトストレージに保存するのか。

CDNを経由してキャッシュを効かせる設計が必要になる。

ファイルサイズが大きくなるため、帯域幅のコスト計算も忘れてはいけない。

APIの利用料金だけでなく、インフラ全体のコストを見積もる必要がある。

これはオーディオ生成アプリ特有の課題だ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務にどう組み込むか。ユースケースと設計

で、僕らの開発にどう影響するのか。

具体的なユースケースの選択肢が広がる。

まずはゲーム開発の領域だ。

プレイヤーの状況や感情に合わせて、動的にBGMを生成するシステムが作れる。

ボス戦に突入した瞬間に、そのプレイヤーのプレイスタイルに応じたテンポの曲を生成する。

そんなインタラクティブな体験が、APIの呼び出し一つで実現する。

動画編集アプリやUGCプラットフォームへの影響も計り知れない。

クリエイターが動画の尺に合わせて、著作権フリーのBGMを瞬時に生成できる。

「このシーンの長さに合わせて、悲しいピアノの曲を作って」と指示するだけだ。

プラットフォーム側は、SynthIDのおかげで著作権侵害のリスクを大幅に減らせる。

安全にクリエイター支援ツールを提供できる。

ユーザーのエンゲージメントを高める武器になる。

実装時の注意点もある。

レイテンシと品質のトレードオフの設計だ。

ユーザーを待たせてでも高品質な「Lyria 3 Pro」を使うか。

それとも即座に反応を返すために「Lyria 3 Clip」を選ぶか。

アプリの性質に合わせて、適切なモデルを選択する設計が求められる。

プロダクトのUXに直結する判断になる。

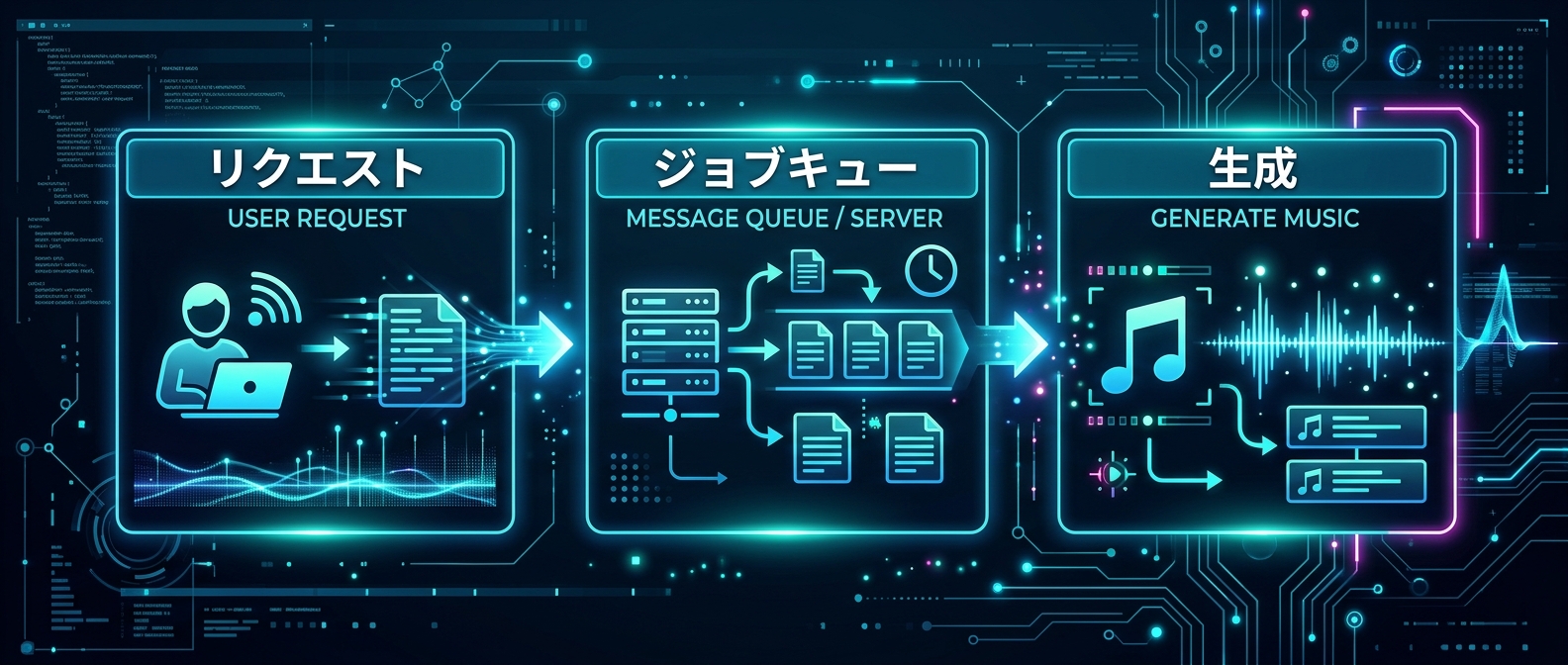

非同期処理とUXのトレードオフ

バックエンドの実装パターンにも変化が起きる。

音楽生成は重い処理だ。

同期的なAPIリクエストでユーザーを待たせるのは現実的ではない。

非同期処理のアーキテクチャが必須になる。

リクエストを受け取ったら、ジョブキューにタスクを積む。

バックグラウンドのワーカーがGemini APIを叩く。

生成が完了したら、WebSocketやServer-Sent Eventsでフロントエンドに通知する。

こういった堅牢なシステム設計が求められる。

しんたろー:

音楽生成はテキスト生成よりどうしても時間がかかる。

ユーザーを待たせる間のUI/UXをどう設計するかが、開発者の腕の見せ所になりそうだと思った。

プログレスバーだけじゃなくて、生成過程を視覚的に楽しませる工夫が気になるところ。

フロントエンドでの再生実装も工夫が必要だ。

生成された音楽をただのオーディオタグで再生するだけでは面白くない。

Web Audio APIを使って、視覚的なビジュアライザーを実装する。

生成された楽曲の波形に合わせて、UIを動的に変化させる。

ユーザーが音楽の生成を「体験」できるようなインターフェースを作る。

AIの出力をどう見せるか、そこに開発者のセンスが問われる。

まずはGoogle AI Studioで検証を始めるのがいい。

有料のAPIキーが必要になるが、専用のワークスペースで高度な機能を試せる。

プロンプトの調整や、自然言語での制御の精度を確認する。

画像から音楽を生成する機能も、ここで確認できる。

APIのレスポンスタイムや、生成される音楽の品質を実測する。

実際のデータに基づいてアーキテクチャを設計する。

パブリックプレビューの段階であることも忘れてはいけない。

仕様の変更や、APIの制限がかかる可能性がある。

本番環境にフルコミットする前に、フォールバックの仕組みを用意しておく。

エラー時のハンドリングや、タイムアウト時の代替処理をしっかり組み込む。

Claude Codeを使って、堅牢なエラーハンドリングのロジックを生成しておくと安心だ。

新しい技術を導入する際は、常に最悪のケースを想定した防御的なプログラミングが求められる。

Lyria 3 導入に関するFAQ

Q1: Lyria 3を開発に組み込むための前提条件は何ですか?

A1: Gemini API経由、またはGoogle AI Studioの新しいオーディオエクスペリエンスからアクセス可能です。

AI Studio内の専用ワークスペースで画像から音楽を生成するなどの高度な機能を使うには、有料のAPIキーが必要となります。

現在はパブリックプレビュー段階です。

まずはAI Studioのプレイグラウンド環境で、プロンプトの反応や生成品質の確認から始めるのが確実です。

Q2: 用意されている2つのモデル(Clip / Pro)はどう使い分ければよいですか?

A2: プロダクションの要件と許容できるレイテンシに応じて選択します。

リアルタイム性や即座の応答が求められるインタラクティブなアプリには、軽量な「Lyria 3 Clip」が適しています。

一方で、バースやコーラスの完全な一貫性、ボーカルの細かなニュアンスなど、最終的な楽曲の品質を最優先する場合は「Lyria 3 Pro」を選択します。

用途に応じたトレードオフの設計が求められます。

Q3: 生成した音楽がAIによるものだと証明する仕組みはありますか?

A3: はい、あります。

Lyria 3で生成されたすべてのオーディオトラックには、Googleの「SynthID」というデジタル電子透かしが自動的に埋め込まれます。

この透かしは人間の耳には聞こえません。

しかし、後から音声が加工や編集された場合でも、Google AIによって生成されたものであることを確実に識別・検証できます。

これにより、アプリ提供側のコンプライアンス向上に直結します。

音楽生成APIが切り拓く次の開発

音楽AIがAPIとして解放され、著作権リスクを抑えながらアプリに組み込めるようになった。

最新の音楽生成APIを活用した新しいアプリのアイデアや実装の悩みを、ThreadPostで開発者仲間と共有してみませんか?

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤