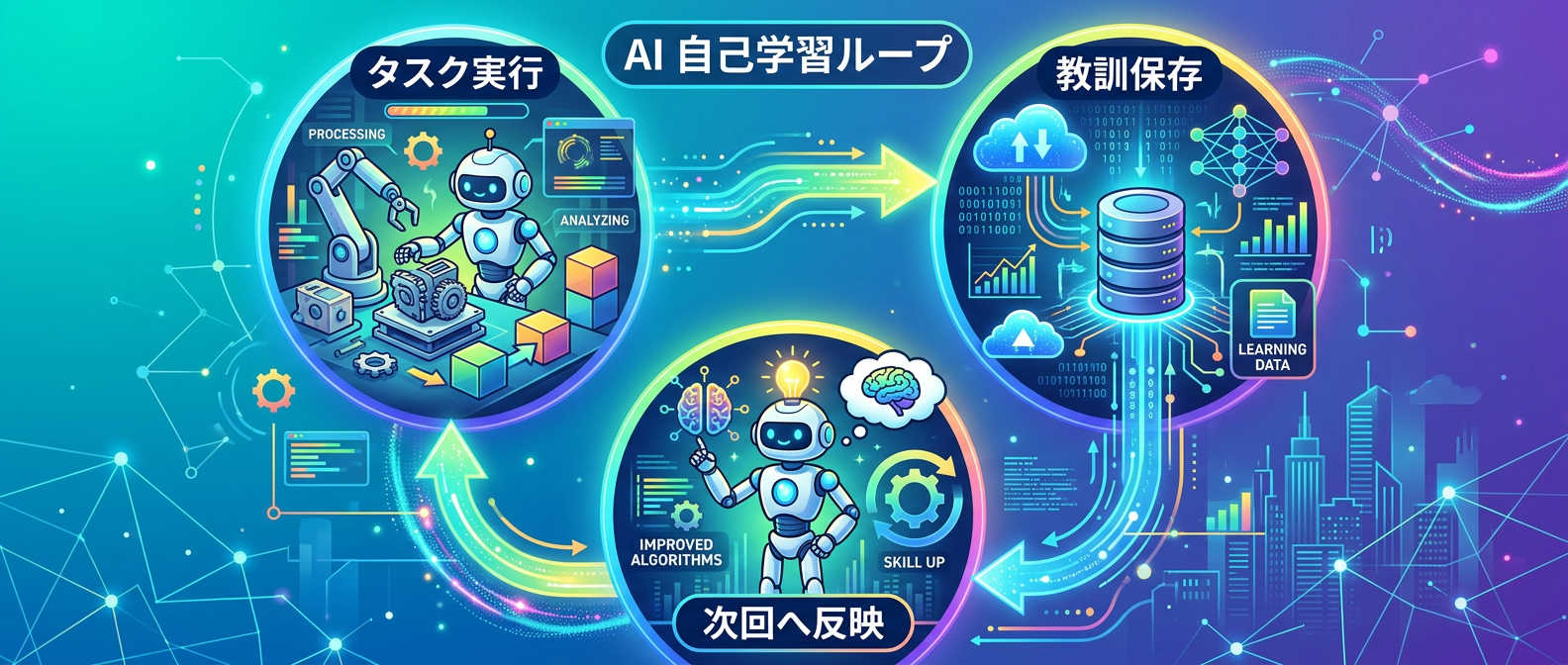

AIエージェントを作っても、毎回同じ間違いをしてイライラすることはないだろうか。

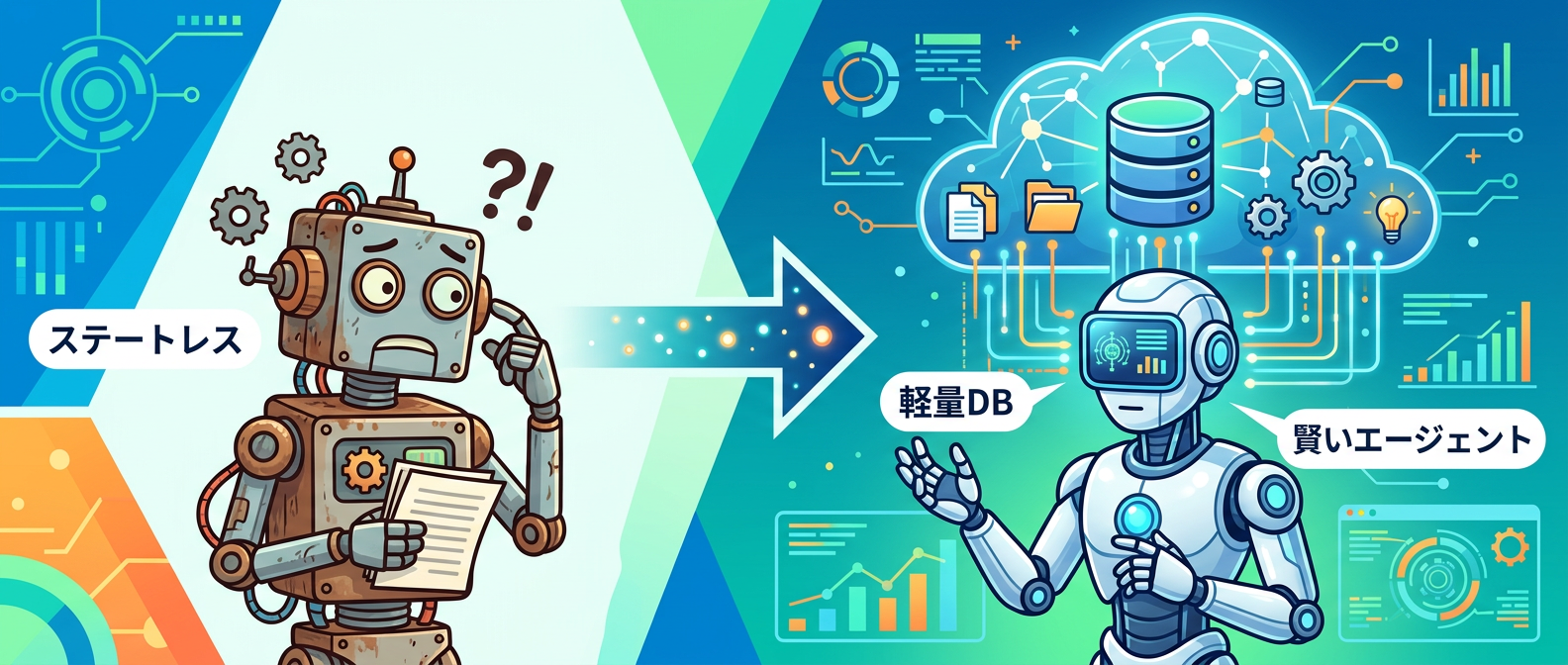

LLMは基本的に記憶を持たないからだ。

でも、自己学習ループを組み込めば、自律的に成長する賢いエージェントが作れる。

1人SaaS開発で毎日Claude Codeを叩いている僕が、エージェントを自律化・自己学習させるための実践的な実装手法を13個に分けて解説する。

結論から言うと、まずは軽量なデータベースで過去の教訓を保存するところから始めるのがおすすめだ。

初心者でも心配無用だ。一つずつ順番に実装していけば、必ず動くようになる。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

1. エージェントの動的生成と構造化

1. Pydanticを用いた構成のスキーマ定義

エージェントの構成要素を構造化する手法だ。

ツールやメモリ、プランナーなどの仕様を「Pydantic」を使って定義する。

これにより、タスクに応じたエージェントの仕様を、LLMが安全かつ一貫性のあるJSON形式で出力できるようになる。

構成要素として定義すべき項目は以下の通りだ。

- 使用するツールの定義

- メモリアーキテクチャの選択

- プランナーの動作設定

単なるテキストの指示ではなく、厳密な型定義を持たせることで、動的なインスタンス化の基盤が整う。

たとえば、出力フォーマットが崩れてシステムが停止するような事態を防げる。

エラーを未然に防ぐためにも必須のアプローチと言える。

さらに、型チェックが自動で行われるため、開発時のデバッグも容易になる。

エージェントの挙動を予測可能にするための第一歩だ。

2. タスク記述からの動的エージェント生成

静的なプロンプトテンプレートに依存せず、入力されたタスク記述から最適なエージェントを自律的に生成する仕組みだ。

上位のエージェントがタスクを分析し、必要なツールやメモリアーキテクチャを自ら選択する。

これにより、未知のタスクにも柔軟に対応できる自己構成型のシステムが実現する。

たとえば、データ分析の指示が来たら分析用ツールを、文章作成の指示が来たら検索ツールを自動で組み込むような動きが可能になる。

毎回手作業でエージェントを調整する手間が省けるはずだ。

タスクの複雑さに応じて、エージェントの能力を動的にスケールさせることも可能になる。

3. 自己評価と反復的自己改善ループの実装

生成したエージェントのパフォーマンスを、システム自身が評価するループを作る。

実行結果のフィードバックを基に、必要に応じて構成やプロンプトを修正する仕組みだ。

この反復ループを実装することで、継続的な精度向上が可能な自律型アーキテクチャを構築できる。

たとえば、出力したコードにバグがあった場合、その原因を自己分析して次のプロンプトに改善策を盛り込める。

失敗から学び、自らをリファインする機能は、高度なエージェントには欠かせない。

人間が介入しなくても、エージェント自身が自律的に成長していく基盤となる。

2. 記憶の永続化と自己学習ループ

4. SQLiteを用いた教訓の永続化

LLMの最大の弱点は、ステートレスで過去の実行結果を忘れてしまうことだ。

これを克服するために、実行ログから得られた教訓を「SQLite」などの軽量データベースに保存する。

保存すべき主なデータは以下の3つだ。

- 実行したタスクの内容

- 成功または失敗の結果

- 次回に向けた具体的な教訓

外部サービスに依存せず、次回の実行時に過去の記憶をプロンプトとして注入するだけでいい。

たとえば、「このAPIはレートリミットが厳しい」という教訓を保存しておけば、次回から自動で待機時間を設けるようになる。

これで、同じ間違いを繰り返さない継続的な学習が可能になる。

複雑なベクトルデータベースを導入する前に、まずはこのシンプルな手法を試すといい。

5. 教訓の信頼度スコアリング

学習した教訓に対して、0.0から1.0までの信頼度スコアを設定するアプローチだ。

同じ教訓が確認されるたびにスコアを加算していく。

これにより、一時的なノイズと本質的な課題を区別できる。

たとえば、1回だけの偶然のエラーはスコアが低いままだが、毎回発生するエラーはスコアが高くなる。

信頼度の高い重要な教訓だけを優先的にエージェントへ提示すれば、ハルシネーションによる誤学習を防げる。

スコアの閾値を設定することで、プロンプトに含める教訓の量を適切にコントロールできる。

6. 教訓の有効期限設定による陳腐化防止

教訓の種類に応じて有効期限を設定する仕組みだ。

たとえば、解決済みの短期的な課題は期限切れで自動削除されるようにする。

一方で、未解決の重要な課題は何度も検出されて残り続ける。

この設計により、エージェントの記憶領域が不要な古い情報で溢れかえるのを防げる。

記憶のメンテナンスを自動化する賢い方法だと言える。

環境の変化に合わせて、古い教訓を適切に忘れることも、エージェントの適応力を高める上で重要だ。

7. CLIパイプモードを活用した軽量学習ループ

複雑なフレームワークを使わず、標準出力とデータベースの読み書きだけで完結させる手法だ。

シェルスクリプトとスケジューラを組み合わせ、CLIのパイプモードを利用して学習ループを回す。

保守性が高く、高速なエージェント運用が可能になる。

大掛かりなインフラを用意しなくても、手元の環境で手軽に始められるのがメリットだ。

開発環境でのテストや、小規模なタスクの自動化に非常に適している。

しんたろー:

Claude Codeで毎日コードを書いて1人SaaS開発している身からすると、このCLIベースの軽量ループは本当に理にかなっている。

複雑なオーケストレーションツールを導入すると保守だけで消耗してしまうが、標準入出力と軽量DBの組み合わせなら、エラーが起きてもすぐに原因を特定できるからだ。

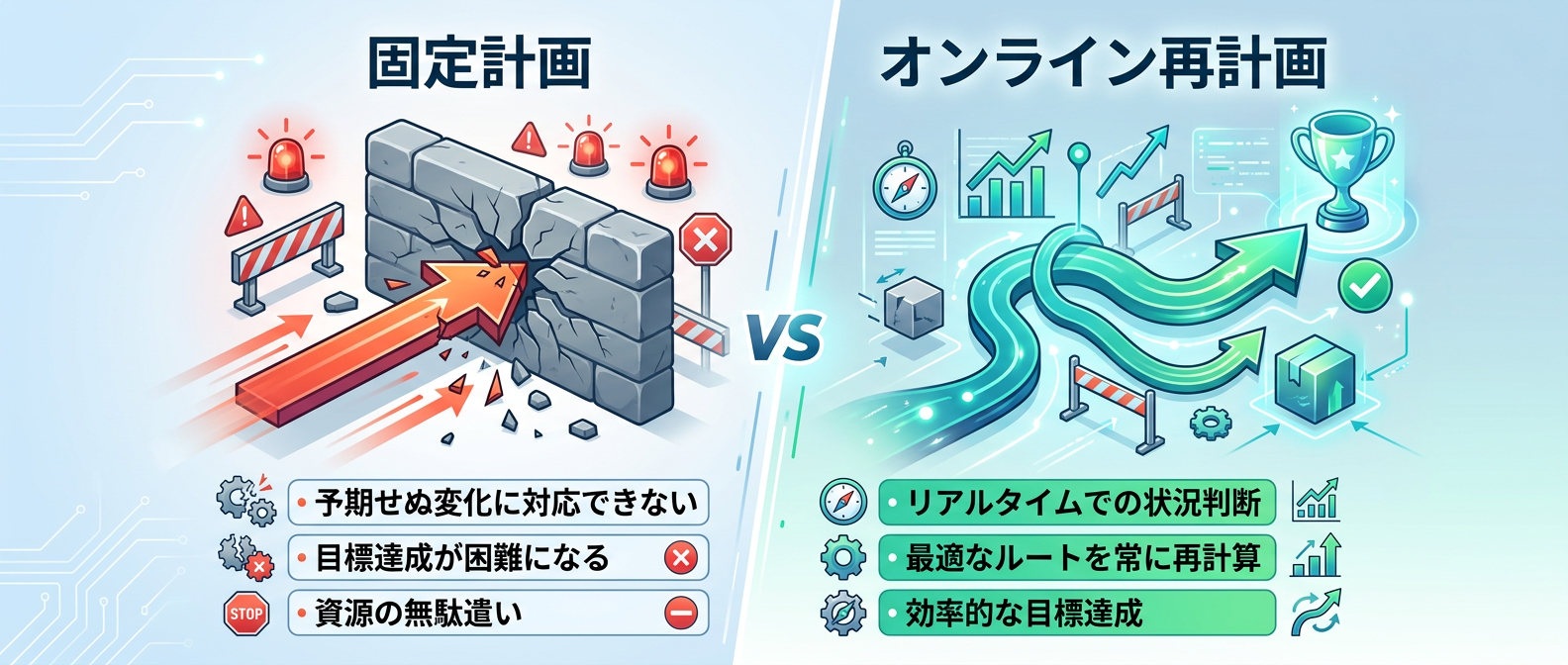

3. 動的環境への適応とオンライン再計画

8. 動的環境に対応するオンライン再計画

状況が刻々と変わる環境では、最初から最後まで固定の計画を立てるのは危険だ。

そこで、数ステップ先までに限定して計画を立てるアプローチをとる。

頻繁に状況を再評価し、計画を細かく更新していく。

オンライン再計画のメリットは以下の通りだ。

- 予期せぬエラーへの即時対応

- 環境変化に伴う目標の再設定

- 無駄な処理の削減

たとえば、Webスクレイピング中にサイトの構造が突然変わった場合でも、すぐに対応策を練り直せる。

これにより、変化の激しい環境でもエージェントの適応力が劇的に向上する。

長期的な目標を見失わずに、短期的な行動を柔軟に調整するバランスが鍵となる。

9. 実行途中の適応による安全性確保

計画通りに実行している最中でも、局所的なリスクを検知したら即座に計画を破棄する仕組みだ。

古い軌道に固執せず、リアルタイムに反応して中間決定を下す。

たとえば、ファイルの削除処理を実行する直前に権限エラーを予測した場合、処理を止めて管理者に通知するような動きだ。

これにより、予期せぬエラーや無効な状態を回避できる。

エージェントの安全性を担保するためには、この柔軟な適応力が必須となる。

システム全体に致命的な影響を与える前に、安全に停止するフェイルセーフの役割も果たす。

10. 推論プロセスのストリーミング構造化

エージェントの思考プロセスや行動ログを、構造化されたイベントとしてストリーミング出力する手法だ。

部分的な推論の途中経過をリアルタイムで監視しやすくなる。

ブラックボックスになりがちなAIの動きを可視化できるため、デバッグ作業が圧倒的に楽になる。

システムの透明性を確保する上でも非常に有効だ。

ユーザーに対して、エージェントが現在何を考えているのかを提示するUIの構築にも役立つ。

4. リソース制約下の自律実験と最適化

11. 自律的なハイパーパラメータ探索

LLMに学習コードを渡し、自律的にコードを変更して実験を繰り返させる仕組みだ。

指標を自動評価し、改善した変更を保持し、悪化したものを破棄するループで最適化を進める。

たとえば、AI自身に最適な学習率やバッチサイズを探らせるといった使い方ができる。

人間が手作業でパラメータを調整する代わりに、エージェント自身に最適な設定を見つけさせる。

これは非常に強力なアプローチと言える。

機械学習モデルのチューニングだけでなく、プロンプトの最適化にも応用できる。

12. 時間予算制約下での小さく速く回す実験設計

限られた時間やリソースの中で自律実験を行う場合、モデルを大きくするよりも小さく速く回す設計が有効だ。

バッチサイズやモデルサイズを縮小して1ステップの計算を軽くする。

同じ時間内でより多くの最適化ステップを踏ませることで、最終的なパフォーマンスが大きく向上する。

リソースが限られている個人開発者にもおすすめの戦略だ。

素早いフィードバックループを構築することが、結果的に最も効率的な最適化につながる。

13. ハードウェア環境に合わせた動的最適化

実行環境のGPUやメモリ容量に合わせて、エージェントにパラメータを動的に調整させる手法だ。

メモリ不足によるクラッシュを回避しつつ、そのプラットフォームにおける最適な設定をエージェント自身に探らせる。

たとえば、手元のPCとクラウドサーバーで別々の最適化を自動で行わせられる。

環境依存のエラーを減らし、安定した自動化ループを構築するためには欠かせない視点だ。

異なる環境間でのエージェントの移植性も高まる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

5. エージェント記憶・学習アプローチ比較表

| アプローチ | 導入難易度 | 外部依存 | メリット | デメリット |

| --- | --- | --- | --- | --- |

| プロンプト手動調整 | 低 | なし | すぐに試せる | スケールしない |

| 軽量DBでの教訓保存 | 中 | なし | 構築が簡単で保守しやすい | 複雑な文脈検索は苦手 |

| ベクトルDB連携 | 高 | あり | 大量の記憶から意味検索できる | インフラ管理の手間が増える |

| 自律的コード最適化 | 高 | なし | 人間の限界を超える調整が可能 | 計算リソースを大量に消費する |

6. しんたろーのイチ推しTips

結論から言うと、一番効果を実感しやすいのは「軽量DBを用いた教訓の永続化」だ。

ステートレスなLLMに擬似的な記憶を持たせるだけで、エージェントの振る舞いは見違えるほど賢くなる。

しんたろー:

自分が開発しているThreadPostでも、AIにSNS投稿を自動生成させる際、過去のエンゲージメント結果を教訓として保存する仕組みを取り入れたいと強く感じている。

Claude Codeを使って実装を進める際も、まずは軽量なデータベースを利用したシンプルな構成から始めるのが一番挫折しにくいアプローチだ。

7. よくある質問

Q1: AIエージェントに自己学習機能を持たせるには何から始めればいい?

まずは、エージェントの実行結果を振り返り、得られた教訓や改善点をテキストとして保存するシンプルな仕組みから始めるのがおすすめだ。軽量なデータベースを用意し、タスク完了ごとに自己評価の結果を記録する。次回のタスク実行時に、保存した教訓を読み込んでプロンプトの一部として注入すれば、過去の失敗を繰り返さない自己学習ループが完成する。

Q2: LLMは過去の実行結果を忘れてしまうが、どう対策すればいい?

LLM自体は状態を持たないため、外部に記憶領域を設けるアーキテクチャが必須となる。具体的には、実行ログや学習した教訓をデータベースに永続化して保存する。そして、新しいタスクを開始する直前に、関連する過去の記憶を検索してコンテキストとして提供する。これにより、LLMは擬似的に長期記憶を持つようになり、一貫性のある自律的な行動が可能になる。

Q3: エージェントが間違った教訓を学習してしまうのを防ぐには?

学習した教訓に対して信頼度のスコアを導入し、さらに有効期限を設定する設計パターンが非常に効果的だ。新しく得た教訓は低い信頼度からスタートさせ、繰り返し確認された場合のみスコアを加算する。信頼度の高い教訓だけをプロンプトに注入するように制御すれば、一時的なノイズによる誤学習の影響を最小限に抑えられる。

Q4: 動的に変化する環境でエージェントを動かす際のコツは?

最初から最後まで完璧な長期計画を立てるのではなく、数ステップ先までの短い計画を立てて頻繁に状況を再評価するオンライン再計画のアプローチが重要になる。行動を1ステップ実行するたびに周囲の状況を再確認し、予期せぬリスクを検知した場合は計画を破棄して即座に新しい行動を決定する。この柔軟な適応力を実装することで、安全なエージェント運用を実現できる。

Q5: 自律的な実験ループを実装する際、計算リソースの制限にはどう対応すべき?

限られた時間や計算リソースの制約下では、モデルやバッチサイズをあえて小さく設定し、実験の回転数を上げるアプローチが有効だ。1回あたりの計算負荷を軽くすることで、同じ時間予算内でより多くの最適化ステップを回せる。結果的に全体のパフォーマンス向上が見込めるはずだ。エージェント自身にハードウェアの制約を理解させることも重要なポイントになる。

8. まとめと次のステップ

今回は、自律型AIエージェントの自己学習ループを実装するための13の手法を解説した。

結論として、最初から複雑なシステムを組む必要はない。

まずは軽量なデータベースを使って、エージェントに過去の教訓を覚えさせるところから始めよう。

以下に今日からできるアクションをまとめておく。

- エージェントの構成を構造化して定義する

- 実行結果をデータベースに保存する仕組みを作る

- 教訓に信頼度と有効期限を設定する

これらを一つずつ取り入れるだけで、あなたのエージェントは劇的に賢くなるはずだ。

自分のプロジェクトに合わせて、少しずつ自律化の仕組みを育てていくといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド