結論から言うと、機密データがないならまずはLLM APIから始めるのが正解だ。

「とりあえずAPIを使えばいい」という思考停止はもったいないし、「プライバシーが心配だから全部ローカルで」というのも極端すぎる。

2026年現在、安くて速いAPIと、実用レベルに進化したローカルLLMは完全に共存している。

それぞれの強みを理解して、ハイブリッドに使い分けるのが賢い選択だと言える。

この記事では、コストや性能、プライバシーの観点から両者をどう選ぶべきか、具体的な基準を徹底的に解説する。

感覚で選ぶのをやめて、自分のプロジェクトに最適なアーキテクチャを見つけるといい。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

APIとローカルLLMの比較軸とは

APIとローカルLLMを比較する上で重要なのは、単なるカタログスペックの性能差ではない。

コスト構造、データの機密性、そしてシステムとしての扱いやすさという3つの軸で多角的に評価する必要がある。

ここからそれぞれの具体的な特徴とメリデメを詳しく見ていく。

外部サーバーで推論するLLM APIの強み

まずは外部サーバーで推論を行うLLM APIについて解説する。

代表的なのはGemini 2.0 FlashやClaude 3.5 Haikuなどのモデルだ。

2026年現在、APIの進化は凄まじく、入力100万トークンあたり0.075ドルという驚異的な安さを実現している。

これはもはやインフラコストとして無視できるレベルに近い。

最大のメリットは、初期投資が一切不要で、アカウントを作ればその瞬間から世界最高峰のAIをシステムに組み込めることだ。

さらに、AIエージェントの構築や外部ツールとの連携精度が非常に高いという特徴がある。

複雑な推論や構造化データの出力など、高度なタスクを安定してこなしてくれるのは頼もしい。

最近のAPIはコンテキストウィンドウも巨大化している。

数万行のコードや分厚いマニュアルを丸ごと読み込ませて質問できるのは、APIならではの強みだ。

手元のPCではメモリ不足で落ちてしまうような巨大なデータ処理も、APIなら一瞬で完了する。

インフラの運用保守を完全に丸投げできるのも、1人開発者にとっては大きなメリットになる。

一方でデメリットも明確に存在する。

外部のサーバーにデータを送信する性質上、社外秘の情報や個人情報など、機密性の高いデータの処理には絶対に向かない。

セキュリティ要件が厳しいエンタープライズのプロジェクトでは、導入の大きな壁になるはずだ。

とはいえ、個人開発や一般的なWebサービスに組み込むなら、まずはAPIを選ぶのが定石となる。

手元で動かすローカルLLMの進化

次に、自分のPCやサーバーで直接動かすローカルLLMについて見ていく。

Llama.cppやQwen2.5などが代表的なモデルとして挙げられる。

ここ数年で量子化技術が劇的に進化し、かつてのような数百万円する超高性能マシンは必須ではなくなった。

現在では、VRAMを8GB搭載したRTX 4060クラスの一般的なPCでも、数年前の最先端モデルを超える性能を実用レベルで動かすことができる。

最大のメリットは、完全なデータプライバシーを確保できる点だ。

外部のネットワークにデータを一切送信しないため、機密情報を扱う業務でも安心して利用できる。

また、APIの従量課金がゼロになり、かかるのはマシンの電気代だけというのも大きな魅力だ。

完全なオフライン環境で動作するのも見逃せないポイントだ。

インターネット接続が不安定な場所や、厳格なファイアウォール内にある社内ネットワークでも問題なく動く。

APIの障害や仕様変更に振り回されることなく、自分だけの安定したAI環境を構築できる。

デメリットとしては、GPUや大容量メモリを搭載したPCを用意する初期投資が必要になる点だ。

モデルのサイズもマシンのスペックに制限されるため、APIのような無尽蔵の計算リソースは使えない。

それでも、特定領域に特化させたモデルを手元で動かす運用は、多くの企業や開発者にとって現実的な選択肢になっている。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

APIとローカルLLMの比較表

ここで、APIとローカルLLMの具体的な違いを表にまとめた。

自分の用途にどちらが合っているか、ざっくりと把握するといい。

| 比較項目 | LLM API | ローカルLLM |

| --- | --- | --- |

| 初期投資 | 不要 | 必要(GPUや高スペックMac) |

| ランニングコスト | 従量課金(利用量に応じる) | 電気代のみ(API利用料ゼロ) |

| データプライバシー | 外部送信あり(機密データ不向き) | 外部送信なし(完全セキュア) |

| 推論速度 | 非常に高速 | マシンスペックに依存 |

| セットアップ | アカウント作成のみ | 環境構築が必要 |

| おすすめ度 | 初心者〜中級者に最適 | 機密データを扱う中〜上級者向け |

使い分けの判断基準5選

ここからは、具体的にどう使い分けるべきか、5つの判断基準を解説する。

自分のプロジェクトと照らし合わせて確認するといい。

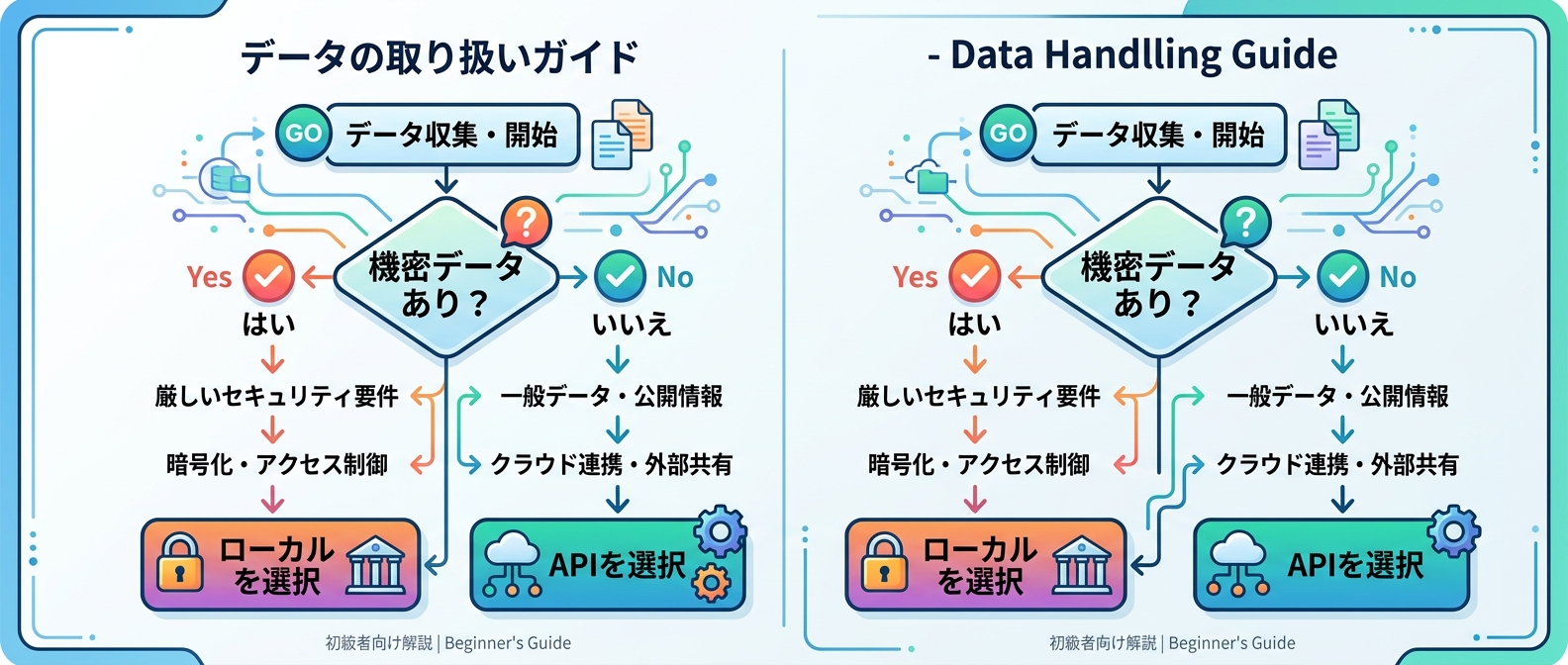

1. 機密データの有無

これが最も重要で、最初の分かれ道になる。

外部に送信できない機密データを扱うなら、ローカルLLM一択だ。

たとえば、顧客の個人情報や未公開の財務データなどを分析する場合、APIの利用はリスクが高すぎる。

こういうケースでは、完全オフラインで動くローカルLLMが必須の選択肢になる。

ただし、ローカルモデルはパラメータ数が少ないため、複雑な推論は苦手な傾向がある。

事前のプロンプト検証を念入りに行い、実用レベルに達するか見極めるプロセスが欠かせない。

もし品質が足りない場合は、データを匿名化してAPIに投げる設計も検討するといい。

2. 月間の処理トークン量

コストの分岐点は処理量にある。

小規模から中規模の利用なら、圧倒的にAPIの方が安上がりだ。

たとえば、ユーザー数が数十人規模の社内ツールなら、APIの利用料は月に数百円で収まることが多い。

しかし、月間5000万トークンを超えるような大規模な処理を常時行うシステムの場合、話が変わってくる。

APIの従量課金は、塵も積もれば山となる。

たとえば、ユーザーが入力した膨大なテキストを毎秒裏側でチェックし続けるような監視システムを作ると、API料金は跳ね上がる。

こういう常時稼働のバッチ処理こそ、ローカルLLMの独壇場だ。

初期投資としてGPU搭載PCを買ったとしても、数ヶ月で元が取れる計算になるケースは珍しくない。

3. 複雑な多段階推論の必要性

自律的に動くAIエージェントを作りたいなら、現状はAPIに軍配が上がる。

エージェント開発では外部関数呼び出しの精度が命になる。

たとえば、「天気を調べて、結果をJSON形式で出力し、データベースに保存する」といった多段の指示を出す場合だ。

APIモデルはこの構造化出力の精度が桁違いに高く、エラーで止まる確率が非常に低い。

複数のエージェントを連携させる複雑なワークフローも構築しやすい。

ローカルモデルで同じことをやろうとすると、出力フォーマットが崩れてシステムがクラッシュするリスクが高まる。

しんたろー:

僕は毎日Claude Codeを使って1人でSaaSを開発しているんだけど、コーディング用途なら間違いなくAPIモデルの圧勝だ。

Claude Codeの推論能力とコード生成の精度は凄まじく、複雑なアーキテクチャの変更も一瞬で終わる。

ローカルモデルも気にはなっているけど、この圧倒的な開発スピードを一度体験すると、手元のマシンリソースで消耗する気にはなれない。

4. 許容できるレイテンシと速度

ユーザー体験に直結するレスポンス速度も重要な指標だ。

APIは並列リクエストを大量に捌けるスケーラビリティがあるが、ネットワーク通信のオーバーヘッドにより最初のトークンが出力されるまでの時間(TTFT)にばらつきが出やすい。

一方、ローカルLLMは手元の環境で動くため、ネットワーク遅延がなく、低レイテンシで安定した応答が可能だ。

リアルタイムなUXが求められる場面では、ローカルLLMの方が優位になるケースが多い。

ただし、並列処理や大規模なバッチ処理で時間制約がある場合は、計算リソースを無尽蔵に使えるAPIの方が圧倒的に有利になる。

用途がリアルタイムなUIなのか、裏側の並列処理なのかで判断が分かれるポイントだ。

5. モデル管理・運用のオーバーヘッド

最後に、システムを運用する人的コストの話だ。

ローカルLLMを選ぶ際に最も軽視されがちなのが、モデルの管理や環境構築にかかるオーバーヘッドだ。

個人プロジェクトなら趣味の延長として許容できるが、チームで運用する場合は話が変わる。

この運用保守にかかる時間を人月コストに換算して、APIの利用料と比較する必要がある。

ローカルの方が電気代だけで安いと判断しても、モデル管理の工数を計上した途端にコストが逆転する事例は珍しくない。

インフラの運用保守を完全に丸投げできるAPIのメリットは、ビジネスにおいて非常に大きいと言える。

しんたろー:

とはいえ、ローカルLLMの進化も見逃せない。

特に最近の小規模モデルは、簡単なテキスト処理やデータの分類タスクなら十分すぎる性能を出せるはずだ。

自分のThreadPostの裏側で、ユーザーの投稿をバッチ処理で分析するような用途なら、ローカルLLMを組み込んでコストを削るのも面白そうだ。

よくある質問(FAQ)

ここからは、APIとローカルLLMの使い分けに関するよくある疑問に答えていく。

Q1: ローカルLLMを動かすのにどれくらいのPCスペックが必要?

VRAMを8GB搭載したGPUがあれば、実用的なモデルを十分に動かすことができる。

たとえばRTX 4060クラスの一般的なPCなら、数年前の最先端モデル相当のAIをローカルで実行可能だ。

より大規模なモデルを快適に動かすには、24GB以上のVRAMや大容量メモリを積んだ最新のMacなどが必要になる。

自分のやりたいタスクの規模に合わせて、適切なハードウェアを選ぶといい。

Q2: APIとローカルLLM、コスト面ではどちらがお得?

処理するデータ量によって完全に変わる。

最新のAPIは非常に安価なため、一般的な利用ならAPIの方が圧倒的に安く済む。

しかし、月間5000万トークンを超えるような膨大なテキストを処理し続ける用途だと、APIの従量課金がどんどん膨れ上がる。

その場合は、初期投資をしてでもローカルLLMを導入した方が、数ヶ月単位でのトータルコストは確実に下がるはずだ。

Q3: 業務の機密データを扱う場合、どうすればいい?

外部に出せないデータがあるなら、ローカルLLMを使うしかない。

ただし、ローカル環境で動くAIの性能で、業務の目的を達成できるかテストすることが必須だ。

性能が足りない場合は、個人情報などの機密部分だけをシステム側でマスキング処理する設計が求められる。

匿名化した上でAPIを利用すれば、安全性と高性能を両立できる。

Q4: ローカルLLMの運用で気をつけるべきことは?

モデルの管理や環境構築にかかる人的コスト(オーバーヘッド)を見落とさないことだ。

個人開発なら問題ないが、チームで運用する場合はこの工数を人月コストに換算してAPIと比較する必要がある。

ローカルの方がランニングコストが安いと判断しても、運用保守の工数を含めるとAPIの方が安上がりになるケースは多い。

目に見えないコストまで含めて総合的に判断することが重要だ。

Q5: AIエージェント開発にはどちらが向いている?

現状では、圧倒的にAPIモデルの方が向いている。

エージェントには、状況を判断して外部のツールを正確に呼び出す高い推論能力が求められる。

APIモデルはこの連携精度が非常に高く、複雑なシステムも安定して構築できる。

高度な自律性を持たせたいなら、迷わずAPIを選ぶべきだ。

まとめ:フェーズに合わせて最適な選択を

今回は、LLM APIとローカルLLMの使い分け基準について解説した。

どちらが優れているという話ではなく、用途とフェーズに合わせて適切なアーキテクチャを選ぶことが重要だ。

まずは初期投資ゼロで始められるAPIから触ってみて、AIの可能性を体感するといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド