SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIは速く書く。でも、それは「動くコード」なのか

月1,000ドルのインフラ費用が、移行後に87%削減された。

こんな数字を見たら、誰でも飛びつく。AIがコードを書き、次世代インフラが1秒以内にデプロイする。

爆速で作れるという文脈で語られるニュースが続いている。

でも待ってほしい。AIが生成したコードの約半数は、実際のプロジェクトメンテナーに却下されるというデータが同時期に出ている。

そしてAIアプリの年間解約率は非AIアプリより30%高い。

速く作れる。でも、それが使われ続けるプロダクトに直結するかどうかは、全く別の話だ。

3つのデータが示す現実と開発者の対応

あるクラウドプラットフォームが1億ドルの資金調達を発表した。マーケティング費用ゼロで200万人の開発者を集め、月間1,000万回以上のデプロイを処理している。

エッジネットワークを通じて1兆回以上のリクエストを処理する規模に成長している。

そのプラットフォームが掲げる価値提案はシンプルだ。AIが3秒でコードを書くなら、デプロイも1秒以内でなければならない。

従来の標準的なビルド&デプロイサイクルは2〜3分かかる。Terraformのような業界標準ツールを使えば、それが当たり前だった。

Claude・ChatGPT・Cursorといったコーディングアシスタントがコードを秒単位で生成する今、この2〜3分が深刻なボトルネックになっている。

そのプラットフォームを使った企業の報告は具体的だ。10万人の連邦請負業者にサービスを提供するプラットフォームのCTOが実測した数字がある。

開発速度が7倍向上し、インフラコストが87%削減された。インフラ費用は月額1万5,000ドルから約1,000ドルに落ちた。

これらは内部ベンチマークではない。エンタープライズクライアントが実測した数字だ。

月額1万5,000ドルが約1,000ドルになるなら、浮いたお金で高級チェアが全員分買える。まあ、私の場合は1人SaaSなので1脚しか必要ないが。

同じ時期に、AIコーディングの実力を問う研究結果が出た。AIエージェントの能力評価に使われる業界標準ベンチマークSWE-bench Verifiedだ。

Anthropic・OpenAIが自社モデルの進歩を示す際に頻繁に引用するベンチマークだ。

このベンチマークで合格とされたAI生成コードを、実際のオープンソースプロジェクトのメンテナーが人間の目でレビューした研究がある。

結果は衝撃的だった。自動テストを通過したコードの約半数が、実際のプロジェクトには取り込めないと判断された。

却下の理由は3つに分類される。コードの品質問題、既存コードへのダメージ、基本的な機能エラーだ。

特に基本的な機能エラーは見逃しがたい。自動テストはパスしているのに、実際には問題が解決されていない。

これはテストが通ることとコードが正しいことは別物だという事実を突きつけている。

モデルが進化しても問題の種類が変わるだけだ。Claude 3.5 Sonnet → 3.7 Sonnetではテスト通過率が上がったが、機能エラーの件数も増えた。

3.7 → Claude 4 Opusでは問題の種類がテスト失敗からコード品質の低さにシフトした。

75,000以上のアプリ開発者が使うサブスクリプション管理ツールが、年次レポートを出した。10億件以上のアプリ内トランザクション、年間110億ドル超の売上を分析した大規模データだ。

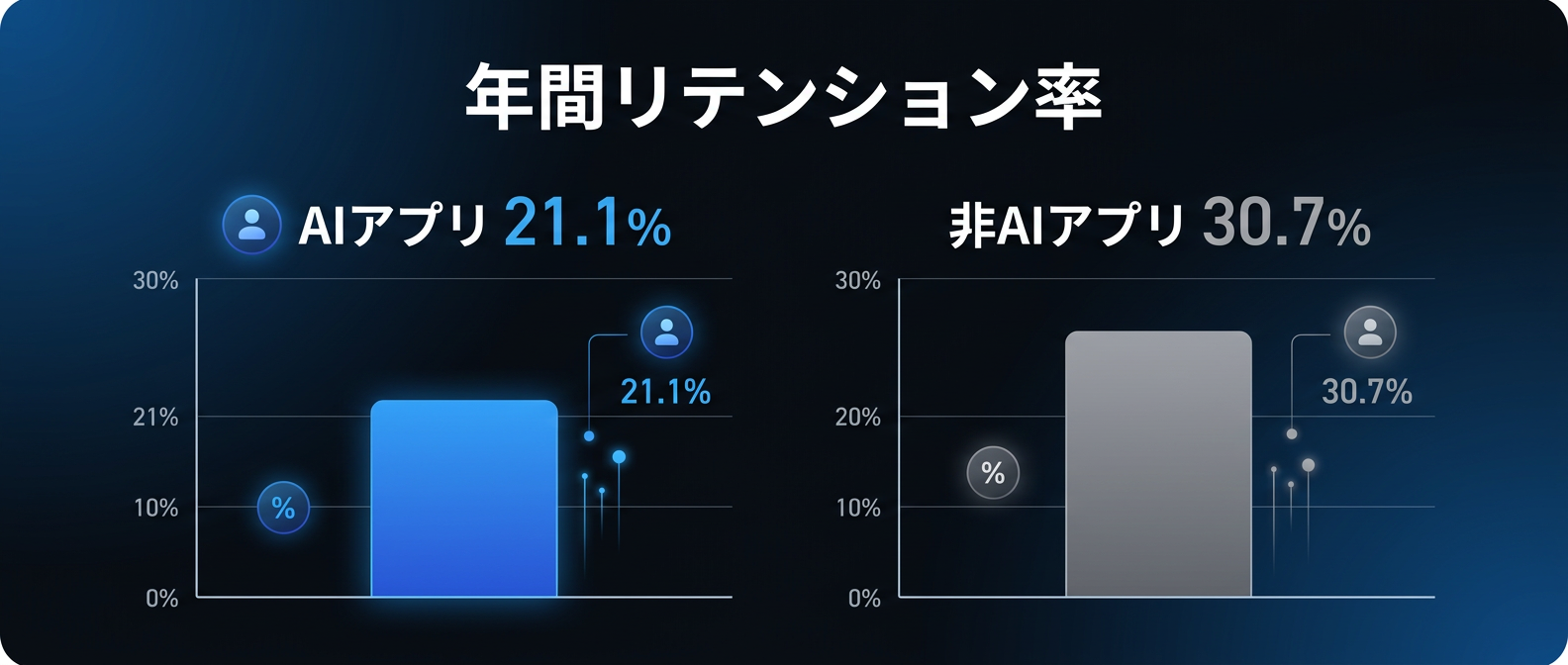

結論は明快だった。AIアプリの年間リテンション率は21.1%で、非AIアプリの30.7%と比べて約10ポイント低い。

月次でも同様だ。AIアプリの月次リテンションは6.1%、非AIアプリは9.5%。

唯一AIアプリが上回るのは週次リテンション(AIアプリ2.5% vs 非AIアプリ1.7%)だけだ。でも週次サブスクリプションはAIアプリでも主流ではない。

ユーザーは最新モデルを搭載したアプリを求めて乗り換える。プロダクトに固有の価値がなければ、AIモデルのアップデートのたびに競合に流れていく。

しんたろー:

この3つのデータを並べると、ちょっと怖くなる。爆速で作れる、コストが激減する、は本当だ。

でもAIが書いたコードの半分は人間に却下される、AIアプリのユーザーは30%速く離れる、も同じくらい本当だ。

速さだけを追いかけると、何かが抜け落ちる。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発現場での具体的な対策と設計

インフラの高速化とAIコーディングの普及は、開発の前提を変えた。以前はコードを書くことが時間のボトルネックだった。

今は書いたコードが本当に正しいか確認することがボトルネックになっている。

Claude Codeで毎日コードを書いている身として、これは実感がある。生成スピードは本当に速い。

でも、生成されたコードをそのまま本番に投げ込む気にはなれない。

テストが通ると実運用に耐えるの間には、埋めるギャップがある。

SWE-benchの研究が示した基本的な機能エラーの問題は特に注意が必要だ。自動テストをすり抜けるエラーは、人間が意図を理解してレビューしなければ発見できない。

これはAIがどれだけ賢くなっても、人間のレビュープロセスを省略できないことを意味する。

AIモデルの性能比較でよく使われるSWE-benchスコア。○○が最高スコアを達成という発表を見るたびに、開発者はじゃあ実務で使えるのかと考えるはずだ。

今回の研究が示したのは、ベンチマークスコアと実際のメンテナー採用率の間に平均24ポイントの差があるという事実だ。

モデルが進化するにつれて、この差は縮まるどころか、問題の種類が変わるだけだ。テスト失敗からコード品質の低さへ、コード品質の低さから次の何かへ。

開発者として、ベンチマークスコアの読み方を変える必要がある。このモデルは何点かではなくこのモデルが生成するコードのどこをどう確認するかという問いに切り替える。

AIアプリの年間リテンション21.1%という数字。これをAIだから仕方ないと受け取るのは間違いだ。

ユーザーが離れる理由は明確だ。最新のAIモデルを搭載しているという価値だけで差別化しているアプリは、次のモデルが出るたびに競合に負ける。

逆に言えば、AIをラッパーとして使うだけでなく、ユーザーの具体的な課題を深く解決するプロダクト設計ができていれば、リテンションは改善できる。

週次リテンションでAIアプリが上回っている(2.5% vs 1.7%)のは、最初の体験は優れているという証拠だ。問題は長期的な価値提供ができていないこと。

初回の感動を、3ヶ月後・12ヶ月後も維持できる設計が求められている。

しんたろー:

ThreadPostを作ってて思うのは、AIで何かできるだけでは弱いということ。ユーザーがこれがないと困ると感じる体験を積み重ねないと、月次リテンション6%の世界に入ってしまう。

爆速でプロトタイプを作れるようになったからこそ、何を作るかの設計に時間をかける。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響。今すぐ見直したい3つのポイント

Claude Codeで生成したコードを、どういうフローでレビューしているか。動いたからOKは危険だ。

自動テストを通過したコードの半分がメンテナーに却下されるという事実は、テストの設計自体を見直す必要があることを示している。

具体的に整備しておきたいのは以下だ。

- 意図の確認: AIが何を解決しようとしたコードなのか、生成前にプロンプトで明示する

- エッジケースのテスト: 正常系だけでなく、異常系・境界値のテストをAIに書かせる(でも人間が確認する)

- コードスタイルの統一: プロジェクト固有のルールをAIに事前に渡す

- 既存コードへの影響確認: 変更が他のモジュールに波及していないか、人間の目で追う

AIが書いたコードをドラフトとして扱う文化を作る。速度の恩恵を受けながら、品質の担保は人間が担う。

AIアプリを作るとき、とりあえずAIで何かできるデモから始めることが多い。でも年間リテンション21.1%という数字を見ると、デモが面白いだけでは長続きしないことが分かる。

初期設計の段階で問う質問がある。

- ユーザーが3ヶ月後も使い続ける理由は何か

- AIモデルが更新されたとき、競合に乗り換えられない理由は何か

- ユーザーのデータ・履歴・設定が蓄積されることで、スイッチングコストが生まれているか

- AIの出力だけでなく、ユーザー固有のワークフローに組み込まれているか

AIを使っているはもはや差別化にならない。このプロダクトでなければならない理由を設計する。

月額1万5,000ドルのインフラ費用が1,000ドルになった事例は極端だ。でも、AIエージェントを使った開発サイクルが速くなっている今、デプロイのボトルネックを放置するコストは見えにくいが確実に存在する。

2〜3分のデプロイ待ち時間が、AIコーディングの速度と釣り合っているか確認する価値はある。

特に注意したいのは、エージェントスピードに対応したインフラ設計という考え方だ。人間が10秒でデプロイできれば十分だった時代は終わりつつある。

AIエージェントが秒単位でコードを生成し、即座に動作確認するサイクルに対応できる構成かどうかを見直す。

しんたろー:

コスト削減の数字(65%、87%)は魅力的だけど、移行コストと学習コストは別にかかる。今のインフラで詰まってるかを先に確認してから動く。

詰まってないなら、今すぐ乗り換えるより、コードの品質担保に時間を使うほうが優先度高い。

よくある質問

Q1. AIコーディングアシスタントを使うと開発はどれくらい速くなりますか?

実際の事例では、AIツールと高速インフラを組み合わせることで開発速度が7〜10倍になったという報告がある。

ただし、これはコードを書く速度の話だ。生成されたコードの約半数は人間のレビューで修正や却下が必要になるというデータもある。

単純に作業時間が10分の1になるわけではない。レビュー・テスト・品質確認に時間を割く必要がある。

体感としてはドラフトを作る速度が10倍になり、レビューに集中できる時間が増えるという表現が近い。生成スピードの恩恵を最大化するには、レビュープロセスを事前に設計しておくことが前提になる。

Q2. AIアプリをサブスクリプションで収益化するのは難しいですか?

難しい、というより設計の問題だ。

75,000以上のアプリ開発者の実データによると、AIアプリの年間解約率は非AIアプリより30%高く、年間リテンション率は21.1%(非AIアプリは30.7%)にとどまる。

原因は最新AIモデルを搭載しているという点だけを差別化に使っているケースが多いこと。モデルが更新されるたびに競合に乗り換えられる。

長期的なリテンションを実現しているAIアプリには共通点がある。ユーザーのデータ・履歴・ワークフローが蓄積されることで、スイッチングコストが生まれている。

AIが使えるアプリではなく自分のデータが入っているアプリになると、解約率は下がる。

Q3. 次世代クラウドプラットフォームは従来のクラウドと何が違うのですか?

最大の違いはエージェントスピードへの対応だ。

従来のクラウドプラットフォームは、人間が設計・承認・デプロイするサイクルを前提に設計されている。Terraformを使った標準的なデプロイは2〜3分かかる。

次世代プラットフォームが狙うのは、AIエージェントがコードを秒単位で生成し、即座に動作確認するサイクルへの対応だ。1秒未満のデプロイを実現するため、自社でデータセンターを構築するケースもある。

コスト面では、最大65〜87%の削減を報告する事例がある。ただし、移行コストと既存システムとの互換性の確認は別途必要になる。

AIが速くコードを書けるのに、デプロイで詰まっているという状況が顕在化したときに、乗り換えを検討するのが現実的なタイミングだ。

まとめ

速く作れるようになった。でも速く作れるとちゃんと動くと使い続けられるは、別々に解決する問題だ。

AIが生成したコードの半分は却下される。AIアプリのユーザーは30%速く離れる。

インフラコストは87%削減できる。この3つの数字を同時に頭に入れておくと、爆速開発で何に時間を使うかが見えてくる。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド