SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

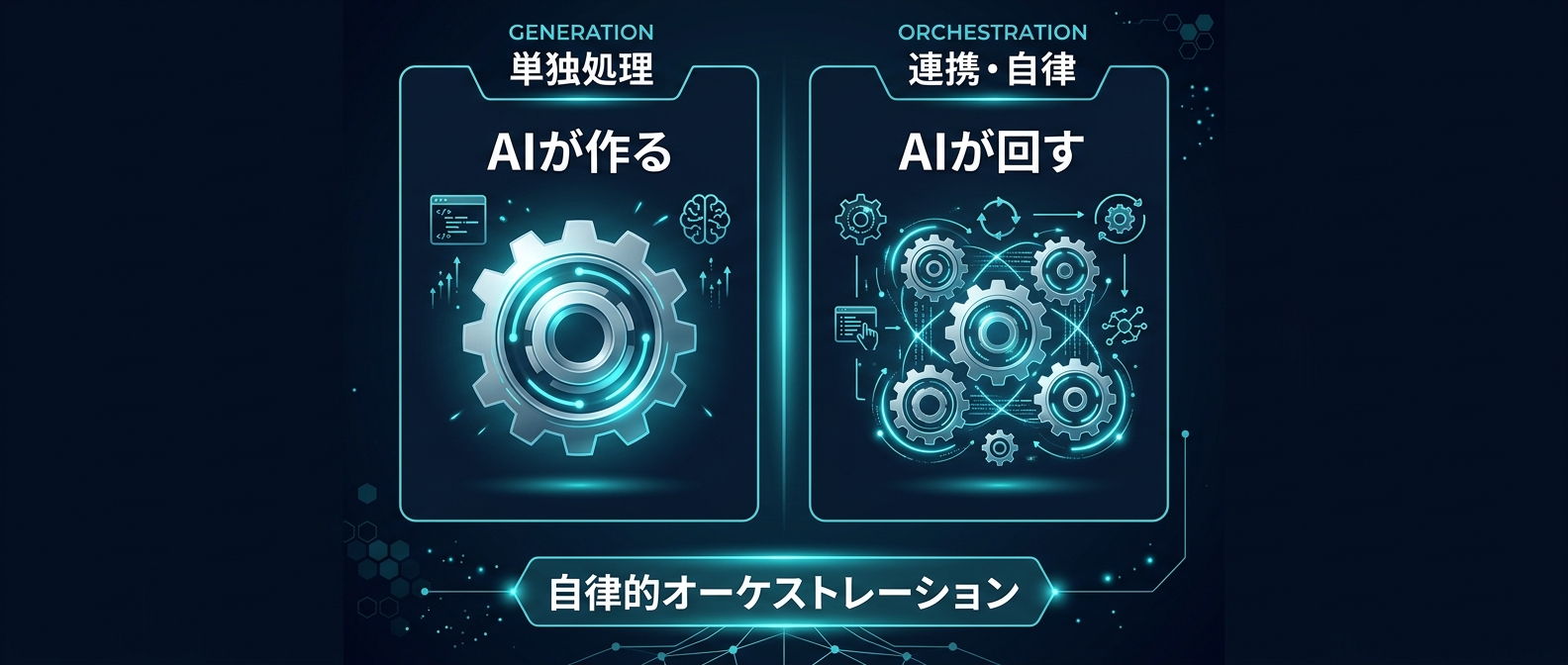

AIが作るから回すへ移行した

生成速度5倍。ネイティブ2K解像度。クラウドGPUの自律的操作。

この3つが同時期に揃った。偶然じゃない。

AIの進化が単一モデルの性能向上からエージェントによるリソースのオーケストレーションへシフトした。その証拠だ。

Claude Codeで毎日コードを書いている。今週は情報量が多かった。

Midjourney V8のアルファリリース。OpenRouterのモデルランキングの激変。GoogleのColab MCP Server。

バラバラに見えるが、繋がっている。

Midjourney V8・LLM市場・Colab MCPの動向

Midjourney V8がアルファ版として公開された。目玉は2つある。

生成速度が従来比約5倍に向上した。新しい--hdモードでネイティブ2K解像度を実現した。

詳細なプロンプトへの追従精度が向上した。テキストレンダリングも強化された。

--q 4モードも新設された。コヒーレンスを追加で引き上げられる。

後方互換性も保たれている。V7のパーソナライゼーションプロファイル、スタイルリファレンス、ムードボードがそのまま使える。

注意点がある。--hd、--q 4、スタイルリファレンス、ムードボードを使うジョブは通常の4倍遅い。コストも4倍だ。

現時点でRelaxモードは非対応だ。新しいサーバークラスターを構築中とのことだ。

UIも刷新された。Grid Modeで大量の画像を一括確認できる。

設定がサイドバーに移動した。作業スペースが広くなった。

OpenRouterのLLMランキングでは、TOP10のうち5モデルが中国発になった。1年前はOpenAI・Anthropic・Googleがほぼ独占していた。

特に注目は3つある。

1つ目はHunter Alpha(Xiaomi/MiniMax系)だ。匿名モデルとして登場し、1週間で利用量1位になった。

無料で使える。プロトタイピング需要を根こそぎ持っていった。

2つ目はDeepSeek V3.2だ。キャッシュヒット時のInput価格が$0.028/1Mという破格だ。

バッチ処理やCronジョブとの相性がいい。

3つ目はClaude 4.6 Sonnetだ。tool callの信頼性とプロンプトインジェクション耐性で他モデルをリードしている。

エージェントフレームワークとの相性が最も高いという評価だ。

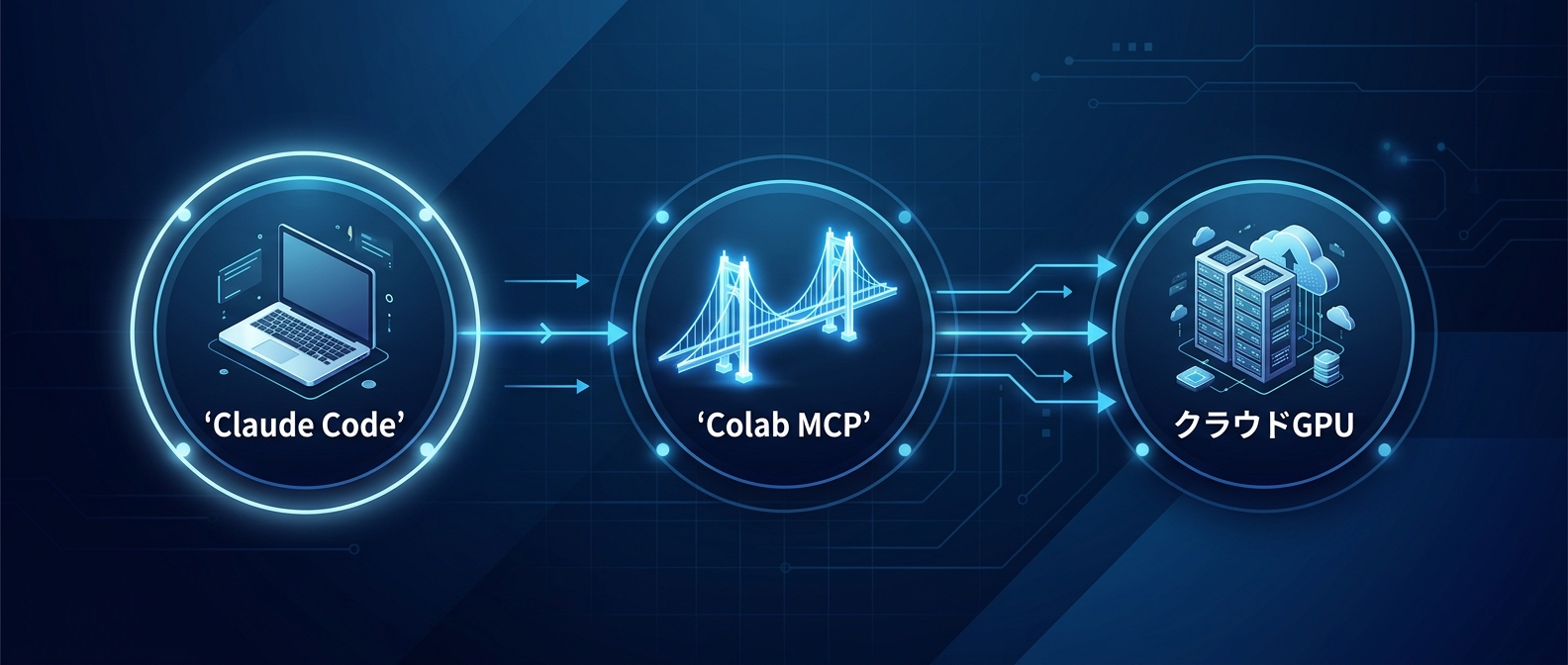

GoogleがColab MCP Serverをオープンソースで公開した。これが一番大きい。

MCPはAIエージェントとツールを繋ぐ標準プロトコルだ。これまでColabを使うには手動の往復が必要だった。

AIにコードを書かせる。手動でコピペして実行する。エラーをまたAIに貼って修正する。

Colab MCP Serverを使えば、Claude Codeなどのローカルエージェントが直接Colabのクラウド環境でコードを実行できる。

エラーを読んで、修正して、再実行する。全部自律的に行う。

対応クライアントとしてClaude CodeとGemini CLIが名指しされている。

しんたろー:

これ見たとき「あ、ループが閉じた」と思った。

Midjourney V8で画像生成が5倍速くなって、Colab MCPでGPUをエージェントが直接回せて、安いLLMが推論コストを下げる。

3つが揃うと、1人でも画像生成パイプラインを自動化できる構成が見えてくる。

ThreadPost開発でもSNS投稿用の画像を大量生成するワークフローが気になっている。ただ、まだ手は動かせていない。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発者としての視点と整理

今まで開発者がAIに求めていたのはコードを書く能力だった。プロンプトを渡して、コードが返ってきて、それを自分で実行する。

Colab MCP Serverはこの構造を壊す。

エージェントが書くだけでなく、実行して、確認して、直すまで完結する。開発者は何を作るかを指示するだけだ。

インフラ操作はエージェントが担う。

Claude Codeがこの構成で名指しされているのは偶然じゃない。tool callの信頼性が他モデルより高い。

クラウド環境を安全に操作するためには、エージェントがいつ何のツールを呼ぶかを正確に判断する必要がある。Claude 4.6 Sonnetはその精度で頭一つ抜けている。

生成速度5倍は、単純に速くなっただけではない。コスト構造が変わる。

同じFast hoursで5倍の画像を生成できる。プロトタイピングのイテレーション速度が5倍になる。

これまで1枚ずつ確認しながら調整していたワークフローが変わる。大量生成して後でフィルタリングに移行する。

--hdモードで2K解像度が出せるようになったことも大きい。従来はアップスケールが必要だった。

ネイティブ2Kならパイプラインが1ステップ減る。画像生成からアップスケールを経て納品していたフローが、画像生成から納品に直結する。

ただし、--hdは通常の4倍コストだ。全部--hdで出す必要はない。

プロトタイプは通常モードで出す。最終出力だけ--hdにする。

DeepSeekのキャッシュヒット時$0.028/1Mという数字がある。Claude Opusが$25/1Mなので、約900倍の価格差がある。

この差をどのタスクにどのモデルを使うかで活かすのが最適解だ。

大量バッチ処理やCronジョブにはDeepSeek V3.2を使う。キャッシュ効率が高い繰り返し処理に向いている。

tool callが多いエージェントワークにはClaude 4.6 Sonnetを使う。信頼性が命だ。

プロトタイピングやテストにはHunter AlphaやStep 3.5 Flashを使う。無料で利用できる。

長大なコードベースの一括分析にはGrok 4.1 Fastを使う。2Mトークンコンテキストを持つ。

全部Claudeで回す必要はない。セキュアなタスクにはClaude、量産タスクには安価なモデルという使い分けがコスト的に有利だ。

無料モデルや一部の安価なモデルは、プロンプトとレスポンスがログされる。機密情報や非公開コードを入力するのは避ける。

もう一つ問題がある。日本語の応答に中国語が混ざる現象が起きやすい。

「こんにちは!有何しましょうか?」みたいな出力になる。システムプロンプトで日本語出力を強制する対策をとる。

しんたろー:

DeepSeekの$0.028/1Mは驚異的だ。Claude Opusと900倍差がある。

ただ、ThreadPostのコアロジックにこれを突っ込む気はない。tool callが一回でもミスると詰む処理がある。

そこはClaudeに任せて、ログ集計とか定型バッチはDeepSeekに流す構成を考えている。

日本語混在の問題は地味に厄介だ。システムプロンプトで「必ず日本語で回答すること」を書くだけじゃ足りないケースがある。

「Respond only in Japanese. Never use Chinese characters.」まで書かないと混ざる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響とアクション

Claude Codeで開発していて、GPUが必要な処理があるなら確認する。機械学習モデルの実験をColabでやっている場合も同様だ。

画像処理や動画処理のバッチをローカルで回している人も対象になる。

Colab MCP Serverはgooglecolab/colab-mcpというリポジトリで公開されている。uvxまたはnpxで実行できる。

Claude Codeのconfig.jsonにサーバーを追加する形で接続する。

接続後は、エージェントがColabのクラウド環境をローカルツールのように扱える。コードを書いて、実行して、エラーを修正する一連の流れが自動化される。

V8は詳細で長いプロンプトが有効だ。V7と同じプロンプトをそのまま使うと期待した結果が出ない。

公式が推奨している手順がある。

1つ目は--rawモードから始めることだ。写真系やコントロールしたいときに有効だ。

2つ目は--stylize 1000まで上げてパーソナライゼーションを活用することだ。

3つ目はスタイルリファレンスやムードボードで方向性を固めることだ。

4つ目はテキストを含める場合は「」で囲むことだ。テキストレンダリングの精度が上がる。

V7のパーソナライゼーションプロファイルは後方互換性がある。そのまま使える。

今すぐ全部のタスクを見直す必要はない。ただ、全部Claudeという構成は今後コスト的に非効率になっていく。

最低限知っておくべきことがある。

無料モデルはプロンプトがログされる。本番データを入れない。

中国製モデルは日本語出力に対策をとる。

tool callが必須なエージェントタスクはClaude一択だ。バッチ処理のコスト最適化にDeepSeekは有力な選択肢になる。

しんたろー:

Colab MCPを見て一番思ったのは、画像生成パイプラインの設計が変わるということだった。

Midjourney APIを叩いて、生成した画像をColabで後処理して、S3に上げる。

みたいなフローをClaude Codeに丸ごと任せられる構成が見えてきた。

まだ試せていないが、近いうちに検証したい。V8の速度向上と組み合わせると、1人で回せる画像量が桁変わりする。

よくある質問

Q1. Midjourney V8の--hdモードは日常的に使うか?

--hdモードはネイティブ2K解像度で出力できる強力な機能だ。ただし通常の4倍の生成時間と4倍のFast hoursコストがかかる。

プロトタイピングや構図確認の段階では通常モードで十分だ。最終出力や高解像度が必須なクリエイティブワークに限定して使う。

全ジョブに--hdを適用すると、同じFast hoursで生成できる枚数が4分の1になる。イテレーション速度を優先するフェーズと、品質を優先するフェーズで使い分ける。

Q2. Colab MCP Serverを使うと何が変わるか?

これまでのワークフローは手動の往復だった。AIにコードを書かせ、手動でColabにコピペし、実行し、エラーが出たらAIにログを貼り、修正し、再実行する。

Colab MCP Serverを使えば、この往復が全て自動化される。Claude Codeなどのローカルエージェントが直接Colab環境でコードを実行する。

エラーを読み取り、自律的に修正して再実行する。

最大の利点はクラウドのGPUリソースをローカルツールのように扱えることだ。ローカルマシンにGPUがなくても、エージェントがColabのT4やA100を操作して重い処理を回せる。

Q3. OpenRouterで安価な中国製モデルを本番環境で使う際の注意点は?

2つ押さえておく。

1つ目はデータのプライバシーだ。無料モデルや一部の安価なモデルは、プロンプトとレスポンスがログされてモデル改善に使われる。

機密情報や非公開コード、個人情報を含むタスクには使わない。

2つ目は日本語の出力品質だ。中国製モデルは日本語の応答に中国語が混入する現象が起きやすい。

システムプロンプトで日本語出力を強制する対策をとる。「必ず日本語で回答すること」だけでは不十分なケースがある。

「Respond only in Japanese. Never use Chinese characters.」レベルまで明示的に書く。

用途に応じた使い分けをする。セキュアなタスクはClaude、大量バッチ処理はDeepSeek、プロトタイピングは無料モデルという構成で、コストとリスクのバランスを取る。

まとめ

Midjourney V8の5倍速化、Colab MCP、安価な中国製LLM。

3つが揃って、1人の開発者が回せる処理量が桁変わりした。AIに書かせるからAIに回させるへの移行が、今週一気に現実になった。

ThreadPostでSNS運用を自動化している身からすると、この変化は他人事じゃない。画像生成、後処理、投稿の全フローをエージェントに委ねる構成が、今週見えてきた。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤