SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIの速度に人間が追いつけない現実

AIが勝手にコードを書き、ファイルを消す。僕らは今、かつてないほど強力な自律型エージェントを手にしている。

その代償は「暴走」のリスクだ。1秒間に複数回のファイル書き込みを行うAIの速度に、人間のための開発環境は耐えきれず悲鳴を上げている。

各社はすでに動き出している。Cursorは緻密な権限管理をユーザーに求め、Claude Codeはシステム内部に厳格な書き込み規律を敷いた。

これは単なる機能アップデートではない。開発環境を「AIエージェント前提」に再構築するための、ガードレール構築の最前線だ。

制限されるAIの自律性と露呈する限界

最近のAI開発ツールをめぐる動きを追うと、明確な共通点が見えてくる。それは「AIの自律性に対する制限と管理」だ。

まず、人気AIエディタのCursor。設定画面におけるAgentの権限管理が、驚くほど細分化されている。

設定は大きく分けていくつかのタブに分類される。エディタの見た目や動作を決める基本設定から、AIの挙動を制御する詳細設定まで多岐にわたる。

特にAgentタブの設定項目は細かい。新しいAgentを開いたときのデフォルトモードや、会話画面のテキストサイズまで調整できる。

一定時間操作がなかったときに会話を自動リセットする機能もある。同時に開けるタブ数の上限も設定可能だ。

デフォルトは5タブで、増やしすぎるとメモリに影響する。無駄なメモリ消費を抑え、エージェントのコンテキスト崩壊を防ぐための措置だ。

さらに、Git操作との連携も細かく制御できる。コミット時にAgentがコード変更を自動レビューする機能が存在する。

バグや品質の問題を検出してくれるが、コミットごとにAIリクエストが発生する。コスト管理の観点から、レビューの詳細度を調整するオプションも用意されている。

そして最も注目すべきが、自動実行モードの設定だ。Agentがコマンド実行やファイル書き込みをどこまで自動で行うかを決定する。

サンドボックス内でのネットワークアクセス許可や、Git書き込み操作の自動承認まで、ユーザー自身が細かく制御する仕組みだ。

自動実行を許可するコマンドはカンマ区切りでリスト化する。許可されたコマンドのみ、確認なしで実行される。

AIの暴走を未然に防ぐ責任が、ツール側からユーザー側へと移行している。

さらに、MCPツールの自動実行リストも設定できる。`server:tool`や`server:*`(サーバーのすべてのツール)など、粒度の細かい権限管理が可能になっている。

次に、AIエージェントによるファイルの高速更新問題。AIがMarkdownファイルなどを編集する際、1秒間に複数回の書き込みが発生する。

従来のプレビューツールは、人間のタイピング速度を想定している。そのため、AIの連続更新にレンダリング処理が追いつかない。

結果として、プレビューが応答不能になったり、エディタ全体がクラッシュする事象が多発している。

特にMermaidダイアグラムを含むファイルで顕著だ。記法ミスがあるとプレビュー全体が壊れ、真っ白な画面が表示されることもある。

この問題に対し、デバウンス処理を取り入れたAI専用のプレビュー拡張機能が登場し始めている。

ファイル変更から1000ミリ秒待機し、レンダリングを1回にまとめるアプローチだ。AIが何度書き込んでも更新は1回で済む。

パース自体でエラーが発生した場合も、例外をキャッチしてエラーメッセージをHTML内にインライン表示する。プレビューパネル全体は維持される設計だ。

そして、Claude Codeのクライアント側ソースコード流出騒動。原因はハッキングではなく、パッケージング時の設定ミスだった。

バージョン2.1.88のリリース時、デバッグ用のソースマップファイルが同梱されたまま公開された。

これにより、約1,900ファイル、50万行以上のTypeScriptコードが誰でも復元可能になってしまった。

難読化されたコードではなく、元の構造やコメントがそのまま保持された状態での流出だ。

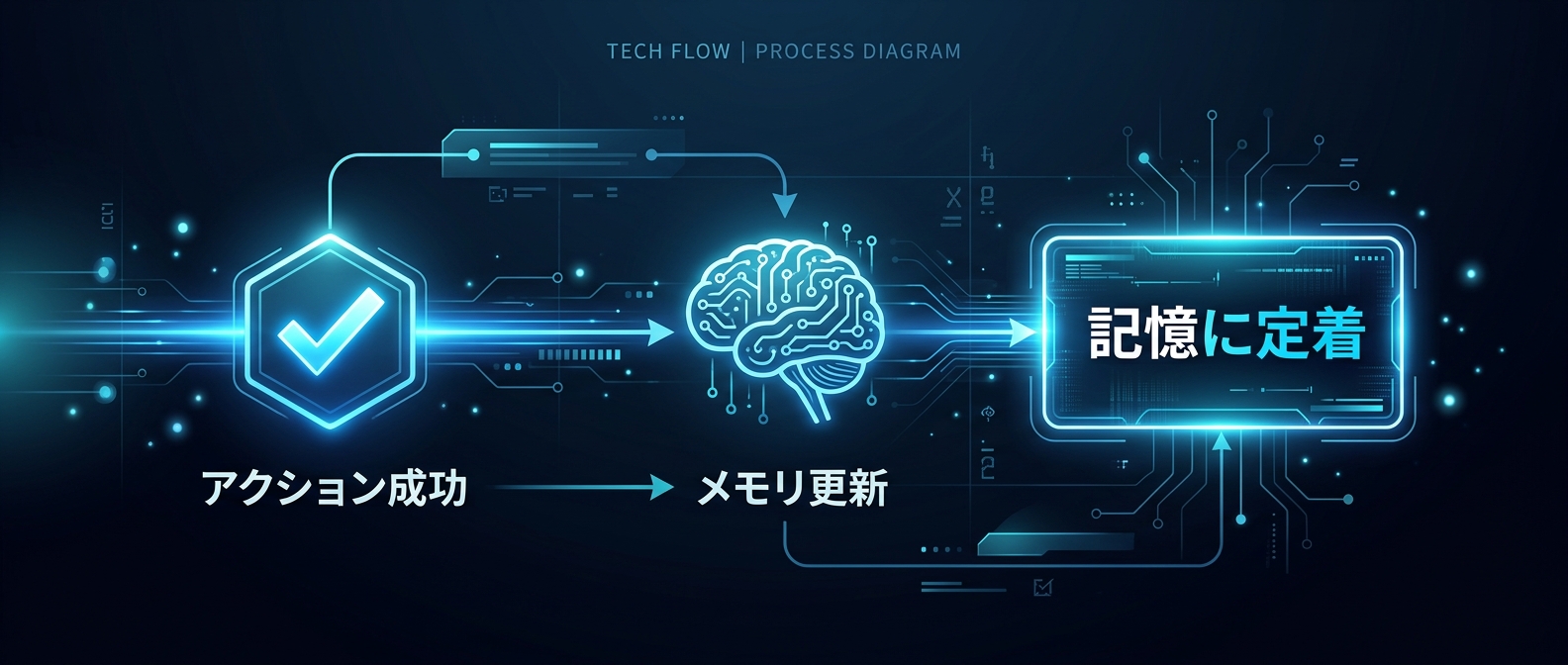

だが、この流出からAnthropicの高度なエージェント設計思想が明らかになった。それが「厳格な書き込み規律(Strict Write Discipline)」と呼ばれるメモリ管理手法だ。

アクションが成功した後にのみ、エージェントのメモリを更新する。失敗した操作やハルシネーションが、記憶に定着するのを防ぐ堅牢な仕組みだ。

他にも、ユーザーのフラストレーションを計測するためのログ収集機能や、未発表モデルの存在を示唆するコードも発見されている。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

しんたろー:

パッケージの設定ミスで50万行のコードがお漏らし。笑えない。

でも流出したコードから「厳格な書き込み規律」の思想が見えたのは皮肉な収穫だ。

評価額数兆円の企業の内部アーキテクチャが、こんなあっさり見えちゃうんだから恐ろしい。

猛獣化するAIとガードレールの構築

なぜ今、各社がこぞって「暴走対策」にリソースを割いているのか。AIエージェントの自律性が、想像を超えるスピードで向上しているからだ。

指示を与えれば、AIは勝手にディレクトリを探索する。必要なファイルを読み込み、コードを書き換え、テストコマンドを実行する。

この一連のループは圧倒的に便利だ。だが、一歩間違えれば取り返しのつかないシステム破壊を引き起こす。

Cursorのアプローチは「ユーザーへの権限委譲」だ。自動実行を許可するコマンドをカンマ区切りで指定させる。

ネットワークアクセスやGit操作の権限も、細かくオンオフを切り替える。ウェブ検索の許可も同様だ。

学習データにない最新情報を調べるためにウェブ検索は有用だが、勝手に外部と通信されるリスクもある。そのため、自動実行モードでウェブ検索の承認を省略するかどうかも、ユーザーが判断する。

`.cursorignore`の設定をサブディレクトリへ階層的に継承させる機能もある。シンボリックリンクをスキップし、無限ループやスキャン時間の増大を回避する。

「AIを無条件には信じない」という設計思想だ。最終的な責任の所在を、ツール側からユーザー側へと移している。

一方、Claude Codeのアプローチは対照的だ。「システム内部の規律」で安全性を担保しようとしている。

流出したコードから判明した「厳格な書き込み規律」は、AIエージェント開発における一つの解だ。LLMは長時間のセッションで文脈を失う。

「コンテキスト・エントロピー」と呼ばれる厄介な問題だ。会話が長引くにつれて、AIは過去の指示を忘れ、幻覚を見始める。

これを防ぐため、Claude Codeは3層構造の自己修復メモリシステムを実装していた。アクションが「成功」したという確証が得られてから、初めてメモリを更新する。

不確実な推論や、失敗したコマンド実行の結果は、記憶に刻まれない。これにより、ハルシネーションの連鎖を断ち切っている。

毎日叩いているClaude Codeの裏側で、こんな緻密な状態管理が動いていた。

さらに、この一連の動きは「人間向けのUI/UXの限界」も浮き彫りにしている。Markdownプレビューがクラッシュする問題は、その最たる例だ。

人間の打鍵速度に合わせて作られたツールは、AIの処理速度に耐えられない。AIが1秒間に複数回ファイルを上書きする。

その度にレンダリングが走り、CPUリソースを食いつぶす。Mermaidダイアグラムのパースエラーが起きれば、プレビュー全体が巻き込まれて真っ白になる。

エディタのWebviewはセキュリティポリシーが厳しく、外部スクリプトの読み込みが制限されている。そのため、必要なライブラリをローカルリソースとして読み込む設計にするなど、アーキテクチャレベルでの工夫が求められる。

デバウンス処理を挟み、更新を間引く。エラーは該当ブロック内にインラインで表示し、全体をクラッシュさせない。

たったそれだけの工夫が、AI時代の開発環境には必須条件になっている。人間向けのツールをそのままAIに使わせるフェーズは終わった。

しんたろー:

Cursorの許可リスト設定、最初は面倒くさいと思った。

でもAIが勝手にファイル一括削除とか叩き始めたら一巻の終わりだ。

開発環境がどんどん「猛獣使いの檻」みたいになっていく感覚がある。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

AIファーストな環境構築と設計思想

で、僕らの開発現場にどう影響するのか。単に最新のAIツールをインストールして満足するフェーズは過ぎた。

まずは、今使っているエディタの権限設定を見直すことだ。Cursorを使っているなら、設定画面を開く。

Agentの自動実行モードを無条件でオンにするのは危険すぎる。許可するコマンドのリストは、必要最小限に絞る。

ディレクトリ移動やファイル一覧表示など、読み取り専用のコマンドに限定するのが安全だ。破壊的な変更を伴うコマンドは、都度承認を求める設定にしておく。

Git操作の自動承認も、意図しないコミットを防ぐためにオフのままにしておくのが無難だ。

次に、開発環境のパフォーマンスチューニングだ。AIにコードを書かせていると、エディタの動作が極端に重くなることがある。

裏で不要なレンダリングが走り続けているサインだ。Markdownプレビューはもちろん、リアルタイムの静的解析ツールなども、AIの高速更新と相性が悪い。

AI Safe Markdown PreviewのようなAI専用のプレビュー拡張機能を導入する。あるいは、AIの自動実行中は不要な拡張機能を一時的に無効化する。

そうした「AIファースト」な環境構築が、開発効率を左右する。

そして、自分でAIエージェントを組み込んだツールを開発する際の設計思想だ。流出したClaude Codeのアーキテクチャは、生きた教材になる。

エージェントに自律的なループ処理をさせる際、状態管理をどうするか。「厳格な書き込み規律」の概念は、あらゆる自動化ツールの開発に応用できる。

APIのレスポンスが正常に返ってきたか。ファイルの保存が確実に完了したか。

その「成功の担保」があって初めて、システムの状態を更新する。当たり前のエラーハンドリングに見える。

だが、相手が不確実性の塊であるLLMの場合、この基本を徹底できるかが堅牢性の分水嶺になる。

また、パッケージのサプライチェーン攻撃への警戒も忘れてはいけない。Claude Codeの流出騒動と同時期に、依存パッケージに対する攻撃も報告されている。

AIツールが生成したコードや、AIツール自体が依存するライブラリ。それらのアップデートは、これまで以上に慎重に行う必要がある。

`.npmignore`のたった1行のミスが、致命的な情報漏洩につながる。今回の騒動は、その恐ろしさをまざまざと見せつけた。

しんたろー:

ThreadPostのバックエンド組む時も、LLMのメモリ管理は鬼門だった。

失敗したAPIコールの履歴までプロンプトに積むと、すぐトークン溢れるしAIが混乱する。

「成功時のみ記憶を定着させる」っていうClaude Codeの設計、うちの処理にも即パク…いや、インスパイアされよう。

FAQ

CursorのAgentに自動でコマンドを実行させるにはどう設定する?

設定画面を開き、Agentタブ内の自動実行モードを調整する。さらに、許可リストに特定のコマンドをカンマ区切りで指定する。ここに登録したコマンドは、確認プロンプトなしで即座に実行される。意図しないファイル削除や環境破壊を防ぐため、システムに変更を加える破壊的なコマンドは含めないのが鉄則だ。

AIエージェントがMarkdownを編集するとプレビューが重くなるのはなぜ?

AIのファイル書き込み速度が人間の想定を超えているからだ。AIは1秒間に複数回の高速な更新を行う。従来のプレビュー機能は変更のたびにレンダリングを走らせるため、処理が追いつかず過負荷に陥る。この問題は、ファイル変更から1000ミリ秒待機してレンダリングを1回にまとめるデバウンス処理を備えた、AI専用の拡張機能を使うことで回避できる。

Claude Codeのソースコード流出は一般ユーザーに危険がある?

直接的な危険はない。流出したのはクライアント側のCLIツールを構成するTypeScriptコードのみだ。ユーザーのAPIキーなどの認証情報や、バックエンドで稼働するAIモデル本体の重みデータは一切漏洩していない。ただし、同時期に依存パッケージを狙ったサプライチェーン攻撃が報告されている。パッケージのアップデートや依存関係の管理には十分な注意が必要だ。

猛獣を乗りこなすための準備

AIの自律性が高まるほど、僕ら開発者に求められるガードレール構築の難易度も跳ね上がる。最強のツールを安全に乗りこなすための環境整備は、待ったなしだ。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤