Anthropicのランレート収益が300億ドルを突破した。

2025年末の約90億ドルから、わずか数ヶ月で3倍以上の急成長だ。

その裏で、次世代モデル「Mythos」の存在が明らかになった。

圧倒的なコーディング能力と推論力を持つが、運用コストは極端に高い。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

異常なスピードで進むインフラ競争

公式発表や内部資料のリークから、AI業界の地殻変動を示す複数の事実が判明した。

単なる業績報告ではない。

AnthropicはGoogleおよびBroadcomと新たな提携を結んだ。

2027年以降に稼働する数ギガワット規模の次世代TPU容量を確保したのだ。

これは単なるサーバー増設のレベルではない。

国家インフラに匹敵する電力と計算資源を、一企業が確保しようとしている。

背景には、顧客からの爆発的な需要がある。

年間100万ドル以上を消費する企業顧客が、わずか2ヶ月で500社から1000社へと倍増した。

次世代モデル「Mythos」の正体

なぜこれほどの計算資源が必要なのか。

その答えが、内部資料から判明した次世代モデル「Mythos」だ。

現在の最上位モデルであるOpusを遥かに凌駕する性能を持つ。

ソフトウェアコーディング、学術的推論、サイバーセキュリティのテストで、Claude Opus 4.6を大幅に上回るスコアを記録した。

だが、強烈な代償がある。

運用コストが極めて高いのだ。

提供する側にとっても、利用する側にとっても、かつてないほど高価なモデルになる。

そのため、サイバーセキュリティ評価を行う一部の早期アクセス顧客から、意図的にゆっくりとテスト展開されている。

AI投資の狂乱とツールの爆発

インフラ競争の裏で、投資マネーの動きも常軌を逸している。

2026年第1四半期だけで、世界のVC投資額は3000億ドルに達した。

その大半がAI関連だ。

基盤モデル企業が調達した資金は、そのまま計算資源やインフラの構築に消えていく。

一方で、AIを「使う」ためのツール層が爆発的な成長を見せている。

代表格がAIコーディングツールだ。

Cursorを開発するAnysphereの年間経常収益は、わずか3ヶ月で10億ドルから20億ドルへと倍増した。

Fortune 500企業の67%が導入済みというデータもある。

基盤モデル企業が巨額の赤字を垂れ流してインフラを構築する横で、ツール企業が猛烈なスピードで収益化を果たしている。

この歪な構造が、現在のAI業界のリアルだ。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

インフラ投資とMythosの密接な関係

Anthropicが2027年に向けて数ギガワットの電力を確保した理由は明確だ。

現在のインフラでは、次世代モデルをスケールさせられないからだ。

Mythosは圧倒的な推論能力を持つ。

複雑なアーキテクチャ設計や、高度なアルゴリズムの実装を自律的にこなす。

だが、AIの賢さは計算量に比例する。

モデルのパラメータ数が増え、推論時の計算コストが跳ね上がっているのだ。

売上が300億ドルに達しても、利益が出ているとは限らない。

むしろ、稼いだ端から次世代インフラへの投資に消えていくチキンレースだ。

コーディングツール市場の覇権争い

この巨額投資を正当化するには、絶対に手放せない市場がある。

それがソフトウェア開発の領域だ。

AIコーディングツールの急成長は、開発者の行動様式を完全に変えた。

「人間がコードを書き、AIが補助する」時代は終わった。

今は「AIがコードを生み、人間がレビューする」時代だ。

この主客逆転が、開発者の生産性を文字通り倍にしている。

基盤モデル企業は、このツール市場の覇権を狙っている。

自社の最強モデルをツールに組み込ませるか、あるいは自らツール企業を買収するか。

実際に、大手AI企業によるコーディングツールの買収劇も起きている。

開発環境という「開発者のデスクトップ」を誰が支配するかの戦争だ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

Claude Codeの進化と期待

AnthropicがMythosを投入すれば、この戦争のゲームチェンジになる。

特にCLIベースのAIツールとの相性は抜群だ。

僕は普段、Claude Codeを使ってSaaSを開発している。

ターミナルから直接AIに指示を出し、ファイル操作からテスト実行まで完結させる。

現在のモデルでも十分に強力だ。

Mythosの「コーディング能力の大幅向上」が統合されたらどうなるか、気になるところだ。

複数ファイルにまたがる大規模なリファクタリング。

複雑な依存関係を持つバグの自律的な特定と修正。

これらが、人間が介入することなくバックグラウンドで完了するようになる。

開発者は「設計」と「承認」のプロセスに専念することになる。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、Mythosの性能向上はめちゃくちゃ楽しみだ。

ただ、運用コストが高いってことはAPI料金も跳ね上がるはず。

今でもターミナルで思考ループに入られるとトークン消費がえぐいのに、これ以上高くなったら個人開発者のサイフが死ぬ。

モデルルーティングの必須化

次世代モデルの登場は、開発の現場に具体的な変化を要求する。

「とりあえず最新モデルを使えばいい」という牧歌的な時代は終わる。

圧倒的な性能と引き換えに、コスト管理が最大の課題になるからだ。

Mythosのような次世代モデルは、利用料金が非常に高額になる。

すべてのタスクを最上位モデルに投げれば、APIコストは一瞬で予算を食いつぶす。

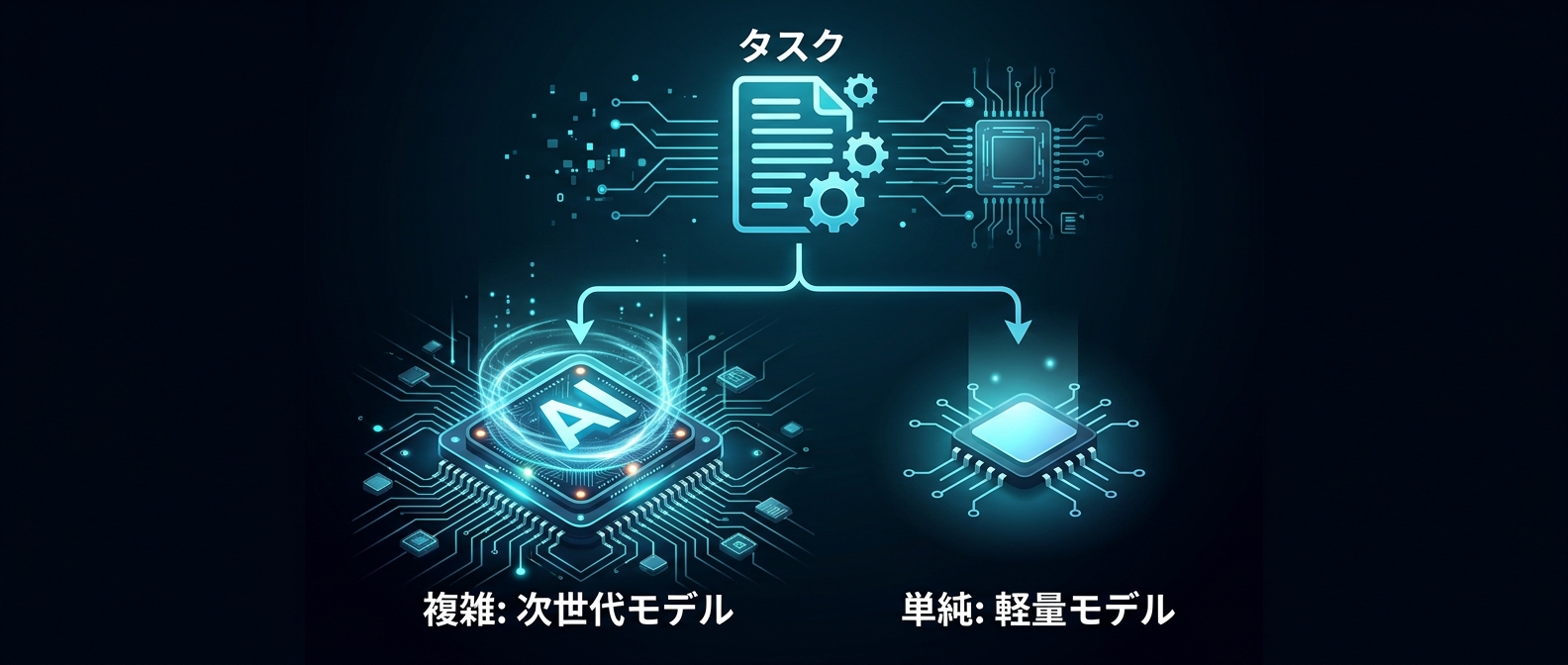

そこで必須になるのが「モデルルーティング」のスキルだ。

タスクの難易度に応じて、適切なAIモデルを動的に使い分ける設計思想である。

複雑な推論が必要なタスクには、高価な次世代モデルを割り当てる。

単純なテキスト処理や定型的なコード生成には、軽量で安価なモデルを使う。

この使い分けを、システム側で自動的に判断させる仕組みが必要だ。

開発者自身が、各モデルの「得意分野」と「コスト感」を正確に把握することになる。

設計の段階からコストを織り込む発想が、これからの開発スタイルになる。

プロンプトエンジニアリングの再定義

コストが高騰するということは、失敗した時のダメージも大きくなる。

曖昧な指示を出してAIに何度もやり直させるのは、文字通り「お金の無駄遣い」だ。

一度のプロンプトで、いかに正確な出力を引き出すか。

プロンプトエンジニアリングの重要性が、ここに来てさらに増している。

具体的な対策は以下の通りだ。

- コンテキストを明確に与える

- 制約条件を箇条書きで厳密に定義する

- 出力フォーマットを事前に指定する

- 必要な情報だけを渡し、無駄なトークンを削る

これらを徹底するだけで、コストを抑えつつ品質を担保できる。

タスクの細分化とパイプライン設計

AIに丸投げするのではなく、タスクを論理的に分割する設計力が問われる。

巨大な問題を一つのプロンプトで解決しようとすると、コストと精度の両方が犠牲になる。

開発プロセスを以下のように分解する。

- 要件定義とアーキテクチャ設計

- コンポーネントの分割

- 個別機能の実装

- 単体テストの作成と実行

それぞれの工程を切り離し、別々のAIタスクとして定義する。

設計フェーズだけ最上位モデルを使い、実装フェーズは軽量モデルを並列稼働させる。

このようなパイプラインを構築できる開発者が、AIを道具として使いこなす側に回る。

AIは万能の魔法ではなく、適切に管理すべき強力なコンポーネントだ。

しんたろー:

うちのSaaSの構成だと、ユーザーの入力解析に一番コストがかかってる。

これを全部Mythosに置き換えるのは現実的じゃないな。

むしろ、裏側のバッチ処理を軽量モデルに移行して、浮いた予算を開発用のClaude Codeに回すのが賢い気がする。

実務で役立つFAQ

Q1: Anthropicの次世代モデル「Mythos」はいつから使えますか?

現在、サイバーセキュリティの評価を行う一部の早期アクセス顧客向けにテストが開始されている段階だ。

運用コストが非常に高く、またサイバーセキュリティ上の懸念から、意図的にゆっくりとしたリリース計画が立てられている。

Anthropicはまず一般公開前にモデルの効率化を進める方針を示しており、広くAPI経由で利用できるようになるまでには時間がかかる見込みだ。

Q2: 次世代モデルのAPI利用料金はどうなりますか?

リークされた内部文書によると、Mythosは「提供する側にとっても、顧客が使用する側にとっても非常に高価になる」とされている。

具体的な料金は未発表だが、現在の最上位モデルよりも高額な価格設定になる。

そのため、実務では複雑な推論やコーディングには次世代モデルを、単純なタスクには軽量モデルを使い分ける設計が現実的な選択肢になる。

Q3: AIコーディングツールと次世代モデルはどのように連携していくと考えられますか?

AIエディタは、背後で複数の強力なLLMを呼び出してコードを生成している。

次世代モデルがAPIとして提供されれば、これらのツールに組み込まれ、より高度なコード生成やデバッグが可能になる。

ツールと基盤モデルの統合が進む一方で、開発者は好みのエディタと最適なモデルを組み合わせて使うエコシステムが続くと予想される。

まとめ

AIの進化は止まらないが、タダで使える魔法でもない。

圧倒的な性能を手に入れるためには、コストと効率のシビアな計算が必要だ。

しんたろー:

結局、AIの性能が上がっても「どう使うか」を考える人間の仕事は減らない。

むしろ、モデルの使い分けとかプロンプトの最適化とか、泥臭いチューニングの重要性が増してるのが面白い。

次世代AIモデルの高コスト化を見据え、効率的なプロンプト設計とモデルの使い分け戦略をThreadPostで議論しよう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤