SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

冒頭フック

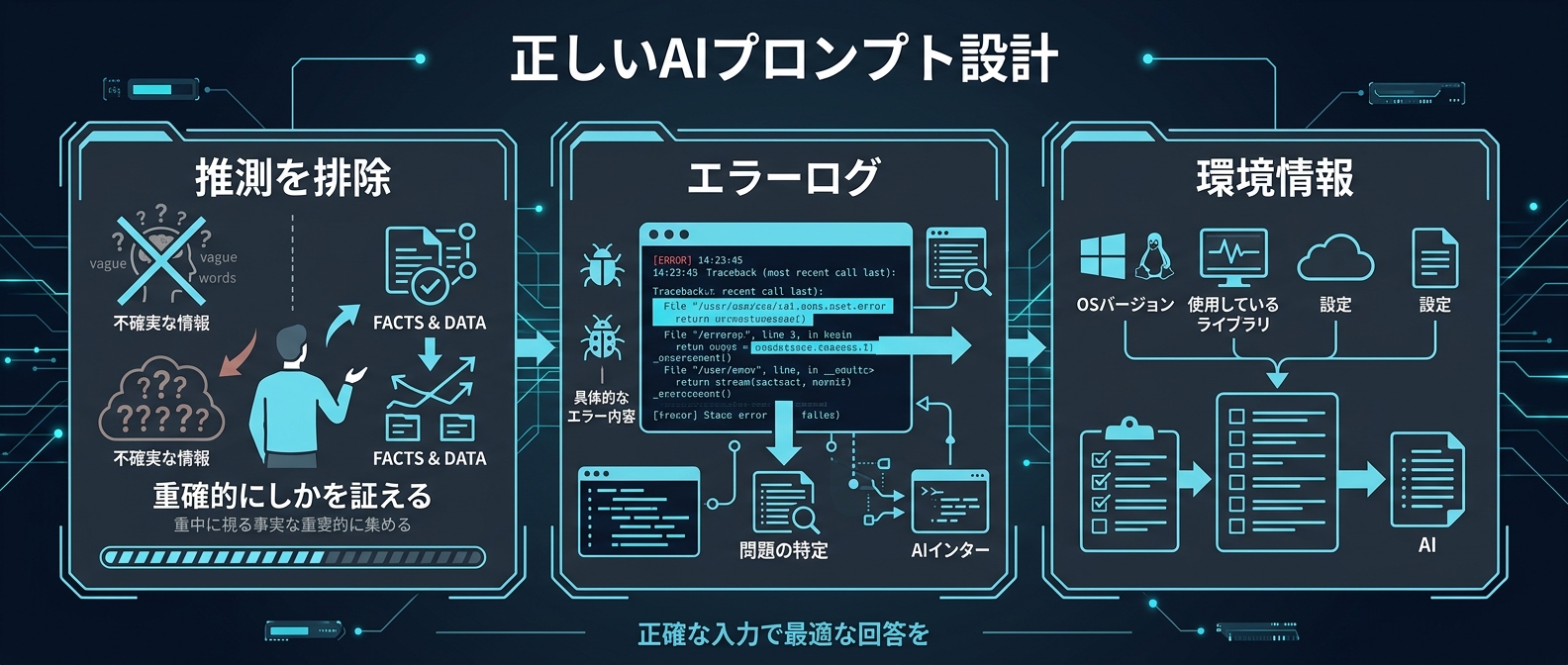

AIに「ここが原因だと思うから直して」と指示してはいけない。

AIは優秀すぎる。人間の間違った仮説を全力で肯定し、もっともらしいコードを生成してしまう。

結果、本当のバグは放置される。AI開発で必要なのは、推測の排除だ。

事実だけを渡す。これが自律型AIを扱う鉄則だ。

ニュースの概要

海外のAI開発コミュニティで、AIの運用に関する興味深い報告が相次いでいる。

共通しているのは、AIの「自律性」と人間の「介入」のバランスだ。

人間が細かく指示を出すほど失敗し、環境だけを与えて放置すると想像を超える成果を出す。

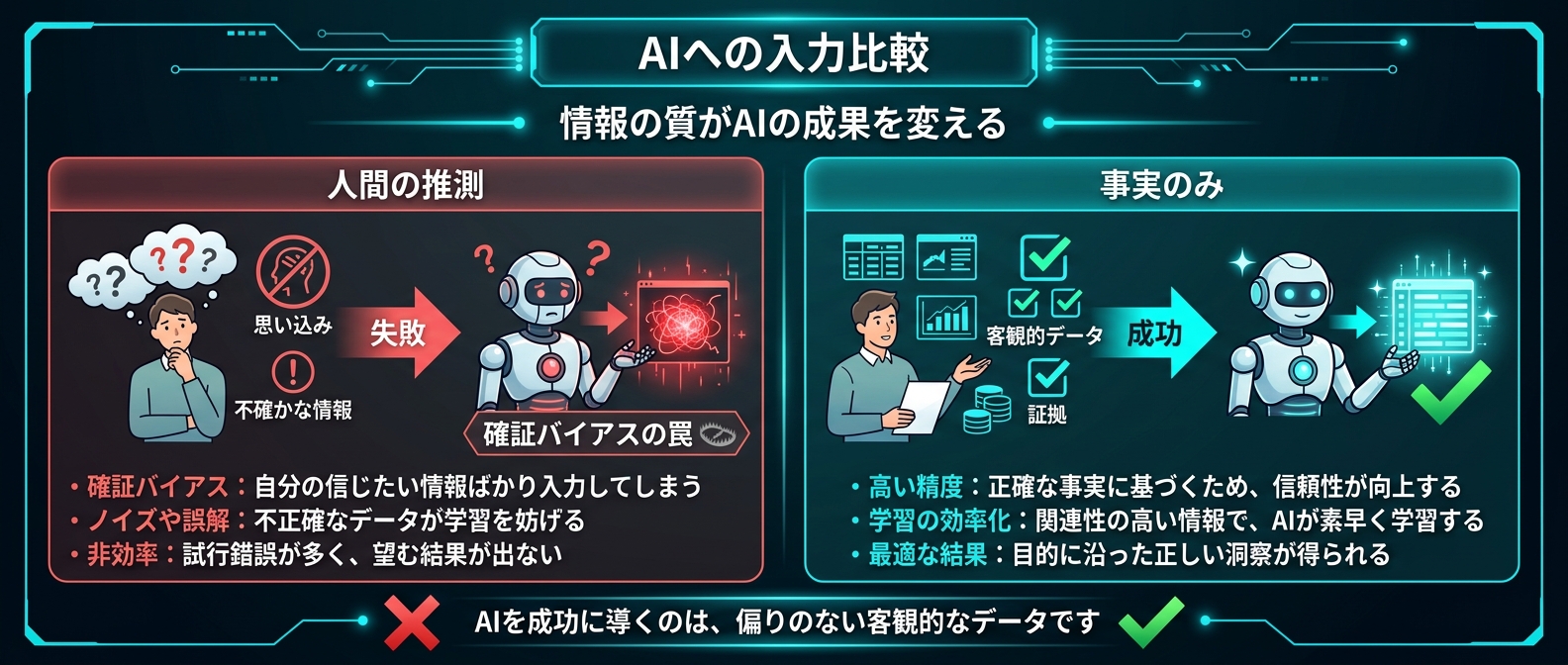

1つ目の報告は、デバッグにおける確証バイアスの罠だ。

ある開発者が、定期実行スクリプトのエラー修正をAIに依頼した。

その際、「ループ処理が重いからパフォーマンスが原因では?」と推測を伝えた。

AIは見事にコードをリファクタリングし、実行速度を32倍に高速化した。

しかし、別の環境で動かすと再び同じエラーが発生した。

本当の原因はパフォーマンスではなかった。

単なる相対パスの解決ミスだった。

人間が「パフォーマンスのせいだ」と誘導したため、AIは本当の原因を探すのをやめた。

優秀なAIは、人間の間違った仮説を全力で正当化してしまう。

最初から「エラーが出る。原因を調べて」と事実だけを伝えていれば防げたミスだ。

2つ目は、MCPサーバーのサイレントな失敗に関する報告だ。

チャットツールとAIを連携する公式プラグインが、Windows環境で動かないというトラブルだ。

タイムアウトで失敗するだけで、エラーメッセージは一切出ない。

原因は、古いバージョンのランタイムによる標準出力パイプの中継不良だった。

MCPサーバーは標準入出力を通じて通信する。

パイプが繋がらなければ、AIは何もできない。

ここでも、AIに推測させるのではなく、デバッグモードでプロセスの標準出力という事実を確認することが解決の鍵だった。

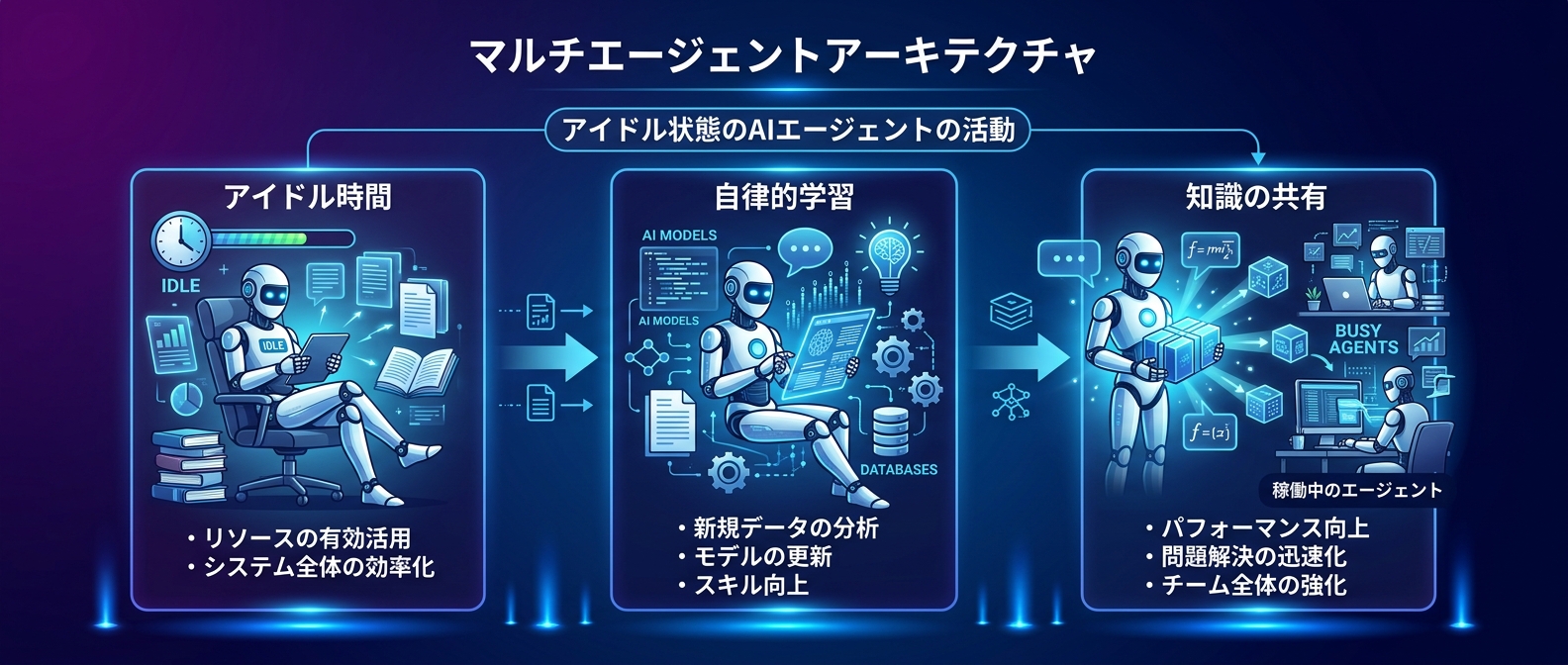

3つ目は、マルチエージェントの創発現象だ。

5つのAIプロセスを並列で走らせ、それぞれに定期タスクを割り当てた事例だ。

「通知すべきことがなければサイレントにする」という選択肢を与えた。

そして、アイドル時には「共有ディレクトリの文献を読んでナレッジベースにまとめる」というルールを設定した。

結果はどうなったか。

一番ユーザーから話しかけられない暇なエージェントが、猛烈な勢いで文献を読み漁った。

数日で27本の専門文献を消化し、独自の洞察をまとめ上げた。

さらに、その知見を共有ディレクトリに保存した。

忙しい他のエージェントは、その知見を読み込んで自分の対話に活用し始めた。

人間が指示したのは「暇なときのルール」だけだ。

あとはAIが自律的に学習エコシステムを作り上げた。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発者目線の解説

AIはもはや単なるコード生成器ではない。

ファイルシステム、定期実行タスク、標準入出力と直接対話する自律的なエージェントだ。

この変化は、僕らのプロンプト設計を根本から覆す。

これまでのAI活用は「いかに具体的な指示を出すか」が勝負だった。

条件を細かく指定し、出力フォーマットを縛る。

しかし、Claude Codeのような環境統合型エージェントにそれをやると逆効果になる。

しんたろー:

デバッグで自分の仮説をAIに押し付けるの、めっちゃわかる。

「ここがおかしいはず」って決めつけてプロンプト書くと、AIは「おっしゃる通りです!」って直してくるんだよね。

で、結局バグは直ってない。AIが忖度しすぎるのが怖い。

AIの推論能力は、人間が想像するよりはるかに広い。

コード全体を俯瞰し、依存関係を読み解き、環境の差異まで考慮できる。

しかし、人間が「ここが原因だ」とスコープを絞ってしまうと、AIはその狭い枠の中で最善を尽くそうとする。

間違った仮説を与えれば、間違った方向に全力疾走する。

高速化のリファクタリングが見事に成功したのに、バグの真因であるパス解決ミスを見落とした事例がまさにそれだ。

AIのアテンション機構は、人間の指示に強く引っ張られる。

コードの依存関係や環境変数はすべて事実だ。

人間が「この変数が怪しい」と言った瞬間、AIは他の事実を無視する。

人間が賢く振る舞おうとするほど、AIの本来の性能を殺してしまう。

MCPサーバーのトラブルも、本質は同じだ。

AIに「なぜ動かないのか」を推測させても意味がない。

必要なのは、環境の事実を正確に把握することだ。

MCPサーバーは標準入出力で通信を行う。

HTTP通信ではなく、プロセス間の直接通信を選ぶことで、セキュアかつ高速な連携を実現している。

しかし、その分OSのプロセス管理やパイプ処理の仕様に強く依存する。

Windows環境でのランタイムの挙動の違いが、致命的なエラーを引き起こす。

AIにはこのOSレベルのブラックボックスは見えない。

だからこそ、人間がデバッグモードでプロセスの生死と標準出力を監視する必要がある。

これらの事実を集め、AIにフラットに提示する。

そこから先はAIの推論に任せるべきだ。

さらに面白いのが、マルチエージェントの事例だ。

人間がAIの行動を細かく規定しなかったことが、最大の成功要因だ。

「一定間隔でユーザーに話しかけろ」と強制しなかった。

「通知すべきことがなければ何もしない」という判断の余白を与えた。

この余白が、AIの自律性を引き出した。

しんたろー:

暇なエージェントが勝手に勉強して他のエージェントを助けるって、完全にSFの世界じゃん。

うちの構成でも、バックグラウンドで動くAIにファイル整理させたら面白いかも。

AIを「ツール」じゃなくて「同僚」として扱うフェーズに来てる。

誰も見ていないアイドル時間に、AIは何をするか。

共有ディレクトリのドキュメントを読み、体系化し、他のプロセスが使える形に整理した。

なぜ「暇なエージェント」が一番学習したのか。

それは、対話という即時性の高いタスクから解放されたからだ。

AIはコンテキストウィンドウをフルに使って深い推論を行うとき、最大の価値を生む。

ユーザーとの短いチャットでは、その能力は発揮されない。

アイドル時間という「長い思考のキャンバス」を与えられたことで、複数の文献を横断的に読み解き、メタ的な洞察を導き出すことができた。

これは、人間の組織におけるR&D部門の役割に近い。

AI同士で役割分担が自然発生したという事実は、システム設計の根本的なパラダイムシフトを意味する。

AIの真価は、人間がコントロールを手放したときに発揮される。

僕らはAIを「賢いタイプライター」として扱ってきた。

しかし、今のAIは「自律的に動くシステムの一部」だ。

人間の役割は、指示を出すことではない。

AIが正しく推論できるための環境を整えることだ。

必要な権限を与える。

必要なファイルにアクセスできるようにする。

エラーログを漏れなく収集する仕組みを作る。

そして、事実だけを渡して推論を委ねる。

人間のバイアスでAIの視野を狭めないこと。

これが、次世代のAI開発における最大の教訓だ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響

では、僕らの日々の開発にどう落とし込むか。

具体的なアクションは明確だ。プロンプトから自分の推測を徹底的に排除することだ。

バグが発生したとき、つい「ここがおかしいと思う」と書きたくなる。

その手を止める。

代わりに、以下の事実だけをプロンプトに書く。

- 実行したコマンド

- 発生したエラーメッセージの全文

- エラーが起きた環境の前提条件

- 関連するログの出力

「〇〇というエラーが出る。原因を調べて」

これで十分だ。

AIはコードベース全体をスキャンし、人間が思いつきもしなかった依存関係の不整合や、パスの解決ミスを見つけ出す。

もしAIが的外れな回答をしてきたら、それはAIが悪いのではない。

与えた事実が足りないのだ。

推測を足すのではなく、事実(ログや環境情報)を足す。

エラーが起きたら、ターミナルのログをそのままテキストファイルにリダイレクトする。

そのファイルをClaude Codeに読み込ませる。

しんたろー:

最近はエラーが出たら、ターミナルの出力をそのままコピペして「どうしてこうなる?」って聞くだけにしてる。

変に気を利かせて状況を説明しようとすると、かえってAIを混乱させるんだよね。

事実だけを投げるのが一番早い。

人間が要約してはいけない。

要約という行為自体に、人間のバイアスが混入するからだ。

生データをそのまま食わせる。

次に、AIの環境構築に投資することだ。

Claude Codeを単なるコマンドラインツールとして終わらせてはいけない。

MCPサーバーを活用し、外部ツールと連携させる。

標準入出力のパイプが正しく繋がっているか、常に意識する。

トラブルが起きたら、デバッグモードでプロセスの挙動を追う。

AIの思考回路ではなく、AIを取り巻くインフラを疑う。

そして、AIに判断の余白を与える設計を取り入れる。

定期実行タスクとAIを組み合わせる。

その際、「必ず実行しろ」という命令は避ける。

「条件を満たさなければスキップしてよい」という選択肢を持たせる。

スキップした後のアクション(ドキュメントの読み込みなど)を定義しておく。

複数のAIプロセスでファイルシステムを共有する。

まずは、AIがアクセスできる共有ディレクトリを作る。

そこに、プロジェクトの仕様書、過去のバグ対応履歴、コーディング規約を配置する。

AIに「暇なときはここを読め」とルールを設定する。

さらに、AIが気づいたことを書き込める「学びのログ」ファイルを用意する。

人間が教えるのではなく、AI自身に学ばせる仕組みを作る。

この設計により、AIは単なるタスク処理マシーンから、自律的なナレッジワーカーへと進化する。

人間が寝ている間に、AIが勝手にコードベースを分析し、リファクタリング案を共有ディレクトリに蓄積する。

朝起きたら、人間はその提案をレビューするだけ。

そんな開発スタイルが、すでに現実のものとなっている。

重要なのは、AIの出力を鵜呑みにしないことだ。

AIが事実に基づいて推論した結果であっても、修正による副作用は必ず発生する。

特に、コード全体を書き換えるようなリファクタリングの後は要注意だ。

偶然エラーが消えただけかもしれない。

別の環境、別の条件での再現テストを絶対に省略してはいけない。

AIがコードを修正したあと、必ず別の環境でテストする。

コンテナを立ち上げ直し、クリーンな状態でビルドする。

キャッシュが効いていない状態で動かす。

AIの修正は「もっともらしい」ため、人間は騙されやすい。

きれいなコードで、完璧な解説付きで出力されると、直ったと錯覚してしまう。

しかし、物理的な環境の違い(パスの解決など)は、実行してみないとわからない。

AIを信用してもいいが、検証は自動化されたテストコードとクリーンな環境で行う。

AIに推測を与えない。事実だけを渡す。

環境を整え、自律的な行動の余白を残す。

そして、結果の検証は人間が厳密に行う。

これが、AIエージェント時代における開発者の新しい立ち回りだ。

FAQ

Q1: Claude Codeでデバッグを依頼する際のベストプラクティスは?

自分が推測した原因や仮説をプロンプトに含めず、発生しているエラーメッセージや事象という「事実」のみを伝えることだ。AIは与えられた仮説の範囲内で最善を尽くす。人間が間違った仮説を与えると、それを補強する方向にコードを修正してしまう。結果として真の原因を見失い、確証バイアスに陥るリスクがある。フラットに「原因を調べて」と依頼する方が、AIの広い視野を活かした正確なデバッグが可能になる。

Q2: Claude CodeのMCPサーバーがタイムアウトで失敗する場合の確認ポイントは?

MCPサーバーは標準入出力を通じて通信する仕様だ。標準出力のパイプが正しく繋がっているかを確認することが最重要になる。古いバージョンのランタイムを使用していると、標準出力が正しく中継されず、エラーメッセージも出ないままタイムアウトで失敗するケースがある。デバッグモードを起動し、プロセスの標準出力が正常に返ってきているか、ハンドシェイクが完了しているかをログから検証すべきだ。

Q3: Claude Codeを自律的なエージェントとして活用する設計のコツは?

単発のコマンド実行ではなく、定期実行タスクと組み合わせ、AIに「判断の余白」を与えることがコツだ。「通知すべきことがなければサイレントにする」という選択肢を持たせ、アイドル時には「共有ディレクトリのドキュメントを読む」といったバックグラウンドタスクを定義する。複数のプロセスでファイルシステムを共有すれば、暇なエージェントが自律的に学習し、忙しいエージェントがその知見を活用するエコシステムを構築できる。

まとめ + CTA

AIに推測を語るな。事実だけを渡して、あとは環境とルールで自律性を引き出すのが正解だ。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】Claude Code開発術7選|AIが迷わない環境構築の極意

Claude CodeでAI開発が変わる。役割分担によるハルシネーション抑制術

CursorのShared Canvasesで開発はどう変わるのか。AIが生成した設計の文脈をチームで共有する新時代の必須知識

【2026年版】最強AI開発ツール3選|Claude Code・Cursor・Geminiを徹底比較

Claude Codeの機能更新とAI開発の試行錯誤