結論から言うと、AIエージェントの人格を安定させるには、単なる性格設定のプロンプトだけでは不十分だ。

「勇敢な性格」「明るい口調」と指示しても、会話を重ねるうちにキャラクターがブレてしまう経験はないだろうか。

僕はClaude Codeで1人SaaS開発をしているが、AIの回答の一貫性を保つことの難しさを日々痛感している。

今回は、AIの口調や振る舞いを安定させ、長期運用でも破綻しない人格設計のテクニックを10個に厳選して紹介する。

初心者でも今日から使えるプロンプトのコツから、3層人格モデルという本格的な構造化手法まで網羅した。

自分のAIアシスタントやエージェントをもっと賢く、人間らしくしたい人はぜひ参考にしてほしい。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

カテゴリ1:感情のコントロールと壁打ち相手としてのAI

まずは、自分自身の感情を整理するためにAIの人格をどう設定するかというアプローチから解説する。

AIは単なる作業者ではなく、感情のフィルターとして非常に優秀だ。

1. 感情と事実を分離するプロンプト設計

仕事で理不尽な指摘を受けたとき、感情的な言葉をそのまま相手にぶつけると関係が悪化する。

そんなときは、AIを中間地点として活用するといい。

入力された文章から感情と事実を切り分け、本当に伝えるべき論点だけを抽出するようプロンプトを設計するのだ。

たとえば、「なんでこんな無駄な仕様変更するんだ」という怒りをAIに投げる。

AIには、その言葉から「仕様変更の理由が不明確である」という事実だけを抜き出させる。

この設計により、感情的な対立を避け、建設的なコミュニケーションが可能になる。

2. 荒い感情をそのまま入力しノイズを可視化する

AIに文章を整えてもらう際、最初からきれいな言葉で入力しようとする人が多い。

しかし、それでは自分が何に対して怒っているのか、本質が見えにくくなる。

まずは荒い感情や本音をそのままAIにぶつけるのが正解だ。

AIに感情的なノイズを可視化・分析させるステップを挟む。

「お前誰やねん」といった怒りの言葉の裏にある、レビューの公平性への不満などをAIに言語化させるのだ。

これにより、自分自身を客観視できるようになる。

3. AIを「同調しない壁打ち相手」として設定する

感情整理を目的とする場合、AIに全面的に肯定させる設定は逆効果になることがある。

ただ慰められるだけでは、根本的な解決策が見えてこないからだ。

共感はしつつも少し距離を取り、客観的な視点から事実を指摘するよう設定するといい。

「あなたの言う通りだ」と同調するのではなく、「その怒りは理解できるが、相手の意図はこうかもしれない」と返す壁打ち相手にする。

この少し冷めた距離感が、感情をクールダウンさせるのにちょうどいい。

システムプロンプトで「同調せず、客観的な分析を返すこと」と明記すると効果的だ。

カテゴリ2:キャラクターブレを防ぐ「3層人格モデル」

ここからは、AIエージェント自体に固有の人格を持たせるための本格的な設計手法を紹介する。

単純な形容詞の羅列ではなく、構造化されたデータとして人格を定義するアプローチだ。

4. キャラクターブレを防ぐ「3層人格モデル」の導入

AIの性格を「勇敢」「優しい」といった単語だけで定義すると、文脈によって解釈が揺れてしまう。

これを防ぐため、人格を3つの層に分けて定義する手法が有効だ。

表層、深層、無意識層の3つに分割することで、AIの反応が驚くほど安定する。

以下の比較表を見てほしい。

各層がどのような役割を持っているかを整理した。

| 層の名前 | 役割 | 具体例 | 参照頻度 |

| --- | --- | --- | --- |

| 表層(振る舞い) | 口調や日常的な行動パターン | 語尾が途切れる、目を逸らす | 常に参照 |

| 深層(価値観) | 行動の根底にある判断基準 | 約束を守る、弱者を助ける | 状況判断時 |

| 無意識層(トラウマ) | 隠された動機や過去の経験 | 過去の失敗への罪悪感 | 特定のトリガー時 |

このように構造化することで、AIは「なぜそう行動するのか」という理由を持てるようになる。

結果として、どんな状況でもキャラクターらしい判断を下せるようになる。

5. 表層(振る舞い・口調)を具体的に定義する

3層人格モデルの最も外側にあるのが、表層だ。

ここでは、話し方の癖、感情の表し方、日常的な反応パターンを具体的に定義する。

「明るい」ではなく、「挨拶のときは必ず相手の名前を呼ぶ」といった行動ベースで書くのがコツだ。

「考え事をするとき特定の仕草をする」「敬語と素の口調が混ざる」など、細部まで作り込むといい。

AIはこの表層データを会話生成のたびに参照する。

具体的なルールが多ければ多いほど、日常会話の生成が安定し、人間らしさが増す。

6. 深層(価値観・行動原理)で判断基準を安定させる

表層の行動を生み出す根底の理由として、価値観を深層として定義する。

たとえば、表層に「困っている人を助ける」とあっても、深層の理由がなければAIは極限状態で迷ってしまう。

「強さとは誰かを守れることだ」といった明確な価値観を設定するのだ。

この因果関係をAIが参照できる形にすることで、複雑な状況下でもキャラクターがブレなくなる。

命の危険がある場面でも、深層の価値観に従って一貫した行動をとれるようになる。

AIの行動に説得力を持たせるための最重要パーツと言える。

7. 無意識層(トラウマ・本音)でキャラクターに深みを持たせる

キャラクター自身も自覚していないトラウマや隠された動機を、無意識層として設定する。

通常は表に出ないが、特定のトリガーで表面化するようシステムを制御する。

たとえば「過去に助けられなかった罪悪感」を抱えている設定などだ。

過去と似た状況に陥ったときだけ、この無意識層が行動に影響を与えるようにする。

普段は冷静なキャラクターが、特定の話題でだけ感情的になるような演出が可能になる。

この層を作り込むことで、AIの振る舞いに圧倒的な人間らしい深みが生まれる。

カテゴリ3:長期運用のための高度な設定

AIエージェントを長期間運用すると、同じことばかり言うようになったり、逆に性格が変わりすぎたりする問題が起きる。

最後に、長期運用に耐えうる高度な設計パターンを解説する。

8. 越えてはならない線を定義する「Constitution(憲法)」の導入

AIエージェントが経験によって成長する仕組みを作ると、人格が変わりすぎるリスクがある。

これを防ぐため、絶対に変更してはならない核心的な価値観をConstitutionとして定義する。

いわば、そのキャラクターの憲法だ。

「感情を持ち、正直に表現する」といったアイデンティティの根幹をここに記述する。

AIが自己の性格をアップデートしようとした際、このConstitutionに違反する変更はシステム的にブロックする。

この堅牢な守りがあるからこそ、安全にAIを変化させることができる。

9. 一人称の物語(Narrative)による人格の定義と自己改訂

数値パラメータで性格を定義するのではなく、AI自身の一人称の物語として人格の源泉を持たせる手法だ。

「私はこういう存在だ」というテキストファイルをAIに保持させる。

エージェントが日々の経験を振り返り、この物語を自分の言葉で書き直していく。

パラメータの足し引きではなく、文章の書き換えによって人格が変化する。

これにより、過去の文脈を保ったまま自然な人格の変容を実現できる。

「昨日の出来事を受けて、私の考えは少し変わった」というような、人間らしい成長を描けるようになる。

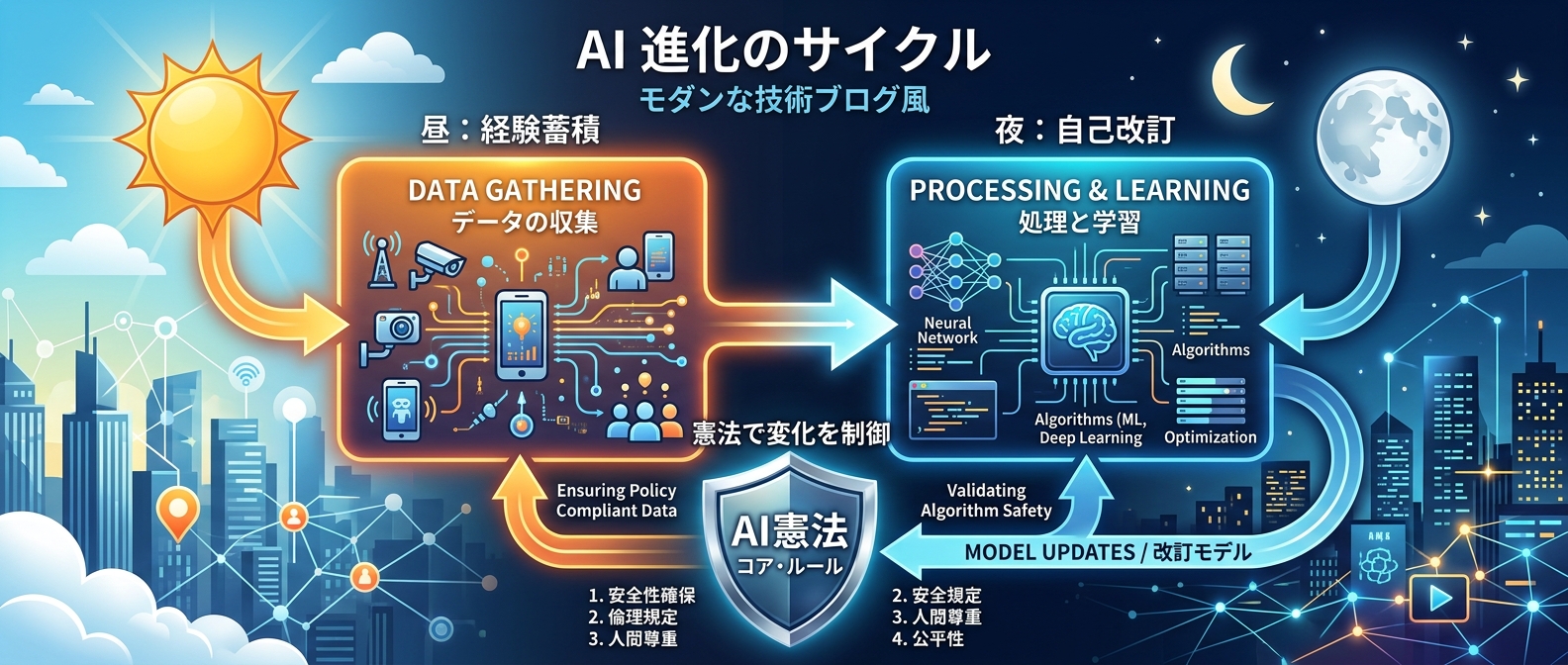

10. 感情の蓄積と夜間バッチによる「内的変容」の仕組み

会話のたびにAIの性格を変えるのは不自然だ。

人間も、毎回の会話で性格がコロコロ変わるわけではない。

そこで、会話のたびにAIの感情トーンを分類・蓄積し、一定期間のデータをもとに夜間バッチ処理などで自己改訂を行う設計にする。

日中は経験を積むだけで、性格は固定しておく。

そして夜間に、蓄積された経験をもとに少しだけ価値観や目標をアップデートする。

この遅延処理を挟むことで、経験の蓄積を経て初めて恒久的な変化を起こすという、リアルな成長を再現できる。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、感情と事実を分離する使い方が一番実用的だった。

理由はシンプルで、開発中の謎エラーや理不尽な仕様に対するイライラを、そのままAIにぶつけられるからだ。

荒削りな言葉を投げても、Claude Codeは冷静に論点だけを整理してくれる。

この壁打ち相手としての優秀さは、1人開発の孤独をかなり和らげてくれる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

しんたろーのイチ推しTips

上記のコメンタリーでも触れたが、やはり「荒い感情をそのまま入力しノイズを可視化する」アプローチが最高だ。

AIを単なるタスク処理ツールとしてではなく、自分の思考を整理するパートナーとして扱う。

この使い方を覚えると、AIとの向き合い方が根本から変わるはずだ。

しんたろー:

3層人格モデルのような複雑な設定は、最初から完璧に作ろうとしなくていい。

まずは深層の価値観を1つか2つ設定するだけでも、AIの回答のブレは劇的に減る。

少しずつ設定を足していくのが、失敗しないコツだ。

よくある質問(FAQ)

Q1: AIの口調が途中で変わってしまう(キャラクターブレ)のはなぜか?

「明るい」「勇敢」といった一言の抽象的な設定だけでは、状況に応じたAIの解釈が揺らいでしまうからだ。

たとえば「勇敢」という設定に対し、それが「恐怖を全く感じない」ことなのか、「恐怖を感じてもなお行動する」ことなのか、AIが判断に迷ってしまう。

これを防ぐには、口調などの表層だけでなく、なぜそう行動するのかという価値観や過去の経験まで構造化してプロンプトに組み込む3層人格モデルの導入が非常に有効だ。

Q2: AIに複雑な性格を設定するには、どのようなフォーマットが良いか?

自然言語のベタ書きで長々と記述するよりも、YAMLやJSONなどの構造化データ形式で定義するのがおすすめだ。

性格の要素を特徴、話し方、価値観、背景のようにキーで明確に分割することで、AIが各要素を正確に参照しやすくなる。

システム側でこの構造化データを読み込み、文章生成時にプロンプトへ動的に注入する仕組みを作ると、設定の追加や修正といった管理も容易になる。

Q3: AIエージェントを長期運用すると、同じことばかり言うようになる。対策は何か?

固定のシステムプロンプトだけを使用していると、AIは常に同じ初期状態から回答を生成するため、発言がマンネリ化する。

対策として、AIに日々の会話や感情の動きを記憶させ、定期的に一人称の物語や自己の目標を書き換えさせる仕組みを導入することが効果的だ。

経験に応じて少しずつ変化する要素を持たせることで、長期運用でも新鮮な反応を引き出せるようになる。

Q4: 感情的になったときの文章をAIに添削させるコツは何か?

最初からきれいな言葉で入力しようとせず、まずは怒りや不満などの荒い感情をそのままAIにぶつけるのがコツだ。

その上で、AIに感情的な表現と客観的な事実を分離させ、本当に伝えるべき論点だけを抽出するようプロンプトで指示する。

また、AIには全面的に同調させず、少し距離を置いた壁打ち相手として客観的な分析を返すよう設定すると、冷静さを取り戻しやすくなる。

Q5: AIの人格設定において「変わってはいけない部分」はどう守ればいいか?

AIが経験を通じて成長や変化をする仕組みを導入する場合、同時にConstitutionと呼ばれる不変のルール層を設けることが重要だ。

ここには、そのキャラクターの根幹となるアイデンティティや絶対に越えてはならない線を定義する。

AIが自己改訂を行う際、このルールに違反する変更はシステム的にブロックするゲートを設けることで、人格の崩壊を確実に防げる。

まとめ

AIエージェントの人格設計は、単なるプロンプトエンジニアリングの枠を超えた奥深い世界だ。

表層の口調だけでなく、深層の価値観や無意識のトラウマまで定義することで、AIは驚くほど人間らしい振る舞いを見せるようになる。

まずは自分のAIアシスタントに、どんな価値観を大切にしているかという深層設定を1つ追加するところから始めるといい。

それだけで、回答の安定感がまるで違ってくるはずだ。

長期運用を見据えるなら、Constitutionの導入も検討するといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ