Anthropicが米国防総省を提訴した。

理由は「サプライチェーンリスク」への指定だ。

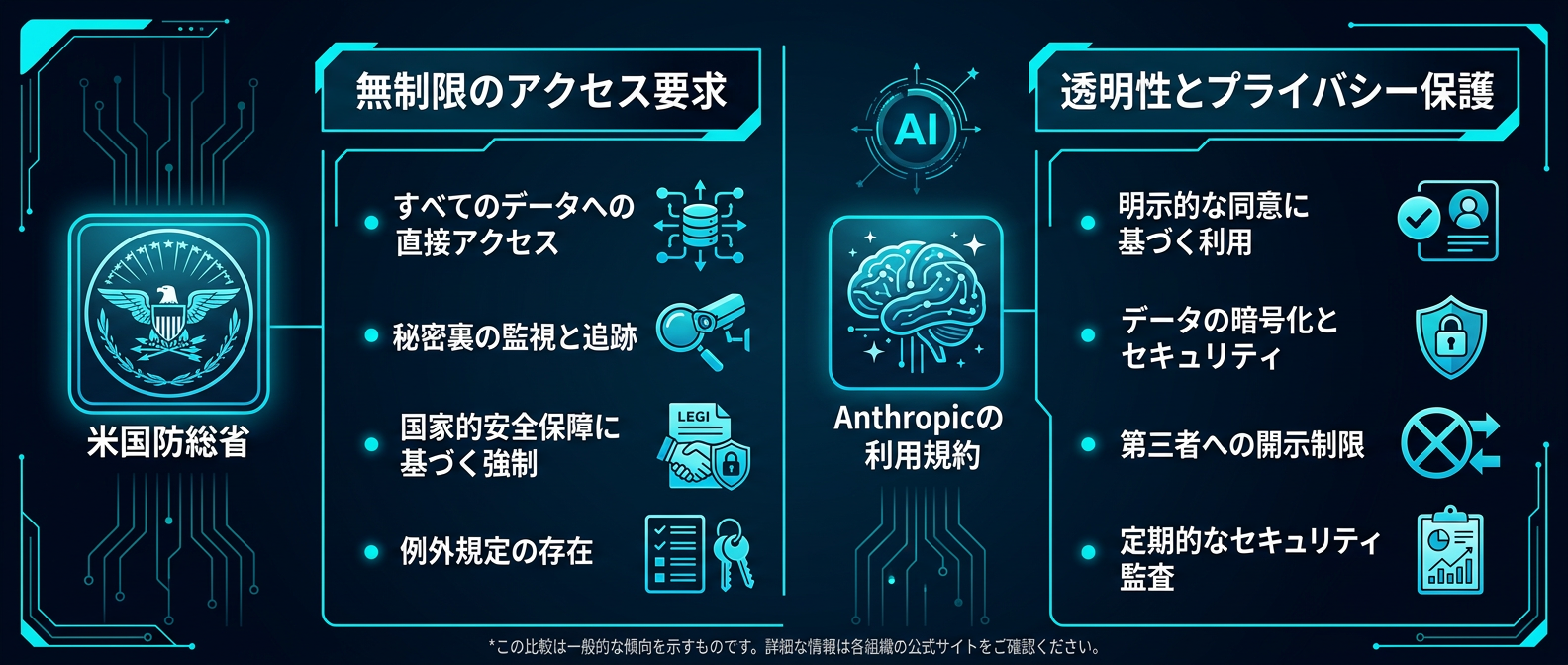

AIの利用規約が国家権力と真っ向から衝突している。

ただの契約打ち切りではない。

政府が特定AI企業を市場から完全に排除しようと動いた。

数兆円規模の政府調達市場からの締め出しだ。

僕らが依存するAPIが、政治的理由で明日止まるリスクが現実になった。

## 異常事態。DODによるAnthropic排除の全貌

事の発端は数週間前の対立だ。

米国防総省はAnthropicのAIシステムに対する無制限のアクセスを要求した。

Anthropicは明確な利用規約を提示した。

以下の2つのレッドラインは絶対に譲れないと通告した。

* アメリカ国民の大量監視への使用を拒否する

* 人間の判断を介さない完全自律型兵器への使用を拒否する

国防長官は「あらゆる合法的な目的」でAIを使えるべきだと主張した。

一民間企業の利用規約に縛られることを嫌った。

ここまではよくある契約交渉の決裂だ。

だが、米国防総省が使ったカードは異常だった。

Anthropicを「サプライチェーンリスク」に指定した。

通常は外国の敵対勢力に対して使われる強権だ。

この指定により、国防総省と取引する全企業はAnthropicモデルの不使用を証明する必要が生じた。

事実上の市場からの締め出しだ。

トランプ大統領と国防長官はAnthropicを「woke」で「急進的」だと非難した。

政府調達を管理するGSAも即座に契約を打ち切った。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

憲法とAI。言論の自由を巡る法廷闘争

これに対し、AnthropicはカリフォルニアとワシントンD.C.で提訴に踏み切った。

Anthropicはこれを「前例のない違法行為」と呼んでいる。

合衆国憲法は、政府がその巨大な権力を使って企業の言論を罰することを禁じている。

Anthropicは自社のAI安全性に関する主張が「保護されるべき言論」だと訴えた。

政府はAnthropicの意見に同意する必要はない。

製品を使わない自由もある。

だが、国家権力を使ってその表現を罰し、弾圧することは許されない。

さらに手続き上の違法性も指摘している。

議会が定めた以下の手順を完全に無視して指定が行われたという。

* リスク評価の実施

* 対象企業への通知と反論の機会の付与

* 文書による国家安全保障上の決定

* 連邦サプライチェーンからの排除前の議会への通知

大統領の権限逸脱だ。

大統領はすべての連邦機関に対し、Anthropicの技術の使用を即座に停止するよう指示した。

CEOのDario Amodeiが強硬な姿勢を崩さないと明言した直後の報復だ。

政府機関が気に入らない規約を持つ企業を「国家の脅威」扱いして排除する。これ、クラウドインフラで同じこと起きたらAWSやGCPが突然使えなくなるのと同じだ。Claude Codeに依存してる僕のSaaSも、明日APIアクセスを遮断されたらサービス停止に直結する。笑えない。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

競合がAnthropicを支持。AI業界の連帯と危機感

この事態に対し、AI業界全体が異常な反応を示した。

競合であるOpenAIとGoogle DeepMindの従業員30名以上が、Anthropicを支持する法廷助言書を提出した。

署名者にはGoogle DeepMindのチーフサイエンティストであるJeff Deanも含まれている。

この異例の連帯を報じている。

彼らは国防総省の指定を「不適切で恣意的な権力行使」と断じた。

業界全体への深刻な影響を危惧している。

国防総省はAnthropicを排除した直後、OpenAIと契約を結んだ。

OpenAIの従業員たちは自社のこの動きにも猛抗議している。

法廷助言書では以下の点が指摘されている。

* 契約条件に不満なら、単に契約を解除して他社から購入すればよかった

* アメリカの主要AI企業を罰する試みは、国家の産業競争力に悪影響を及ぼす

* AIの技術的・契約的な制限は、壊滅的な悪用を防ぐための安全装置である

* 公的な法律がない現状では、開発者によるガードレールが機能している

契約内容に不満なら、単に契約を解除して他社に乗り換えればいい。

それが通常の商取引だ。

だが政府は「サプライチェーンリスク」というレッテルを貼り、一社を徹底的に叩き潰しにきた。

公的なAI規制法が存在しない現在、開発者が設定する利用規約は最後の砦だ。

ライバル企業の技術者たちも、この危機感を完全に共有している。

国家権力という最大のブラックスワン

僕ら開発者にとって、このニュースの本当の恐ろしさは別にある。

「プラットフォームリスク」の完全な顕在化だ。

特定のAIモデルに依存するアーキテクチャは、もはや技術的負債ではない。

事業継続を脅かす致命的な単一障害点だ。

政府の鶴の一声で、特定のAIプロバイダーが国内で事業停止に追い込まれる可能性がある。

APIの提供が突然ストップする。

過去にもTwitter APIの制限やRedditのAPI有料化など、プラットフォームリスクは存在した。

だが今回は民間企業同士のトラブルではない。

「国家権力」という最大のブラックスワンが介入してきた。

技術選定の基準が変わった。

モデルの性能や価格だけを見ていればいい時代は終わった。

プロバイダーの政治的リスクを評価項目に入れる必要がある。

Claude CodeでThreadPostのバックエンドを組んでる時、プロンプトの最適化は全部Claude 3.5 Sonnetに特化させてた。でも今回のニュース見て背筋が凍った。Anthropicが政府と揉めてAPI提供を止められたら、僕のSaaSのコア機能が即死する。OpenAIのAPIに逃がす準備を本気でやらないとマズい。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

マルチモデル開発への移行。アーキテクチャの再設計

特定のAIベンダーへのロックインは避ける。

これはクラウドインフラにおけるマルチクラウド戦略と同じ構造だ。

実務レベルでマルチモデル・アーキテクチャの導入が現実解になる。

1つのモデルが停止しても、即座に他社モデルへフォールバックできる設計だ。

システムの前段にルーティング層を設ける。

リクエストの内容や現在のAPI稼働状況に応じて、動的にモデルを切り替える。

LiteLLMなどのプロキシサーバーの導入が現実的な解だ。

コード側の変更を最小限に抑えつつ、バックエンドのモデルを柔軟に変更できる。

マルチモデル化には以下のステップが必要になる。

* プロキシサーバーによるAPIエンドポイントの統合

* モデルごとのレートリミットとコストの監視

* 障害発生時の自動フェイルオーバー設定

* 出力フォーマットの正規化処理

プロンプトの抽象化も避けて通れない。

Claude向けにガチガチにチューニングしたプロンプトは、GPTやGeminiでは期待通りに動かない。

モデルごとに最適なプロンプトを管理する仕組みが必要だ。

システムプロンプトの共通化と、モデル固有の微調整パラメータを分離する。

出力フォーマットの揺らぎも大きな課題だ。

JSONモードの挙動はモデルによって微妙に異なる。

パースエラーを防ぐための堅牢なバリデーション層が不可欠になる。

エラーハンドリングとテスト自動化の再設計

エラーハンドリングのロジックも根本から見直す。

タイムアウトやレートリミットだけではない。

「APIアクセス権限の喪失」を想定したフォールバック処理を組む。

メインのClaude APIがエラーを返した場合、自動的にOpenAIのAPIへリクエストを再送する。

ユーザー体験を損なわずに裏側でモデルを切り替える。

サーキットブレーカーパターンを実装し、障害が連鎖するのを防ぐ。

テスト自動化のコストも跳ね上がる。

プロンプトを変更した際、複数のモデルで期待する出力が得られるか検証する。

LLM as a Judgeの手法を用いて、出力の品質を自動でスコアリングする仕組みを作る。

うちのThreadPostも今はClaude一本に最適化してる。もし明日APIが止まったらどうするか?マルチモデル対応は「やらなきゃ」と思いつつ後回しにしてた。このニュース見て、さすがに優先度上げないとまずいと思った。

ベンダーロックインの代償は重い。

開発のスピードは落ちる。

複数モデルの検証コストも跳ね上がる。

それでも、政治的リスクによるシステム完全停止に比べれば安い保険だ。

単なる企業間の法廷闘争ではなく、公的AI規制が存在しない空白地帯で民間の利用規約が唯一の安全装置として機能しているという構造が浮かび上がる。その安全装置を国家権力が破壊しようとした時、業界全体が競合の垣根を超えて反応した。これはAI開発の政治リスクが、技術リスクと同列に扱われる段階に入ったことを示している。

よくある質問(FAQ)

Q1: AnthropicのAPIは一般の開発者も使えなくなるの?

現時点では、一般企業や個人の開発者がClaude APIを利用することに影響はない。今回の問題は米国防総省および連邦政府機関との契約に関するものだ。民間へのサービス提供は継続されている。ただし、米国政府機関と取引のある企業は、連鎖的にAnthropic製品の利用を制限される可能性がある。

Q2: なぜOpenAIの従業員が競合のAnthropicを支持しているの?

国防総省がAnthropicを排除した手法が、AI業界全体への恣意的な権力行使だと危惧しているためだ。公的な法規制がない中、開発者が設定する倫理的ガードレールを守る権利は業界全体で死守する必要がある。単なる自社利益を超えた、安全なAI開発環境を守るための連帯だ。

Q3: 開発者としてこのニュースから取るべき対策は?

特定のAIモデルが政治的・法的な理由で突然利用制限を受けるリスクを前提にシステムを組む。OpenAIやGoogleなど複数のLLMを動的に切り替えられるマルチモデル・アーキテクチャを採用する。LiteLLMなどのプロキシを挟み、APIの停止時に自動で他社モデルへフォールバックする仕組みを実装する。

まとめ

AIモデルの利用規約が国家権力によって無効化されるリスクが現実になった。特定モデルへの依存は致命傷になる。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド