AIを毎日使っていると「なぜか期待通りの答えが返ってこない」と悩む瞬間が必ずある。

結論から言うと、AIは人間のように文脈を察してくれる対話相手ではなく、確率に基づいてテキストを生成するシステムだ。

だからこそ、人間が直感的に良いと感じる指示が、AIにとっては逆効果になることも珍しくない。

今回は、曖昧な指示を排除する米軍式の言語統制や、AIの思考プロセスを制御する最新のテクニックをまとめた。

AIの挙動を根本から変えるプロンプト術を紹介する。

今日からすぐに使えるものばかりだ。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

カテゴリ1:語彙とフレームの制御

1. 曖昧な日常語を避け「意味密度の高い専門用語」を使う

AIに指示を出すとき、「セキュリティに気をつけて」のような曖昧な言葉を使うのは避けるべきだ。

AIは単語をベクトル空間上の座標として処理するため、多義的な言葉を与えると参照する知識の範囲が広がりすぎて出力がブレる。

そこで、定義が厳密な専門用語を使うのが効果的だ。

たとえば、軍事ドクトリンで使われるような「意味密度」の高い言葉を使うと、AIは特定の知識クラスタに迷わず接続できる。

結果として、100行の曖昧なプロンプトよりも、たった数文字の専門用語のほうが精度の高い出力を引き出せる。

2. 情報保護の指示には「OPSEC」「INFOSEC」を指定する

単に「情報を守って」と指示しても、AIは一般的なパスワード管理などの回答しか返さないことが多い。

これを「OPSEC(作戦情報の保護)の原則に基づき」と指定するだけで、AIの思考回路は軍事レベルの情報統制に切り替わる。

部署名やスケジュールの組み合わせが機密になるという、情報の断片化リスクまで自発的に指摘するようになる。

さらに通信経路の保護を意識させたいなら「INFOSEC」や「COMSEC」という用語を混ぜるべきだ。

日常語を専門用語に置き換えるだけで、プロンプトの解像度は劇的に上がる。

3. 思考フレームを切り替えるため「OODA」や「ROE」を活用する

AIに手順や計画を作らせる際、前提となる思考の枠組みを指定することで出力の質をコントロールできる。

たとえば「PDCA」と指示すると半年スパンのゆったりとした改善活動を提案してくる。

しかし「OODAループ」と指示すれば、秒単位の判断速度を重視した緊迫感のある手順を生成する。

また、リスクの洗い出しに「脅威モデリングとROE(交戦規定)」を指定するのも効果的だ。

許可と禁止の線引きが明確になり、実務ですぐに使える細かいルールが生成される。

カテゴリ2:出力の多様性と制約

4. アイデア出しでは「過去の出力」をプロンプトに注入して重複を防ぐ

AIに毎週新しいアイデアを出させようとしても、すぐに似たような内容ばかり提案してくるようになる。

これはAIが同じ確率分布から最も無難な回答を選び取る性質を持っているためだ。

このモードコラプスを防ぐには、過去の出力をプロンプトに注入するのが最も効果的だ。

具体的には、過去数回分の出力サマリーを渡し「以下と意味的に類似するアイデアは除外すること」と明確な制約をかける。

これにより、AIは強制的に新しい領域を探索せざるを得なくなる。

5. Temperatureに頼らず「入力の視点」をローテーションさせる

AIの回答に変化をつけようとして、設定温度(Temperature)を上げるのは悪手だ。

文章が破綻したり意味不明な言葉が混ざったりするだけで、本質的な創造性は生まれない。

質の高い多様性を生み出すには、入力側の環境を計画的に変化させる必要がある。

たとえば、曜日ごとに検索の視点や情報ソース、問いの立て方を変えてみるのが効果的だ。

異なる文脈を意図的に衝突させることで、初めてAIから新しい切り口のアイデアを引き出せる。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、この「過去の文脈を注入して制約をかける」アプローチが一番使いやすかった。

理由はシンプルで、AIに「空気を読め」と期待するより「これはやるな」とルール化したほうが圧倒的に制御しやすいからだ。

別の話題のツールも良さそうだが、ターミナルから直接コンテキストを操作できるClaude Codeの体験は群を抜いている。

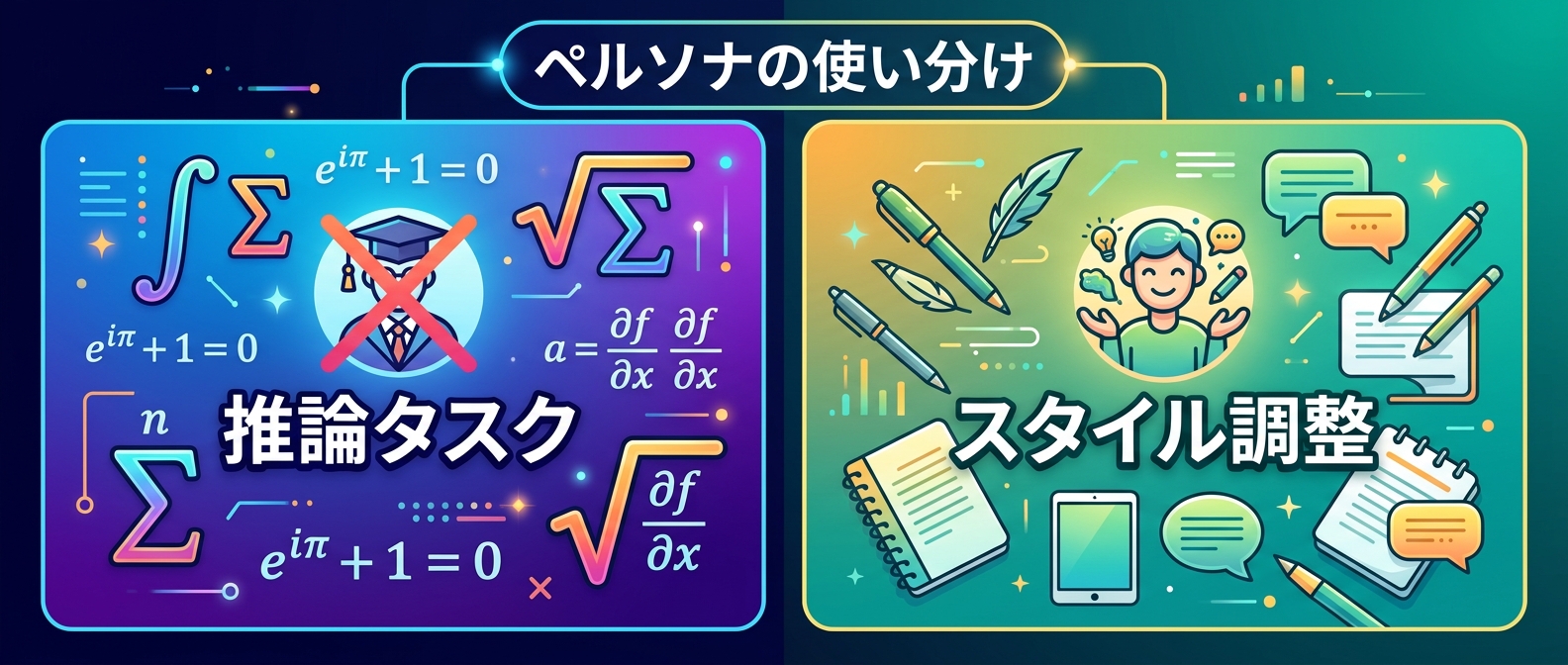

カテゴリ3:ペルソナと推論の罠

6. 正確性が問われるタスクで「あなたは専門家です」のペルソナを使わない

プロンプトの定番である「あなたは〇〇の専門家です」という指示は、実は万能ではない。

最新の研究では、数学やコーディングなど事実に基づく推論が必要なタスクにおいて、専門家ペルソナを与えると正答率が低下することが判明している。

AIの総合学力を測るベンチマーク「MMLU」を用いた検証でも、ペルソナなしでは71.6%だったのに対し、ペルソナを付与すると正答率が低下する傾向が確認されている。

AIが専門家らしく振る舞うための丁寧な文体生成に処理能力を奪われてしまうからだ。

正確な答えが欲しいタスクでは、余計な役割を与えず、シンプルに要件だけを伝えるのが正解だ。

7. ペルソナ・プロンプトは「トーン調整・ロールプレイ」に限定する

ではペルソナが全くの無駄かというと、そうではない。

文章のトーン調整や、特定のキャラクターになりきったストーリー作成など、スタイルが重視されるタスクでは依然として強力だ。

営業担当者風のメール作成や、コンプライアンス担当者としての注意喚起文の作成には大いに役立つ。

目的が「正しい答えを引き出す」ことなのか「スタイルを整える」ことなのかを見極め、用途を誤らずに使い分けることが重要になる。

8. 複数のAIエージェント間で「認知的隔離」を行う

AIから多様なアイデアを引き出すには、複数のサブエージェントを並列で走らせ、それぞれに情報を部分的にしか渡さない「認知的隔離」が有効だ。

1つのコンテキストで情報収集から発想までを順に行うと、最初の解釈が後続の推論を汚染するアンカリング効果が起きてしまう。

各エージェントに異なる情報と異なる思考フレームを与え、お互いの存在を知らない状態で推論させる。

同じ情報セットを与えられた場合でも、各エージェントの視点が独立しているため、全く異なる洞察を引き出すことができる。

9. ペルソナを変えるより「推論戦略」を変える

多様なアイデアを出させるために「経済学者の視点で」「デザイナーの視点で」とペルソナを変えるアプローチは、実は効果が薄い。

研究によれば、ペルソナを変えてもAIは演じている感を作り出すだけで、本質的な推論パスは変わらない。

質的に異なる結論を得るには、推論の仕方自体を変える必要がある。

端的に結論を出す直接回答(IO)や、段階的に推論するステップバイステップ(CoT)、さらには反実仮想推論など、推論戦略を切り替えるべきだ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

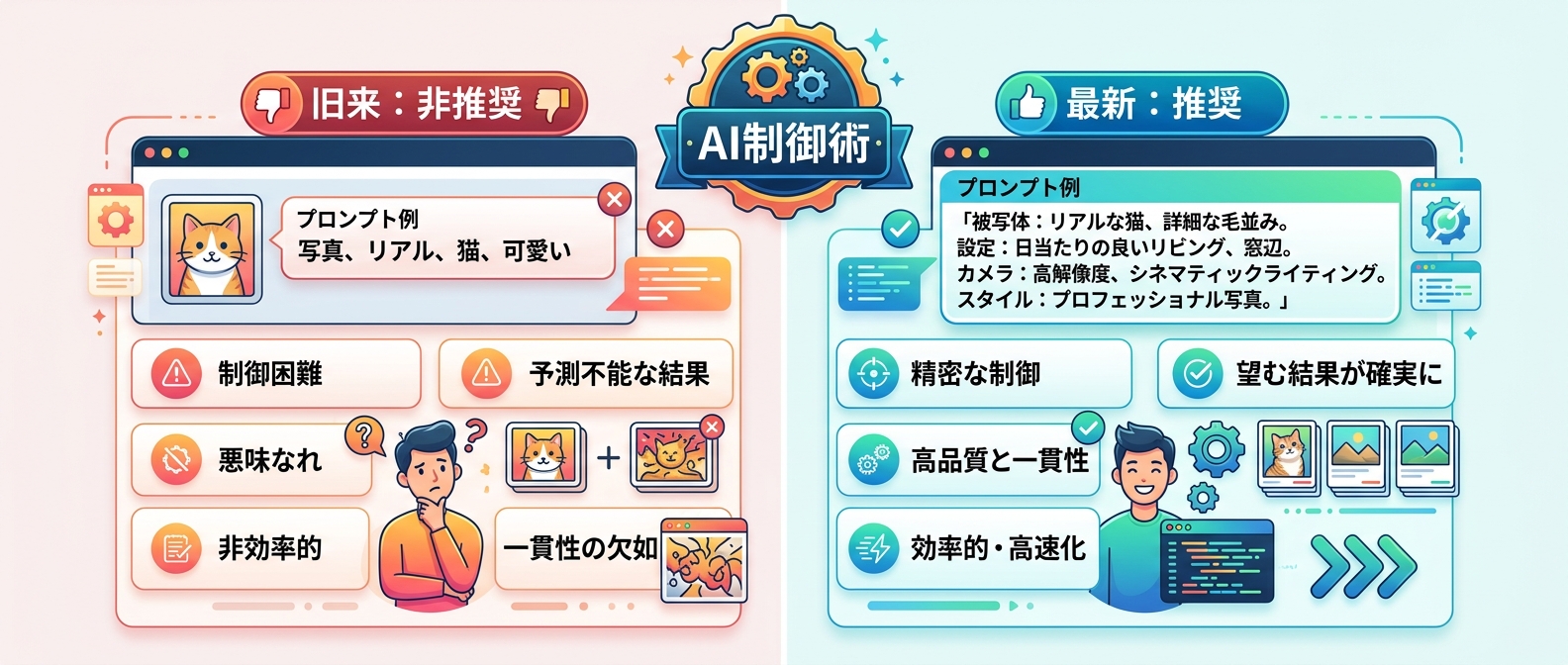

旧来のプロンプトと最新テクニックの比較

ここで、これまでの一般的なプロンプトと、今回紹介した最新テクニックの違いを比較表で整理しておく。

| 比較軸 | 旧来のプロンプト(非推奨) | 最新テクニック(推奨) | 期待できる効果 |

| :--- | :--- | :--- | :--- |

| 用語の選択 | セキュリティに気をつけて | OPSECの原則に基づき | 曖昧さが消え、解像度の高い出力になる |

| 思考フレーム | PDCAサイクルで計画 | OODAループで手順化 | 緊迫感や判断速度など、時間軸を制御できる |

| アイデア出し | 別のアイデアを出して | 過去の出力(要約)を除外 | モードコラプスを防ぎ、強制的に新領域を探らせる |

| ペルソナ設定 | あなたは優秀なプログラマー | (正確なタスクでは使用しない) | 演技へのリソース浪費を防ぎ、推論精度を上げる |

| 推論の多様性 | ペルソナを変える | 推論戦略を変える | 本質的な推論パスが変わり、質的に異なる結論が出る |

しんたろー:

AIへの指示は「短く・鋭く」が鉄則だ。

丁寧に「あなたは専門家として〜」と書くのをやめてから、Claude Codeのコード生成の精度が明らかに安定した。

他の推論モデルも気になってはいるが、今のところこの制御術とClaude Codeの組み合わせが最強の相棒だと言える。

よくある質問(FAQ)

Q1: プロンプトに「あなたは〇〇の専門家です」と書くのはもう古いのか。

古いわけではないが、タスクによる使い分けが必須になったと言える。

数学やプログラミングなど「正確な答え」が求められるタスクでは、専門家ペルソナを与えるとAIが「それらしく振る舞う」ことに処理能力を奪われ、かえって正答率が下がる。

一方で、文章のトーンを整えたり特定のキャラクターになりきらせたりするスタイル重視のタスクでは、引き続き有効な手法だ。

Q2: AIにアイデアを出させると、いつも似たような回答になる。どうすればいいか。

過去に出力されたアイデアの要約をプロンプトに含め、「以下のアイデアと類似するものは除外すること」と明確な制約をかけるのが最も効果的だ。

AIは同じ入力に対して最も確率の高い無難な回答を返す性質があるため、単に「別のアイデアを出して」と指示しても似た内容になりがちだ。

設定温度を上げても文章が破綻しやすくなるだけなので、入力する条件や視点を強制的に変える工夫が必要になる。

Q3: プロンプトに軍事用語を使うのは難しそうだ。

軍事用語そのものを丸暗記する必要は全くない。

重要なのは、日常語の曖昧さを排除し、定義が厳密な言葉を使うという本質を理解することだ。

たとえば「セキュリティ」という言葉を「機密情報の外部漏洩を防ぐ通信経路の保護」のように、誰が読んでも1つの意味にしか取れない解像度の高い言葉に置き換えるだけでいい。

これだけでAIの出力精度は劇的に向上するはずだ。

Q4: AIから多様なアイデアを引き出すには、ペルソナを変えるのが良いか。

ペルソナを変えるアプローチは、出力の多様性において限定的な効果しかない。

AIは演じている感を作り出すだけで、本質的な推論パスは変わらないからだ。

質的に異なるアイデアを得るには、ペルソナではなく、直接回答やステップバイステップなど、推論戦略自体を変えるべきだ。

Q5: プロンプトを短くシンプルにするのと、長く詳細に書くのはどちらが良いか。

目的によるが、長く書けば精度が上がるという誤解には注意が必要だ。

曖昧な言葉を使って100行のプロンプトを書くよりも、意味が厳密に定義された専門用語を数文字入力する方がAIは迷わず正確な答えを導き出せる。

ペルソナ設定などでプロンプトが長くなりすぎると、肝心の推論能力が低下するリスクもある。

短くても意味密度の高い指示を心がけるべきだ。

まとめ:AIを「確率的テキスト生成器」として乗りこなす

AIの出力をコントロールするには、人間同士のコミュニケーションの延長で考えるのをやめる必要がある。

曖昧な言葉を避け、制約を明確にし、AIの特性を理解した上で入力環境を設計することが不可欠だ。

今回紹介した米軍式の用語統制やペルソナの引き算は、どれも今日からすぐに実践できる。

まずは正確な答えが欲しいタスクから「あなたは専門家です」の一文を削るところから始めるといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

なぜClaude Codeは自律的な同僚になるのか。Opus 4.8で変わる開発の現場と信頼の完全ガイド

なぜAnthropicの巨額調達が開発の分かれ道になるのか。Claude Codeの実装と次世代モデルの選択を徹底解説

【2026年版】Claude Codeの神機能10選|生産性を限界まで引き上げる最適化術

なぜAI開発はGUIを捨てCLIへ回帰するのか。Claude Codeが示す自動化の最適解

Gemini 3.5 FlashとOmniの実力|Claude Code開発者が選ぶ推論先行型AIの使い分けを徹底解説