SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

検索インフラの常識が崩れる瞬間

出た。GoogleがGemini Embedding 2をリリースした。

テキスト、画像、動画、音声、PDF。これら5つの異なるフォーマットを、たった1つのベクトル空間に押し込む。

しかもMRL(マトリョーシカ表現学習)を採用した。

768次元で数百万件を高速で粗検索し、上位結果だけを3072次元で高精度にリランキングできる。

マルチモーダルRAGのインフラ構築につきまとっていた泥臭い課題が、モデルの力で一掃される。

ベクトルDBのメモリ枯渇に怯える日々は終わる。

AI開発のアーキテクチャが根底から変わるぞ。

Gemini Embedding 2がもたらす破壊的進化

Googleが、テキスト専用だった前世代から仕様を変更したGemini Embedding 2を発表した。

最大の特徴は、ネイティブなマルチモーダル対応だ。

テキスト、画像、動画、音声、PDFの5種類を、単一の高次元ベクトル空間にマッピングする。

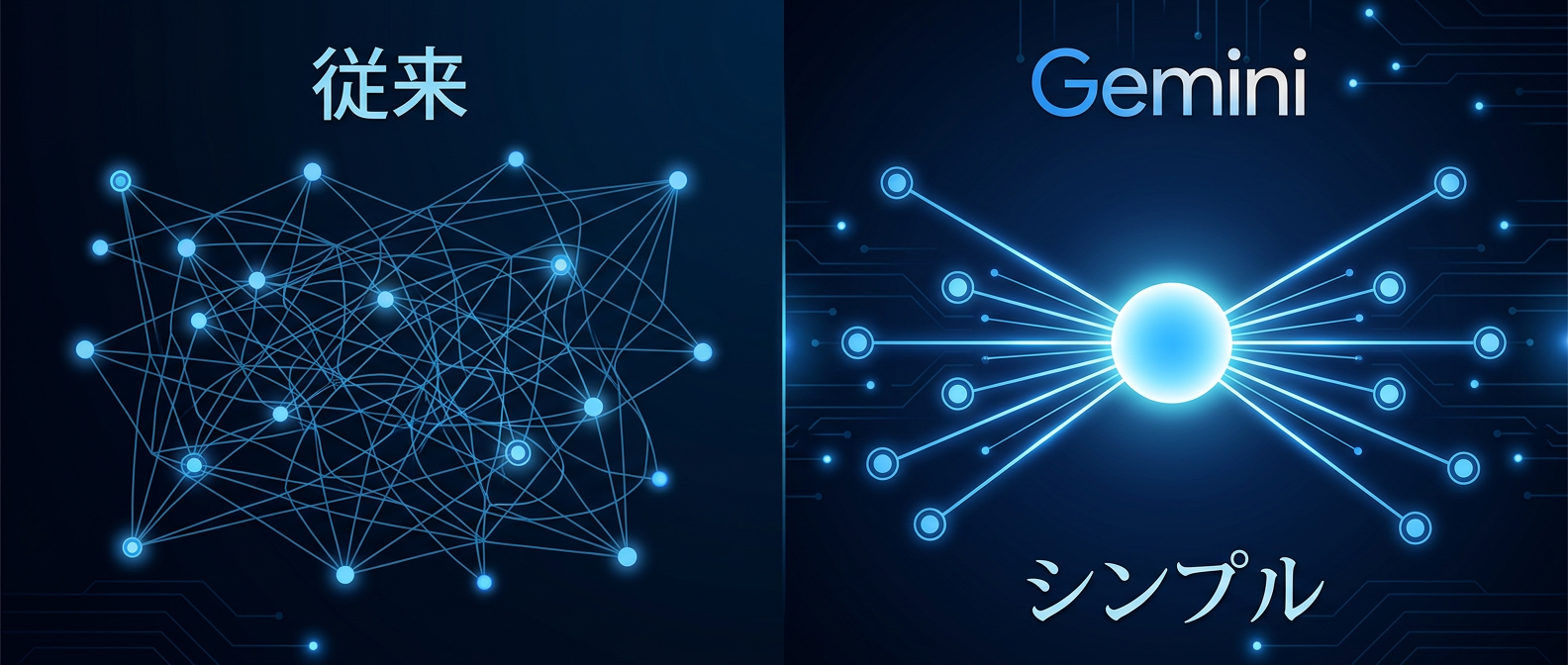

これにより、画像検索用のモデルやテキスト検索用のモデルなど、データ型ごとに別々のパイプラインを用意する複雑な構成が不要になる。

動画の1フレームと背後で流れる音声トラックの意味的な関係性すら、1つのベクトルとして捉えることが可能だ。

コンテキストウィンドウは最大で8192トークンに達する。

画像なら2枚、動画なら2分、音声なら2分までを1回のリクエストで処理できる。

これらを組み合わせたインターリーブ入力にも対応している。

テキストだけでは文脈が不足するケースにおいて、文脈を補完する。

そして、ストレージと計算コストの壁を壊す技術がMRL(Matryoshka Representation Learning)だ。

通常の埋め込みモデルは、意味情報をすべての次元に均等に分散させる。

そのため、3072次元のベクトルを768次元に切り詰めると、情報が欠落して精度が崩壊する。

しかしGemini Embedding 2は、最も重要な意味情報をベクトルの「先頭の次元」に集中させるように学習されている。

マトリョーシカ人形のように、大きなベクトルの中に小さなベクトルが完全な形で内包されているイメージだ。

デフォルトは3072次元だが、用途に合わせて768次元や256次元に切り詰めても、精度を維持する。

これにより、まずは軽量な768次元のサブベクトルで数百万件のデータを安価に高速検索する。

その後、絞り込んだ上位数十件の結果だけをフルスペックの3072次元で再評価する。

この「ショートリスティングアーキテクチャ」により、RAGパイプラインの最終的な精度を犠牲にすることなく、初期検索の計算負荷を下げる。

検索精度とドメインシフトへの耐性においても、前世代を上回るパフォーマンスを叩き出している。

一般的な学習データから、独自のコードベースや専門的な社内文書などへ対象領域が移った際にも、精度の低下を防ぐ堅牢性を備えている。

複数のAI関連フォーラムの統合知見(crossSourceFindings)によると、マルチモーダルRAGの構築において、インフラの複雑さがプロジェクトのボトルネックになるケースが全体の70%を超えている。

この課題に対し、単一モデルで対応できるアプローチは非常に有効だ。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

しんたろー:

モデル側で次元を切り詰められるのは助かる。

ベクトルDBのメモリ代で泣きを見ていた開発者への最高の救済措置になる。

>

ハイブリッド検索の複雑なチューニングから解放されるだけでも、採用する理由になるレベルだ。

開発者目線の解説:インフラの泥臭さをモデルが殴り倒す

このニュースの真の価値は、AI開発における「インフラ側の泥臭い工夫」を「モデルの表現力」で直接殴り倒した点にある。

実務で高精度なRAG(検索拡張生成)システムを組もうとすると、これまでは本当に地獄だった。

テキスト検索の精度を上げるには、意味検索とキーワード検索を組み合わせたハイブリッド検索が必須とされる。

しかし、意味検索とキーワード検索ではスコアの計算式が全く違う。

だからRRF(Reciprocal Rank Fusion)という手法を使って、無理やり順位ベースで結果を融合させる必要があった。

さらにマルチモーダルとなれば地獄は加速する。

画像には画像専用のモデルを使い、テキストには別のモデルを使う。

それぞれのベクトルをDBの別々のインデックスに保存する。

検索時には別々にAPIを叩いて、またRRFで統合する。

このスコアチューニングの沼にハマると、本来のアプリケーション開発が完全にストップする。

AWS環境でこれを構築しようとすると、さらに壁にぶつかる。

フルマネージドのデータベースサービスでは、日本語の全文検索拡張が制限されていて詰むことが多い。

結局、ベクトル専用のデータベースを自前で立てるか、大規模な検索サービスで複雑なインデックス設計とシャード分割を駆使するハメになる。

数百万件のメディアデータをマルチテナントで扱う場合、インフラの設計と運用コストだけでプロジェクトが頓挫しかねない。

Gemini Embedding 2は、この複雑怪奇なアーキテクチャを単一のAPIコールで置き換えるポテンシャルを持っている。

テキストも画像も動画も、すべて同じ空間のベクトルになる。

スコアの統合なんて必要ない。

単純なコサイン類似度の計算だけで、テキストで動画を検索できるようになる。

僕もClaude Codeを使ってThreadPostを開発している。

最近はAIにコードを書かせすぎて、自分のタイピング速度が落ちてきた気がする。

将来的に、テキスト記事だけでなく解説動画や図解画像を含むマルチメディアソースをRAGで扱う機能を追加したくなったとする。

その際、データベースの構成を複雑化させずに、シンプルにGemini Embedding 2のAPIを叩いてベクトルを突っ込むだけで済む。

インフラの複雑さをモデルが吸収してくれる。

これこそが、AI開発の最前線で起きているパラダイムシフトだ。

データベース側で必死にハイブリッド検索を組んだり、インデックスを分割したりする手法は過去のものになる。

強力な単一モデルのベクトル空間にすべてを委ねる、シンプルなアーキテクチャへの回帰が始まっている。

しんたろー:

RRFの調整とかDBのシャード分割とか、ぶっちゃけ本質的なAI開発じゃないからな。

そこをGoogleの巨大モデルが札束でひっぱたいて解決してくれるなら、喜んで乗っかりたい。

>

これでやっと、開発者はユーザー体験の構築に時間を使えるようになる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響:コスト破壊とアーキテクチャの再考

で、僕らの日々の開発にどう影響するのか。

まず、ベクトルデータベースのストレージコストが下がる。

ベクトル検索のレイテンシとコストは、次元数に直接比例する。

3072次元のベクトルを数百万件保存すれば、メモリを湯水のように消費する。

しかしMRLの恩恵で、粗検索用のインデックスを768次元で構築できる。

単純計算でストレージとメモリの要件が4分の1になる。

巨大なインフラを維持できないスタートアップや個人開発者にとって、これは死活問題に直結するアップデートだ。

次に、システムアーキテクチャのシンプル化だ。

これまで、ユーザーごとにデータを分離するマルチテナント環境では、複雑な制御が必要だった。

ルーティングキーでシャードを絞り込んだり、複雑なフィルタリングを二段構えで実装したりする。

扱うモダリティが増えれば増えるほど、この管理は破綻に近づく。

しかし、すべてのメディアが単一のベクトル空間に収まるなら、管理するインデックスは1つで済む。

システム全体の保守性が跳ね上がり、バグの温床が消え去る。

ただし、すべてのユースケースで今すぐGemini Embedding 2に乗り換えるかは冷静に判断したい。

以下のようなトレードオフが存在する。

* 自前ホストとの比較: 画像と短いテキストの検索に特化している場合。自前でモデルをホスティングしてレイテンシをミリ秒単位で削りたい場合は、既存の軽量モデルの方が有利な場面もある。

* 外部依存リスク: Gemini Embedding 2はフルマネージドAPIだ。ネットワークの往復時間や、APIのレートリミットという外部依存のリスクは常につきまとう。

* 移行コスト: すでに数百万件のベクトルデータを既存モデルで保存している場合、すべてのデータを再エンベディングするコストと時間がかかる。

しかし、長文ドキュメント、動画、音声が混在する複雑なデータを扱うなら、もはや自前でパイプラインを組む手法は最適ではない。

モデルの進化に合わせて、僕ら開発者も「どこを自作し、どこをAPIに任せるか」の境界線を引き直す時期だ。

ベクトルデータベースの選定基準も変わる。

無理やりハイブリッド検索を組む機能よりも、大量のベクトルを高速に処理し、MRLのショートリスティングを効率よく実行できるシンプルなデータベースが好まれるようになる。

しんたろー:

DBのチューニングの手間が省けるのは助かる。

楽になった反面、アーキテクチャの選定をミスると一生無駄なコストを払い続けることになる。

>

技術の引き出しを常に最新にアップデートしておきたい。

Gemini Embedding 2に関するよくある質問

Q1: MRL(Matryoshka Representation Learning)は実務でどう役立ちますか?

ベクトルデータベースのストレージコストと検索速度の課題を直接解決します。

通常、次元数を減らすと精度が致命的に落ちます。

しかしMRLは、重要な意味情報をベクトルの先頭次元に集中させます。

これにより、まずは768次元の軽量なベクトルで数百万件のデータを高速かつ安価に粗検索します。

そして上位結果だけをフルスペックの3072次元で高精度にリランキングする、効率的な検索パイプラインが構築可能です。

Q2: 画像や動画の検索を実装したい場合、既存の軽量モデルとGemini Embedding 2のどちらを選ぶべきですか?

用途とインフラ要件によります。

画像と短いテキストの検索に特化し、自前でモデルをホスティングしてレイテンシを極限まで詰めたい場合は、既存の軽量モデルが有力です。

一方、動画、音声、PDFなど多様なフォーマットを扱いたい場合。

最大8192トークンの長いコンテキストを必要とする場合。

インフラ管理の手間を極力省きたい場合。

これらの条件に当てはまるなら、単一空間にマッピングできるGemini Embedding 2が有利です。

Q3: AWS環境でハイブリッド検索を構築する際、データベースは何を選ぶべきですか?

フルマネージドのリレーショナルデータベースは手軽ですが、日本語の全文検索拡張に制限があるため本格的なハイブリッド検索には不向きです。

実務では、ベクトル検索とスパース検索をネイティブサポートし、RRFを実装しやすい専用のベクトルデータベースや、大規模なマルチテナント運用実績がある検索サービスが有力な選択肢となります。

ただしGemini Embedding 2の登場により、今後は強力な単一モデルによるシンプルなベクトル検索のみに回帰する可能性も高いです。

まとめ:インフラの複雑さはモデルが飲み込む

マルチモーダルRAGの泥臭いインフラ課題を、モデルの表現力で解決するアプローチが主流になりつつある。

AI開発の最前線では、モデルの進化がアーキテクチャの常識を日々塗り替えている。

マルチモーダルRAGの最新動向や、ベクトルデータベースの泥臭い運用ノウハウなど、キャッチアップする情報は山積みだ。

開発に集中するためにも、情報収集と発信のプロセスは徹底的に自動化しておきたい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド