SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIエージェント開発のアーキテクチャ変化

OpenAIがResponses APIに組み込みツールを追加した。

エージェント型アプリケーション構築のコア基盤となるアップデートだ。

Chat Completions APIによる単一モデルとの対話から開発の焦点が移っている。

複数モデルをルーティングする自律型エージェント構築が主流になりつつある。

数行のコードでAIが外部ツールを操作する。

o4-miniが思考プロセスの中で直接ツールを実行する。

単一のモデルにすべてのタスクを処理させるアプローチは過去のものになりつつある。

複数のモデルを組み合わせ、システム全体をオーケストレーションする手法が採用されている。

AIにテキストを生成させるだけのフェーズは終了した。

現在はAIにシステム全体を制御させるフェーズへと移行している。

エージェント開発のパラダイムは、プロンプトの調整からアーキテクチャの設計へと変化した。

開発者はモデルの特性を理解し、最適なタスクを割り当てる役割を担う。

GPT-4oやo1などの強力なモデルは、複雑な推論や計画立案に特化して使用される。

一方で、o4-miniのような軽量モデルは、高速なデータ処理やツール実行を担当する。

この分業体制により、システム全体のパフォーマンスとコスト効率が最適化される。

AIアプリケーションは、単なる対話インターフェースから自律的な業務システムへと進化している。

Responses APIとo4-miniのアップデート詳細

OpenAIがResponses APIに強力な組み込みツールを追加した。

リモートのMCPサーバーの完全サポートが含まれている。

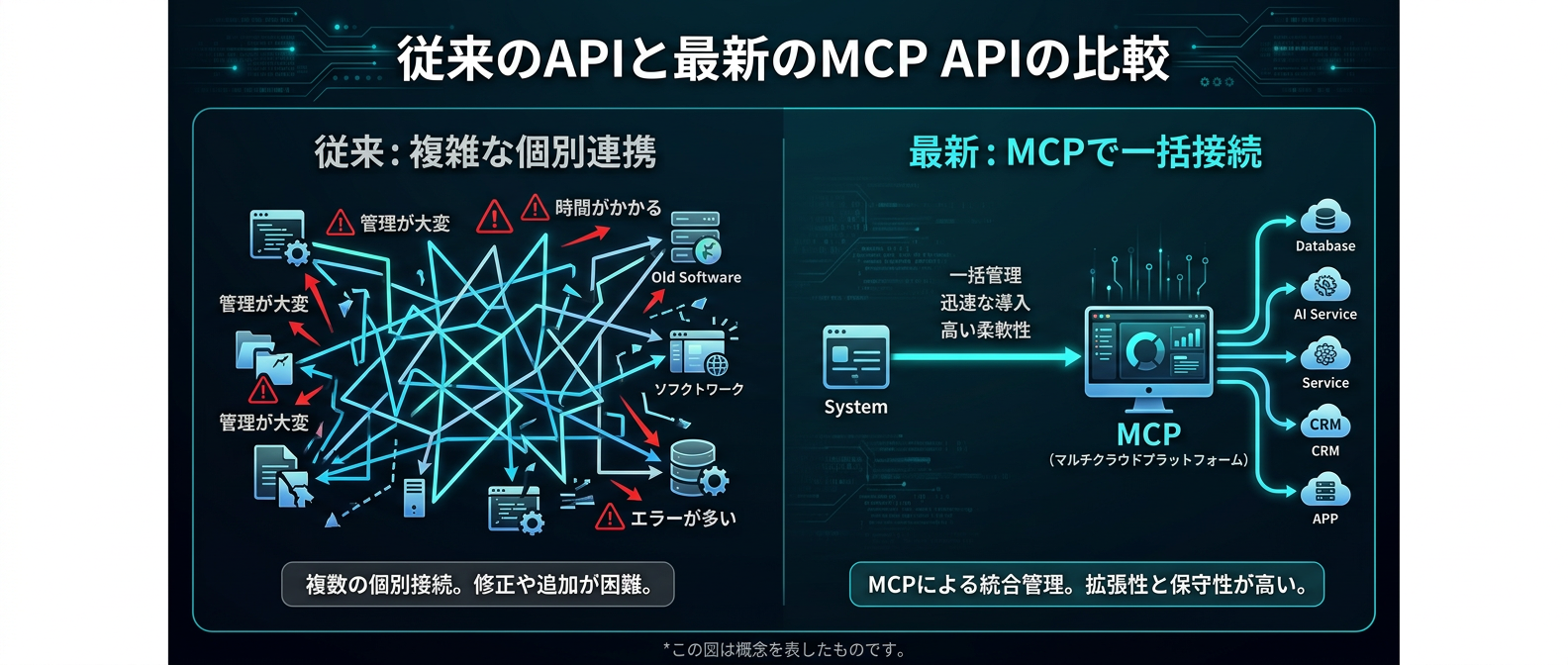

MCPはアプリケーションがLLMにコンテキストを提供するための標準プロトコルだ。

Anthropicが提唱したこのオープンスタンダードを、OpenAIもネイティブにサポートした。

業界全体でツール連携の規格が統一されつつある。

開発者はモデルと外部ツールを瞬時に接続できる。

タイプにMCPを指定し、サーバーのURLを渡す。

この記述だけで、AIが外部のデータベースやSaaSと直接対話を始める。

画像生成、コードインタープリター、ファイル検索の機能も向上している。

これらがGPT-4oシリーズやo1などの推論モデル全体でネイティブに利用可能になった。

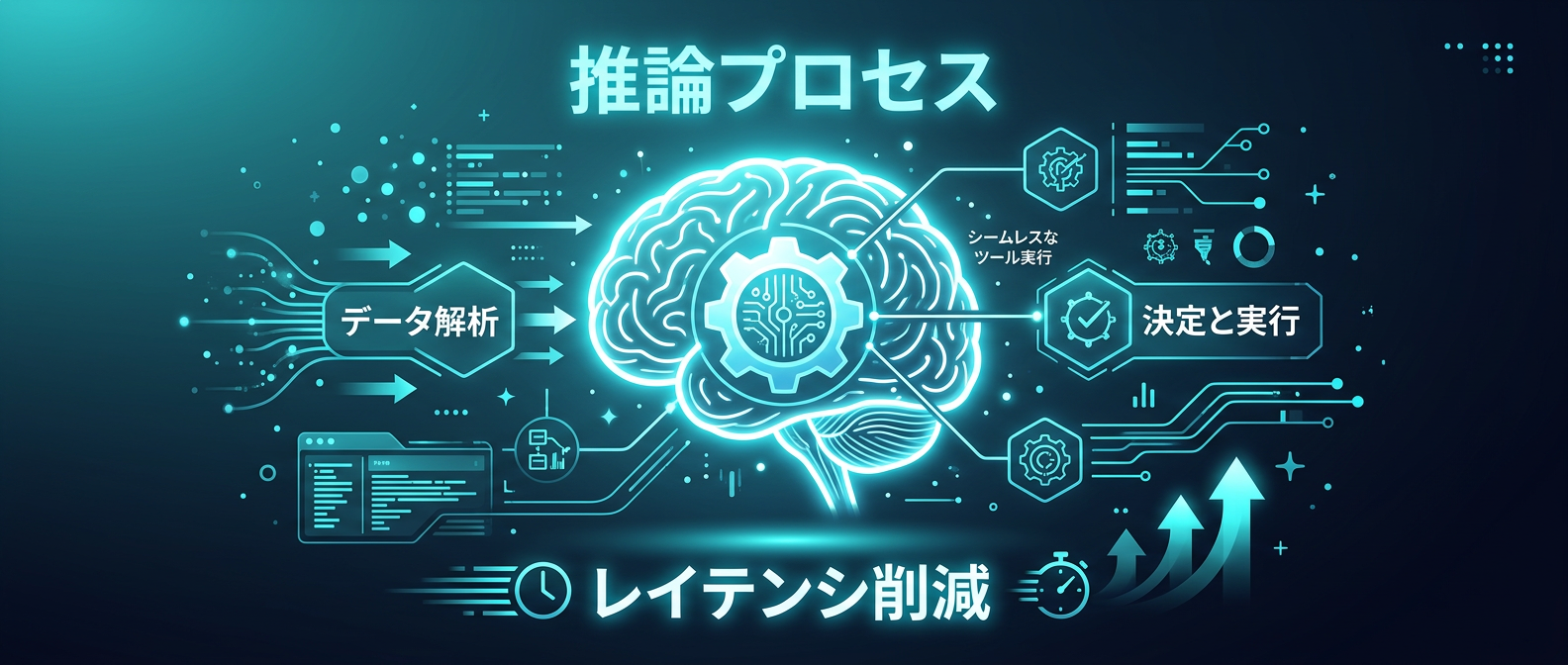

o3とo4-miniの挙動も変化した。

これらのモデルは、Chain-of-Thoughtの中で直接ツールや関数を呼び出せる。

従来は推論とツール実行のプロセスが明確に分断されていた。

モデルが推論を止め、外部に実行を依頼し、結果を待つというサイクルが存在した。

現在は推論のトークンを保持したまま、文脈に沿った回答を生成する。

モデルの知能が向上し、開発者のコストとレイテンシが低下する。

推論プロセス内でツールが実行されることで、コンテキストの欠落が防がれる。

複数回のツール呼び出しが必要な複雑なタスクでも、一貫した推論が維持される。

エンタープライズ向けの機能も強化されている。

非同期で長時間のタスクを処理するバックグラウンドモードが追加された。

推論の要約機能や、暗号化された推論アイテムのサポートも導入されている。

企業が求める信頼性とプライバシーの要件がAPIレベルで担保される。

暗号化された推論アイテムにより、機密データを扱う金融や医療分野での導入が進む。

コンプライアンス要件を満たしながら、高度な推論能力を活用できる。

2025年3月のリリース以来、数十万人の開発者がこのAPIを利用している。

処理されたトークン数は数兆に及ぶ。

Zencoderのコーディングエージェントは、このAPIを利用してコードベースを解析している。

Reviの市場分析エージェントは、プライベートエクイティや投資銀行向けの情報収集を自動化している。

MagicSchool AIの教育アシスタントも、ウェブ検索を駆使して最新の教材を生成している。

AIは業務システムの中核を担う自律的なオペレーターとして機能している。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

Chat Completions APIからの移行背景

しんたろー:

Responses APIのアップデート、機能の幅が広がって面白い。

ThreadPostの裏側も、これに書き換えたらどうなるか気になる。

非同期処理のバックグラウンドモードがあれば、バッチ処理のタイムアウトの悩みも消えそうだ。ただ、新しいAPIの仕様を読み込むのは骨が折れる。

単一のモデルに全てを任せるアプローチは限界を迎えている。

適材適所のモデルルーティングが採用されている。

GPT-5のような重い推論モデルと、o4-miniのような高速モデルを組み合わせる。

コストと速度と精度のバランスを取るための手法だ。

複雑なアーキテクチャ設計やシステムレベルの計画には、o1やGPT-5の深い推論能力を当てる。

単純なコードレビューや検索タスクにはo3-miniやo4-miniを使う。

o3-miniは、大きなモデルと同等の品質を出しながら処理が速い。

リアルタイムのコーディング支援において、レイテンシが低下する。

タスクごとに最適なモデルを選択する柔軟性が提供されている。

これがマルチエージェントシステムの基盤となる。

ソフトウェア開発の現場では、モデルの使い分けが始まっている。

コードベースの理解とドキュメント検索には高速なo4-miniが使われる。

バグのトリアージと機能分析には推論と速度のバランスが取れたモデルが選ばれる。

アーキテクチャ決定とシステム設計には深い推論が可能なo1が割り当てられる。

外部ツール連携の壁を取り払ったのがMCPだ。

従来は各SaaSのAPI仕様に合わせて、個別に連携コードを書いていた。

Shopify、Stripe、Slackなどの仕様を読み込み、専用のラッパーを実装していた。

APIのバージョンが上がるたびにコードのメンテナンスが発生していた。

MCPの標準プロトコルを使えば、多様なツールと接続できる。

エージェントに外部ツールを操作させる実装コストが下がる。

インフラの保守コストも削減される。

推論モデルのツール呼び出し機能も進化している。

o4-miniは思考プロセスの中で自律的にツールを選ぶ。

これまでは、モデルがJSONを返し、アプリ側でツールを実行し、その結果をまたモデルに投げていた。

この往復ラウンドトリップが、システム全体のボトルネックになっていた。

新機能では、推論の文脈を保ったままツールが内部で実行される。

リクエスト間のレイテンシが減少し、APIコストも最適化される。

プロンプトエンジニアリングからシステムアーキテクチャ設計へと焦点が移っている。

どのエージェントにどのツールを持たせ、どう連携させるかの設計が行われている。

AI開発の主戦場はアーキテクチャ設計へと移行した。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

マルチエージェント設計のベストプラクティス

しんたろー:

複数のモデルをオーケストレーションする設計は、プロンプトを書くのとは別の思考回路が必要になりそうだ。

最近はClaude Codeに頼りきりで、自分でコードを書く筋力が落ちている気がする。

実務における変化は、システムアーキテクチャの根本的な見直しだ。

Chat Completions APIからResponses APIへの移行が進んでいる。

単純な一問一答のチャットボットなら、従来のAPIでも稼働する。

外部ツールを叩き、自律的に動くエージェントを作る場合は新APIが採用される。

複数のエージェントが協調して動くシステムでは、役割分担が設定される。

各エージェントに極めて狭いスコープを持たせる。

検索エージェント、読み込みエージェント、統合エージェントに分割する。

タスクを細分化することで、推論の精度が上がり、ハルシネーションが最小化される。

1つのエージェントに責任を集中させない設計が取られる。

責任の分散が、システム全体の信頼性を担保する。

品質の閾値に達しない場合は「答えられない」と判断する仕組みが組み込まれる。

無理に回答を生成させない制御が実運用で採用されている。

マルチエージェント設計において採用されているベストプラクティスが存在する。

タスクの複雑さに応じてモデルを動的にルーティングする。

各エージェントの責任範囲を極小化し、単一障害点をなくす。

MCPを用いて外部データソースとの接続を標準化する。

証拠に基づかない生成を防ぐためのコンテキストエンジニアリングが徹底される。

コンテキストエンジニアリングというアプローチも浸透しつつある。

生成を開始する前に、正しい証拠やデータを収集するプロセスだ。

構造化されたデータの束をエージェントに渡し、そこから推論させる。

事実に基づかない回答を排除するアプローチとして機能する。

バックグラウンドモードの活用も進んでいる。

長時間の非同期処理が、サーバーレス環境でも安定して稼働する。

タイムアウトの課題が解消され、バッチ処理の設計が変わる。

大規模なデータセットの分析や、夜間のバッチ処理がAPI経由で実行される。

サーバーのタイムアウト制限を気にせず、複雑なタスクをAIに委譲できる。

Claude Codeのような自律型コーディングエージェントの仕組みが構築しやすくなった。

軽量モデルでコードを理解し、強力なモデルで設計を行う。

このアプローチは、あらゆるドメインのアプリケーションに応用されている。

AI開発のハードルが下がり、設計の自由度が広がっている。

開発者はAPIの仕様書を確認する時間を減らすことができる。

エージェントのオーケストレーションとユーザー体験の向上にリソースが割り当てられる。

Responses APIと推論モデルに関するよくある質問

Q1: Responses APIでMCPサーバーを使うメリットは何ですか?

従来は各SaaSのAPI仕様に合わせて個別に連携コードを書く必要がありました。

MCPに対応したことで、標準化されたプロトコルを用いて外部データやツールに接続できます。

エージェントに外部ツールを操作させる実装コストと保守コストが下がります。

開発者はAPIの仕様書を読む時間を減らし、エージェントのオーケストレーションに集中できます。

システムの拡張性も向上します。

Q2: o3やo4-miniでのツール呼び出しはどう変わりましたか?

これまでは推論プロセスとツール呼び出しのプロセスが分離していました。

新機能により、Chain-of-Thoughtのプロセス内で直接ツールや関数を呼び出せます。

推論の文脈とトークンを保持したままツールを実行できるため、文脈に沿った回答が得られます。

無駄な往復処理が減ることで、リクエスト間のレイテンシとAPIコストも削減されます。

より高速なエージェントの構築が可能になります。

Q3: Chat Completions APIからResponses APIへ移行する判断基準は何ですか?

単純なチャットボットであればChat Completionsでも稼働します。

外部ツールを叩く、長時間の非同期処理を行う、または複数のエージェントをルーティングする複雑なアプリを作る場合は移行が採用されます。

Responses APIはマルチエージェント構築の新しい標準基盤として設計されています。

移行により、システムの信頼性とコスト効率が向上することが多くの事例で示されています。

今後のAI開発において標準的な選択肢となります。

エージェント開発のパラダイムシフト

プロンプトの工夫から、モデルとツールのオーケストレーションへ。

しんたろー:

APIの進化が早すぎてキャッチアップが大変だけど、やれることが増えるのは純粋に楽しい。

バックグラウンドモードが実際のバッチ処理でどう動くか試してみたい。まあ、その前に山積みになっている既存のバグ修正を終わらせないといけないんだが。

Responses APIの進化とMCP対応で、エージェント開発のアーキテクチャは変化した。

最新のAPIトレンドと実装のベストプラクティスをThreadPostで議論しよう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる技術10選|API課金を最適化する実践ノウハウ

VercelのZeroが変えるAI開発、なぜエージェントに特化した言語が必要なのか

Claude Codeのセキュリティ設定|APIキー管理の新たな責務

なぜKPMGは全社員にClaudeを導入したのか。業務を自律化するエージェント設計を徹底解説

AnthropicのStainless買収でClaude開発はどう変わるのか。API接続の自動化とMCP活用による新時代のAIシステム構築を完全ガイド