結論から言うと、2026年はローカルAI環境を構築する最高のタイミングだ。これまでAIといえばクラウド経由で利用するのが当たり前だった。しかし、外部にデータを送信するリスクや、毎月のAPI利用料が開発者の重荷になっていたのも事実だ。そこに登場したのが、Googleの最新オープンモデルであるGemma 4だ。

周辺ツールをうまく組み合わせれば、高価なグラフィックボードを積んだPCがなくても、実用的なAI環境が手に入る。機密性の高いコードや個人的なメモを、誰にも見られずにAIで処理できる。今回は、1人開発者の視点で厳選したローカルAI構築ツール5選と、完全オフライン化の手順をステップバイステップで解説する。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

前提知識

ローカルAIを始めるにあたって、特別な準備は必要ない。必要なものは、メモリが8GB以上搭載されたパソコンか、最新のスマートフォンだけだ。複雑な環境構築や、何十万円もする専用の機材は一切いらない。Mシリーズのチップを搭載したMacであれば、基本的にメモリが16GB以上あるため、実質的にほぼ誰でも動かせる計算になる。まずは手元の端末で、安全で高速なAI環境を作るところから始めよう。

ステップ1:OllamaでGemma 4を動かす

ローカルAI構築の第一歩は、Ollamaの導入だ。これはターミナルから簡単なコマンドを入力するだけで、巨大なAIモデルをダウンロードして実行できる必須ツールになる。通常、AIをローカルで動かすには複雑な設定ファイルやPythonの環境構築が必要になる。しかしOllamaを使えば、面倒な作業をすべて省略できる。

今回メインで動かすのは、Googleが公開したGemma 4だ。このモデルの最大の特徴は、MoE(Mixture of Experts)と呼ばれる、複数の小さな専門モデルを組み合わせた特殊なアーキテクチャを採用している点にある。全体のパラメータ数は26Bと巨大だが、推論のたびに必要な部分だけを呼び出して計算を軽くするため、実際に動くのは3.8B相当になる。見た目ほど重くないのが大きなポイントだ。

特に4ビット量子化(E4B)と呼ばれる軽量化が施されたモデルは、たった5GB程度のメモリでサクサク動く。M1チップ以降のMacBookや、一般的なWindowsノートパソコン、あるいは安価なLinuxマシンがあれば、十分実用的な速度で回答を生成できる。さらに、256Kという非常に長いコンテキストに対応しているため、長大なドキュメントをそのまま入力する使い方も容易だ。マルチモーダル機能も備えており、画像を渡して説明させたり、音声を処理したりする作業がローカルで完結する。

商用利用が可能なApache 2.0ライセンスで提供されているのも大きな魅力だ。個人開発のサービスに組み込んだり、社内ツールとして配布したりする際も、ライセンスの壁にぶつかることがない。Ollamaのバージョン0.20以上をインストールして、手元のパソコンでAIが動く感動を味わってみるといい。

ステップ2:スマホで完全オフライン実行

ローカルAIの進化はパソコンの中だけにとどまらない。なんと、手元のスマートフォンでもGemma 4を完全オフラインで動かせる。iPhoneユーザーなら、Google AI Edge Galleryという専用のAI実行アプリをApp Storeからインストールするだけで準備完了だ。クラウドへのデータ送信は一切なく、面倒なAPIキーの登録も不要で、すぐに高速な推論を体験できる。

この仕組みの最大のメリットは、電波の届かない場所でもAIを使えることだ。飛行機の中でのアイデア出しや、地下鉄でのちょっとしたコードの確認など、場所を選ばずにAIの支援を受けられる。また、絶対に外部に漏らしたくない個人的な日記や、未発表のプロジェクトの構想を整理するのにも最適だ。

スマホでここまでの処理ができるようになったのは、AIモデルの軽量化技術が劇的に進歩した結果だと言える。Android端末向けのアプリもGoogle Playに用意されているので、自分のスマートフォンでどこまでAIが動くのか、実際に試してみる価値は十分にある。

ステップ3:スプレッドシートでローカルAIを活用する

ローカルAIを単なるチャットボットとして終わらせず、実務でゴリゴリ使うなら、SUMIRE-nというスプレッドシート連携ツールが良さそうだ。これはExcelのような表計算ソフトの感覚で、セルの中にAIを呼び出す関数を記述できるオープンソースのツールだ。特定のセルに関数を入力して実行ボタンを押すだけで、Ollama経由でローカルAIが裏側で動き、回答を自動的に書き込んでくれる。

個人開発をしていると、複数のプロジェクトを同時に進行することが多い。その際、いちいちドキュメントを開いてテキストをコピーし、AIのチャット画面に貼り付けるのは非常に手間だ。このツールを使えば、セルにファイルへのパスを書いておくだけで、AIが実行時に自動で中身を読み込んでくれる。

「あの仕様はどうなっていたか」という疑問も、実行ボタンを1回押すだけで即座に答えが返ってくる。Univerという安定したスプレッドシートエンジンを採用しているため、日本語入力の不具合も起きにくい。グラフィックボードがない一般的なパソコンでも、環境変数を変更してGemini APIに切り替えれば快適に動作する設計になっており、毎日の事務作業やデータ整理の効率を劇的に引き上げてくれるはずだ。

ステップ4:ベクトルDB不要の軽量セマンティック検索

AIに社内の独自ドキュメントや巨大なソースコードを読み込ませる技術をRAGと呼ぶ。これを実現するには、通常ベクトルデータベースという重厚なシステムを構築する必要がある。しかし、個人開発や小規模なプロジェクトでそこまで大掛かりな仕組みを用意するのは現実的ではない。そこで役立つのが、concept-grepという軽量なセマンティック検索ツールだ。

これはプロジェクト内のファイルを走査し、キーワードの完全一致ではなく、文章の「意味」や「概念」を理解して検索するツールになる。例えば「認証」という言葉で検索したとき、ファイル内にその単語が含まれていなくても、「ログイン処理」や「トークン検証」といった関連するコードを賢く探し当ててくれる。

テキスト、埋め込みベクトル、来歴情報を1つのプレーンテキストファイルにまとめる独自のフォーマットを採用しており、ファイルサイズも16〜32KB程度と非常に軽量だ。重いデータベースを構築しなくても、手元のパソコンにインストールしてコマンドを実行するだけですぐに使い始められる。ローカルに保存されたテキストやコードの断片を、AIが理解しやすい形で素早く抽出できるため、RAGの第一歩として非常に優秀なツールだと言える。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

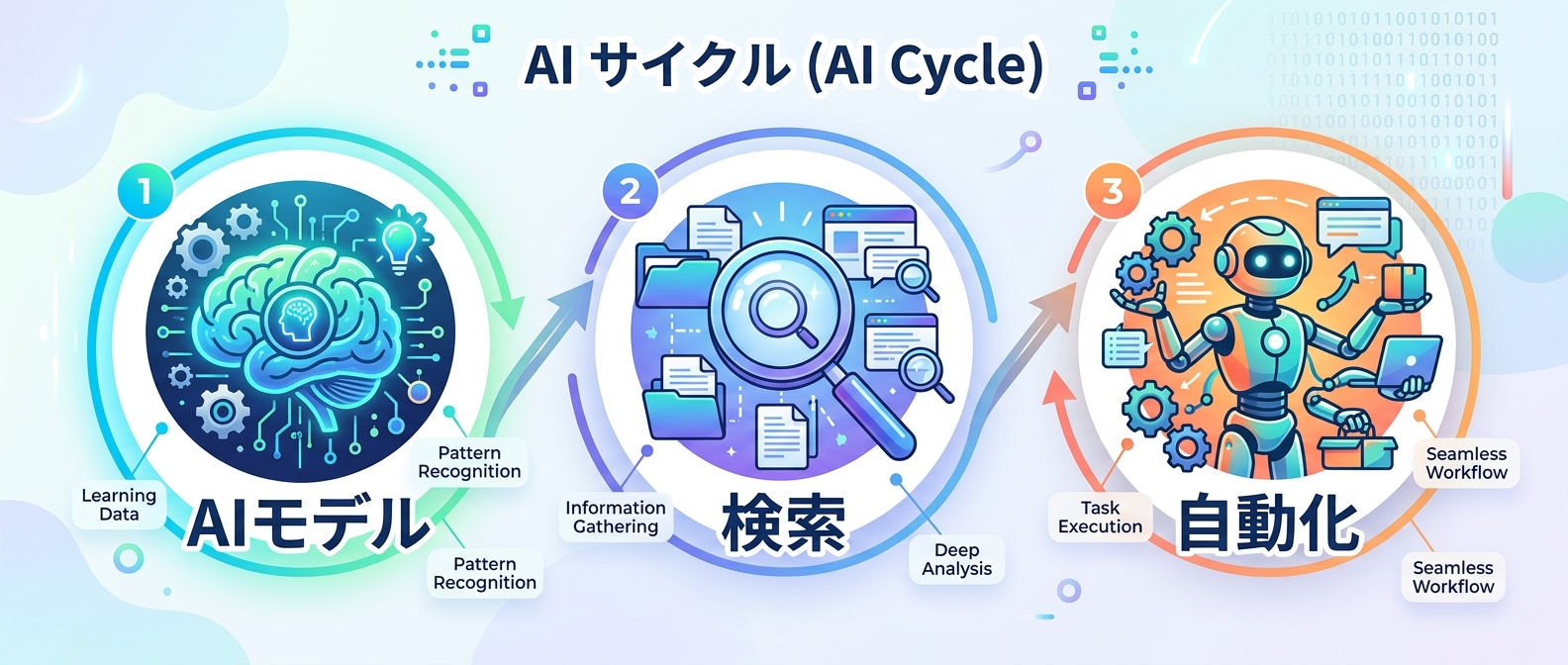

ステップ5:ローカルAIと検索ツールを組み合わせたエージェント化

最後のステップは、ローカルAIと軽量検索ツールを組み合わせて、自律的に動くAIエージェントを作る仕組みだ。巨大なプロジェクトの全ファイルをそのままAIに読み込ませると、一度に処理できる情報の限界であるトークン上限にすぐ達してしまう。クラウドのAIなら莫大な利用料金が発生する原因にもなる。

そこで、AI自身にconcept-grepのような検索ツールを使わせるアプローチをとる。AIが「この課題を解決するには、まずデータベースの設計書を読む必要がある」と判断し、自ら検索ツールを叩いて必要な情報だけを抽出する。この仕組みなら、コンテキストの制限を大幅に節約しながら、極めて精度の高い回答を得られる。

ローカル環境でこのサイクルを回せるようになれば、コストを一切気にすることなく、巨大なソースコードの解析やリファクタリングの提案をAIに任せられる。人間の開発者は、AIが提示した改善案を確認して適用するだけの、いわば監督のようなポジションに専念できるようになる。

しんたろー:

普段はClaude Codeで毎日コードを書いている身からすると、コンテキストの節約は一人開発における永遠の課題だ。

ローカルAIと軽量検索ツールを組み合わせるアプローチは、コスト削減の観点でもかなり理にかなっている。

ThreadPostの開発でも、大量の過去コードを参照する際にこの仕組みを応用できそうだ。

つまずきポイント

ローカルAIの構築で、初心者がハマりやすい罠を3つ紹介する。

- モデルの選び間違い

最初は必ず、最も軽量な4ビット量子化モデル(E4Bなど)から始めること。スペックに余裕があるからといって、いきなり数十ギガバイトもある巨大なモデルをダウンロードすると、パソコン全体がフリーズする原因になる。まずは軽いモデルで動作確認をするのが鉄則だ。

- メモリ不足による強制終了

ブラウザのタブを大量に開いたままAIを動かすと、メモリ不足でエラーになることが多い。ローカルAIはパソコンのメモリを限界まで使い切るため、実行時は他の重いアプリケーションをすべて閉じておく必要がある。

- ツールのバージョンが古い

Ollamaなどの実行ツールは、新しいAIモデルに対応するために頻繁にアップデートされている。最新のGemma 4を動かすにはバージョン0.20以上が必須になるため、エラーが出た場合はまずツールの更新を確認するといい。

比較表

ここで、今回紹介したツールと関連環境の特徴を比較表にまとめておく。

| ツール名 | 用途 | 必要なメモリ | コスト | おすすめ度 |

| --- | --- | --- | --- | --- |

| Ollama | ローカルAIの実行基盤 | 8GB〜 | 無料 | ★★★★★ |

| AI Edge Gallery | スマホでのオフライン実行 | スマホ依存 | 無料 | ★★★★☆ |

| SUMIRE-n | スプレッドシートでのAI活用 | 8GB〜 | 無料 | ★★★★☆ |

| concept-grep | 軽量な意味検索(RAG用) | 8GB〜 | 無料 | ★★★★★ |

| Claude Code | クラウドでのAIコーディング | 不要 | 有料 | ★★★★★ |

しんたろー:

僕はクラウド型のClaude Codeをメインで使っているが、機密性の高いデータや一時的なスクリプトの処理にはローカルAIが向いている。

完全オフラインで動く安心感は代えがたい。

適材適所で使い分けるのが、これからの個人開発のスタンダードになるはずだ。

FAQ

Q1: ローカルLLMを動かすのに必要なPCのスペックはどれくらいか?

A1: モデルのサイズによるが、Gemma 4の軽量版(E4B)であれば約5GBのメモリで動作する。RAMが8GBから16GB搭載された一般的なノートパソコンで十分に動かせる。より高度な推論を求める大きなモデルを動かす場合は、20GB以上のRAMや専用のグラフィックボードが必要になる。

Q2: Ollamaとは何か?なぜ必要なのか?

A2: Ollamaは、ローカル環境でAIモデルを簡単にダウンロードして実行するための必須ツールだ。通常、AIを動かすには複雑な環境構築が必要になる。しかしOllamaを使えば、簡単なコマンドを一つ入力するだけでモデルを取得し、すぐにチャットとして利用できるようになる。

Q3: クラウドのAIとローカルLLMの違いは何か?

A3: 最大の違いはデータのプライバシーと利用コストだ。ローカルLLMは自身のパソコン内で処理が完全に完結するため、機密情報を外部のサーバーに送信するリスクが一切ない。また、APIの利用料金がかからず、インターネットがないオフライン環境でも無制限に利用できる。

Q4: RAGをローカルで試すにはどうすればいいか?

A4: 通常はベクトルデータベースの構築が必要になるが、初心者にはハードルが高い。まずは今回紹介したような軽量なセマンティック検索ツールを使うのがおすすめだ。ローカルのテキストやコードを意味ベースで検索して、AIにコンテキストとして渡す仕組みをすぐに作れる。

Q5: ローカルLLMは商用利用可能か?

A5: 利用するモデルのライセンスによって異なる。Googleが公開したGemma 4はApache 2.0ライセンスで提供されているため、商用プロダクトへの組み込みも基本的に問題ない。ただし、モデルごとに利用規約が細かく異なるため、利用前に必ず公式サイトで確認するといい。

まとめ

まとめると、Gemma 4とOllamaの組み合わせによって、誰でも簡単に実用的なローカルAI環境を作れるようになった。データの外部送信リスクやAPIコストを気にせず、自分だけのAIを無限に活用できる。まずはパソコンにOllamaをインストールして、軽量なモデルを動かすところから始めよう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ

なぜClaude Codeはプロンプト一発回答をやめたのか。開発者が対話で思考を深めるべき訳を徹底解説

Claude Codeで開発を自動化する鍵は検証ゲートの設計にある

【速報】CursorがSDKとJSONL保存を正式発表。AIエージェントの検証を自動化する開発手法

CursorのDesign ModeでUI操作が自動化。サブエージェント設計への移行