結論から言うと、今は自分のPCだけで高性能なAIを動かせる。

クラウドのAPIを使うと、毎月のトークン代がかさむことも珍しくない。

でも最新のオープンモデルと最適化ツールを組み合わせれば、APIコストは完全にゼロになる。

今回は、今日から始められるローカルLLMの環境構築手順をまとめた。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

前提知識

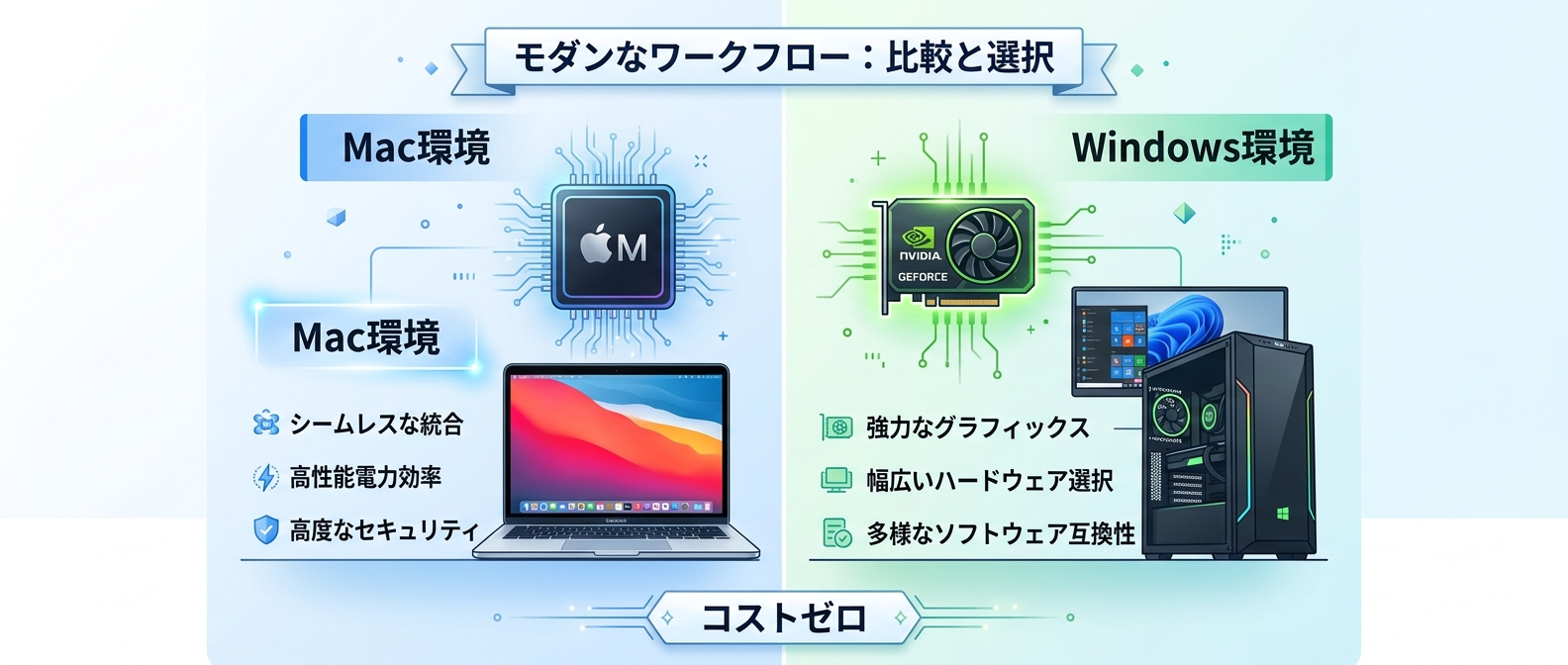

必要なものは、そこそこのスペックを持つPCとインターネット環境だけだ。

Macならメモリ32GB以上のApple Silicon搭載機がおすすめだ。

WindowsならNVIDIAのBlackwell GPUなどがあると快適に動かせる。

もちろん、ハイスペックなマシンがなくても動かせる軽量なモデルも存在する。

特別なプログラミング知識がなくても構築できる。

まずは自分のPCのスペックを確認するところから始めよう。

ステップ1: 最適なオープンモデル「Google Gemma 4」の選定

まずは頭脳となるAIモデルを選ぶところから始めよう。

結論として、Googleが公開したGemma 4が現状の最適解だ。

このモデルは完全にオープンなApache 2.0ライセンスで提供されており、商用利用も自由にできる。

以前のバージョンにあった厳しい制限がなくなり、開発者が自由に扱えるようになった。

特筆すべきは、スマホで動く超軽量版から本格的な開発向けまで、4つのサイズが用意されていることだ。

具体的には「E2B」「E4B」「26B MoE」「31B Dense」というラインナップになっている。

たとえば、モバイル端末やIoT機器での動作を想定するなら、メモリ消費が少ないE2BやE4Bを選ぶといい。

これらは画像、ビデオ、音声入力をネイティブ処理できる、非常に効率的なモデルだ。

さらに、これらのモデルは単なるチャットだけでなく、関数呼び出しにも標準で対応している。

構造化されたJSON形式の出力も得意としており、システムへの組み込みも容易だ。

複雑な論理的思考やエージェント的な動きも難なくこなしてくれる。

自分の環境に合わせて最適なサイズを選べるのが、Gemma 4の最大の強みと言える。

Gemma 4の主な特徴は以下の通りだ。

* 完全なオープンライセンスで商用利用も自由に行える

* E2Bから31Bまで用途に合わせた4つのサイズ展開がある

* 関数呼び出しや画像認識に標準で対応している

* JSON形式の出力が得意でシステムに組み込みやすい

ステップ2: Ollama 0.19によるApple Silicon環境の最適化

Macユーザーなら、Ollama 0.19というツールを使うのが一番の近道だ。

これは複雑な設定なしで、簡単にAIモデルを動かせる便利なソフトウェアだ。

最新バージョンでは、Apple独自の機械学習フレームワーク「MLX」に完全対応している。

これにより、Macの潜在能力をフルに引き出せるようになった。

要はMacのメモリ構造を最大限に活かせるようになったということだ。

従来はCPUメモリとGPUメモリが物理的に分かれており、データ転送がボトルネックになっていた。

でもMLXを使えば、そのボトルネックが解消されて推論速度が劇的に上がる。

物理的なメモリを共有するApple Siliconの強みが、ここで存分に発揮される。

特に「NVFP4」という特殊なデータ圧縮形式のモデルを指定すると効果絶大だ。

限られたメモリ帯域幅でも、信じられないほどのスピードで文章を生成してくれる。

公式のテストでも、デコードと呼ばれるトークン生成速度が約2倍になったという結果が出ている。

Mシリーズのチップを搭載したMacを持っているなら、この組み合わせを必ず設定しよう。

Mac環境で推論速度を上げるポイントは以下の通りだ。

* Apple Silicon搭載のMacを使用する

* Ollama 0.19以降のバージョンをインストールする

* MLX対応のモデルを選択する

* NVFP4圧縮フォーマットを指定してダウンロードする

ステップ3: NVIDIA GPUを活用した環境の高速化

WindowsやLinuxを使っているなら、NVIDIA製のGPUを活用するのも一つの手だ。

Jetson Orin Nanoから最新のBlackwell GPUまで幅広くサポートされている。

これらを使えば、クラウドのAIにも引けを取らない処理速度を叩き出せるはずだ。

ローカルに環境を構築すれば、24時間365日AIを稼働させても追加コストはゼロだ。

常に裏で動いている自分専用のAIアシスタントを作ることも夢ではない。

APIの利用制限や情報漏洩のリスクを気にせず、自由にデータを処理できる。

最近はハードウェアの最適化が進んでおり、コンシューマー向けのグラフィックカードでも動作する。

高額なサーバーを借りる必要はもうなく、手元のPCがそのままAI開発の拠点になる。

手元のPCのグラフィックボードを最大限に働かせて、無料でAI開発を進めよう。

Windows環境でローカルAIを快適に動かす条件は以下の通りだ。

* NVIDIA製のGPUを用意する

* 大容量のVRAM(ビデオメモリ)を確保する

* 最新のドライバを入れる

しんたろー:

クラウドのAPI料金を気にせず開発できるのは、本当にストレスフリーだ。

僕は普段Claude Codeでコードを書いているが、ローカルで動くAIがあれば、機密性の高いデータも安心して処理できる。

特にNVIDIAのGPUを使った環境は、一度構築すると手放せなくなるほど快適だ。

ステップ4: LM Studioを使った直感的なモデル管理とサーバー起動

LM Studioを使うのもおすすめだ。

これはコマンドラインから簡単にモデルのダウンロードや設定ができる便利なアプリだ。

先ほど紹介したMLX対応のモデルも、コマンド一つでロードできる。

難しい環境構築を一切意識せずに、最新のAI技術に触れることができる。

使い方はとてもシンプルで、コマンドでチャット画面を開くだけだ。

すぐに試し打ちができるので、モデルの賢さや返答のスピードを直感的に確認できる。

さらに、ローカルでAPIサーバーを立ち上げる機能も標準でついている。

コマンド一つで、自分のPCがAIのサーバーに早変わりする。

他のアプリからこのローカルサーバーに接続して、AIの機能を呼び出すことも可能だ。

初心者にとって、これほどわかりやすくローカルLLMを管理できるツールは他にない。

LM Studioの便利な機能は以下の通りだ。

* コマンドから直接モデルをダウンロードできる

* チャット画面で簡単に試し打ちができる

* コマンド一つでローカルAPIサーバーを立ち上げられる

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

ステップ5: Mastraを使ったローカルAIエージェントの開発連携

ローカルでAIが動くようになったら、次はAIエージェントの開発に挑戦してみよう。

ここで役立つのが、Mastraというフレームワークだ。

これと先ほど立ち上げたローカルサーバーを組み合わせることで、ローカルLLMの実験が簡単にできる。

通常、AIエージェントのテストには何度もAPIを呼び出すため、クラウドだとコストが膨れ上がる。

でもローカルモデルを使えば、何度失敗してもお金は一切かからない。

安心してプログラムの挙動を確認できるのは、開発者にとって大きなメリットだ。

エラーが出ても気兼ねなくリトライできる環境は、学習スピードを加速させる。

Mastraを使うメリットは以下の通りだ。

* APIコストを完全にゼロにしてテストを繰り返せる

* ローカルLLMの実験が簡単にできる

* プログラムの挙動を安心して確認できる

しんたろー:

普段はClaude Codeで1人SaaS開発をしているんだけど、ローカルモデルの検証用としてこの構築手順はかなり役立っている。

Claude Codeは推しツールとして毎日使っていて、クラウドの賢さは圧倒的だが、ちょっとした実験やコストを抑えたいタスクにはローカルLLMが最適だ。

実際、ローカル環境でテストしてからClaude Codeに渡すことで、開発の精度とスピードが格段に上がった。

つまずきポイント

ローカルLLMの構築で初心者がハマりやすい罠を3つ紹介する。

事前に知っておけば、無駄な時間を過ごさずに済む。

* PCのメモリ不足でモデルが動かない

一番多いのが、PCのスペック以上の大きなモデルを選んでしまうミスだ。

メモリが足りないと、エラーが出てAIが起動すらしない。

最初は一番小さい「E2B」などのモデルから始めて、徐々にサイズを上げていくといい。

* モデルの保存場所がわからなくなり容量を圧迫する

AIのモデルデータは数GBから数十GBと非常にサイズが大きい。

色々なモデルをダウンロードしていると、あっという間にPCのストレージがいっぱいになる。

Ollamaではモデルが `~/.ollama` 以下に保存され、35Bクラスのモデルは20GB前後のディスク容量を使うため、空き容量を確認してからダウンロードしよう。

* MLXバックエンドの性能を引き出せない

既存のQ4_K_Mフォーマットのモデルをそのまま動かしても、劇的な速度改善は得られない場合がある。

MLXバックエンドの性能を最大限に引き出すには、NVFP4フォーマットのモデルを使う必要がある。

比較表

ここで、ローカルLLM環境を構築するための代表的なツールを比較してみる。

自分のスキルや目的に合わせて選んでほしい。

| ツール名 | 特徴 | 対象ユーザー | おすすめ度 |

| :--- | :--- | :--- | :--- |

| Ollama | コマンドで軽快に動作し、MLXバックエンドに対応 | 中級者〜開発者 | ★★★★★ |

| LM Studio | Mac (Arm) に最適化されたMLX版のモデルをロードできる | 初心者〜中級者 | ★★★★★ |

| Mastra | ローカルLLMをサクッと実験できるフレームワーク | アプリ開発者 | ★★★★☆ |

FAQ

ローカルLLMを動かすのに必要なPCのスペックは?

目的のモデルサイズによって必要なスペックは大きく変わる。

Gemma 4のE2BやE4Bのような軽量モデルなら、モバイルデバイスやIoTハードウェアでも動作する。

一方で大型モデルを快適に動かすには、Macなら32GB以上のメモリ、WindowsならBlackwell GPUなどが必要だ。

OllamaとLM Studioのどちらを使えばいい?

用途と自分の好みに応じて選ぶのが正解だ。

MLXバックエンドやNVFP4フォーマットを活用したいならOllamaがおすすめだ。

Mac (Arm) に最適化されたMLX版のモデルを手軽にロードしたいなら、LM Studioが向いている。

Gemma 4のモデルサイズはどう選べばいい?

実行するPCの環境と、やらせたいタスクの複雑さで判断する。

モバイルデバイスやIoTハードウェアでの動作を想定するなら、メモリ消費が少ないE2BやE4Bで事足りる。

ワークステーションやサーバーでの本格的な開発を求める場合は、十分なPCスペックを用意した上で26B MoEや31B Denseの大型モデルを選ぶと高い精度が得られる。

MacでAIの推論速度を上げるコツは?

Appleの機械学習フレームワーク「MLX」に対応したツールを使うことが最重要だ。

Ollama 0.19以降などを利用すれば、Macの構造を活かして処理速度を劇的に向上できる。

さらに、モデルをダウンロードする際に「NVFP4」などの効率的な圧縮フォーマットを指定することで、より高速な文章生成が可能になる。

Mastraとは何?なぜローカルLLMと組み合わせるの?

Mastraは、ローカルLLMをサクッと実験できるフレームワークだ。

ローカルLLMと組み合わせる最大の理由は、開発中のテストにかかるAPIコストをゼロにできることだ。

ローカルモデルでテストを繰り返すことで、安心してプログラムの挙動を確認できる。

まとめ

今回は、APIコストをゼロにするローカルLLM環境の構築手順を解説した。

Gemma 4のような高性能なモデルと最適化ツールを使えば、誰でも手元でAIを動かせる。

まずは自分のPCにLM StudioやOllamaをインストールするところから始めよう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【速報】CursorがSDKとJSONL保存を正式発表。AIエージェントの検証を自動化する開発手法

CursorのDesign ModeでUI操作が自動化。サブエージェント設計への移行

【2026年版】レガシーシステムを刷新する仕様駆動開発|導入ステップ5選

CursorのJira連携でコード開発はどう変わるか。AIエージェントによる自動化の裏側を徹底解説

なぜAI攻撃は自律化したのか。Claude Code開発者が教える防御的アーキテクチャの完全ガイド