結論から言うと、クラウドの圧倒的な性能を求めるならGemini 2.0、エッジデバイスでのローカル動作やプライバシーを重視するならGemma 3シリーズがおすすめだ。

最近はAIモデルの選択肢が増えすぎて、どれをプロジェクトに採用すべきか迷う人も多いはずだ。

特にオープンウェイトモデルの進化は著しく、商用モデルとの境界線が曖昧になってきている。

今回は、商用フラッグシップモデルと最新のオープンウェイトモデルを徹底的に比較していく。

要件に合わせて最適なモデルを選ぶための参考にしてほしい。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

比較のポイント:クラウドかローカルか

モデルを選ぶ際に見るべきポイントは大きく3つある。

それぞれのプロジェクトが抱える制約や目的に応じて、優先すべき項目は変わってくる。

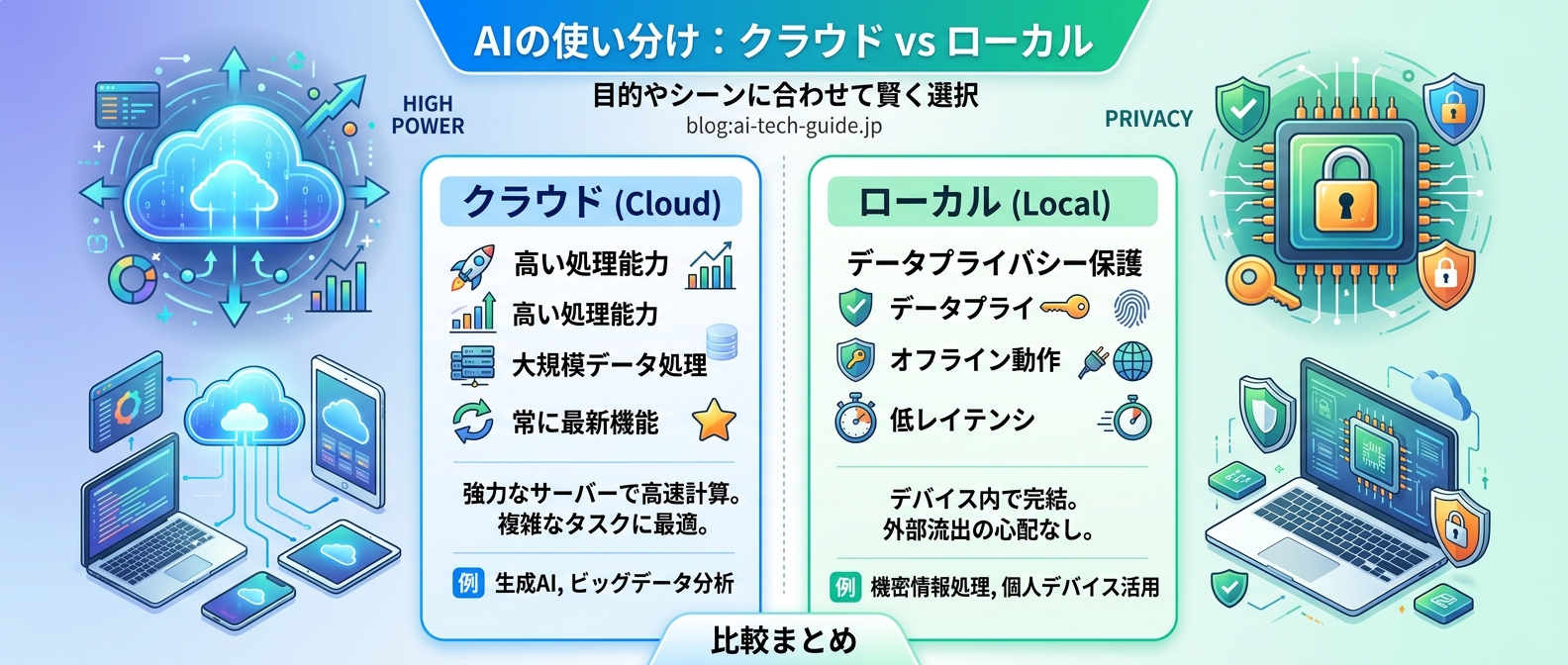

1つ目は処理を実行する環境がクラウドかローカルかという点だ。

クラウドモデルは巨大な計算資源を活用できるため、複雑な推論や大規模なデータ処理に強い。

一方で、ローカルモデルは手元のデバイスで完結するため、オフライン環境でも動作し、機密データの外部流出を防ぐことができる。

2つ目は消費電力や必要なマシンスペックといった効率性になる。

サーバー上で動かすのか、スマートフォンやIoTデバイスのようなリソースが限られた環境で動かすのかによって、選ぶべきモデルのサイズは全く異なる。

特にモバイル環境では、バッテリー消費をいかに抑えるかが重要な課題となる。

3つ目は複雑な推論能力やマルチモーダル対応などの機能性だ。

テキストだけでなく、画像、音声、動画を同時に処理できる能力が求められるケースが増えている。

これらを基準に、最新の3モデルを詳しく見ていこう。

各モデルの徹底解説

1. Gemma 3n:エッジで動くマルチモーダルAI

Gemma 3nは、エッジデバイス向けに設計されたモバイルファーストのオープンウェイトモデルだ。

最大の特徴は、画像、音声、動画、テキストをネイティブサポートするマルチモーダル性を備えていることだ。

これまでクラウド上の巨大なモデルでしか実現できなかったような高度な処理を、手元の端末だけで実行できる。

ローカルで動くため、プライバシーを気にするプロジェクトには最適な選択肢と言える。

具体的な強みは以下の通りだ。

- 画像、音声、動画、テキストをネイティブサポートするマルチモーダル性

- E2Bモデルなら最小2GB、E4Bモデルでも最小3GBのメモリで動作する高い効率性

- ローカルで動くためプライバシーを気にするプロジェクトに最適

高価なGPUを積んだサーバーを用意しなくても、一般的なノートPCやスマートフォンで十分に動かせる。

エッジデバイス上でリアルタイムにユーザーの音声を認識し、画像を解析するといったアプリ開発で大いに役立つはずだ。

例えば、スマートフォンのカメラで撮影した映像をリアルタイムに解析し、音声でフィードバックを返すような視覚サポートアプリの構築も可能になる。

一方で、クラウドベースの巨大なフロンティアモデルと比較すると、複雑な論理的推論や高度なコーディング能力では劣る。

あくまでエッジでの効率性とマルチモーダル処理に特化したモデルだと理解しておく必要がある。

それでも、手元の端末だけで完結するセキュアなAIアプリを作りたい開発者にとっては、非常に魅力的なモデルだ。

2. Gemma 3 270M:超小型で省電力な特化型AI

Gemma 3 270Mは、パラメータ数がわずか2.7億という超小型のオープンウェイトモデルだ。

このモデルの最大の強みは、圧倒的な省電力性とコンパクトさにある。

スマートフォン上で動かした場合、25回の会話を行ってもバッテリー消費はたったの0.75パーセントに収まる。

モバイル端末やIoTデバイスで常にバックグラウンドで稼働させるような用途には、これ以上ないほど適している。

主な特徴は以下の通りだ。

- パラメータ数がわずか2.7億という圧倒的なコンパクトさ

- 25回の会話を行ってもバッテリー消費は0.75パーセントという超省電力性

- 25万6000トークンの語彙サイズを持ちファインチューニングに最適

特定タスク向けのファインチューニングのベースモデルとしても非常に優秀だ。

巨大な語彙サイズを持っているため、専門用語や特定の言語への適応力が高い。

決まった形式でデータを出力させたり、特定のドメイン知識だけを学習させたりするのに向いている。

スマートウォッチの通知要約や、センサーデータのリアルタイム解析など、リソースが極端に限られた環境での活躍が期待できる。

例えば、工場の機械に取り付けたセンサーから異常を検知し、即座にアラートを出すようなシステムにも組み込める。

ただし、汎用的で複雑な会話や、高度な論理的推論を必要とするユースケースには全く向いていない。

何でもできる万能なAIを求めているなら、別のモデルを選ぶべきだ。

用途を極限まで絞り込むことで、その真価を最大限に発揮するモデルと言える。

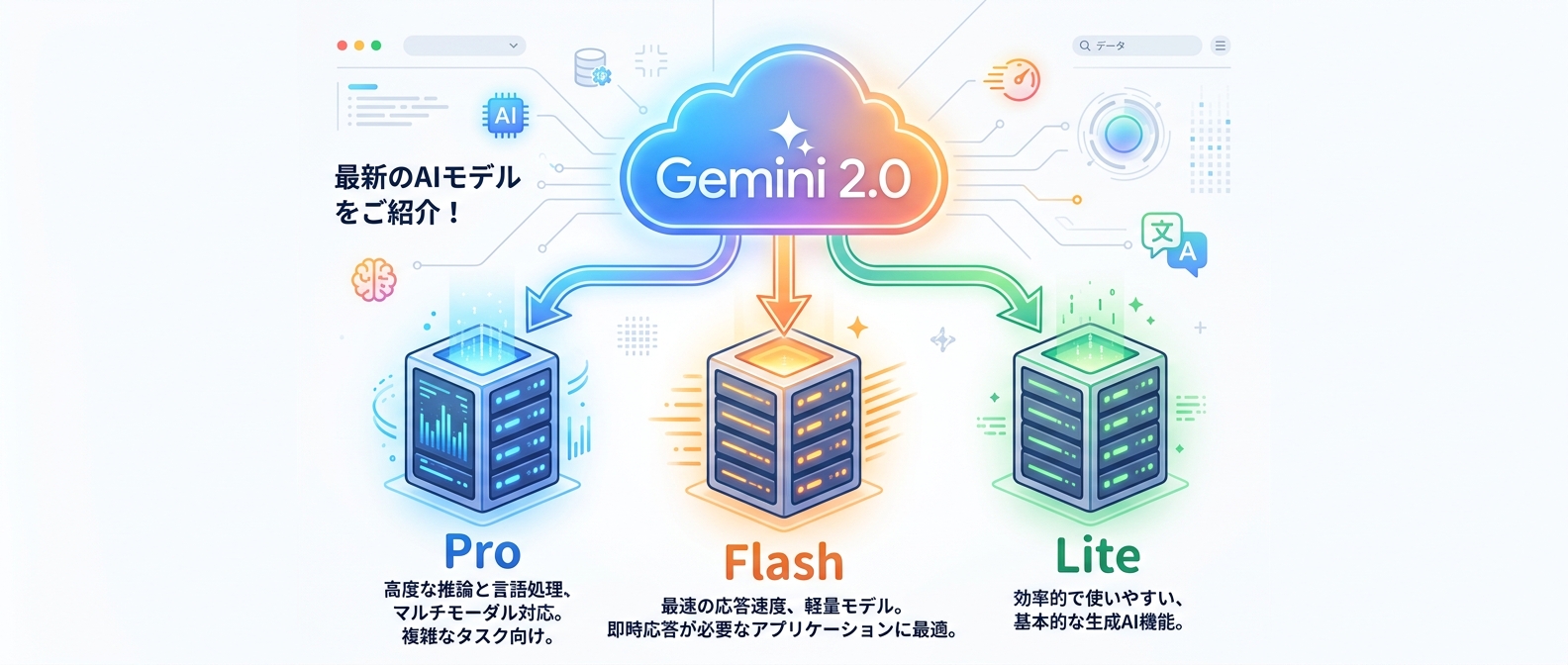

3. Gemini 2.0:クラウドの圧倒的パワーを誇るフラッグシップ

Gemini 2.0は、Googleが提供する最新の商用フラッグシップモデル群だ。

オープンウェイトモデルとは異なり、クラウド上で動作し、API経由で利用する形になる。

圧倒的な推論能力と処理速度を求めるなら、間違いなくこのモデルが第一候補になる。

用途や予算に合わせて、以下の3つのバリエーションから柔軟に選択できるのが特徴だ。

- 複雑なプロンプトや高度なコーディングに強いProモデル

- 低遅延で高パフォーマンスを実現するFlashモデル

- コストを極限まで抑えたFlash-Liteモデル

最上位のProモデルは、複雑なプロンプトの解釈や高度なプログラミングコードの生成に強い。

一方、Flashモデルは低遅延で高パフォーマンスを実現しており、リアルタイム性が求められるチャットボットなどに最適だ。

大量のデータを一瞬で処理したり、複雑な論理パズルを解かせたりと、クラウドの計算資源をフル活用したパワフルな処理が得意だ。

膨大な社内ドキュメントを読み込ませて、高精度な社内FAQシステムを構築するような用途にも適している。

デメリットとしては、完全なオフライン環境では動作しない点が挙げられる。

API経由での通信が必須となるため、機密性の高いデータを扱う場合はセキュリティ要件の確認が必要になる。

また、従量課金などの利用料金が発生するため、コスト管理も重要だ。

まずは無料枠のある環境でFlashモデルなどを試し、プロンプトの反応や処理速度を体感してみるのがおすすめだ。

比較表:用途に合わせた最適な選択肢

各モデルの特徴とおすすめの用途を一覧表にまとめた。

プロジェクトの要件と照らし合わせて確認してほしい。

特に動作環境と推論能力のバランスを見極めることが、プロジェクト成功の鍵を握る。

| モデル名 | 動作環境 | 推論能力 | 効率・省電力性 | おすすめの用途 |

| --- | --- | --- | --- | --- |

| Gemma 3n | ローカル | 中〜高 | 高 | エッジでのマルチモーダルアプリ、セキュアなローカル処理 |

| Gemma 3 270M | ローカル | 低(特化型) | 極めて高 | モバイル・IoTでの常時稼働、特定タスクのファインチューニング |

| Gemini 2.0 | クラウド | 極めて高 | クラウド依存 | 高度な推論、複雑なコーディング、大規模データ処理 |

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

用途別おすすめと開発者の本音

ここまで3つのモデルを比較してきたが、結局どれを選ぶべきか迷う人もいるはずだ。

結論としては、プロジェクトの制約と目的によって明確に使い分けるのが正解になる。

クラウドの強力な計算資源を前提にできるなら、Gemini 2.0一択だ。

特に複雑なロジックを組んだり、大量のテキストを処理したりするタスクでは、他の追随を許さない。

エンタープライズ向けのシステム開発や、高度なデータ分析基盤の構築には欠かせない存在になる。

一方で、ユーザーのプライバシーを最優先に考えるアプリや、オフライン環境でも動作させたい場合は、Gemma 3nが輝く。

マルチモーダル対応でありながらローカルで動くのは、開発者にとって非常に魅力的だ。

医療データや個人の金融情報を扱うような、セキュリティ要件が極めて厳しいプロジェクトでも安心して採用できる。

さらに、ウェアラブル端末やIoT機器のような極端にリソースが限られた環境なら、Gemma 3 270Mの出番になる。

特定のタスクに特化させて組み込むことで、バッテリー消費を気にせずAIの恩恵を受けられる。

それぞれの強みを理解し、適材適所で組み合わせていくのが今のAI開発のトレンドだ。

一つのモデルに全てを任せるのではなく、用途に応じて複数のモデルを連携させるアーキテクチャが主流になっていく。

しんたろー:

Claude Codeで毎日コード書いてる身からすると、複雑な推論が必要な場面ではクラウドモデルの強さを痛感する。

理由はシンプルで、コンテキストの理解力とコード生成の精度が圧倒的だからだ。

ただ、手元で軽く動かせるGemma 3シリーズの機動力もかなり良さそうだ。

今後、ローカルで動くAIの需要は確実に増えていくはずだ。

しんたろー:

僕は1人SaaSとしてThreadPostを開発しているが、機能ごとにモデルを使い分ける重要性を常に感じている。

重い処理はクラウドに投げつつ、UIの即時フィードバックにはローカルの軽いモデルを挟むような設計が理想的だ。

Gemma 3 270Mのような超小型モデルは、ちょっとしたタスクの振り分け役に使うと面白そうだ。

コストとパフォーマンスのバランスを取るのが開発者の腕の見せ所になる。

よくある質問(FAQ)

AIモデルの選択や導入について、初心者がつまずきやすい疑問をまとめた。

オープンウェイトモデルと商用APIモデルの違いは何?

オープンウェイトモデルは、モデルのデータが公開されており、自分のPCやスマホなどのローカル環境にダウンロードして動かせるAIのことだ。

カスタマイズの自由度が高く、オフラインでも利用できる。

一方、商用APIモデルはクラウド上で動作し、インターネット経由でアクセスして利用する。

高度な推論が可能だが、データ通信が必要で利用料がかかる場合がある。

プロジェクトの予算やセキュリティ要件に合わせて選択する必要がある。

Gemma 3nを動かすにはどれくらいのPCスペックが必要?

Gemma 3nは非常に効率的に設計されており、高価なGPUは必須ではない。

E2Bモデルであれば最小2GB、E4Bモデルであれば最小3GBのメモリで動作する。

一般的なノートPCや、場合によってはスマートフォンなどのエッジデバイス上でも十分に動かすことが可能だ。

手軽にローカルAIの開発を始められるのが大きなメリットになる。

開発環境の構築ハードルが低いのも魅力の一つだ。

Gemini 2.0 FlashとProはどう使い分ければいい?

Gemini 2.0 Flashは応答速度が速くコストパフォーマンスに優れているため、チャットボットや大量のデータ処理など、リアルタイム性が求められる用途に最適だ。

一方、Gemini 2.0 Proは、複雑なプロンプトの解釈や高度なプログラミングコードの生成、論理的な推論が求められる専門的なタスクに向いている。

まずはFlashで試し、精度が足りない部分をProで補うのが賢い使い方だ。

コストと性能のバランスを見極めることが重要になる。

Gemma 3 270Mはどのような用途に向いている?

パラメータ数が2.7億と非常に小さく、超低消費電力で動作するため、スマートフォンやIoTデバイスでの常時稼働タスクに最適だ。

複雑な会話には向かないが、特定の専門用語を学習させたり、決まった形式でデータを出力させたりするタスク特化型のファインチューニングのベースモデルとして非常に優秀だ。

用途を絞り込むことで真価を発揮するモデルと言える。

スマートウォッチの通知要約などが代表的なユースケースになる。

ローカルでAIを動かすメリットは何?

最大のメリットは、セキュリティとプライバシーを確実に保護できることだ。

機密情報や個人データをクラウドに送信せずに処理できるため、情報漏洩のリスクを極限まで抑えられる。

また、インターネット接続がないオフライン環境でも利用でき、APIの利用料金や通信遅延を気にせず使える点も大きな魅力になる。

セキュアでレスポンスの速いアプリを作りたい場合に最適だ。

通信環境が不安定な場所での利用にも適している。

まとめ

今回は、最新のAIモデルであるGemma 3n、Gemma 3 270M、Gemini 2.0の3つを比較した。

クラウドの圧倒的な性能を活用するか、エッジデバイスでの効率性とプライバシーを重視するかで、選ぶべきモデルは大きく変わる。

まずは無料枠のある環境や手元のPCで実際に動かしてみて、それぞれのモデルの特性を肌で感じてみるのがおすすめだ。

自分のプロジェクトに最適なAIを選び抜き、開発を加速させるといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ