SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

1. なぜ今、ローカルAI環境が必要なのか

結論から言うと、Googleがリリースした最新モデルのGemma 4が圧倒的に優秀だからだ。

Gemma 4はオープンウェイトモデルとして公開されており、Apache 2.0ライセンスで誰でも利用できる。

情報漏洩のリスクを気にせず、機密データを使った開発や分析ができるのが最大のメリットだ。

社外秘のドキュメントや未公開のソースコードを扱う場合、クラウドAIの利用はセキュリティの観点から制限されることが多い。

しかし、ローカル環境に構築したAIであれば、外部と通信することなく安全に処理を実行できる。

今回は、この最新AIをローカル環境で動かすための具体的な手順を5つのステップで解説する。

初心者でも順番通りに進めればすぐに始められる。

複雑なプログラミングの知識がなくても、便利なツールを使えば直感的に操作できるはずだ。

2. 環境構築を始める前の前提知識

ローカル環境の構築に必要なものは、インターネットに繋がったパソコンだけだ。

特別な専用機器や高額なソフトウェアは一切必要ない。

まずは手持ちのパソコンを使って、AIの基本機能に触れてみるのがおすすめだ。

ただし、AIを動かすにはパソコンのメモリやグラフィックボードの性能が重要になる。

特にVRAMと呼ばれるグラフィックメモリの容量が、動かせるAIの賢さに直結する。

自分のパソコンのスペックを事前に確認しておくと、その後の手順がスムーズに進む。

もし手元のパソコンのスペックが足りなくても、ブラウザを利用する回避策がある。

Google AI Studioを使えば、セットアップ不要で高性能なモデルを試すことができる。

自分の環境に合わせて柔軟に構築できるのが、現在のローカルAIの強みだと言える。

3. ステップ1:Gemma 4の最適なモデルを選ぶ

環境構築の第一歩は、自分のパソコンのスペックに合ったモデルを選ぶことだ。

Gemma 4には用途と性能に合わせて4つの異なるサイズが用意されている。

パソコンのVRAM容量と相談して決める必要がある。

以下の比較表を参考にして、どのモデルから試すか検討するといい。

| モデル名 | 特徴 | 必要なVRAM目安 |

|---|---|---|

| E2B | 超軽量でエッジデバイス向け | 約1.5GB |

| E4B | 軽量かつ実用的な性能のバランス型 | 約2.5GB |

| 26B MoE | 高性能な推論特化型で複雑な処理向け | 約13GB |

| 31B Dense | 最高品質のフラッグシップモデル | 約16GB |

一般的なノートパソコンを使っているなら、まずはE4Bから始めるのがおすすめだ。

約2.5GBのVRAMで動作するため、多くのパソコンで快適に動かすことができる。

文章の要約や簡単なコード生成であれば、このサイズでも十分に実用的なレベルだ。

一方で、より高度な論理的推論や複雑なタスクを求めるなら26B MoEが選択肢に入る。

ただし、このモデルは全パラメータをメモリに展開する必要があるため、約13GBのVRAMを消費する。

見た目の数字以上にメモリを消費するため、ハイスペックなパソコンを用意する必要がある。

まずは軽量モデルで全体の流れを掴んでから、徐々に大きなモデルに挑戦するといい。

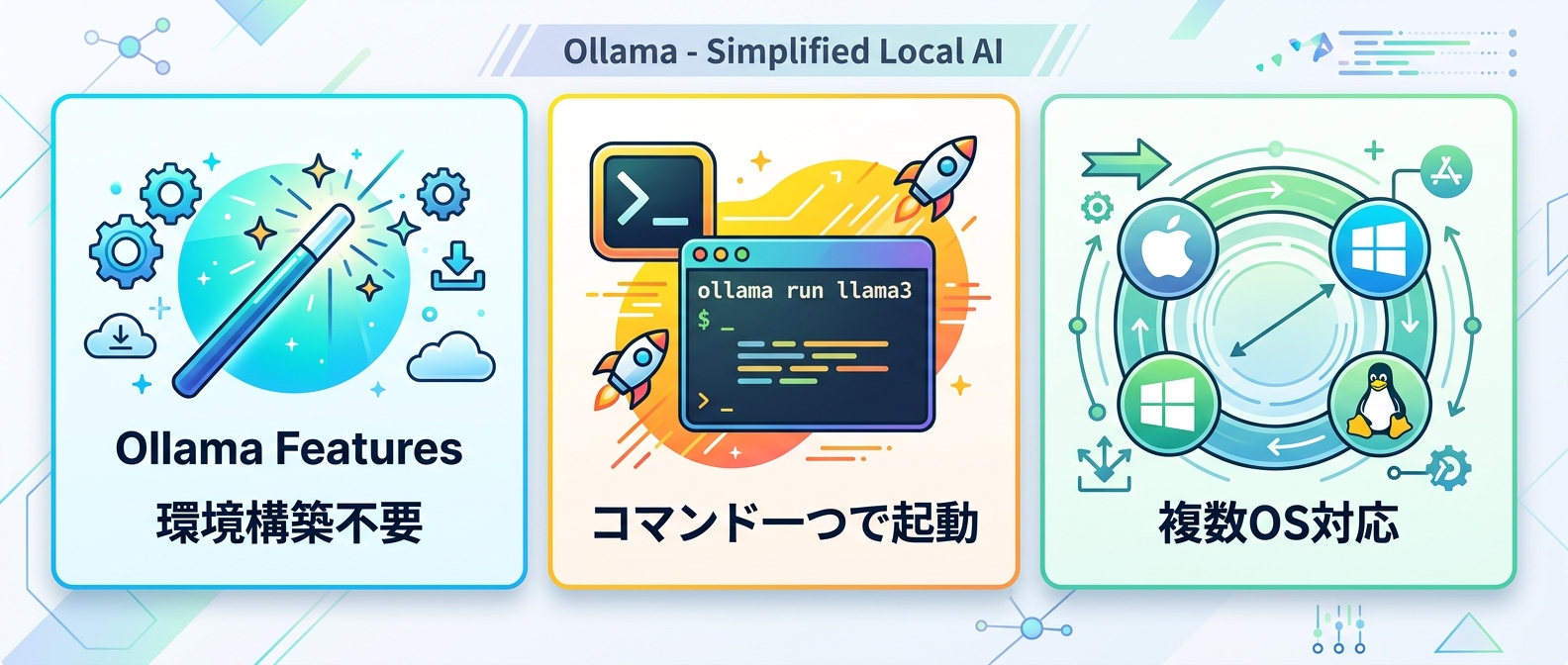

4. ステップ2:Ollamaをインストールする

モデルが決まったら、次はAIを動かすための土台となるツールを準備する。

ローカルでAIを動かすなら、Ollamaというツールを使うのがおすすめだ。

複雑な環境構築や依存関係の解決を自動で行ってくれる。

Ollamaを導入するメリットは以下の通りだ。

* ワンコマンドでローカル実行できる

* APIサーバーとしても動作する

* マルチモーダル(画像入力)に対応している

導入手順は非常にシンプルで、ターミナルからインストールコマンドを実行するだけだ。

インストールが終わると、パソコンのバックグラウンドでOllamaのサービスが常駐するようになる。

これでAIをいつでも呼び出せる準備が整ったことになる。

ターミナルを開いて、専用のコマンドを打ち込むといい。

ここでエラーが出なければ、正常にインストールが完了している証拠だ。

モデルのダウンロードから実行まで、すべてこのコマンドラインから操作できる。

初心者にとってハードルが高く感じるはずだが、使うコマンドは数種類しかないためすぐに慣れることができるはずだ。

5. ステップ3:ローカル環境でGemma 4を動かす

Ollamaの準備ができたら、いよいよGemma 4を自分のパソコンで動かすといい。

ターミナルに「ollama run gemma4」というコマンドを入力して実行キーを押すだけだ。

特定のサイズを指定したい場合は、モデル名の後ろにコロンをつけて「e4b」などと追記する。

初回だけはモデルのデータをダウンロードするため、時間がかかる。

しかし、ダウンロードが完了すればすぐにチャット画面が立ち上がり、AIとの対話が始められる。

2回目以降はパソコン内にデータが保存されているため、すぐに起動するようになる。

完全にオフラインの状態でAIと会話できる感動を、味わうといい。

ローカルでGemma 4を動かすと、以下のようなタスクが実行できる。

* プログラミングコードの生成

* 技術的な概念の解説

* 画像データの内容説明

Gemma 4はテキストだけでなく画像も認識できるマルチモーダル機能を備えている。

コマンドの最後にオプションとして画像ファイルのパスを指定するだけで、画像を読み込ませることができる。

たとえば、画像に何が写っているかを説明させるといった使い方が可能だ。

APIサーバーとして起動するコマンドを使えば、自分で開発しているアプリにAIを組み込むこともできる。

しんたろー:

普段はClaude Codeで1人SaaS開発をしている僕から見ても、Ollamaの手軽さは素晴らしい。

コマンドラインツールに慣れている開発者なら、息をするようにAIを操作できるはずだ。

別のオープンモデルであるLlama 4なども気になっているので、近いうちに同じ手順で試してみるつもりだ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

6. ステップ4:高度な設定でThinking Modeを活用する

Gemma 4を単なるチャットボットとして使うだけではもったいない。

このモデルの真価は、推論能力を飛躍的に高めるThinking Modeにある。

これはAIが最終的な回答を出す前に、内部で問題の分解や中間計算、仮説検証を行う強力な機能だ。

Thinking Modeを活用することで、以下のような効果が得られる。

* 問題の分解と中間計算の実行

* 特定ドメインでの精度向上

* 複雑な推論タスクの処理

この機能を最大限に引き出すには、Pythonを使った高度な制御が必要になる。

具体的には、HuggingFace Transformersというライブラリを使ってAIを呼び出す。

システムプロンプトと呼ばれるAIへの事前指示に、専用のタグを埋め込むだけで有効化できる。

このタグを認識したAIは、複雑な計算に対して深い思考プロセスを展開する。

プログラミングの文脈では、この思考プロセスを経ることで高いコーディング能力を発揮できる。

競技プログラミングのCodeforcesにおいて、世界上位数%に匹敵するELO 2150という数値を記録している。

開発者としてAIの挙動を根本からコントロールしたいなら、この設定は避けて通れない。

少し専門的な知識が必要になるが、挑戦する価値は十分にあると言える。

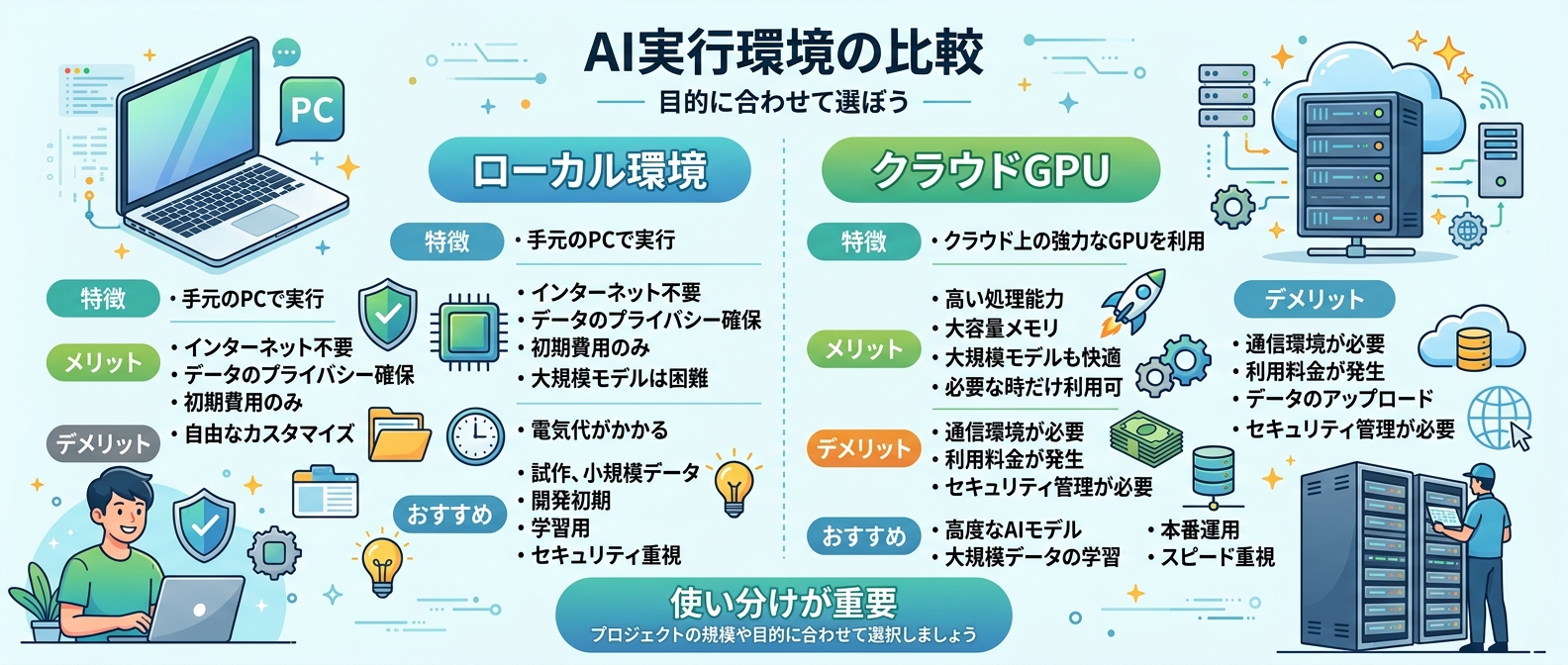

7. ステップ5:ブラウザ環境で大規模モデルを動かす

ここまでの手順を踏んでも、パソコンのスペック不足で大きなモデルが動かないことがある。

そんな時に活用したいのが、Google AI Studioを使ったブラウザ環境での実行だ。

強力なGPUを備えたサーバーをクラウド上に用意し、手軽にモデルを試すアプローチだ。

Google AI Studioの活用には、以下のメリットがある。

- セットアップが不要

- ブラウザだけで完結

- GUIから直感的に操作可能

具体的な手順としては、ブラウザからアクセスしてモデルを選択するだけだ。

そこに画像入力やシステムプロンプトの設定を行い、すぐに推論を実行できる。

31B Denseや26B MoEといった大規模モデルも、この環境なら問題なく動作する。

手元のパソコンのスペックに依存せず、最高品質のAIを体験できる。

この方法の最大のメリットは、パソコンの買い替え費用を大幅に節約できることだ。

必要な時だけブラウザを開いて大規模モデルを動かせば、コストと手間を最小限に抑えられる。

30Bクラスの最高品質モデルを試したい開発者にとって、このツールの活用は必須のスキルだ。

8. しんたろーの体験とローカルAIの可能性

ローカルAIの進化スピードは凄まじく、数ヶ月前の常識がすぐに通用しなくなる。

Gemma 4の登場で、オープンモデルの実用性は大きく向上した。

自分の環境に合わせてモデルを選び、必要に応じてブラウザ環境を組み合わせる柔軟さが重要だ。

しんたろー:

僕が開発しているThreadPostというSNS運用ツールでも、AIの推論能力は要になっている。

日々の機能追加やバグ修正はClaude Codeに任せきりだが、ローカルAIの進化も常に見逃せない。

外部にデータを出せない機密性の高いタスクでは、今回構築したGemma 4の環境が確実に活きるはずだ。

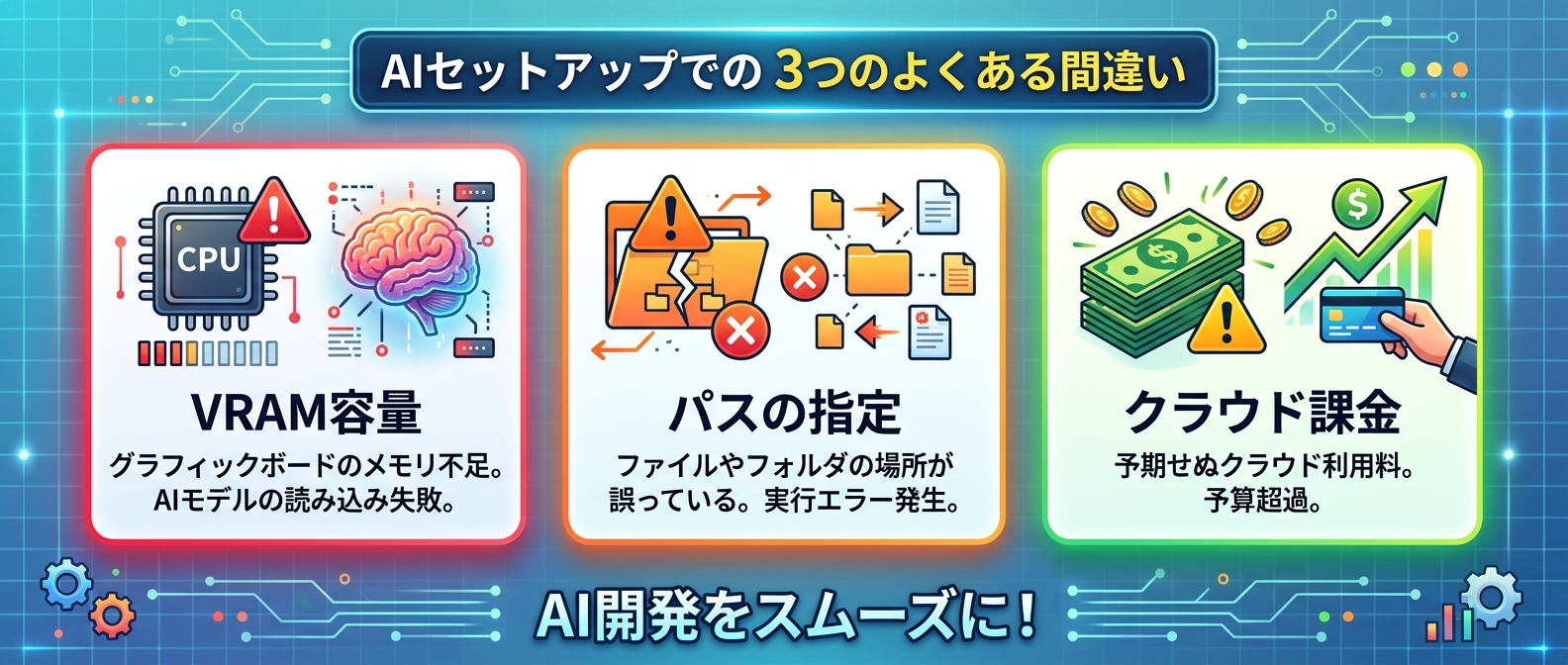

9. 環境構築における3つのつまずきポイント

初心者がローカルAI環境の構築でハマりやすい罠を3つ紹介する。

事前に知っておけば、無駄な時間を溶かさずに済むはずだ。

- VRAM容量の見積もり間違い

モデルのサイズ選びで一番多い失敗がこれだ。

特にMoEと呼ばれるアーキテクチャのモデルは、見た目のパラメータ数以上にメモリを消費する。

推論時に使う一部のパラメータだけでなく、全体のデータをメモリに乗せる必要があるからだ。

必ず総パラメータ数を基準にして、自分のパソコンのVRAMに収まるか確認するといい。

- コマンドの打ち間違いやパスの指定ミス

ターミナルでの操作に慣れていないと、些細なスペルミスでエラーを引き起こす。

特に画像を読み込ませる際のファイルパスの指定は間違いやすいポイントだ。

相対パスと絶対パスの違いを理解し、正しい場所を指定できているか何度も確認するといい。

- 量子化設定による精度劣化の無視

VRAMを節約するためにINT4などの量子化を行うと、モデルの精度がわずかに低下する。

NF4量子化であれば全精度と比較してベンチマーク差は1〜3%程度に収まる。

メモリ削減のメリットと精度劣化のトレードオフを理解した上で設定を選ぶ必要がある。

10. ローカルAI環境構築に関するFAQ

ローカル環境でGemma 4を動かす際によくある疑問をまとめた。

Q1: Gemma 4を動かすのに必要なPCのスペックは?

モデルのサイズによって必要なVRAM容量は大きく異なる。

最小のE2Bモデルで約1.5GB、バランス型のE4Bモデルで約2.5GBのVRAMが必要だ。

高性能な26B MoEモデルは約13GB、最上位の31B Denseモデルは約16GBを消費する。

特にMoEモデルは全パラメータをメモリに展開するため、総パラメータ数基準でVRAMを見積もる必要がある。

Q2: Thinking Modeとは何か?

AIが最終的な回答を出力する前に、内部で問題の分解や中間計算を行う高度な推論機能だ。

これにより、複雑な問題に対する回答の精度が大幅に向上する仕組みになっている。

Gemma 4では全モデルにこの機能が標準で搭載されている。

システムプロンプトに専用のタグを追加するだけで、誰でも簡単に有効化できる。

Q3: 自分のPCのスペックが低くても高精度モデルを試せるか?

パソコンのスペックが低くても高精度なモデルを試す方法は確実に存在する。

ブラウザから手軽に使えるGoogle AI Studioを利用する方法だ。

セットアップ不要で画像入力やシステムプロンプトの設定もGUIから行える。

クラウド上の強力なGPUを利用するため、手元のパソコンの性能は一切関係なくなる。

Q4: Gemma 4は商用利用できるか?

結論から言うと、Gemma 4は制限なく商用利用が可能だ。

以前のモデルからライセンスが大きく変更され、オープンソースで広く使われているApache 2.0ライセンスが採用された。

これにより、他の主要なオープンモデルと同じ基準で扱えるようになっている。

企業が自社のサービスやプロダクション環境へ組み込む際のハードルが劇的に下がったと言える。

Q5: Ollamaで画像を読み込ませるにはどうすればいいか?

Ollamaを使えばコマンドラインから非常に簡単な手順で画像を入力できる。

実行時にオプションとしてイメージ指定のコマンドを使い、画像ファイルのパスを追記するだけだ。

これにより、指定した画像とテキストプロンプトを組み合わせた高度な画像認識を行わせることができる。

画像に何が写っているかの解析などがすぐに実行できる。

11. まとめ:今日からローカルAIを始めよう

Gemma 4とOllamaを組み合わせれば、誰でも簡単に強力なローカルAI環境を手に入れられる。

パソコンのスペックに合わせてモデルを選び、足りなければブラウザ環境を活用するのが賢いアプローチだ。

まずは軽量なモデルからダウンロードして、AIとの対話を体験するといい。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ

なぜClaude Codeはプロンプト一発回答をやめたのか。開発者が対話で思考を深めるべき訳を徹底解説

Claude Codeで開発を自動化する鍵は検証ゲートの設計にある

【速報】CursorがSDKとJSONL保存を正式発表。AIエージェントの検証を自動化する開発手法

CursorのDesign ModeでUI操作が自動化。サブエージェント設計への移行