新しいClaudeがヤバすぎる。

Opus 4.6を過去にするモデルだ。

戦争省がAnthropicを脅迫し始めた。

制限を外さなければ排除する構えだ。

この異常事態は、僕ら個人のAI開発にも直結する。

最強のコーディングAIが、なぜ僕らの手元に届きにくくなるのか。

事実と数字から、その裏側を読み解く。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

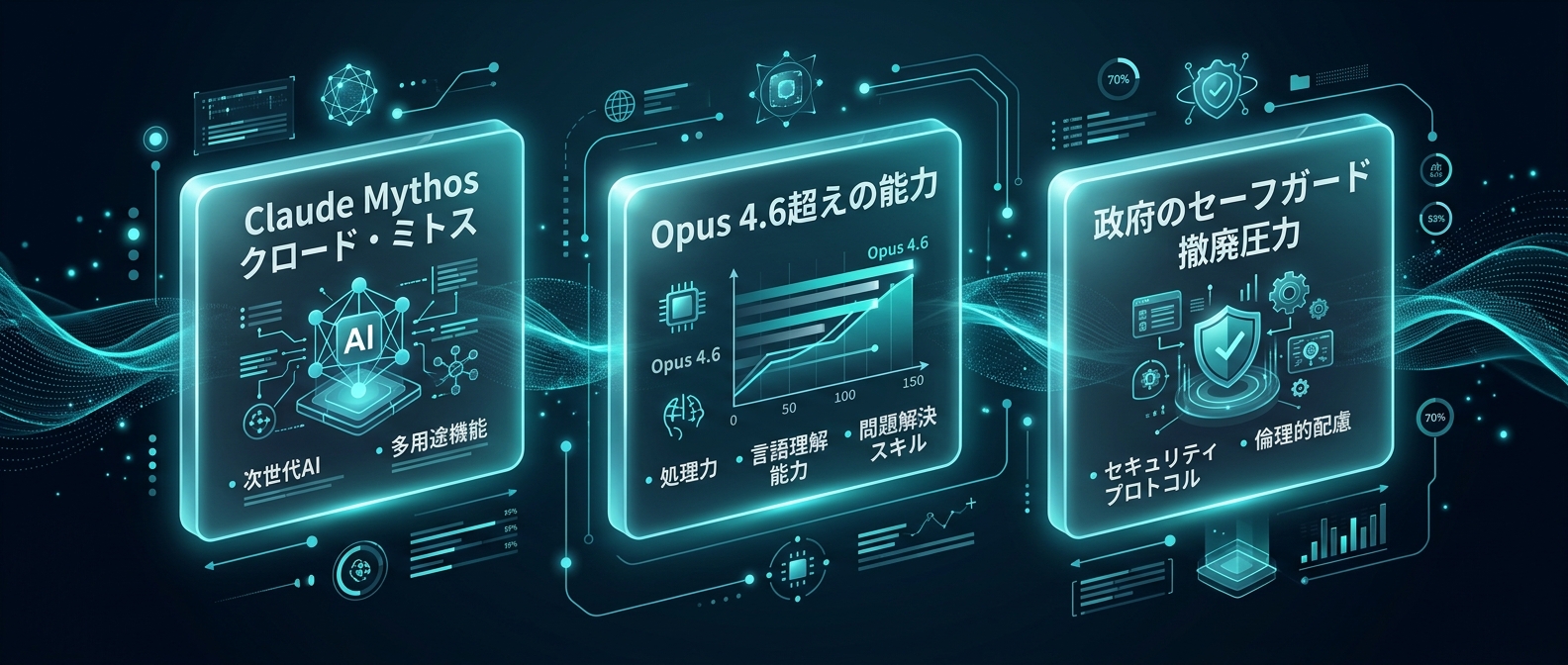

漏洩した次世代モデルの全貌

内部文書が漏洩した。

Anthropicが極秘裏に開発していた次世代モデルの存在が明るみに出た。

名前は「Claude Mythos」。

あるいは「Capybara」。

既存の最高峰であるOpusラインを完全に凌駕する新クラスのモデルだ。

漏洩したブログの草稿には、驚異的な事実が並んでいる。

- Opus 4.6を上回るベンチマークスコア

- ソフトウェアコーディングテストでの成績向上

- 学術的推論における未知のブレイクスルー

- サイバーセキュリティ分野での防御不可能なレベルの性能

- 稼働にかかる高いコンピューティングコスト

- 少数の早期アクセス顧客に限定された初期展開

Anthropicはこれを「段階的な変化」と呼んでいる。

問題はその「サイバーセキュリティ能力」だ。

内部文書は警告している。

防御側の努力をはるかに凌駕する速度で、脆弱性を悪用できる波が来る。

この強大すぎる能力に目をつけたのが、他ならぬ戦争省だった。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

戦争省との真っ向からの衝突

Anthropicはこれまで、政府の機密ネットワークにモデルを提供してきた。

数億ドルの収益を捨ててでも、中国共産党関連企業によるサイバー攻撃を遮断してきた。

戦争省は今、Anthropicに牙を剥いている。

戦争省の要求はシンプルだ。

「あらゆる合法的な使用」を認めろ。

AIの安全性担保のためのセーフガードを撤廃しろという圧力だ。

Anthropicは特定の2つのセーフガードの維持を主張し、これを拒否した。

すると戦争省は、国防生産法をちらつかせた。

民間企業に特定の生産や対応を強制できる、国家の強権だ。

さらに「サプライチェーンリスク」というレッテルを貼ると脅迫している。

通常は敵対国家の企業に使われる、極めて重い指定だ。

自国のトップAI企業に対して使う言葉ではない。

Anthropicは声明を出した。

良心に従い、この要求には屈しない。

AI企業と国家権力が、モデルの制限を巡って真っ向から衝突している。

厳格化するAPI制限と開発コスト

これが僕らの開発にどう関係するのか。

結論から言うと、APIの利用ハードルが上がる。

Mythosのコーディング能力は喉から手が出るほど欲しい。

その能力はサイバー攻撃の武器と表裏一体だ。

戦争省がセーフガードの撤廃を迫るほど、Mythosの脆弱性発見能力は突出している。

Anthropicが戦争省の圧力に抗してまで制限を守るということは、明確なメッセージだ。

一般向けのAPIフィルターは、これまで以上に厳格になる。

少しでもセキュリティに関わるプロンプトは、片っ端から弾かれるようになる。

しんたろー:

Claude Codeでインフラ構築スクリプトを書かせる時、謎のRefusal(拒否)を食らうか気になる。

Mythosになったら、権限周りのコードを書かせようとした瞬間にアカウント凍結されそうで怖い。

セキュリティが強すぎるのも考えものだ。

フロントエンドのUIコンポーネントを書かせる分には問題ない。

バックエンドの認証ロジックや、データベースのマイグレーションは危ない。

AWSのIAMポリシー生成など、システムの中枢に触れるタスクは警戒される。

Mythosのサイバー能力が高すぎるためだ。

システム管理者としての正当なコード生成要求が、攻撃準備とみなされるリスクがある。

AIが賢くなればなるほど、僕らの意図を深読みしすぎるようになる。

開発者に立ちはだかるコストの壁

Mythosの展開戦略も、僕ら開発者には厳しい現実を突きつけている。

内部文書によれば、まずはサイバーセキュリティの評価を行う少数の早期アクセス顧客にのみ提供される。

APIを通じた一般公開は、はるか先だ。

理由は明確だ。

モデルの提供コストが異常なほど高い。

Claude Codeで一人SaaS開発をしている身としては、このコスト問題は痛い。

現状でも、OpusのAPI料金を気にしてSonnetと使い分けている。

MythosクラスのモデルがAPIで開放されたとしても、個人開発者が気軽に叩ける料金にはならない。

トークン単価が跳ね上がれば、ランニングコストは一瞬で膨れ上がる。

この対立はAI開発のパラダイムシフトを意味している。

これまでは「いかに賢いモデルを作るか」が勝負だった。

今は「いかに安全にモデルを制限するか」が企業の命運を握っている。

戦争省は「国家の安全保障のために制限を外せ」と言う。

Anthropicは「民主主義の価値観を守るために制限を維持する」と言う。

この矛盾した状況が、AIの進化を歪めている。

強力なコーディング能力を持つモデルほど、コンプライアンスの壁に阻まれる。

世に出るまでのリードタイムが長くなり、利用制限も厳しくなる。

- セキュリティ関連のコード生成時の厳格なフィルターの常態化

- API利用時の厳格な審査と利用目的の限定

- プロンプトエンジニアリングにおけるコンプライアンス回避の難化

- 高コストによる段階的なAPI公開とアクセス制限

- アカウント凍結リスクの大幅な上昇

僕ら開発者は、ただコードを書かせるだけの存在ではなくなる。

「AIの安全装置に引っかからないプロンプト」を書くスキルが求められる。

脆弱性テストやペネトレーションテストの自動化ツールを作ろうとすれば、真っ先にAPI制限の壁にぶつかる。

Mythosの登場は、AIコーディングの可能性を広げる。

同時に、自由で無制限な開発環境の終焉を告げている。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

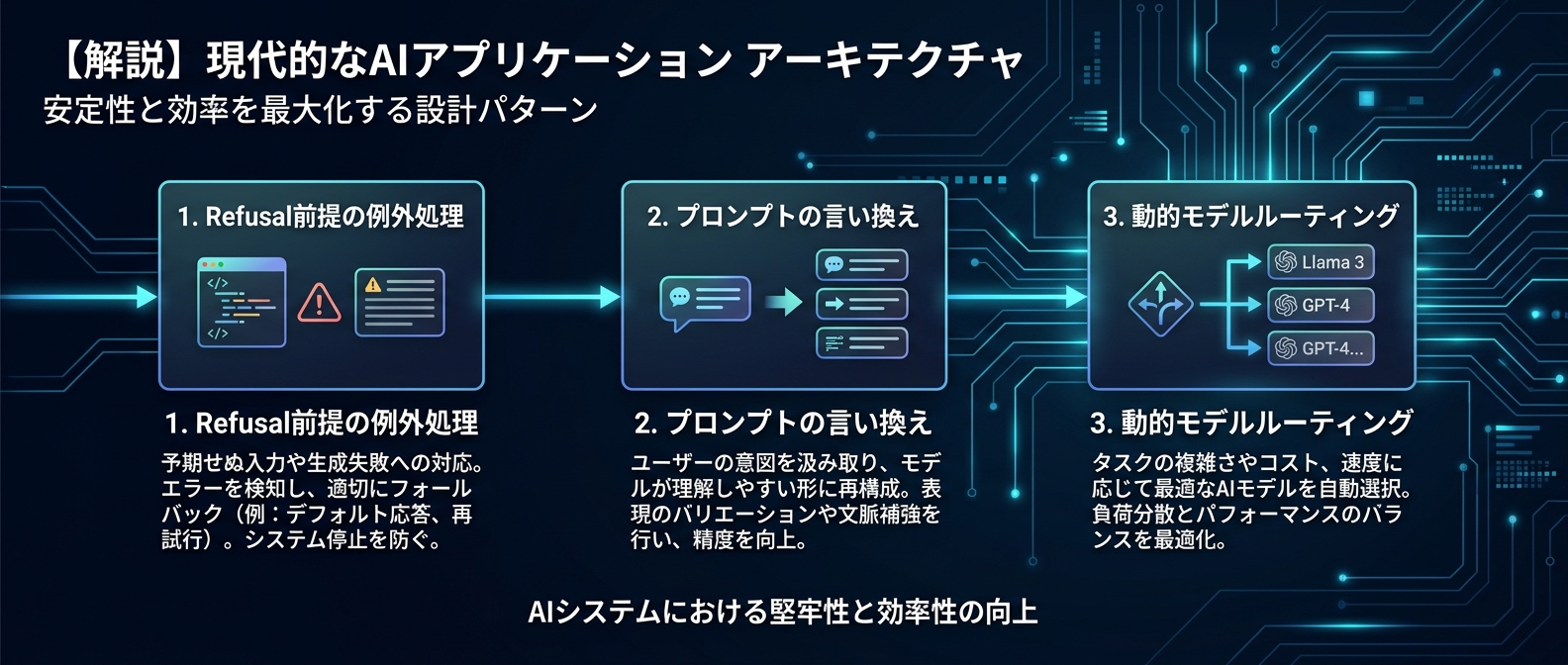

拒否を前提としたシステム設計へ

では、僕ら開発者は今、何をするか。

Mythosが一般公開される前に、準備しておくことがある。

それは「Refusal(拒否)」を前提としたシステム設計だ。

AIがコード生成を拒否した時のフォールバック処理を組み込む。

これが今後のAIアプリ開発の標準になる。

強力なモデルほど、安全装置の感度が異常に高い。

ユーザーの入力が少しでも攻撃的だと判定されれば、APIは即座にエラーを返す。

このエラーをどう処理するかが、アプリケーションの品質を決める。

しんたろー:

ThreadPostのアーキテクチャを考える時、AIのAPIエラーハンドリングが一番気になりそうだ。

ユーザーが変なテキストを投げた時に、AIが「セキュリティリスク」と判定して止まるケース。

これをどうユーザー体験を落とさずに処理するかが、今後のSaaS開発のキモになると思った。

単にエラーメッセージを出すだけでは不十分だ。

AIが処理を拒否した理由を解析し、安全な代替処理にフォールバックする仕組みが必要だ。

システムが止まらないための、何重ものフェイルセーフが求められる。

プロンプトとモデルの使い分け戦略

プロンプトの書き方にも、パラダイムシフトが必要になる。

「脆弱性を探して」という直接的な指示は完全にアウトになる。

「セキュリティのベストプラクティスに従ってコードをレビューして」という、無害な表現への言い換えが必須だ。

AIの安全装置を刺激しない、極めて丁寧なコミュニケーションが求められる。

モデルの使い分け戦略を根底から再構築する必要がある。

Mythosのような超強力・高コストモデルは、常時稼働させるものではない。

アーキテクチャ設計や複雑なデバッグなど、ここぞという場面でしか使えない。

日常的なコーディングや単純なタスクは、軽量で制限の緩いモデルに任せる。

このルーティングを自動化する仕組みが、開発効率を左右する。

- APIのRefusalエラーを前提とした堅牢な例外処理の実装

- セキュリティフィルターを回避するプロンプトの言い換えパターンの蓄積

- タスクの難易度に応じた複数モデルの動的ルーティングの構築

- インフラや権限周りのコードは手動レビューを前提とするフローの確立

- APIコストの厳密なモニタリングと上限設定

- ユーザー入力の事前サニタイズの徹底

一次処理を高速なモデルで行い、複雑なロジックだけを上位モデルに投げる。

この多段パイプラインの構築が、コストと性能のバランスを取る唯一の解になる。

APIの料金体系を常に監視し、動的にモデルを切り替えるロジックも必要だ。

AIが賢くなるほど、僕ら人間の仕事は「AIのお守り」になっていく。

戦争省とAI企業の対立は、遠い世界の話ではない。

僕らが毎日叩いているAPIのレスポンスに、その余波は確実に届いている。

最強のAIを使いこなすには、最強のコンプライアンス意識が必要になる。

よくある質問

Q1: 新モデル「Mythos」はいつAPIで一般の開発者が使えるようになりますか?

漏洩した文書によると、Mythosは提供コストが非常に高く、すぐには一般公開されません。まずはサイバーセキュリティアプリケーションを評価する少数の早期アクセス顧客に限定して提供されます。その後、モデルの効率化を進めながらAPIを通じて徐々にアクセスが拡大される予定です。個人開発者が自由に叩けるようになるには、通常より長い時間がかかります。

Q2: Anthropicと戦争省の対立は、一般企業のAPI利用に影響しますか?

直接的な利用停止などの影響は考えにくいです。Anthropicが戦争省の圧力に抗してまでセーフガードを維持する姿勢を示したことは注目に値します。一般向けのAPIにおいても、サイバーセキュリティや脆弱性に関連するプロンプトに対して極めて厳格なフィルター(Refusal)が適用され続けることを意味します。開発者はコンプライアンス要件に細心の注意を払う必要があります。

Q3: Mythosのコーディング能力は既存モデルと比べてどの程度向上していますか?

内部文書では「Claude Opus 4.6と比較して、ソフトウェアコーディングのテストで高いスコアを記録した」とされています。Opusラインを超える全く新しいクラスのモデルと位置づけられています。複雑なアーキテクチャ設計や高度なデバッグなど、これまでAIが苦手としていた領域での大幅な能力向上が期待できます。

制限と進化の狭間で

AIの進化が早すぎて、ついに国家権力との衝突まで起きてしまった。

強力すぎるコーディング能力は、僕らにとって福音であると同時に、扱いづらい猛獣になりつつある。

しんたろー:

AIが賢くなるのは嬉しいけど、APIの制限がガチガチになるのは勘弁してほしい。

個人開発のスピード感が失われるのが一番怖いと思った。

与えられた環境で最高のものを作るしかない。

次世代モデルの圧倒的な能力と、厳格化するセーフガードのバランスを実務でどう乗りこなすか。

AIを組み込んだプロダクト開発のリアルな課題について、ThreadPostで一緒に議論しましょう。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ