SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIコスト最適化の主戦場が、モデルの賢さから「設計」に移った

プロンプトキャッシュの1時間TTL対応。MCPによるツール自律探索。バッチ処理設計の標準化。

この3つが同時に動き始めている。

モデルの性能を上げるより、APIをどう叩くかの設計でコストが10倍変わる。Claude Codeの最新アップデートがそれを象徴している。

Claude Codeが静かに変えていること

最新バージョンのClaude Codeにアップデートが入った。

プロンプトキャッシュのTTL制御が追加された。環境変数「ENABLE_PROMPT_CACHING_1H」を設定すると、キャッシュの有効期限を1時間に延長できる。従来は5分TTLがデフォルトだった。API Key、Bedrock、Vertex、Foundryの全環境で対応している。

Claude Codeはセッション中、コードベース全体のコンテキストを何度も読み込む。1時間TTLにより、同じコンテキストを繰り返しトークンとして消費せずに済む。長時間のコーディングセッションほど、キャッシュヒット率が上がる。

次にMCPとスラッシュコマンドの自律探索だ。モデルが「Skill tool」を通じて、「/init」「/review」「/security-review」といったビルトインコマンドを自分で発見して呼び出せるようになった。

AIが自分でツールを探索して、適切なコマンドを選んで実行する。エージェントとしての自律性が上がった。

その他のアップデートも実務直結のものがある。

- 「/recap」機能の追加: セッションに戻ったときに文脈を再構築する

- 「/undo」が「/rewind」のエイリアスに変更

- 「/model」切り替え時の警告: モデル変更時にキャッシュが無効になる警告が表示される

- エラーメッセージの改善: サーバーのレート制限とプランの使用量制限が区別される

ファイル読み込みのメモリフットプリント削減も入っている。言語グラマーをオンデマンドで読み込む方式に変更された。

しんたろー:

「/model切り替えでキャッシュが全部消える」の警告が気になる。知らずにモデルを変えてコストが跳ね上がる事故は起きるはずだ。アップデートの地味さと実用性のバランスがこのバージョンはいい。

「どこにAIを入れるか」の設計判断が、コストを決める

Next.jsアプリにClaude AIを3箇所組み込んだ実装がある。コスト・レイテンシ・UXのバランスで「自動 / 遅延 / オンデマンド」を使い分ける設計だ。

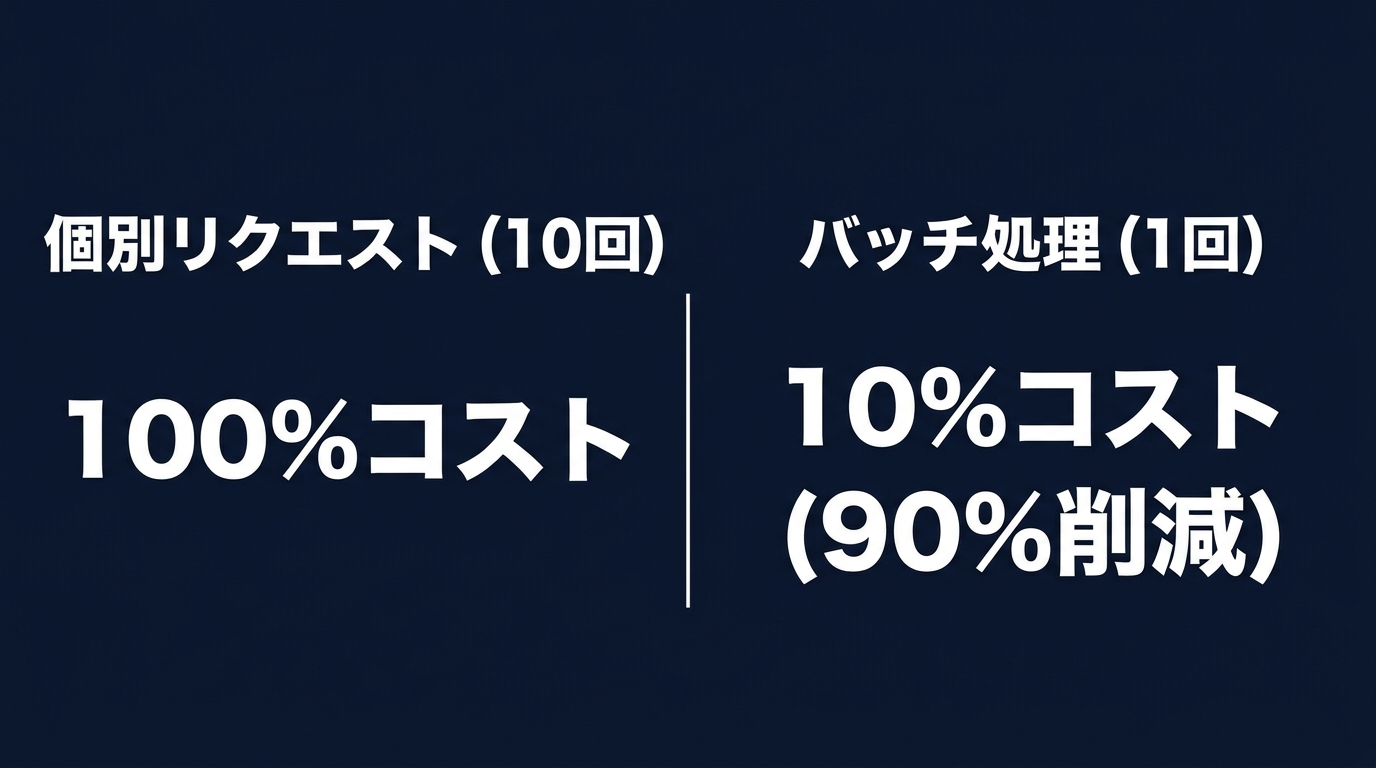

検索結果のカード10枚がそれぞれAI要約をリクエストすると、10回のAPIコールが走る。N+1問題だ。クライアント側のキューで収集し、100msのdebounceで1回のバッチAPIコールに集約する手法が取られている。

10回が1回になる。単純計算でAPIコストが90%削減される。

モデルの選択も合理的だ。翻訳と要約が中心のユースケースなら、Claude Haikuクラスで十分な品質が出る。レイテンシも小さく、コストも抑えられる。

日本語検出による条件付き翻訳も実装されている。英語で検索しているのに翻訳APIを呼ぶのは無駄だ。正規表現で日本語文字が含まれる場合だけ翻訳処理を走らせる。条件分岐一つで、不要なAPIコールをゼロにする。

この設計思想は以下の通りだ。

- AIが必要な場所だけにAIを入れる

- リクエストをまとめてバッチ化する

- 条件分岐で不要なコールを避ける

- モデルはユースケースに合わせて選ぶ

- キャッシュを積極的に使う

これは純粋にエンジニアリングの問題だ。

ここにClaude Codeの1時間TTLキャッシュが重なる。Claude Codeは「AIエージェントをどう設計すべきか」のリファレンス実装として機能している。

MCPの話もここに繋がる。MCP(Model Context Protocol)は、AIと外部ツールを繋ぐ標準規格だ。データベース、API、ローカルファイルとの連携部分を共通化できる。

Claude CodeがMCPに対応し、モデルが自律的にコマンドを探索・実行できるようになった。AIに指示を出す人間から、AIが自分でタスクを完遂する環境を設計する人間への役割シフトが起きている。

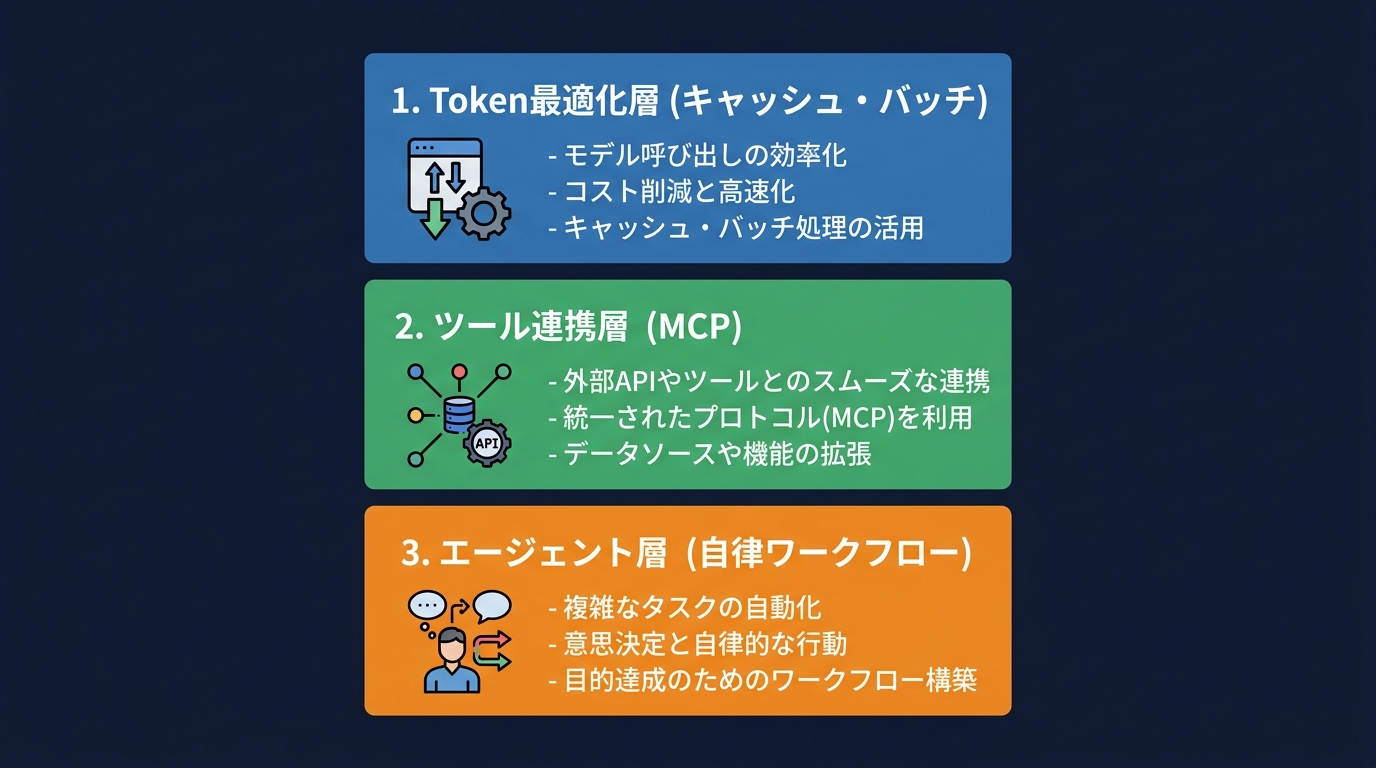

AI工学の知識体系で整理すると、今起きていることはこうだ。

- Token最適化層: プロンプトキャッシュ、バッチ処理でトークン消費を減らす

- ツール連携層: MCPで外部リソースとの接続を標準化する

- エージェント層: 自律的なタスク実行と判断ループを設計する

この3層を意識して設計できるエンジニアと、そうでないエンジニアの差が、APIコストと開発速度に直結している。

しんたろー:

バッチ処理の設計は自分で実装すると考えることが多い。debounceの待機時間、タイムアウト処理、キャッシュの無効化タイミング。Claude Codeがこれを内部でやってくれてるのを見ると、こういう設計が正解なのかと思う。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

今すぐ知っておくべき実務への影響

キャッシュ戦略は後回しにしない

Claude CodeのENABLE_PROMPT_CACHING_1Hを設定する。デフォルトの5分TTLのままだと、長いセッションで同じコンテキストを何度もトークン消費する。

自前のAPIアプリでも同じ考え方が使える。頻繁に参照するシステムプロンプトやコンテキストは、キャッシュに乗せる設計にする。

バッチ処理の設計を先に決める

N+1問題はAI APIでも起きる。UIで複数の要素がそれぞれAPIを叩く設計は、コスト爆発を招く。

対策は単純だ。

- クライアント側でリクエストをキューに積む

- 一定時間(100ms程度)待機してまとめる

- 1回のAPIコールでまとめて処理する

- レスポンスを各リクエストに振り分ける

この設計を最初から入れるか、後から入れるかで、実装コストが大きく変わる。

MCPの標準化の流れに乗る

MCPは2024年11月のリリースから普及している。Claude Codeが対応し、各社のツールが続々とMCPサーバーを実装している。

自分のアプリにAIを組み込む場合、ツール連携部分をMCPで設計しておくと、後から別のAIモデルやクライアントに切り替えやすくなる。標準規格に乗った方が長期的にメンテナンスコストが下がる。

モデルの選択はユースケースドリブンで

翻訳・要約・分類のような処理に最大性能のモデルを使う必要はない。Claude Haikuクラスで十分な品質が出るユースケースは多い。

判断の基準はシンプルだ。

- 高度な推論が必要か → Yes なら上位モデル

- レイテンシが重要か → Yes なら軽量モデル

- コストが制約になるか → Yes なら軽量モデル+バッチ処理

この3つを確認してからモデルを選ぶ。

「/model切り替えでキャッシュが消える」を覚えておく

Claude Codeで作業中にモデルを切り替えると、それまで積み上げたプロンプトキャッシュが全部無効になる。次のレスポンスでフルコンテキストを再読み込みする。コストが一時的に跳ね上がる。

長いセッションの途中でモデルを切り替えるときは、このコストを意識する。

しんたろー:

MCPの普及スピードが速い。半年前は標準規格になるかどうかの議論だった。今はClaude Codeが標準装備でサポートして、モデルが自律的にコマンド探索する段階まで来ている。ThreadPostのようなSaaSでも、外部ツール連携をMCPで設計しておくべきか検討が必要だ。

よくある質問

Q. AIのAPIコストを抑えるために、開発者がまず取り組むべきことは?

プロンプトキャッシュの活用とリクエストのバッチ化だ。

プロンプトキャッシュは、頻繁に参照するコンテキストをキャッシュに乗せることでトークン消費を削減する。Claude CodeのようにキャッシュTTLを制御できる環境では、1時間TTLに設定するだけでコストが変わる。

バッチ処理は、複数のAPIリクエストを1回のコールにまとめる設計だ。UIで10個の要素がそれぞれAPIを叩く設計は、10倍のコストがかかる。クライアント側でキューを作り、100ms程度のdebounceでまとめてから1回のAPIコールで処理する。これだけでAPIコストとレイテンシの両方が改善される。

Q. MCP(Model Context Protocol)を導入するメリットは?

MCPは、AIモデルと外部ツールを接続するための標準規格だ。

従来はツールごとに個別の実装が必要だった。データベースに繋ぐコード、外部APIを呼ぶコード、ファイルを読み書きするコードを、AIの出力に合わせて個別に書く必要があった。MCPを使うと、この連携部分が共通化される。

開発者はAIに何をさせるかというロジックの設計に集中できる。Claude CodeのようにMCPに対応したツールを使うことで、AIが自律的にリポジトリ内のコードを読み書きしたり、セキュリティレビューを実行したりするワークフローを、標準化されたプロトコル上で構築できる。

Q. Claude Codeの「/recap」機能は何に使うのか?

長期プロジェクトでのコンテキスト復元に使う。

開発作業は途中で中断することが多い。別のタスクをこなしてからClaude Codeのセッションに戻ると、前回どこまで何をやっていたかのコンテキストが薄れる。「/recap」を使うと、セッションの文脈を再構築したサマリーを出力する。

設定は「/config」から変更でき、席を外した後に自動で起動する「CLAUDE_CODE_ENABLE_AWAY_SUMMARY」環境変数も用意されている。長いコーディングセッションの途中で別の作業を挟んだ後や、翌日に昨日の作業を再開するときに「/recap」を叩くと、前回のコンテキストをAIが整理して提示する。

まとめ

モデルが賢くなることより、どう叩くかの設計でコストが変わる時代になった。

Claude Codeの1時間キャッシュ対応、MCPの自律探索、バッチ処理の設計思想。これらは全部、同じ方向を向いている。AIをどう使うかではなく、AIをどう設計に組み込むかが、開発者の差別化になる。

AIエージェントの設計思想を自作アプリに落とし込む方法、ThreadPostで深掘りしている。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ