SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AI導入とセキュリティの崩壊

AIの経済効果は15.7兆ドル。

しかし、本番環境へのAI導入に成功した企業は25%。

巨大AI企業が世界的なコンサルティングファーム5社と提携した。

企業へのAI導入が加速する。

同時に、AIによる自律的な脆弱性発見と攻撃の自動化も進んでいる。

防御側の開発者は、アーキテクチャの転換を迫られている。

巨大AI企業とコンサルティングファームの戦略的提携

巨大AI企業が、世界トップクラスのコンサルティングファーム5社と戦略的提携を結んだ。

エンタープライズ企業におけるAI導入の壁を破壊する狙いがある。

AIの経済効果は2030年までに15.7兆ドルと試算されている。

実稼働環境でAIを大規模に展開できている組織は25%。

残りの75%は、概念実証の段階にある。

提携の柱は3つある。

1つ目は、業界特化型のAIソリューションの共同開発だ。

金融、製造、小売といった業界に対し、スケーラブルなAIシステムを構築する。

2つ目は、最先端のフロンティアモデルへの早期アクセス権の付与だ。

コンサルファームの顧客は、未公開のAIモデルを業務パイプラインに組み込める。

3つ目は、経営層への直接的なAI戦略支援だ。

トップダウンでの意思決定を促し、組織全体のAIトランスフォーメーションを推進する。

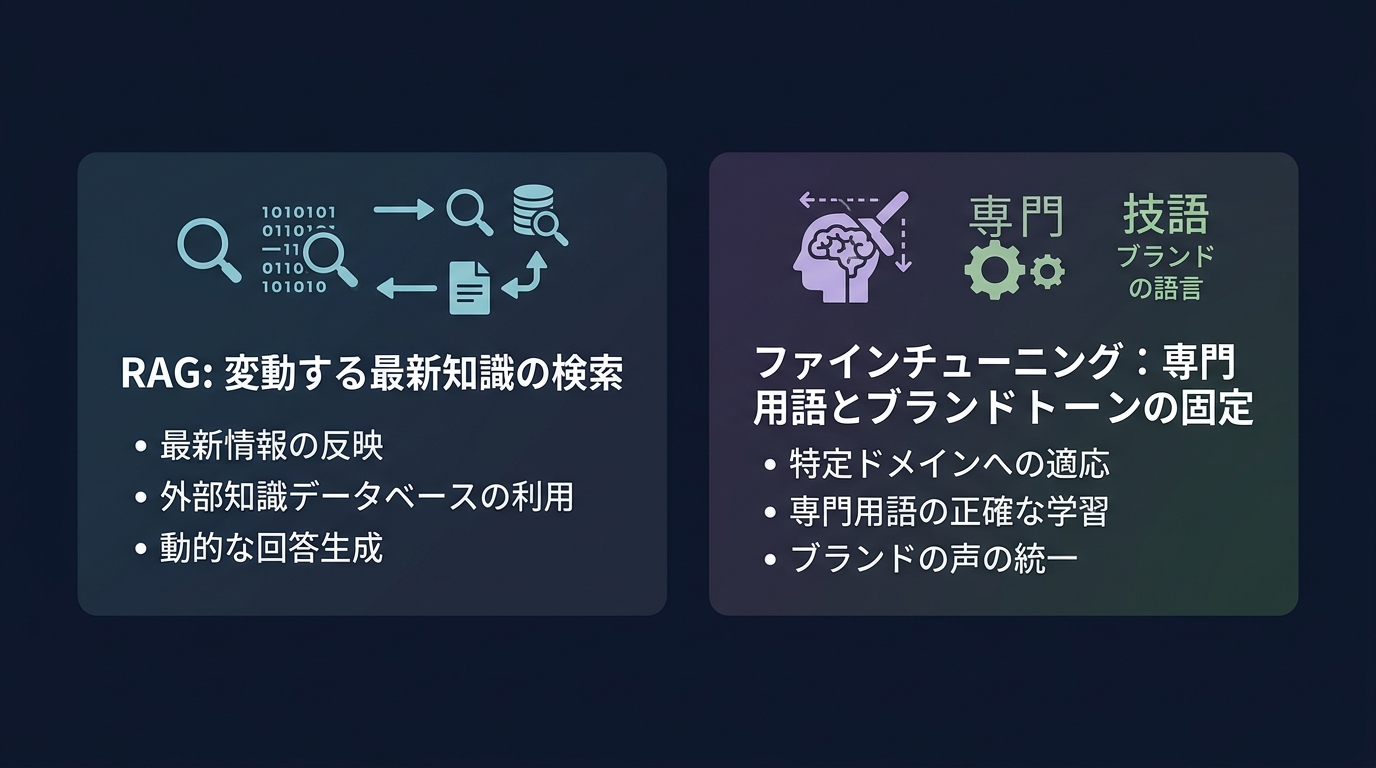

2026年の標準アーキテクチャは、RAGとファインチューニングのハイブリッド構成だ。

変動する知識はRAGで外部のベクトルデータベースから検索させる。

ブランドトーンや専門用語といった振る舞いは、ファインチューニングでモデル自体に焼き込む。

RAGの検索失敗率を削減するため、Contextual Retrievalという手法が標準化されつつある。

この手法により、検索失敗率は49%削減される。

リランキングを組み合わせることで、失敗率は最大67%まで低下する。

AIによる脆弱性発見とエクスプロイト作成の自動化が進んでいる。

自律型攻撃エージェントは、わずか1年半で本番環境の脅威となった。

人間が手作業でコードを監査している間に、AIは数千行のコードから脆弱性を見つけ出す。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

攻撃の民主化と防御の自動化

エンタープライズ企業がコンサルを入れて一斉にAIを導入する。

システムの複雑性は増大する。

そこに、AIで武装した攻撃者が群がる。

しんたろー:

コンサルが入って大規模にAIを組むと、どこかに穴ができる。

複雑なRAGパイプラインや権限管理のミスをAIエージェントに突かれる事態が気になる。

セキュリティ予算を削ってAI導入に全振りしている企業の状況が頭をよぎる。

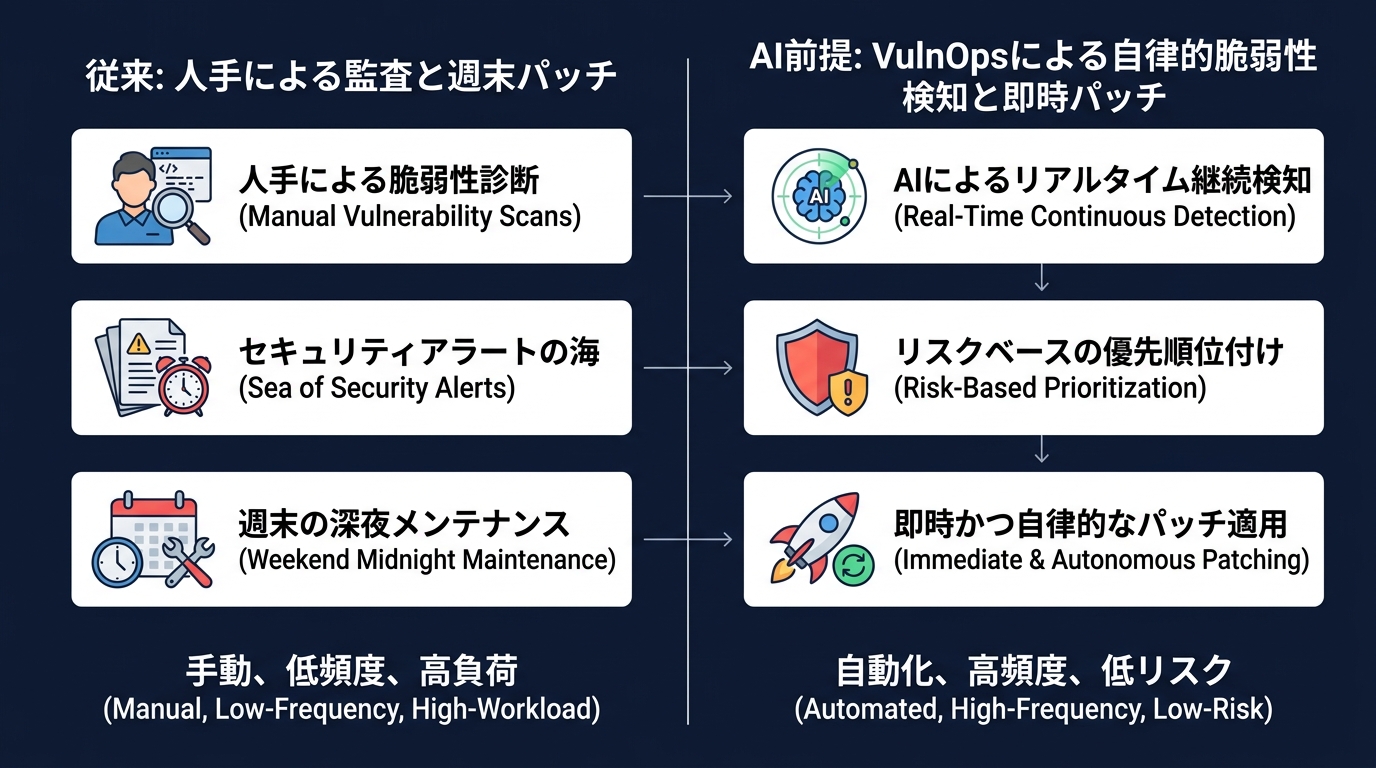

これまでのセキュリティ対策は、人間の限界を前提としていた。

AIエージェントは、ソースコードを読み込み、論理的な脆弱性を自律的に発見する。

さらに、その脆弱性を突く攻撃コードまで数秒で生成する。

防御側もAIをフル活用し、攻撃者より先に脆弱性を見つけて塞ぐ。

これが、VulnOps(脆弱性運用)と呼ばれる概念だ。

コードをレビューし、脆弱性を探し、パッチを適用するAIエージェントを開発パイプラインに組み込む。

僕は普段の開発でClaude Codeを使っている。

Claude Codeのような自律型AIコーディングエージェントは、VulnOpsの最前線ツールだ。

ターミナル上で起動し、リポジトリ全体を自律的にスキャンする。

依存関係の脆弱性を検知し、修正のプルリクエストを自動で作成する。

テストコードを実行し、リグレッションがないことを確認してからコミットする。

RAGの検索対象となるデータベースは、ポイズニング攻撃のリスクに晒される。

モデルの振る舞い自体をファインチューニングで強固にする必要がある。

LoRAやQLoRAといった軽量な追加学習手法を使い、不適切な指示を無視するようモデルを訓練する。

この多層防御が、2026年のAIアプリケーション開発における要件となる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

マイクロサービス化とデプロイの独立性

毎日、あるいは毎時間、新しい脆弱性が報告されるようになる。

システム全体を停止してパッチを当てていては、サービスが成り立たない。

しんたろー:

Claude Codeに自分の書いたコードのセキュリティレビューをさせると、容赦なく脆弱性を指摘してくる。

直すたびに全体デプロイを走らせるのは効率が悪い。

CI/CDのパイプライン自体をAI前提に作り直さないと、パッチ当ての作業だけで日が暮れると思った。

モノリスなアーキテクチャは、AI時代においては弱点になる。

システムを徹底的にマイクロサービス化する。

コンテナ技術を活用し、サービスごとに独立したデプロイメントパイプラインを構築する。

認証サービスに脆弱性が見つかれば、そこだけを切り離してパッチを当てる。

決済サービスに問題があれば、そこだけをロールバックする。

この「部分的な修正と即時デプロイ」が可能な基盤が、AIによる高速なパッチ適用を活かす。

AIエージェントの権限管理も重要だ。

Agentic RAGのように、AIが自律的に検索を繰り返し、外部APIを叩く機能は強力だ。

AIに過剰な権限を与えれば、それがそのまま攻撃ベクターになる。

AIエージェントには、そのタスクを実行するための最小限の権限しか与えない。

IAMのポリシーを絞り込む。

データベースへのアクセスは読み取り専用のビューに限定する。

FAQ

RAGとファインチューニング、結局どちらから始めるべき?

2026年の標準はハイブリッドですが、まずはRAGから始めるのが定石です。

知識の更新頻度が高い場合、RAGならデータベースの更新だけで済み、運用コストが低いためです。

まずは小規模なデータでRAGのPoCを回します。

検索精度やAPIコストの実測値を見てから、LoRA等を用いたハイブリッド構成へ移行します。

AIによる攻撃が高度化する中、開発者がまずやるべきセキュリティ対策は?

「AIによる脆弱性発見」を前提としたワークフローへの移行です。

コードのセキュリティレビューをClaude CodeのようなAIエージェントに常時実行させます。

そして、発見された脆弱性に即座に対応できる「デプロイの独立性」を確保します。

システムをマイクロサービス化し、パッチ適用が全体に影響を与えない疎結合なアーキテクチャを構築します。

コンサルと組むような大規模AI導入で、現場が注意すべきことは?

AI導入はシステムアーキテクチャの変革を伴います。

AIが生成したコードやパッチをそのまま本番適用するリスクを認識する必要があります。

AIの出力結果を別のAIに二重チェックさせるなど、品質管理プロセスが必須です。

AIに与える権限を最小限に絞り込む、ゼロトラストな設計を導入初期から徹底します。

AI時代の開発体制へ

防御側の開発者は、自身の開発ライフサイクルにAIを組み込む決断を迫られている。

しんたろー:

攻撃者がAIをフル活用している以上、こっちもAIで防御するしかない。

ツール選びで迷うより、まずは自分のコードをAIに読ませて現状を把握するところからスタートだと思った。

AIによる開発の高速化とセキュリティリスクの増大を両立させるための「AIネイティブな開発体制」について、ThreadPostで深掘りしていく。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ