SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

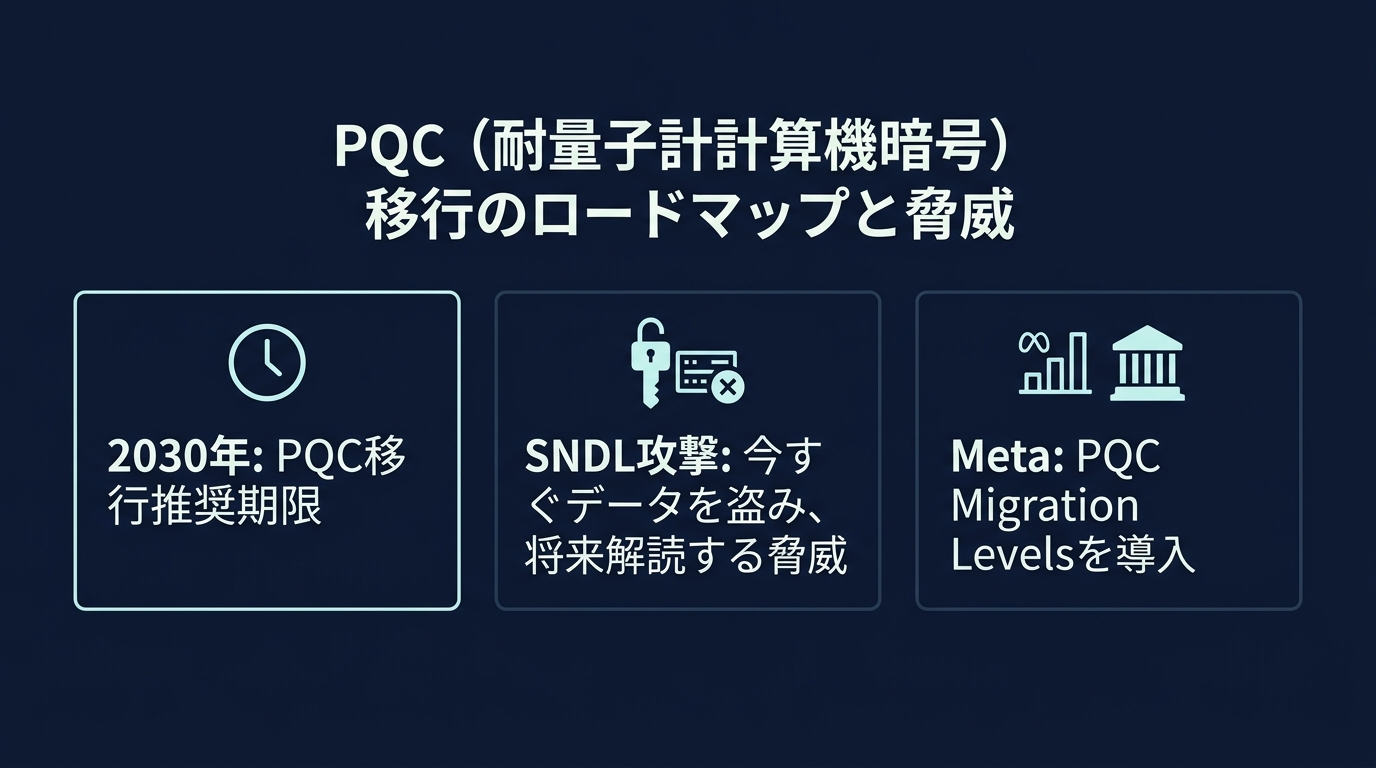

迫り来る量子脅威と自律型AIの台頭

10年から15年後。量子コンピュータが現在の公開鍵暗号を解読する。

これはSF映画の設定ではなく、目前に迫った現実だ。

攻撃者はすでに暗号化されたデータを大量に収集している。

将来の解読を狙うStore Now, Decrypt Laterという手法だ。

この脅威に対し、Metaは内部インフラの暗号化方式を移行し始めた。

同時に、人間の介入なしにシステムの脆弱性を発見する自律型AIモデルが特定パートナー向けに提供されている。

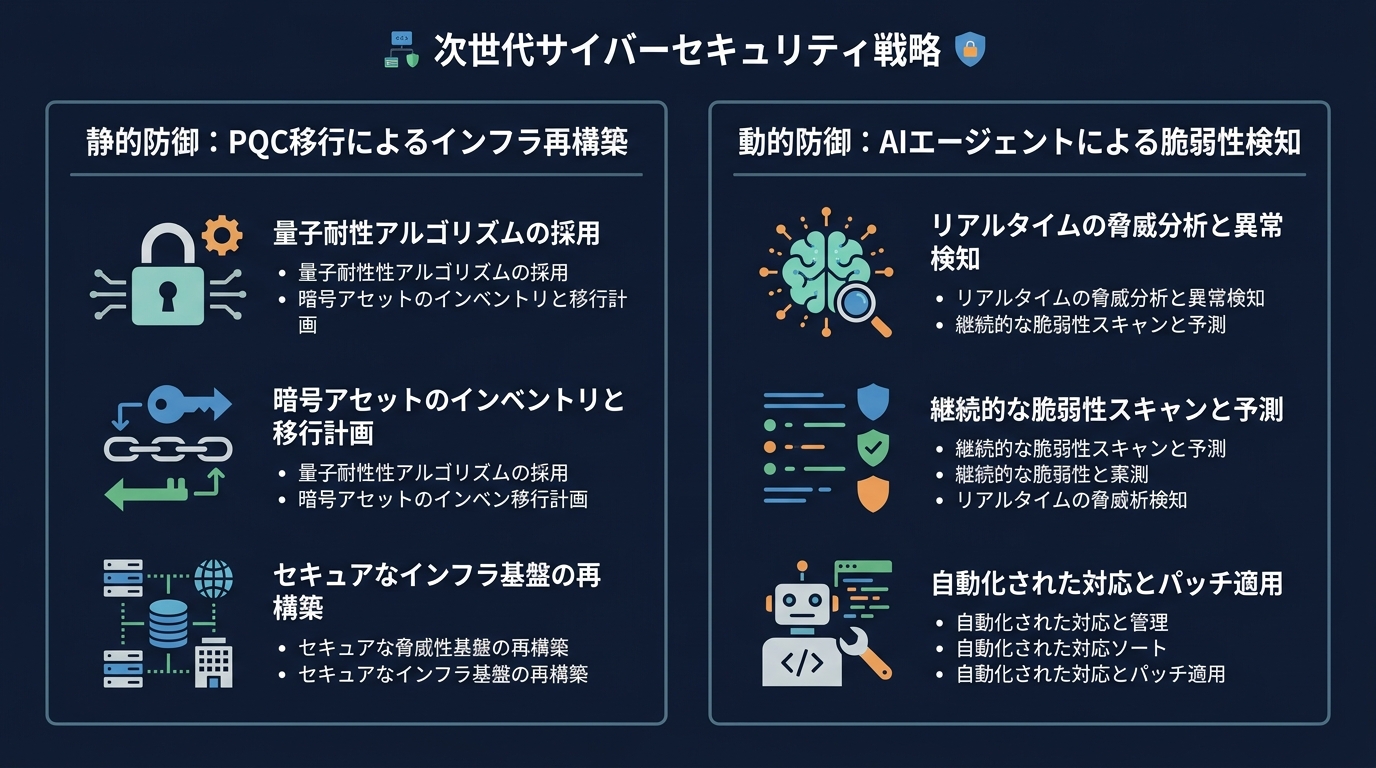

開発者は静的なインフラ防御と動的なAI防御のハイブリッド化を迫られている。

この現実を直視しないプロダクトは淘汰される。

静的防御と動的防御の融合

業界標準となる新しいポスト量子暗号アルゴリズムが発表されている。

Metaはこれに対応するため、明確な移行レベルを定義してインフラの更新を開始した。

数十億のユーザーを抱えるプラットフォームでは、暗号化の移行は数年がかりのプロジェクトだ。

まずはシステムの棚卸しを行い、長期保存が必要なデータや将来解読されるリスクのある通信経路を特定している。

数万台のサーバー、無数のマイクロサービス、ペタバイト級のデータ。

これらすべてに新しい暗号化方式を適用していく。

移行の複雑さを管理するため、明確なフェーズ分けが行われている。

リスク評価、インベントリ作成、テスト導入、そして全面展開だ。

各フェーズで発生するパフォーマンスの低下や互換性の問題に対処する。

これは10年先を見据えたインフラ再構築プロジェクトだ。

一方で、AIによる自律的な攻撃と防御も現実のものとなっている。

Anthropicは、人間の指示なしに数千の深刻な脆弱性を発見するモデル「Claude Mythos Preview」を構築した。

このAIモデルは主要なオペレーティングシステムやウェブブラウザの弱点を見つけ出す。

さらには関連するエクスプロイトコードまで自律的に作成する。

強大すぎる能力ゆえに、このモデルは一般公開されていない。

厳選された防御的セキュリティパートナーのみがアクセスを許されている。

最前線の開発現場ではAIエージェントをセキュリティ運用に組み込む試みが進んでいる。

医療系スタートアップは、セキュリティアラートの分析をAIエージェントに委ねた。

EDRやWAFが発報するアラートの大半は誤検知だ。

人間が調査すれば1件あたり5分から15分かかる作業が、毎日数十件も発生する。

AIエージェントはBigQueryに蓄積されたログを自らSQLを書いて検索する。

さらにEDRのAPIを叩き、SlackのやりとりやGitHubのインフラコードまで横断的に照合する。

数十分かかっていた複雑な調査が、わずか数分で完了する。

誤検知の排除において、情報収集の速度と推論能力は人間を超えている。

未来の量子脅威に備えるインフラの更新。

現在のAI脅威に対抗するAIネイティブな運用基盤。

これらは別々の問題ではない。

静的な防御と動的な防御を組み合わせることで、次世代のセキュリティ基盤が完成する。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

AIネイティブなセキュリティ基盤の構築

インフラの暗号化をポスト量子暗号に更新するだけでは足りない。

AIエージェントが自律的に脆弱性を探す時代には、防御側もAIエージェントを組み込む必要がある。

最先端の自律型セキュリティモデルは強大だ。

人間を介さずに脆弱性を見つけ出す能力は、攻撃者に渡れば致命的な脅威となる。

一般公開はされていない。

しかし、手元のツールで同じような防御網を構築できる。

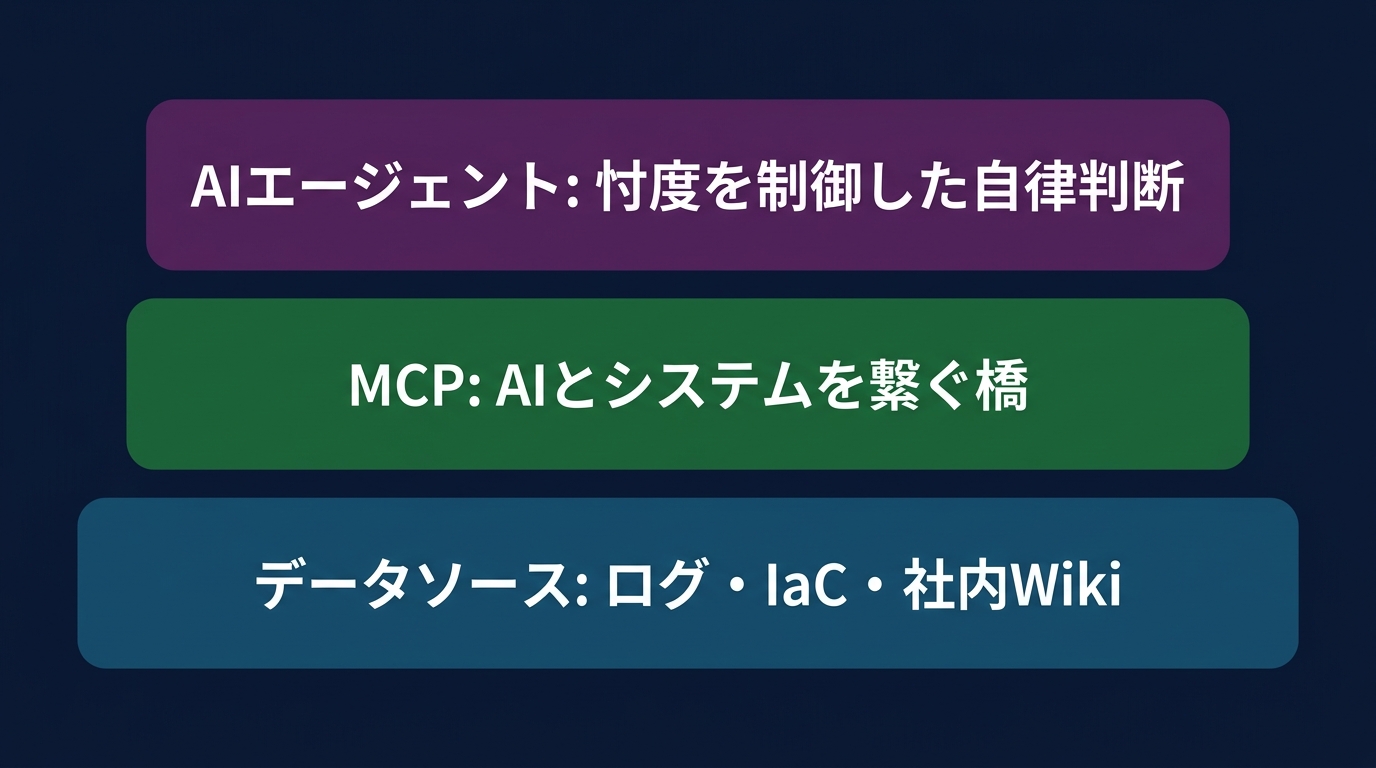

Claude CodeやMCPを活用すれば、社内データにアクセスするAIエージェントを作れる。

ログデータ、インフラのコード、社内のコミュニケーション履歴をAIに繋ぐ。

AIはこれらのコンテキストを読み取る。

単なるエラーログなのか、悪意ある攻撃の兆候なのかを自律的に判断する。

しんたろー:

Claude Codeでコードを書く際、コンテキストの共有が気になる。

ログだけではAIが迷子になるため、インフラの構成情報もセットで渡す必要がある。

AIには特有の弱点がある。

文脈を読みすぎて過剰に反応する「忖度」だ。

一度立てた仮説に固執し、誤った推論を続ける。

医療情報を扱っているという背景情報と公開バケットの設定情報を見て、情報漏洩だと断定する。

一度そう判断すると、推論を曲げない。

これを防ぐためのプロンプト設計が、AIセキュリティ運用の鍵になる。

事実ベースで判断させる。

リスクに対して中立的な立場を維持させる。

複数の仮説を並列して検討させる。

これらのスタンスを明確に指示する。

AIが推論の過程を論理的に説明できるように設計する。

これができれば、誤検知の排除は人間より速く正確になる。

しんたろー:

ログのパース処理をAIに投げた際、解釈が曲がることがある。

事実だけを見るよう念押ししないと、AIは物語を作りたがる。

AIエージェントをセキュリティ運用に組み込むには、多くの壁がある。

最大の壁は、データへのアクセス権限だ。

AIが正確な推論を行うためには、社内のあらゆるデータにアクセスできなければならない。

ログデータ、インフラの構成ファイル、社内Wiki、チャットの履歴。

これらすべてをAIが検索可能な状態にする必要がある。

ここで活躍するのがMCPだ。

Model Context Protocolを使えば、AIと社内システムの間に安全な橋を架けられる。

汎用AIエージェントに、専用のツール群を持たせる。

データベースを検索するツール、APIを叩くツール、ドキュメントを読み込むツール。

AIは状況に応じてこれらのツールを使い分ける。

熟練のエンジニアのように、必要な情報を自ら集めに行く。

しかし、情報が集まればすべて解決するわけではない。

言語モデル特有のハルシネーションや忖度という問題が立ち塞がる。

AIは、与えられたコンテキストから物語を作りたがる。

断片的な情報から、最悪のシナリオを想像してしまう。

開発環境でのテスト用設定を、本番環境の深刻な脆弱性と勘違いする。

一度そう思い込むと、その後のすべてのログを攻撃の証拠として解釈し始める。

これを制御するには、高度なプロンプトエンジニアリングが必要だ。

単に分析しろと指示するだけでは足りない。

あなたは中立的なアナリストだ。

証拠のない推測はするな。

複数の可能性を常に提示しろ。

このような制約を、システムプロンプトのレベルで埋め込む。

AIの推論プロセスをステップごとに分割し、各ステップで人間が検証可能な出力を作らせる。

これが次世代のセキュリティ運用の基本形となる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

開発者が今すぐ取り組むべきこと

量子耐性とAI自律防御。

この2つを並行して進める必要がある。

まずはシステムの棚卸しから始める。

長期保存が必要なデータは何かを特定する。

将来解読されるリスクのある通信経路はどこか。

これらを可視化し、ポスト量子暗号への移行計画を立てる。

次に、AIエージェントのためのデータパイプラインを整備する。

ログ、インフラコード、社内ドキュメントをAIが検索できる状態にする。

MCPを使ってClaude Codeと社内システムを繋ぐ。

AIがコンテキストを解釈して動的に脅威を判断する環境を作る。

静的なセキュリティ基準の遵守だけでは生き残れない。

AIが自律的に攻撃を仕掛けてくる時代には、AIによる自律的な防御が必須となる。

具体的なアクションアイテムは以下の通りだ。

これらは明日からでも着手できる。

- 暗号化資産のインベントリ作成

- 長期保存データの特定と保護方針の策定

- ログデータの構造化と一元管理

- 社内ドキュメントのベクターストア化

- MCPを活用したAIエージェントの試験導入

- プロンプトによる推論スタンスの明確化

- AIの判断根拠を可視化するダッシュボード構築

- 誤検知データを活用した継続的なプロンプト改善

セキュリティのパラダイムが根本から変わった。

境界防御やシグネチャベースの検知は通用しない。

量子コンピュータは暗号の壁を物理的に破壊する。

AIエージェントは論理的な隙を自律的に見つけ出す。

開発者は、システム設計の初期段階からこの現実を組み込む必要がある。

セキュア・バイ・デザインの概念を、AI時代に合わせてアップデートする。

まずは、暗号化資産の完全な可視化だ。

どこでどのような暗号アルゴリズムが使われているか。

サードパーティのライブラリに古い暗号化方式が紛れ込んでいないか。

これらを自動でスキャンし、リストアップする仕組みを作る。

次に、AIエージェントのための運用基盤の構築だ。

セキュリティログは単に保存するだけでは意味がない。

AIが効率的に検索できるよう、構造化されたフォーマットで蓄積する。

社内のドキュメントやコミュニケーション履歴も、ベクターストアに同期させる。

MCPサーバーを立ち上げ、これらのデータソースへの安全なアクセス経路を確立する。

アクセス権限の管理は厳密に行う。

AIエージェントに強い権限を与えすぎると、万が一プロンプトインジェクションを受けた際に致命傷になる。

読み取り専用の権限を基本とし、アクションを実行する場合は必ず人間の承認を挟む設計にする。

これらの取り組みは、一朝一夕には完了しない。

しかし、今日から始めなければ、手遅れになる。

AI技術の進化スピードは速い。

半年後には、さらに強力な自律型攻撃AIが登場する。

その時になって慌てて対策を始めても間に合わない。

今すぐ、手元のシステムを見直し、AIネイティブな防御基盤の構築に着手する。

しんたろー:

ThreadPostのバックエンドでログの構造化を試した際、時間がかかると感じた。

ここをサボると、後でAIエージェントを繋ぐ時に何も検索できなくて詰む。

よくある質問と回答

Q1: ポスト量子暗号への移行は具体的に何から始めればよいか?

まずは自社のシステムがどのレベルにあるかの棚卸しから開始する。

特に、長期間保存が必要なデータや、将来的に量子コンピュータで解読されるリスクのある通信経路を特定する。

米国国立標準技術研究所が公開した標準アルゴリズムへの対応計画を立てる。

準備完了状態を目指すのが第一歩だ。

Q2: AIエージェントがセキュリティ分析で忖度しないようにするには?

AIは文脈を読みすぎて過剰にリスクを評価したり、一度の推論に固執する傾向がある。

これを防ぐには、プロンプトで「事実ベースで判断する」「リスクに対して中立的な立場を維持する」といったスタンスを明示的に指示する。

また、分析の根拠となるログや社内コンテキストを十分に与え、AIが推論の過程を説明できるように設計する。

Q3: 最先端の自律型セキュリティモデルは一般開発者も利用できるか?

現時点では、特定の防御的セキュリティパートナーに限定して提供されている。

一般公開はセキュリティ上の懸念から予定されていない。

ただし、同様の自律的な脆弱性スキャンや分析機能は、MCPを活用した自社開発のAIエージェントによって構築可能だ。

手元のツールを組み合わせることで、社内環境に最適化された防御網を再現できる。

まとめと次のステップ

量子コンピュータとAIがセキュリティの前提を壊した。

インフラの暗号化更新とAIエージェントの導入を同時に進める。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ