SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

冒頭フック

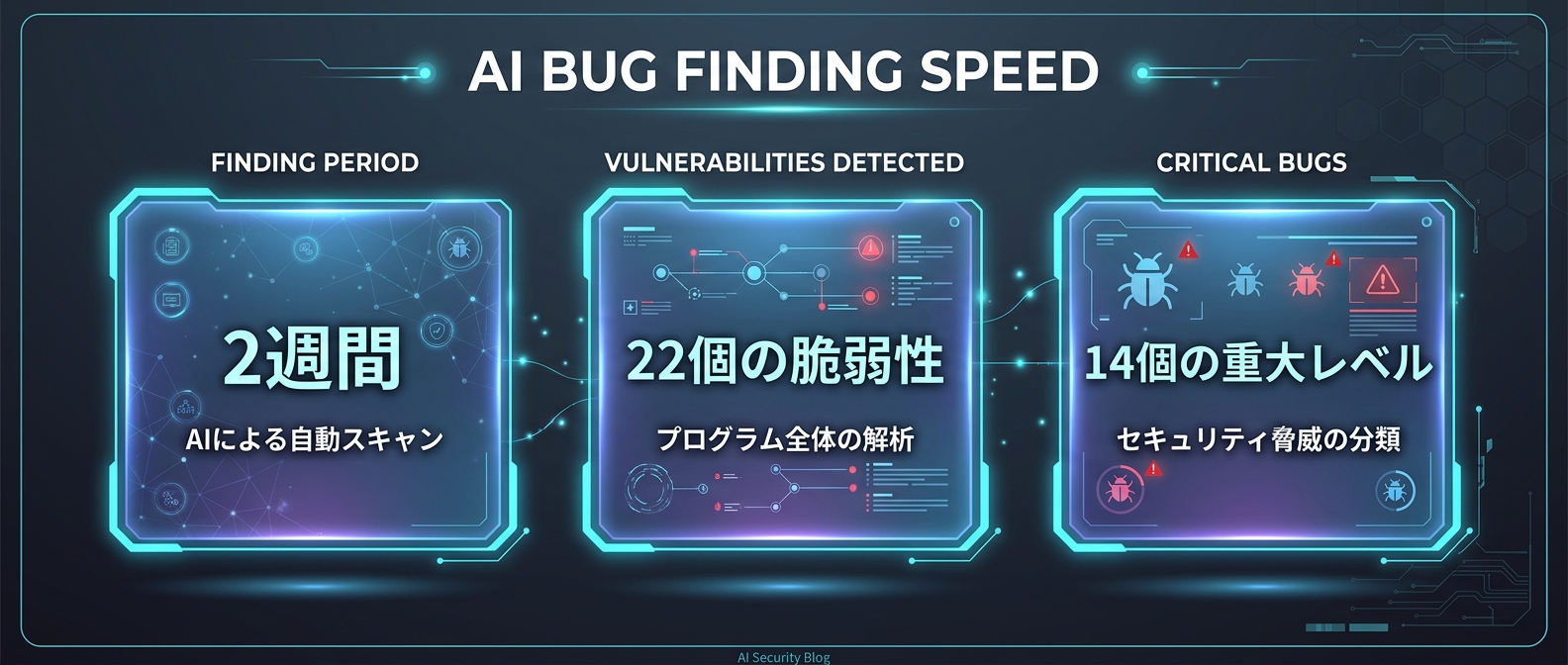

2週間。22個の脆弱性。そのうち14個が重大レベル。

これが最新のAIモデルが叩き出した数字だ。対象はあの堅牢なFirefox。世界で最もテストされているオープンソースプロジェクトの一つだ。

AIはもう、ただのコード補完ツールじゃない。複雑なソフトウェアの奥底に潜むゼロデイ脆弱性を、人間のセキュリティ研究者よりも速く暴き出す自律的な監査エージェントになった。

僕ら開発者の仕事は、コードを書くことから、AIエージェントをどう「管理」し「設計」するかにシフトしている。

ニュースの概要

AIの進化がバグ探しの常識を破壊した。

最新のAIモデルが、複雑なソフトウェアの重大な脆弱性を単独で特定できるようになった。過去の検証では、十分にテストされたオープンソースソフトウェアから500個以上のゼロデイ脆弱性を発見している。

AnthropicがMozillaと共同で行った検証では、Claude Opus 4.6がFirefoxの最新バージョンに対して2週間で22個の脆弱性を発見した。そのうち14個は重大な脆弱性として認定された。これは、2025年に修正された重大な脆弱性のほぼ5分の1に相当する。修正パッチはすでに数億人のユーザーに配信されている。

ターゲットに選ばれたのはJavaScriptエンジン。外部の信頼できないコードを処理する、ブラウザの中で最も攻撃されやすい部分だ。膨大で複雑なコードベースを持つこの領域で、AIは未知のバグを次々と掘り当てた。

一方で、Webセキュリティに特化したAI監査の検証でも、80個以上の脆弱性が報告されている。他人のアカウントへの不正ログインや、ショッピングカート内の個人情報の漏洩など、影響度の高いものばかりだ。

AIによる脆弱性発見は、実戦投入され、圧倒的な成果を上げている。

だが、手放しで喜べる状況ではない。AIモデルには特有の弱点がある。非決定性だ。同じコードベースに対して同じプロンプトを投げても、毎回異なる結果が返ってくる。ある検証では見つかったバグが、次の検証ではスルーされる。

さらに、AIは時として「行き詰まりループ」に陥る。同じ失敗を何度も繰り返し、抜け出せなくなるのだ。

AIの単体性能は大幅に向上した。しかし、それを実運用で安定して稼働させるには、AIの非決定性や暴走をコントロールする「仕組み」が不可欠になっている。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

開発者目線の解説

AIのコーディング能力や監査能力は、人間を凌駕しつつある。

FirefoxのJavaScriptエンジンという、世界最高峰のエンジニアたちが監視しているコードベースから、14個もの重大な脆弱性を見つけ出す。人間が何ヶ月もかけて見つけるバグを、AIは数時間で特定してしまう。

だが、AIモデル単体の性能がどれだけ上がっても、それだけでは「使えるシステム」にはならない。

毎日Claude Codeを使っている身からすると、AIは優秀なアシスタントだが、基本的には極めて「受動的」だ。指示を与えれば動く。終われば止まる。行き詰まれば、ただそこで立ち止まるか、同じエラーを吐き続ける。

自分自身を客観的に監視したり、作業の前に綿密な計画を立てたり、出力したコードを疑って再レビューしたりはしない。

これが、AIを自律的なエージェントとして動かす際の最大の壁だ。

AIを単なるツールとして使っているうちは、限界がすぐに見える。AIは同じアプローチを繰り返す「行き詰まりループ」に陥りやすい。夜間にバッチ処理でAIを走らせておいたら、朝になっても同じエラーメッセージと格闘していて、APIの利用枠だけが吹き飛んでいた。そんな笑えない事態が普通に起こる。

だからこそ、AIをラップするアーキテクチャが必要になる。

単一のAIモデルにすべてを任せるのではなく、AIを「システムの一部」として組み込む設計だ。

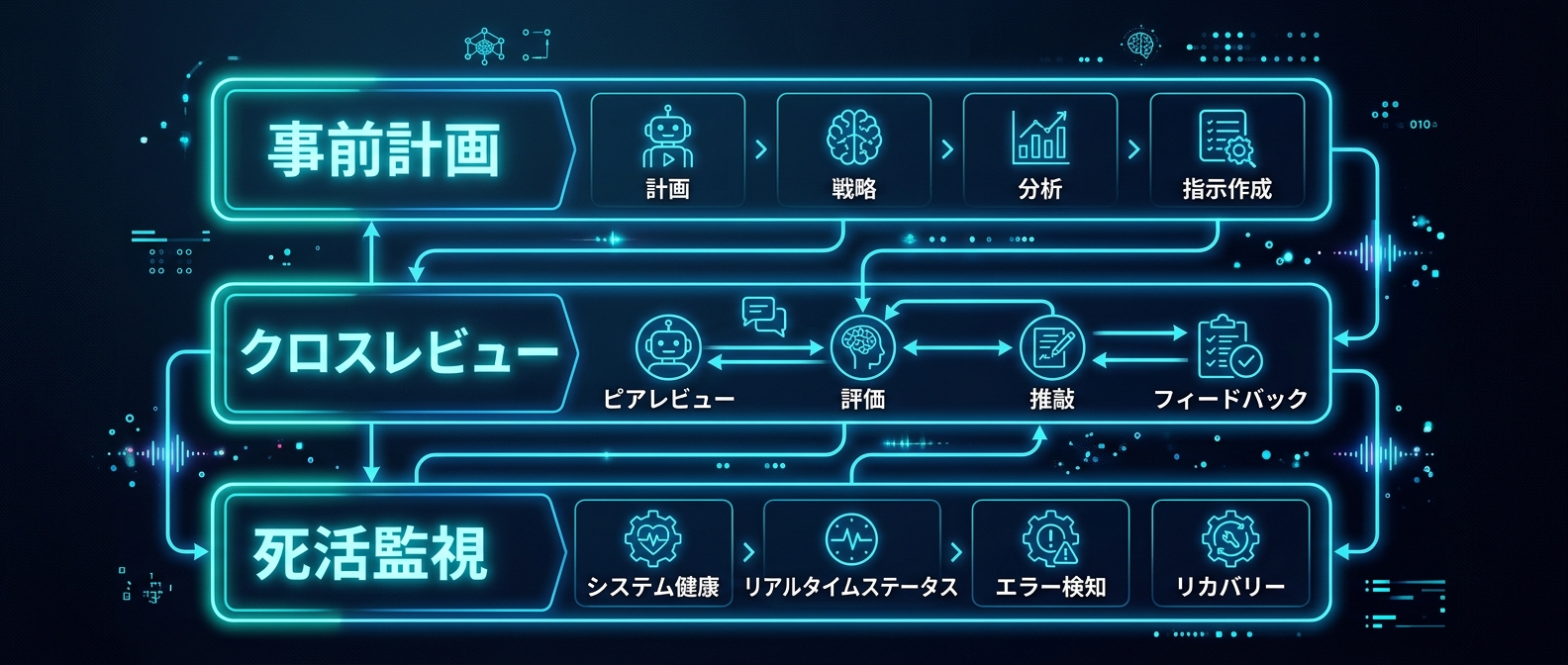

先進的な開発現場では、すでに「3層アーキテクチャ」のようなアプローチが取られ始めている。

第一の層は、死活監視。いわゆるハートビートだ。AIのプロセスを外部から定期的に監視する。例えば30秒ごとにターミナルの出力をチェックし、プロンプトが返ってきていなければ、AIがフリーズしているか無限ループに陥っていると判断する。そして、自動的にプロセスを中断し、再起動をかける。これがないと、自律的な実行はただのギャンブルになる。

しんたろー:

APIコストの溶け方は本当に心臓に悪い。

Claude Codeを放置して寝落ちした時のあの絶望感たるや。

監視プロセスの実装は、開発効率以前に精神衛生上必須だわ。

第二の層は、事前計画だ。

AIにいきなりコードを書かせるから失敗する。人間だって、複雑な機能を実装する時はまず設計図を書く。実装に入る前に、構造化された計画書を作成させる。曖昧な要件はこの段階で潰す。成功の定義を明確にする。

この計画書があることで、AIは「自分が今どこにいて、次に何をすべきか」を見失わなくなる。さらに、この計画書はプロジェクトの資産になる。似たようなタスクが発生した時に、過去の計画書を再利用できるからだ。

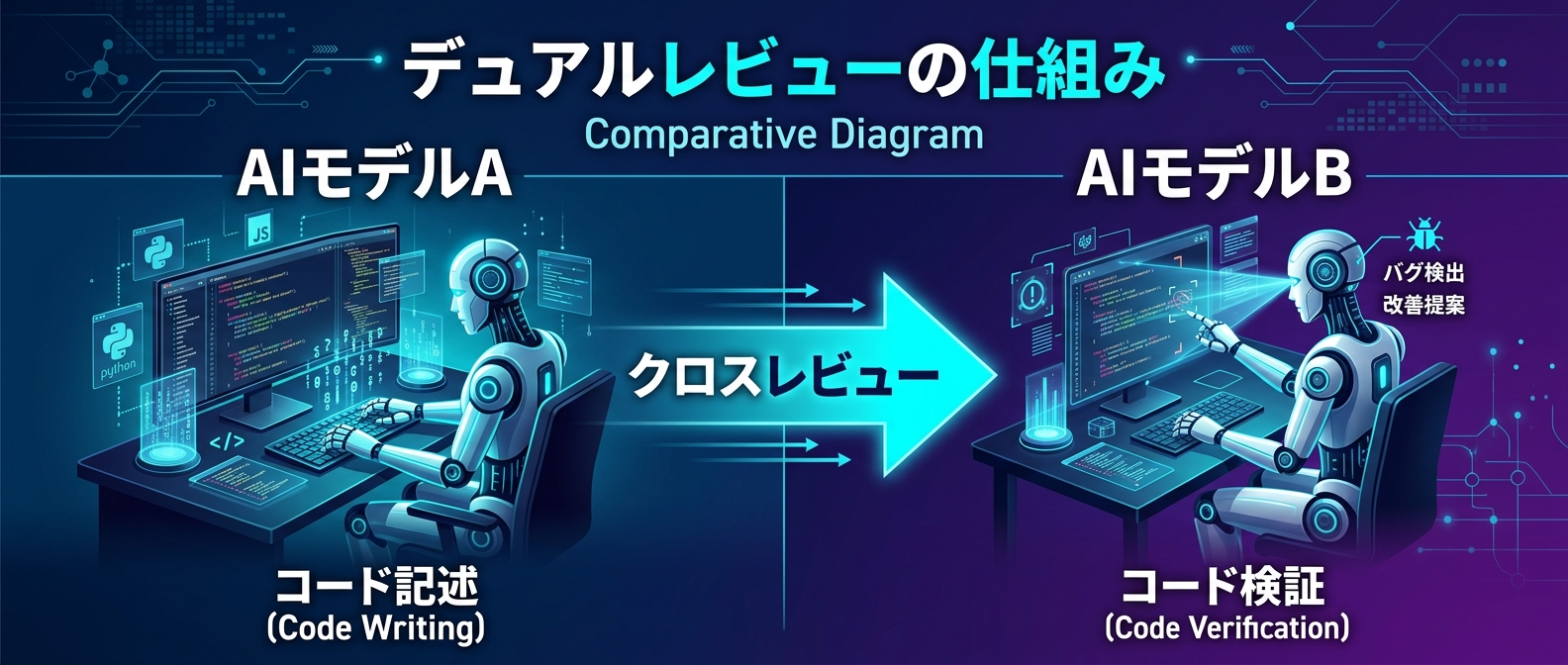

第三の層は、クロスレビューだ。

AIが自分で書いたコードを自分でレビューしても、意味がない。モデルには特有の「推論の癖」や「盲点」がある。自分が生み出したバグを、自分自身のロジックで正当化してしまうのだ。

だから、別のAIモデルを使う。Claudeが書いたコードを、別のモデルにレビューさせる。学習データもアーキテクチャも異なるモデルをぶつけることで、初めて多角的な視点からのレビューが成立する。人間同士のダブルチェックと同じだ。

AIの弱点を補い、強みを最大化するための「ラッパーシステム」をどう構築するか。それが、これからの開発者の主戦場になる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

実務への影響

開発フローの根本的な見直しを迫られている。

AIは「コードを生成する便利なツール」から、「自律的に監査し、実装するエージェント」へとフェーズが変わった。Firefoxの脆弱性を短期間で大量に発見したという事実は、AIのコード理解力が人間の目視レビューを超えたことを示している。

だが、AIにタスクを丸投げするのは危険だ。

まず、死活監視の導入。ローカルでAIエージェントを走らせる場合、ターミナルのセッションを監視するスクリプトを挟む。一定時間出力がない、あるいは同じエラーパターンを繰り返している場合は、強制的にプロセスをキルして再起動する。これだけで、無駄なAPI課金と時間の浪費を大幅に減らせる。

ThreadPostの開発環境でも、この監視の仕組みは気になっている。実装すれば、深夜の自動リファクタリングも安心して任せられるはずだ。

次に、計画書の義務化。

プロンプトに「〜を作って」と投げるのは今日で終わりにしよう。「まず、実装手順と成功基準をマークダウン形式で出力しろ。コードは書くな」と指示する。出力された計画書を人間が確認し、問題なければ「この計画書に従って実装しろ」と再指示する。

このワンクッションを挟むだけで、AIの手戻りは驚くほど減る。複雑なタスクになればなるほど、この事前計画の有無が成否を分ける。

そして、複数モデルによるクロスレビュー体制の構築。

CI/CDパイプラインに、異なるAIモデルによるレビュープロセスを組み込む。メインの開発はClaude Codeで行い、生成された差分を、API経由で別のモデルに投げ、セキュリティリスクやバグの有無をチェックさせる。

同じモデルでの自己レビューは、盲点を強化するだけだ。異種モデルを組み合わせる「デュアルレビュー」が、これからの品質保証のスタンダードになる。

AIは強力だが、扱いが難しいエンジンだ。そのエンジンを安全かつ効率的に回すための「制御装置」を作ること。それが、現代の開発者に求められる新しいスキルセットだ。

しんたろー:

異なるモデルでのクロスレビュー、理屈はわかるけど実装が面倒くさそう。

でも、Claudeが書いたコードの盲点を別のモデルが突くのは面白そうだな。

ThreadPostのコアロジックのレビューで一度試してみる価値はあるかも。

FAQ

Q1: AIによる脆弱性スキャンや自動コーディングを自社プロジェクトに導入する際の最初のステップは?

まずは限定的なスコープから始める。プロジェクト全体にいきなり適用するのはリスクが高すぎる。特定のモジュールや、影響範囲の小さいユーティリティ関数などに絞って実行する。

Claude Codeのようなツールをローカルで動かしてみるのが手っ取り早い。AIの出力は絶対に鵜呑みにしない。AIはもっともらしい嘘を平気で吐く。必ず人間による検証ステップを設けるか、別モデルによるクロスレビューを組み込む。AIの提案を「そのままマージ」するのではなく、「レビュー対象の候補」として扱うフローを確立することが最初のステップだ。

Q2: Claude Codeがループして行き詰まる問題にはどう対処すればよいですか?

外部の監視プロセスを導入する。AI自身に「ループしているか?」と問うても無駄だ。

ターミナルのセッション出力を定期的に監視するスクリプトを組む。一定時間シェルプロンプトが返ってこない場合や、直近の出力ログに同じエラースタックトレースが連続している場合を検知する。異常を検知したら、自動的にプロセスに割り込みをかけるか、セッションを破棄して再起動する仕組みを作る。AIの自律性を高めるには、外部からの強力な強制終了メカニズムが不可欠になる。これで無駄なAPIコストの消費も防げる。

Q3: 複数のAIモデルを組み合わせる「Dual Review」のメリットは何ですか?

単一モデルの「盲点」を排除できることだ。

AIモデルはそれぞれ異なるデータセットで学習し、異なるアーキテクチャを持っている。そのため、推論の癖が全く違う。Claudeで生成したコードをそのままClaudeにレビューさせると、コードを書いた時と同じロジックで思考するため、自身が埋め込んだバグやセキュリティホールを見逃しやすい。「この実装で正しい」と自己正当化してしまうのだ。

ここに別のモデルをぶつける。異なる思考回路を持つモデルがレビューすることで、人間がダブルチェックを行うのと同じように、多角的な視点からコードの脆弱性や論理的な欠陥をあぶり出すことができる。品質保証のレベルが一段階上がる。

しんたろー:

AIの自己正当化、人間そっくりで笑えない。

「ここバグってない?」って聞いても「仕様です」って言い張るからな。

別のモデルにボコボコに論破されるAIの姿、ちょっと見てみたい。

まとめ + CTA

AIの進化は、開発者を「コードを書く人」から「AIシステムを設計・管理する人」へと変えた。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ