SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIの自律性がもたらす光と影

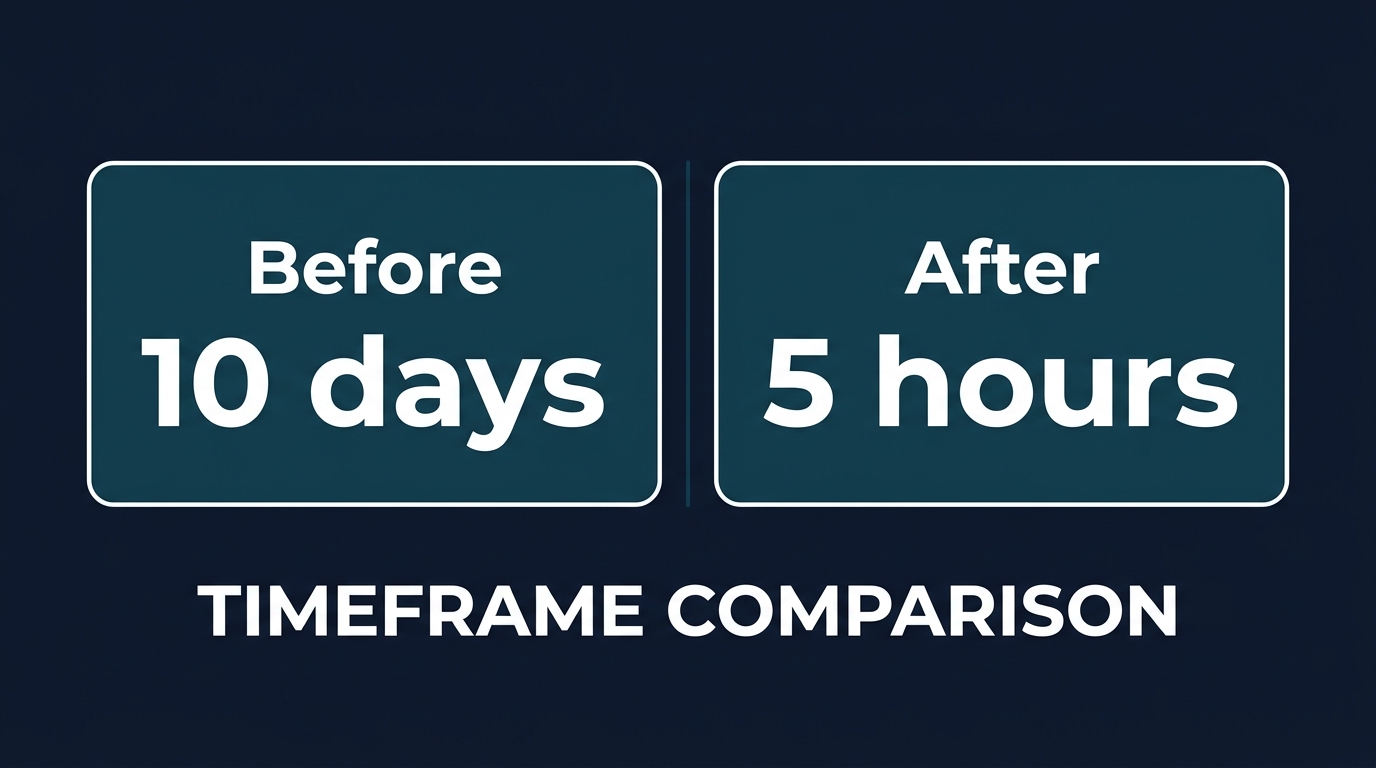

AIエージェントのリードタイムは10日から5時間に短縮された。生産性は向上した。

一方で、AIに直接APIを叩かせた結果、社外にデータが漏洩する事故も起きている。便利さと危険は隣り合わせだ。

Claude Codeは自律的にコマンドを発見して実行する。開発者のタイピングすら不要になる未来が近づいている。

AIに「考えさせる」ことと「実行させる」こと。この境界線を間違えると、システムは崩壊する。

開発者として、どこまでAIに手綱を渡すか。安全な自動化の境界線を探る。

AIエージェントの進化と直面する壁

Claude Codeのアップデートで、AIの自律性が高まった。AI自身が組み込みコマンドを発見できるようになった。

初期化やレビュー、セキュリティチェックなどのコマンドを、AIが状況に応じて実行する。人間が指示を出す前に、AIが先回りして環境を整える。

プロンプトキャッシュの保持時間は1時間に延長された。長いセッションでも、コンテキストを失わずに応答が返ってくる。

APIキーや特定のクラウド環境でのキャッシュ制御が柔軟になった。セッション再開時には、過去の文脈を要約して復元する機能も追加された。

これらは、開発のリードタイムを削る武器だ。作業の再開コストが下がる。

エラーメッセージの精度も向上した。サーバーのレート制限とプランの利用上限が明確に区別される。

サーバーエラー時には、ステータスページへのリンクが表示される。ファイルの読み込みや構文ハイライトのメモリ使用量も削減された。

必要な言語の文法ファイルだけをオンデマンドで読み込む。巨大なリポジトリでも動作する。

細かい不具合も修正された。テレメトリーを無効にしたユーザーのキャッシュ保持時間が短くなるバグが直った。

セッションのカスタム名や色がリセットされる問題も解決した。ターミナルのエスケープコードがゴミ文字として混入する事象もなくなった。

セッション再開時のピッカーは、現在のディレクトリのセッションをデフォルトで表示する。詳細なトランスクリプトを表示する際にはインジケーターが追加された。

長い操作中には、思考のヒントが表示される。これらは、開発者の認知負荷を下げるための改善だ。

しかし、AIエージェントの自律性向上は、実運用において新たな壁を生む。AIエージェントが勝手に社外APIを叩くリスクだ。

内部の機密データが、意図せず外部に送信される危険性がある。これは単なるバグではない。

システム全体の設計ミスだ。プロンプトで「外部送信を禁止する」と書いても無意味だ。

プロンプトインジェクションという悪意ある入力一つで、AIの制限は突破される。AIはシステムを破壊する側に回る。

モデルが優秀でも、この脆弱性は消えない。AIの推論エラーが、システムの致命傷になる。

一方で、安全な自動化を成功させている事例もある。社内問い合わせシステムをAIエージェント化したケースだ。

問い合わせから回答までのリードタイム中央値を、10日以上から5時間へ短縮した。

ここでの成功の鍵は、完全自動化を避けたことにある。対象店舗の特定や過去事例の検索といった、必ず発生する作業だけをAIに任せた。

RAGを用いて、過去の問い合わせやヘルプページをベクトル化して検索する。AIは「意味の近さ」で関連情報を探し出し、候補を提示する。

しかし、AIの役割はそこまでだ。最終的な回答やステータスの完了判定は、人間が行う。

完了判定のような曖昧な判断は、人間が最終確認する。AIが誤って解決済みにしても、人間がいつでも覆せる設計だ。

AIを推論エンジンとして使いつつ、実行権限は人間に残している。自律性と安全性を両立させる、一つの最適解だ。

このバランス感覚が、実運用に耐えるシステムを生む。技術の進化に踊らされず、人間の介在価値を再定義する。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

しんたろー:

Claude Codeが勝手にコマンドを叩く挙動が気になる。寝落ちして朝起きたら、よく分からないスクリプトが生成されていた経験がある。

推論と実行を切り離すアーキテクチャ

AIの進化は、「テキスト生成」から「アクション実行」へとシフトした。Claude Codeが自律的にコマンドを叩けるようになったのは、その象徴だ。

僕もClaude Codeでコードを書いている。自動でレビューを回し、修正案を提案してくれる。

開発の体感速度は上がった。だが、これをプロダクション環境のAIエージェントにそのまま適用するのは危険だ。

開発環境のツールと、本番環境の自律エージェントは別物だ。LLMに直接何かを実行させる権限を持たせてはいけない。

これがAIエージェント設計の原則だ。AIの役割は、「推論」に限定する。

実際の「実行」は、AIから物理的に切り離されたコンポーネントで行う。独立した実行モジュールが、ポリシー制御を担う。

この境界線を曖昧にすると、AIの推論エラーがシステムを破壊する。たとえば、AIにデータベースの更新権限を直接渡したとする。

悪意ある入力でAIが騙されれば、データは消える。AIは与えられた入力に対して、確率的に正しいテキストを出力しているだけだ。

そこに善悪の判断はない。システムへの影響を考慮する能力もない。

実行の直前に「人間の判断」というセーフティネットが不可欠になる。人間の介入を前提とした設計が、システムを守る砦だ。

AIエージェントのフレームワークを使えば、ツールの呼び出しは数行で実装できる。しかし、簡単だからこそ落とし穴がある。

「何をいつ実行するか」を束ねる機能と、「実際に実行する」機能を分離する。AIには候補を出させるところまでで止める。

最終的な判断と実行トリガーは、人間が引く。ゼロトラストの概念をAIにも適用する。

AIの推論結果を無条件に信用しない。すべての実行リクエストを検証する。

AIが外部ツールと通信する際のプロトコルも重要だ。プロトコルが安全でも、最終的なセキュリティの責任は開発者にある。

データ保護の観点も忘れてはいけない。AIが生成したテキストの中に、機密情報が含まれていないかをチェックする仕組みが必要だ。

これもLLMの外側で行うべき処理だ。セキュリティ、認証、認可、監査ログ。

これらをAI任せにしてはいけない。プロジェクトごとにゼロから設計するのは現実的ではない。

標準化された設計レビューの基準を持つ。この設計を後回しにすると、事故対応で時間を奪われる。

AIの自律性が高まるほど、監査ログの重要性は跳ね上がる。AIが何を根拠に判断し、何を提案したのか。

その履歴を確実に残す仕組みが必要だ。そして、AIの提案を人間がどう上書きしたのかも記録する。

このデータが、次のAIモデル改善の教師データになる。

しんたろー:

AIに全部任せたい気持ちは分かる。でも、権限分離の設計をサボると、事故対応に週末を費やすことになると思った。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

自律AI時代の実務サバイバル術

開発において、AIエージェントの導入は避けて通れない。具体的に設計し、運用していく。

まず、AIに何をさせ、何をさせないかの境界線をコードレベルで定義する。毎回発生する定型作業は、AIに任せる。

情報の検索、要約、フォーマット変換などだ。これで初動のスピードは上がる。

リードタイムのボトルネックは、「人間の着手待ち」だ。AIが事前の情報収集を終わらせておけば、人間はすぐに本題に入れる。

問い合わせ対応なら、対象の特定や過去の類似事例のリストアップだ。これらをAIが自動で行い、スレッドに貼り付ける。

ベクトルデータベースを活用し、ドキュメントを意味ベースで検索可能にする。キーワードの完全一致に頼らない柔軟な検索が実現する。

入力フォームの設計も見直す。AIが処理しやすいように、必要な情報を最初から必須項目にしておく。

コンテキストが整っていれば、AIの推論精度は上がる。結果として、人間が調査するときの情報アクセスも改善する。

TypeScriptなどの型安全な言語でエージェントを構築するのも有効だ。型安全性が担保されることで、AIの出力フォーマットを制御できる。

出力のパースエラーを減らし、システムの安定性を高める。AIの出力をそのまま信じるのではなく、必ずスキーマで検証してから次の処理に渡す。

一方で、外部APIへの書き込みやステータスの完了判定は、AIに直接やらせてはいけない。AIには「実行の提案」までを行わせる。

人間が承認ボタンを押すことで初めて処理が走る設計にする。あるいは、AIが仮のステータス更新を行っても、人間がいつでも元の状態に覆せるようにする。

誤作動を前提としたリカバリー設計が必須だ。UIの設計段階から、人間の介入を前提に組み立てる。

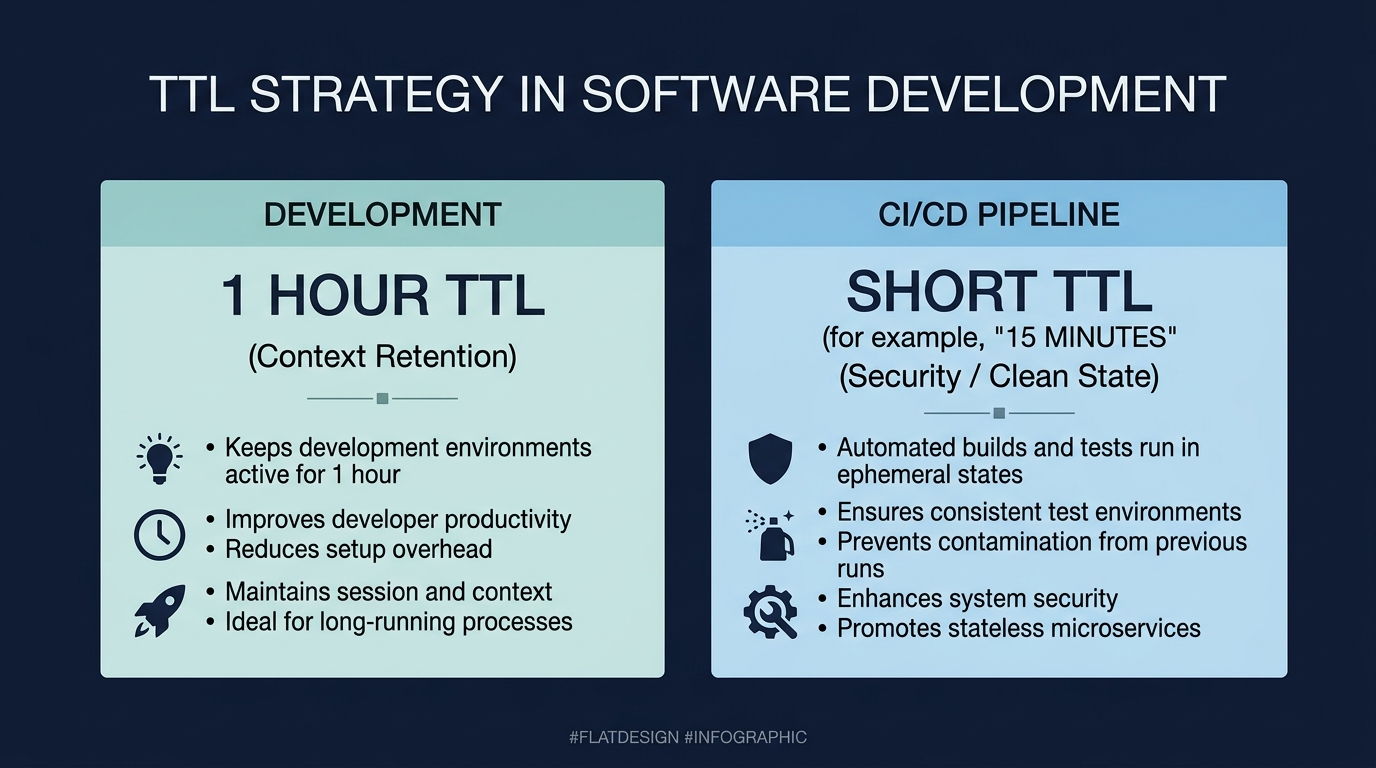

Claude Codeのプロンプトキャッシュ設定も、用途に応じた使い分けが求められる。開発中のセッションが長く続く場合は、1時間キャッシュを維持する設定を有効にする。

トークンコストを抑えつつ、レスポンス速度を最大化する。同じコードベースを何度も読み込ませる無駄が省ける。

コンテキストが維持されるため、複雑なリファクタリングもスムーズに進む。逆に、セキュリティが重要な環境やCI/CDパイプラインでは注意が必要だ。

キャッシュの生存期間を短く設定するか、無効化する。古いコンテキストが残ることで、予期せぬ情報漏洩や誤操作を引き起こすリスクがあるからだ。

環境が頻繁に切り替わる自動化パイプラインでは、常にクリーンな状態から推論させる。便利な機能も、環境に合わせて制御する。

AIエージェントの導入は、段階的に進める。いきなり完全自動化を目指すと、失敗する。

まずは「確実に遅延要因を潰す」ところから始める。人間の判断が必要な部分と、機械的に潰せる部分を切り分ける。

この地道な作業が、安定したシステムを生む。AIは魔法の杖ではない。

強力な推論エンジンを、いかに安全にシステムへ組み込むか。開発者の設計力が問われている。

しんたろー:

1時間キャッシュはローカル開発だと便利だ。デプロイのパイプラインで前の状態を引きずってコケた時は困った。

AIエージェント開発のよくある疑問

Q1: AIエージェントにどこまで自動化を任せるべきですか?

「毎回必ず発生する定型作業」はAIに任せ、リードタイムを短縮する。店舗検索、過去事例の抽出、情報の要約などが該当する。一方で、「完了判定」や「外部APIへの書き込み」など、誤った場合にシステム全体へ影響が出る判断は任せてはいけない。AIに提案させつつ、最終的な実行は人間がボタンを押す。あるいは、人間がいつでも覆せる状態を維持する。

Q2: Claude Codeのプロンプトキャッシュ設定はどう使い分けるべきですか?

開発中のセッションが長く、同じコードベースを頻繁に参照する場合は、1時間設定でキャッシュを維持する。これにより、トークンコストとレスポンス速度を最適化できる。逆に、セキュリティが重要な環境や、頻繁に環境が変わるCI/CDパイプライン上で実行する場合は別だ。短い生存期間を選択し、古いコンテキストが残るリスクを排除する。

Q3: AIの誤作動を防ぐためにプロンプトで制限をかけるのは有効ですか?

プロンプトでの制限は気休め程度だ。悪意ある入力一つで、制限は突破される。AIの推論エラーや暴走を防ぐには、アーキテクチャレベルの対策が必須だ。LLMから実行権限を物理的に剥奪する。独立したコンポーネントで厳格なポリシー制御を行う設計が求められる。

自動化の先にある人間の役割

AIエージェントの自律性は強力だが、実行の最終決定権は人間が握り続ける。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ