SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

エージェントが「途中で力尽きる」問題、解決の糸口が見えてきた

8時間。自律エージェントが止まらずにコーディングタスクを実行し続けられる時間として、業界のベンチマークになっている。

長時間のエージェント実行を試みた開発者は知っている。コンテキストが膨らみ、キャッシュが切れ、ストリームが途切れ、エージェントが同じ手法をループする。これはモデルの賢さではなく、インフラとセッション管理の問題だ。

Claude Codeの最新アップデートが、この問題に答えを出した。

Claude Codeが変えた「長時間実行」の常識

AIエージェント界隈の競争軸が変わった。「モデルの賢さ」から「長時間実行の安定性」へのシフトだ。あるAIラボが公開したエージェント特化モデルは、SWE-Bench ProでSOTAを達成し、8時間の自律実行を持続する。パラメータ数は754B。MoEアーキテクチャと非同期強化学習を組み合わせ、従来モデルの構造的欠陥を克服した。

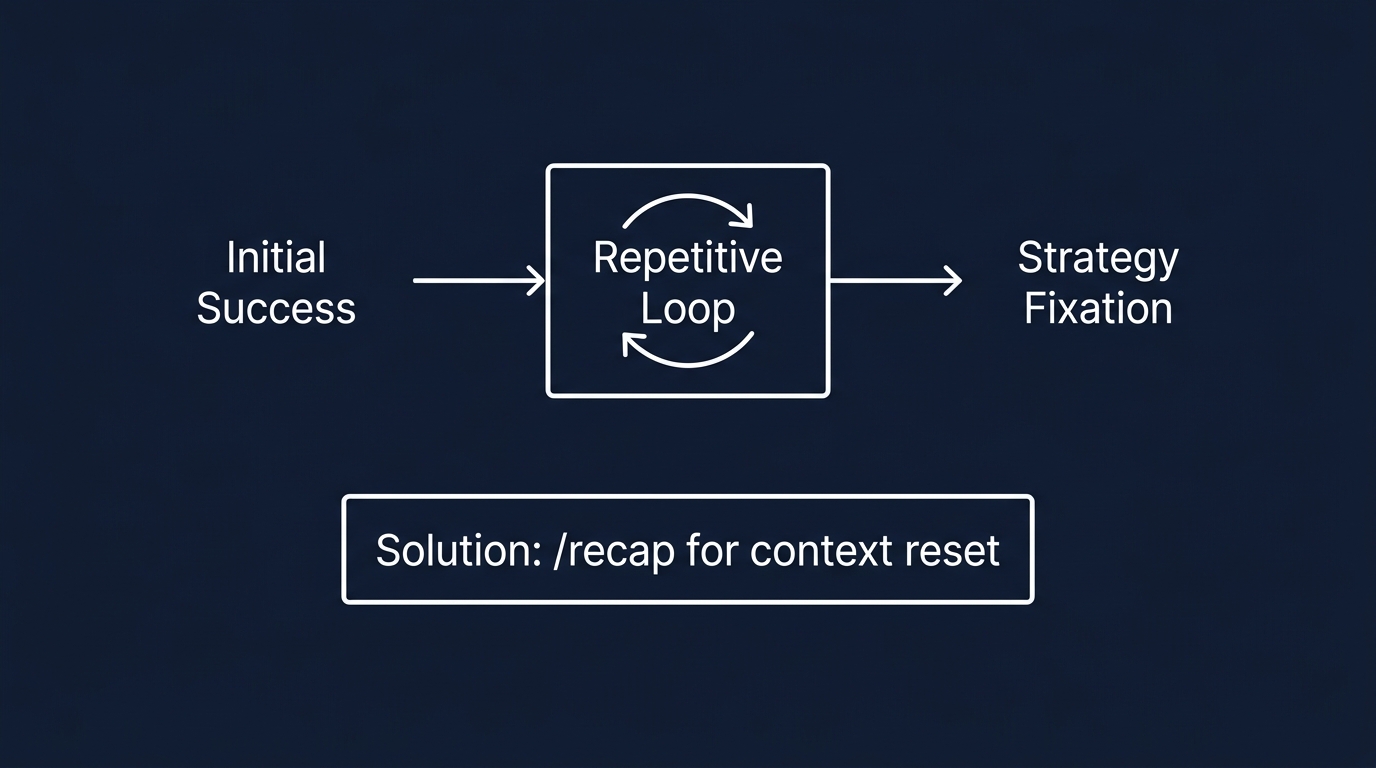

このモデルが解決した問題は明確だ。従来のLLMをエージェントとして使うと、初期段階で成功した手法を繰り返し、やがて行き詰まる。これは推論能力ではなく、長時間タスクでの「戦略の固着」だ。数千回のツール呼び出しを経ても判断が劣化しない設計を、訓練レベルから作り込んでいる。

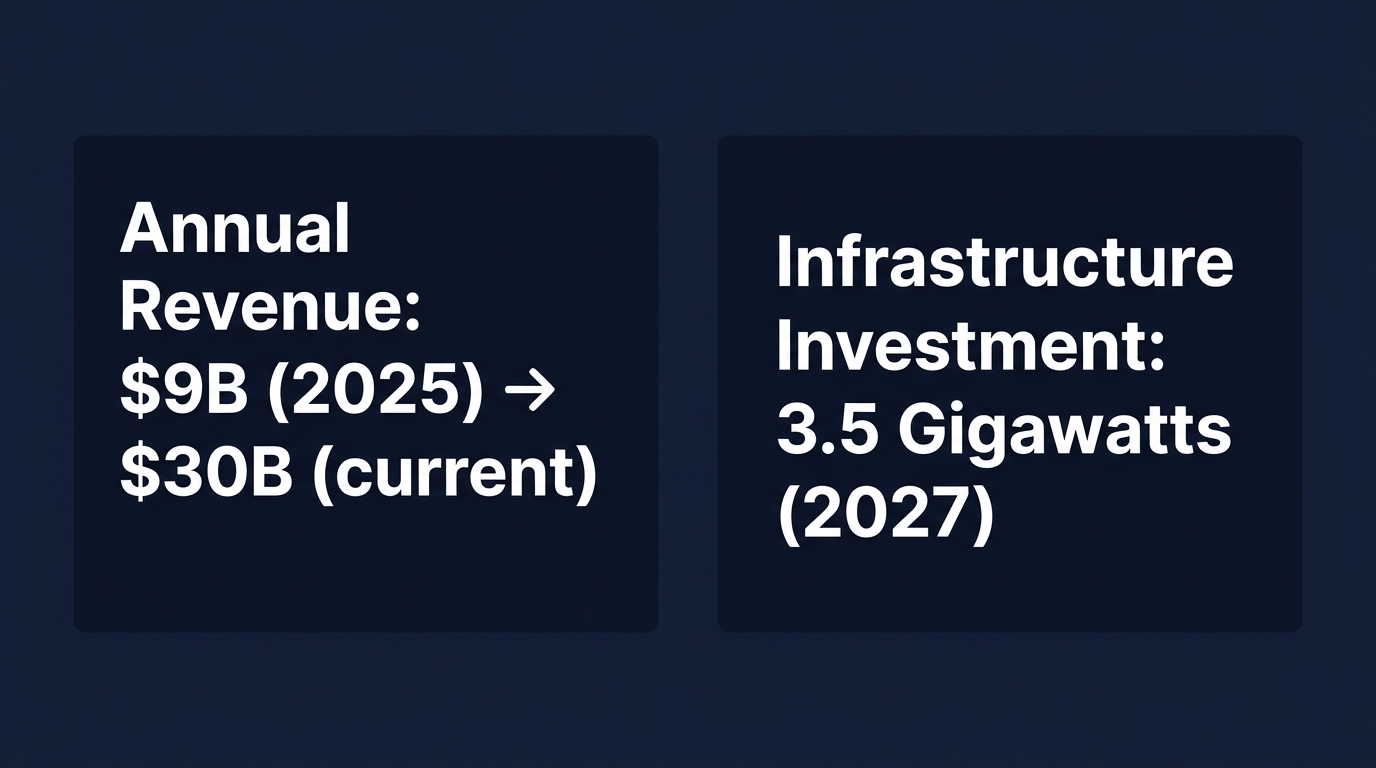

Anthropicはインフラ側で動いた。Google・Broadcomとの新たな計算資源契約を締結。関連する公開情報から3.5ギガワット規模の計算資源が確保される。2027年に稼働予定で、米国内に大半を配置する。Anthropicの年間収益換算は300億ドル。2025年末の90億ドルから急増した。年間100万ドル以上を支出するエンタープライズ顧客が1,000社超という数字が、このインフラ投資の背景にある。

Claude Codeのバージョン2.1.94が公開された。長時間エージェント実行に直撃する内容だ。

主要な変更点は以下の通りだ:

- ENABLE_PROMPT_CACHING_1H 環境変数の追加。APIキー・Bedrock・Vertex・Foundryで1時間TTLのプロンプトキャッシュを有効化できる

- FORCE_PROMPT_CACHING_5Mで5分TTLを強制指定可能

- recap機能の追加。セッションに戻った際のコンテキスト要約を自動提供。「/recap」コマンドで手動起動も可能

- /resume ピッカーの改善。現在のディレクトリのセッションをデフォルト表示

- サーバーレート制限とプランの使用量制限を区別するエラーメッセージ

- メモリフットプリントの削減。言語グラマーをオンデマンドロードする方式に変更

しんたろー:

changelogを読んで全部つながっていると感じた。

キャッシュTTL制御、recap、resume改善。全部「長時間実行中にコンテキストをどう維持するか」という一点に収束している。

エージェントの完走率を上げるための設計思想が見える。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。コーヒーを飲みすぎて手が震えている。

「コンテキストの断片化」という本当の敵

長時間エージェントが止まる原因は大きく3つだ。

① キャッシュ切れによるコスト爆発と遅延

② コンテキストウィンドウの肥大化による推論劣化

③ セッション再開時の「何をやってたっけ」問題

今回のClaude Codeアップデートは、この3つ全てに手を入れている。

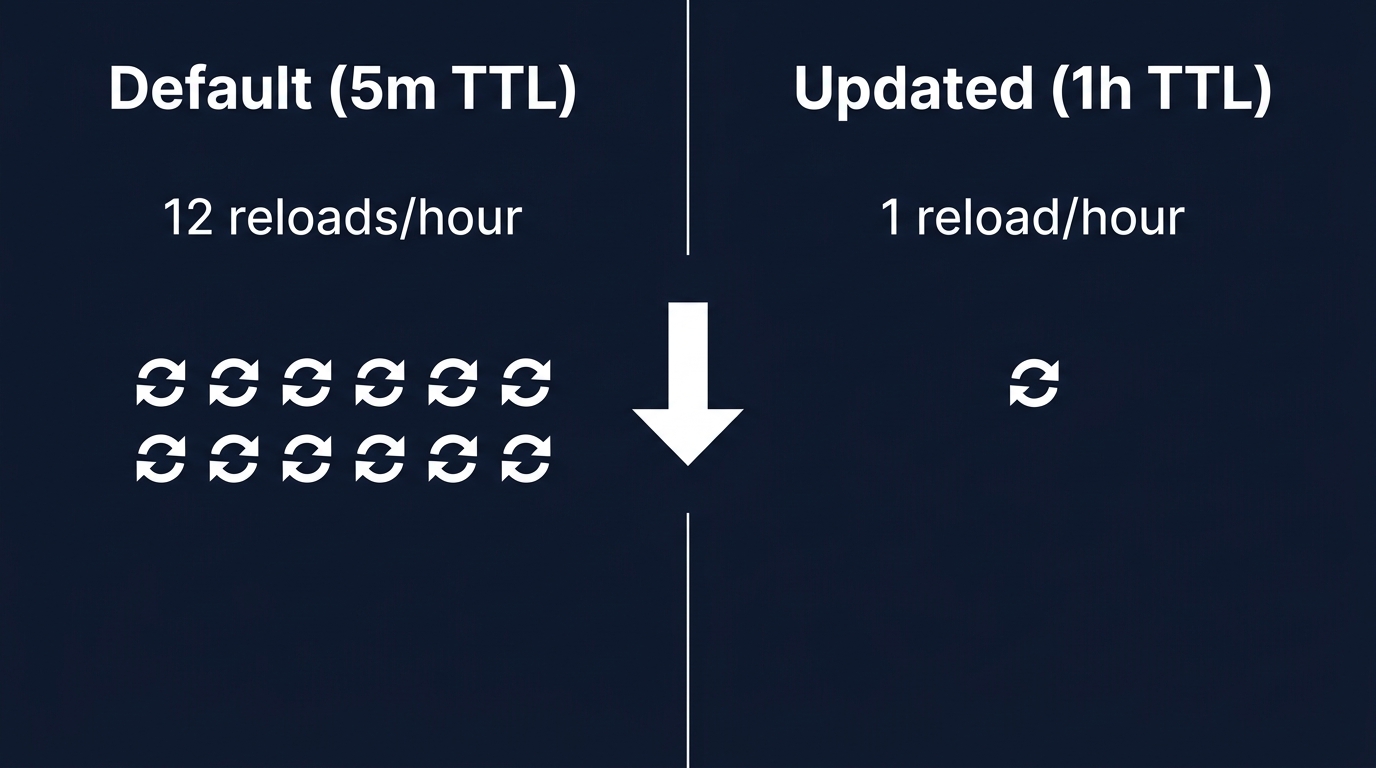

キャッシュTTLの話から始める。エージェントが長時間動くとき、同じリポジトリの情報を何度も参照する。デフォルトの5分TTLだと、5分ごとにキャッシュが切れてリポジトリ情報を再読み込みする。1時間のセッションなら12回分の再読み込みコストが発生する。大規模なコードベースほど、この差は大きい。

ENABLE_PROMPT_CACHING_1Hを有効にすることで、1時間のセッション中はリポジトリのシステムプロンプト部分がキャッシュされ続ける。コスト削減と推論速度の維持に効く。

次にrecap機能。エージェントが長時間動いた後、人間がセッションに戻ったとき「どこまで進んでたっけ」という状況が発生する。従来は全トランスクリプトを読み直すか、エージェントに状況確認させるしかなかった。recapはセッションの要約をモデルが生成して提示する。コンテキストの断片化を補完する仕組みだ。

さらに、CLAUDE_CODE_ENABLE_AWAY_SUMMARYという環境変数でテレメトリ無効時にもrecapを強制できる。プライバシー重視の環境でも使える設計だ。

モデル切り替え時の警告も追加された。「/model」コマンドでセッション途中にモデルを変えると、次のレスポンスで全履歴がキャッシュなしで再読み込みされる。これを知らずに実行すると、コストが一気に跳ね上がる。警告が出るようになったのは、そういう事故を防ぐためだ。

業界全体の文脈に戻る。前述の754Bエージェント特化モデルが「8時間自律実行」を実現するには、モデル側の訓練だけでなくクライアント側のインフラが必要だ。どれだけ優秀なモデルでも、キャッシュが5分で切れてコストが爆増し、セッション再開時にコンテキストが失われるなら、長時間実行は成立しない。

Claude Codeのアップデートは、「モデルの賢さ」ではなく「エージェントが完走するためのインフラ」に投資している。Anthropicの3.5ギガワット規模のインフラ投資も同じ文脈だ。賢いモデルを安定して動かし続けるための計算資源の確保。2027年稼働というタイムラインは、エージェントが「試験的な実験」から「本番業務の主力」になる時期を見越している。

しんたろー:

「モデルの賢さ競争」から「完走率競争」へのシフトだ。

Claude Codeで毎日コードを書いていると、キャッシュTTLの話は地味に大きい。

長めのタスクを走らせるとき、5分ごとにキャッシュが切れてる感覚があった。

1時間TTLになるなら、バッチ処理系のタスクは設計を見直す価値がある。

Anthropicのインフラ投資が開発者に与える影響も整理する。

- APIレート制限の緩和:計算資源が増えれば、エージェントが大量トークンを消費するタスクでも制限に引っかかりにくくなる

- 大規模コンテキストウィンドウの安定稼働:現時点でも200Kトークンのコンテキストウィンドウを持つが、インフラ増強で安定性が上がる

- 推論速度の改善:TPUベースの計算資源はレイテンシ改善にも寄与する

ただし2027年稼働という点は注意が必要だ。今すぐ恩恵を受けられる話ではない。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

今の開発に直接関係する話

1. ENABLE_PROMPT_CACHING_1H を今すぐ確認する

Claude Codeを使って長めのタスクを走らせているなら、この環境変数の設定を確認する。特に大きなリポジトリを参照しながら作業するケースで効果が出る。設定方法は「/config」から確認できる。

2. /recap をセッション管理の標準フローに組み込む

エージェントに長時間タスクを任せる場合、途中で確認するタイミングで「/recap」を使う。全トランスクリプトを読み直すより速く、現在地を把握できる。特に複数のサブタスクが絡み合う開発タスクでは、recapで全体像を整理してから次の指示を出すほうが精度が上がる。

3. セッション再開時のコンテキスト設計を見直す

「/resume」でセッションを再開するとき、何も考えずに再開するとモデルが「どこまでやったっけ」状態になる。recapを活用しつつ、再開時の最初のメッセージで「現在の状態を確認して、次のステップを提案して」という指示を入れる設計が有効だ。

4. モデル切り替えのコストを意識する

セッション途中で「/model」を使ってモデルを変えると、全履歴がキャッシュなしで再読み込みされる。これは意図しないコスト増の原因になる。モデルを変える必要があるなら、新しいセッションを開始するほうがコスト効率がいい。

5. 自作エージェントを作るなら「キャッシュ戦略」を最初に設計する

Claude APIを直接叩いてエージェントを作る場合、キャッシュポイントの設計が完走率を左右する。システムプロンプト部分(リポジトリ情報、コンテキスト情報)はキャッシュが効くように構造を固定する。タスクごとに変わる部分とキャッシュすべき部分を分離する設計が基本だ。

6. 「8時間自律実行」を目指すなら推論の停滞対策が必要

長時間エージェントの最大の敵は「同じ手法のループ」だ。Claude Codeのrecapがモデルに「新しい視点」を与える仕組みとして機能するように、定期的にコンテキストを整理してモデルに状況を再認識させる設計が有効だ。一定のステップ数ごとに「現在の状況を整理して、まだ試していないアプローチを提案して」という指示を挟む。

しんたろー:

自作エージェントを考えている人へ。

キャッシュ設計を後回しにすると、長時間実行のコストが想定の3〜5倍になることがある。

モデルの選定より先に「キャッシュ戦略どうするか」を決めておくべきだ。

Claude Codeがここまで細かくTTL制御を実装してきたのは、実務でのコスト問題が顕在化している証拠だ。

FAQ

Q1. なぜエージェント開発においてプロンプトキャッシュのTTL制御が重要なのですか?

エージェントは長時間にわたり同じリポジトリ情報を参照し続ける。キャッシュが切れるたびに再読み込みが発生し、コストと遅延が急増する。デフォルトの5分TTLでは、1時間のセッション中に12回の再読み込みが発生する。1時間TTLを設定することで、長時間のコーディングセッション中でも推論コストを抑えつつ、モデルが最新のコードベースを効率的に参照し続けられる。TTL制御はモデルの賢さではなく、エージェントの経済性を決める要素だ。

Q2. 8時間自律実行するエージェントを作る際、最も注意すべき技術的ボトルネックは何ですか?

最大のボトルネックは「推論の停滞」だ。モデルは初期段階で成功体験を得ると、同じ手法を繰り返して行き詰まる傾向がある。これは推論能力の問題ではなく、長時間タスクで発生する「戦略の固着」だ。対策は2つある。1つは非同期強化学習で長時間タスクに特化した訓練を受けたモデルを選ぶこと。もう1つはClaude Codeのrecap機能のように、定期的にコンテキストを整理してモデルに新しい視点を与える仕組みを実装することだ。

Q3. Anthropicのインフラ投資は、API利用者にとってどのようなメリットがありますか?

2027年以降の話になるが、計算資源の大幅増強はAPI利用者に3つの恩恵をもたらす。①レート制限の緩和:エージェントが大量トークンを消費するタスクでも制限に引っかかりにくくなる。②大規模コンテキストウィンドウの安定稼働:現在の200Kトークンのコンテキストウィンドウをより安定して使えるようになる。③推論レイテンシの改善:TPUベースの計算資源は推論速度にも寄与する。インフラの安定性はそのまま開発の継続性に直結する。

エージェントが完走する時代の入り口に立っている

モデルの賢さ競争は続く。今起きているのは、「賢いモデルを完走させるインフラ」の競争だ。

Claude Codeのchangelogと、Anthropicの巨大なインフラ投資と、新興ラボの8時間自律実行モデル——全部同じ方向を向いている。

今すぐできることは小さい。キャッシュTTLを設定して、recapを使って、セッション設計を見直す。それだけで、エージェントの完走率は変わる。

SNS運用のような繰り返しタスクも、エージェントに任せる時代が来ている。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ