SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

華麗なデモの裏にある泥臭い現実

AIエージェントを連携させて業務を完全自動化する。

最高にかっこいい響きだ。

だが実際に毎日動かし始めると、月末のAPI請求額に青ざめることになる。

そして数週間後には、AIの的外れな回答と堂々巡りの対話に頭を抱える。

原因はプロンプトの書き方ではない。

システム設計の欠如だ。

静的データと動的データの混在がキャッシュを無効化し、コストを跳ね上げる。

過去と現在の指示の並列配置がAIを混乱させ、出力を破綻させる。

今日は、毎日動くAIシステムを崩壊させないためのアーキテクチャの話をする。

自動化の成功事例と隠れた2つの壁

海外のAI開発コミュニティでは、一発芸のデモはもう評価されない。

実務に定着し、毎日地味に動き続ける自動化の事例だけが注目を集めている。

あるコンサルティングチームは、15種類の専門エージェントを連携させたパイプラインを構築した。

動画の時系列分析、SNSからの顧客インサイト抽出、高エンゲージメント投稿の分類を並列で実行させる。

これらをリサーチフェーズとして処理した後、ポジショニングやコピーライティングのエージェントが順次稼働する。

各段階には品質管理マネージャー役のエージェントが配置されている。

新規性とインパクトの2軸で出力を厳しくスコアリングする仕組みだ。

結果として、かつて2週間かかっていた案件がわずか4時間で完成するようになった。

このチームは提供価値の向上を理由に、料金を4倍に引き上げた。

現在では3,000社以上の小規模エージェンシーがこの手法を導入しているという。

日本のテレビ番組を無料配信する動画サービスでも、iOSアプリ開発における不具合修正プロセスが標準化された。

プロジェクト固有の知識がほぼない状態で途中参画したエンジニアが、分析から実装、PR作成までの3ステップを自動化した。

QAから報告された不具合を調査し、原因特定と修正方針をまとめたIssueを自動生成する。

そのIssueをもとに実装を行い、最後にAndroid実装との比較表を含む詳細なPRを生成する。

バグ修正は明確なゴールがあり、スコープが限定的なためAI活用と相性が良い。

途中参画メンバーでも一定品質のアウトプットが可能になり、プロジェクトのリリースを成功させた。

暗号資産の予測市場でも、完全な自動取引システムが会話ベースで構築された。

5分ごとの価格監視とポートフォリオの損益トラッキングを自律的に行う。

複数の市場で価格差を検出し、確実な利益機会を見つけると自動で取引を実行する。

1回の取引は最大20ドル、1日の上限は50ドルという安全装置も組み込まれた。

初週の成績は8件の決済済み取引で75%の勝率を記録した。

実現ROIは9.6%に達し、特定戦略では36.2%という驚異的な数字を叩き出した。

退屈で地味な戦略ほど、システムとして安定稼働する。

金融システムをAIで構築する事例として、極めて実践的なアプローチだ。

広告運用の領域でも、泥臭い分析業務が完全自動化されている。

従来は管理画面で数値を手動確認し、キーワードを精査して改善案を人間が考えていた。

これには最低3時間、悪い時は4〜5時間の作業枠が必要だった。

新しいフローでは、データベースに格納された広告データをAIが自動取得する。

状況の要約から考察、具体的な改善提案の作成までを一気に処理する。

人間がやるのは、出力された提案の採否を判断するだけだ。

社内チャットボットの改善サイクルも、見事なまでに自動化されている。

ユーザーが低評価ボタンを押すと、そのフィードバックが自動で課題管理ツールに登録される。

AIが原因を分析して改善案を提示し、開発者はレビューして修正を適用するだけだ。

体験予約のマーケットプレイスを運営する企業では、CPO自らが11個の自動化ジョブを構築した。

毎朝7時になると勝手に動き出し、チャットツールを開くと結果が待っている仕組みだ。

非エンジニアの役員が実務レベルで自動化を回している点が注目を集めている。

あるWeb・アプリ開発会社は、複数のAIコーディングエージェントを比較検討した結果、実装品質と速度のバランスから特定のツールを全社導入した。

導入後、数日で数万行のコードを生成したメンバーが出現するなど活用が進んでいる。

検証開始から導入決定まで約1年かかったが、1〜2ヶ月での意思決定が望ましかったと振り返っている。

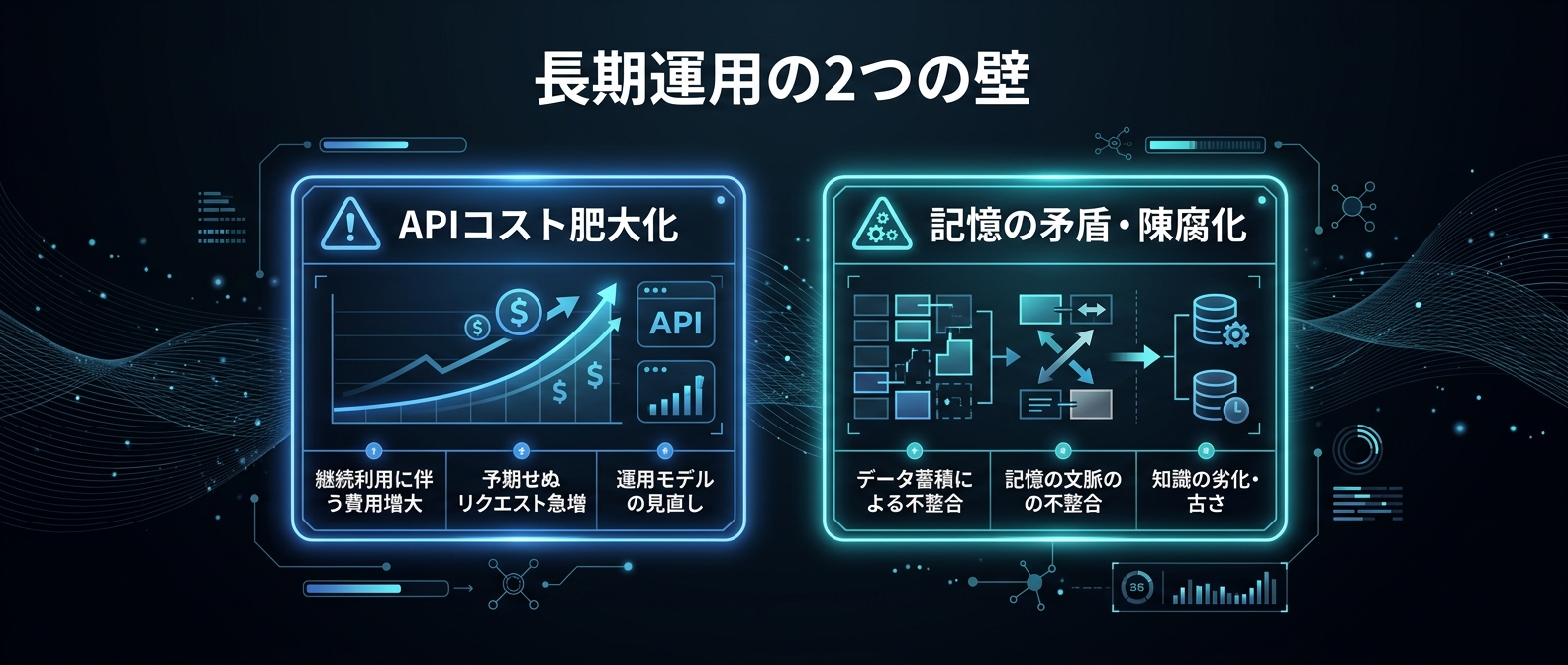

だが、これらの「毎日動くシステム」を自分たちで長期運用しようとすると、必ず2つの壁に激突する。

一つはAPIコストの肥大化だ。

毎日数百回のタスクを実行するたびに、数千トークンのシステムプロンプトを送信し続けることになる。

これはすべて入力トークンとして計算され、容赦なく書き込みコストとして計上される。

月末の請求書を見て、システムの停止を検討することになる。

もう一つは記憶の矛盾と陳腐化だ。

プロジェクトが数週間続くと、過去の指示と現在の指示が入り混じる。

「Aの方法でやって」という過去の指示と「Bに変更して」という新しい指示が、AIの中で等価に扱われる。

結果として、AIの判断がブレ始め、期待する出力が得られなくなる。

この2つの壁を越えられない限り、AIの自動化は実務に定着しない。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

プロンプトエンジニアリングからシステム設計へ

APIコストの肥大化を防ぐ鍵は、プロンプトのキャッシュ戦略にある。

ClaudeのAPIには、同じプロンプトを再利用してコストを下げる機能が用意されている。

有効期限は5分間と非常に短い。

この5分以内に同じプロンプトを再送信すれば、キャッシュがヒットする。

初回は数千トークンの書き込みコストが発生するが、2回目以降は読み込みコストだけで済む。

これを活用すれば、入力コストを約89%削減できる。

毎日100回のタスクを実行する環境なら、月に換算して90ドルのコストが10ドルに下がる計算だ。

実装自体は難しくない。

システムプロンプトの指定を文字列からリスト形式に変更し、キャッシュ制御のタイプを指定するだけだ。

だが、ここで多くの開発者が罠にハマる。

キャッシュは完全一致で評価されるという仕様だ。

現在時刻やユーザー固有のデータなど、動的な値が1文字でも混ざるとキャッシュは無効になる。

毎回異なるタイムスタンプをシステムプロンプトに埋め込む設計は破綻する。

固定のシステムプロンプトと、毎回変わるユーザーメッセージを完全に分離する情報アーキテクチャに移行する。

静的データと動的データを明確に切り分ける設計が、コスト最適化に直結する。

しんたろー:

APIのキャッシュ仕様を知らずに、毎回ご丁寧に現在時刻をシステムプロンプトに突っ込むと痛い目を見る。

月末の請求書で変な声が出ないよう、動的変数の扱いは本当に気をつけたいと思った。

記憶の矛盾を防ぐには、コンテキストの階層化が機能する。

人間は新しい情報を重視し、古い情報を自然に忘れる特性を持っている。

心理学で言う新近性効果だ。

だがAIにはこの新近性効果が存在しない。

AIは与えられたコンテキスト内の全情報を、時間軸に関係なく等価に扱う。

1週間前のフィードバックも、今日のフィードバックも同じ重みで参照する。

だから、チャットの履歴を要約して次のセッションに渡すような「引き継ぎプロンプト」では長期運用が破綻する。

引き継ぎプロンプトはその時点のスナップショットを渡すだけで、なぜその状態に至ったかの経緯を保存しない。

さらに、有効な指示と撤回された方針が並列に存在し、肥大化していく。

AIの記憶管理で最も難しいのは、覚えさせることではなく忘れさせることだ。

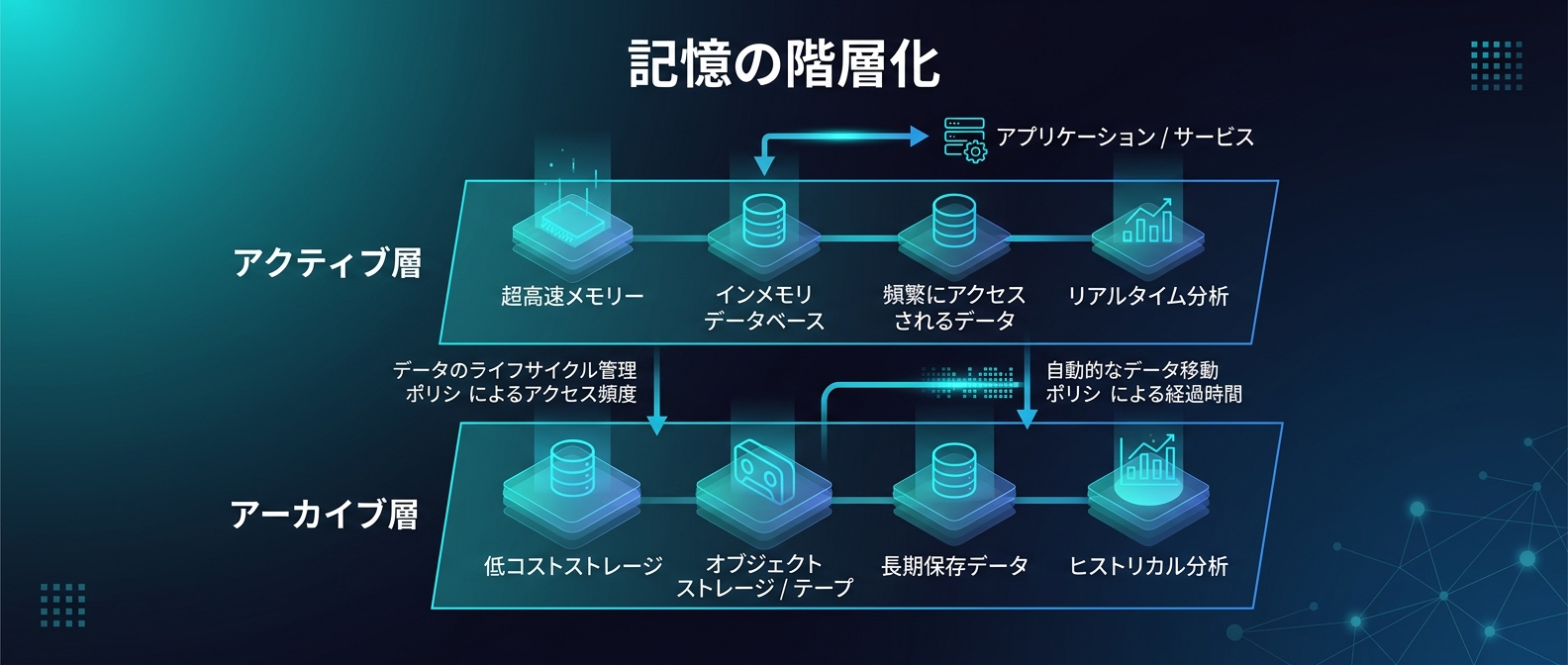

これを解決するのが、記憶の3層構造による管理手法だ。

現在有効な指示だけをまとめたアクティブ層と、過去の経緯を残すアーカイブ層に物理的に分割する。

アクティブ層には20〜40件程度の最新情報だけを置く。

AIのセッション開始時に自動読み込みされるのは、この層のデータだけだ。

これがAIの「今の人格」と「現在の行動規範」を厳密に規定する。

古い方針や撤回されたルールは、単純に削除しない。

なぜその判断をしたかのエビデンスとして、将来必ず必要になる。

ステータスを「アーカイブ済み」に変更し、AIが直接読み込まない別ファイルに移す。

しんたろー:

Claude Codeにコーディング規約を覚えさせた後、途中で方針を変えると見事に混乱しそうだ。

「あのルールはもう古いから無視して」と書いても読んでくれないだろう。物理的にファイルを分けるのが一番確実だと思った。

アーカイブ層のデータは、AIの意思決定には直接使わせない。

あくまで人間が過去の経緯を振り返るためのリファレンスとして保持する。

消してしまうと、1ヶ月後に「なぜこの実装にしたんだっけ」と悩むことになる。

さらに過去の膨大な記録は、ベクトルデータベースに入れて検索可能にする構想もある。

これが第3の層となる。

ただし、検索結果をそのままAIの指示としてコンテキストに注入すると破綻する。

ベクトル検索のコサイン類似度は、内容の近さを返すだけで、その情報が今も有効かどうかは判定できない。

アーカイブ済みの古い情報が、関連性が高いという理由だけで上位にヒットしてしまう。

結果として、撤回されたはずの古い指示をAIが「現在も有効なルール」として誤認するリスクが残る。

だから第3層のデータは、あくまで「読み物」であって「指示」ではないという原則を徹底する。

AIの自律性に任せるのではなく、人間が明示的に記憶の階層を管理・制御する。

この泥臭い情報整理が、AIシステムを安定稼働させる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

提案はAI、実行判断は人間に委ねる

毎日動く自動化システムを実務に組み込む際、もう一つ決定的な視点がある。

それは提案と実行の分離だ。

完全自動化はAPI経由で技術的に可能だが、ビジネスの現場ではリスクが高すぎる。

広告の予算変更や本番環境へのコードマージなど、破壊的変更を伴う領域では特にそうだ。

AIが予期せぬハルシネーションを起こしたり、極端な判断を下したりした時のダメージは計り知れない。

だから、すべての権限をAIに渡すアーキテクチャは採用しない。

データの収集から複雑な分析、そして具体的な改善案の作成まではAIに完全に任せる。

ここは人間がやると数時間かかるが、AIなら数秒で終わる最もレバレッジが効く部分だ。

そして最後の承認ゲートだけを人間が担う設計にする。

この「提案はAI、実行判断は人間」という切り分けは、あらゆる業務で汎用性が高い。

人間の作業時間を数時間から数秒に削減しつつ、システムの安全性と品質を確実に担保する。

暴走したときのリスクを最小限に抑える、極めて現実的な運用手法だ。

しんたろー:

1人SaaS開発でも、テストコードの生成からPR作成までは全部自動でやらせてみたい。

でも本番環境へのマージボタンだけは、絶対に自分で押す設計にする。寝てる間にDB吹き飛ばされたら立ち直れないからね。

APIコストを下げるための静的データと動的データの分離。

長期運用でAIを混乱させないための記憶の階層化。

そしてリスクをコントロールするための承認プロセスの設計。

これらは単なるプロンプトエンジニアリングの小手先のテクニックではない。

システム全体をどう構築し、どう運用していくかというアーキテクチャの問題だ。

AIエージェントを実務で使い倒すには、この視点の切り替えが前提となる。

明日もっといいツールが出ると待つ必要はない。

今は今の最適解を選んで、泥臭く実装を進める。

デモ映えする一発芸ではなく、地味だが毎日確実に動く仕組みを作る。

AIシステム設計のよくある疑問

Prompt Cachingを有効にするための具体的な実装方法は?

Claude APIのリクエストにおいて、システムプロンプトを文字列からリスト形式に変更する。そこにキャッシュ制御の指定として「エフェメラル」タイプを追加するだけで有効になる。重要な注意点として、キャッシュは完全一致で評価され、有効期限は5分間と短く設定されている。そのため、現在時刻やユーザー固有のデータといった動的な値が1文字でも混ざるとキャッシュミスとなる。動的な変数はシステムプロンプトから完全に分離し、毎回変わるユーザーメッセージ側に含めるよう、プロンプトの構造自体を静的・動的に切り分ける設計見直しが前提となる。

長期プロジェクトでAIが過去の古い指示に従ってしまうのを防ぐには?

AIは人間のように「古い情報を自然に忘れる」という新近性効果を持たず、与えられたコンテキスト内の全情報を等価に扱う。そのため、古い指示と新しい指示が混在するとAIが混乱する。これを防ぐには、記憶を物理的に階層化するアプローチが有効だ。現在有効な指示だけをまとめたアクティブなファイルと、過去の経緯として残すがAIの意思決定には直接使わせないアーカイブファイルに分割する。単に削除するのではなく、ステータスをアーカイブ済みに変更して別ファイルに移すことで、AIの判断のブレを防ぎつつ、人間が後から経緯を振り返れる状態を維持できる。

「提案はAI、実行判断は人間」という切り分けはなぜ機能するのか?

完全自動化はAPI経由で技術的に可能だが、AIが予期せぬ挙動をした際のビジネスリスクをコントロールするためだ。例えば広告の予算変更や本番環境へのコードマージなど、破壊的変更を伴う領域では暴れたときのリスクが甚大になる。そこで、データの収集・分析・改善案の作成という最も時間のかかる「リサーチとドラフト作成」までをAIに完全に任せ、最後の承認ゲートのみを人間が担う設計にする。これにより、人間の作業時間を数時間から数秒に削減しつつ、システムの安全性と品質を担保する現実的な運用が可能になる。

まとめ

AIによる自動化は、プロンプトの呪文詠唱から堅牢なシステム設計のフェーズに移行した。

キャッシュ戦略と記憶の階層化なしに、毎日の安定稼働は実現できない。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ