Googleのエンジニアが1年かけて作ったシステム。

Claude Codeはそれをたった1時間で生成した。

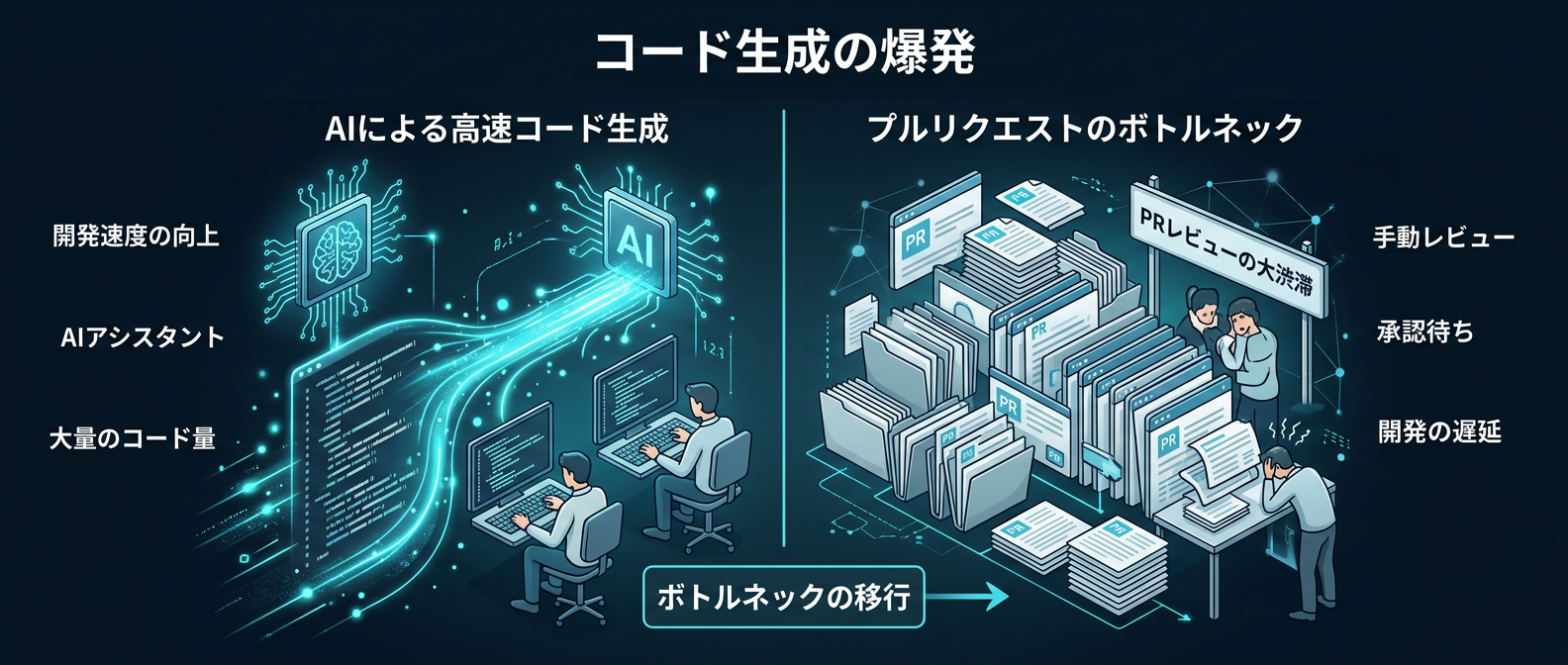

コード生成の速度が上がった結果、今の開発現場で何が起きているか。

レビュー待ちのプルリクエストの山だ。

Anthropicはこの自ら生み出した大渋滞を、6つのAIエージェントで強行突破しようとしている。

AIが書いたコードは、AIに監査させる。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

異常な生成速度と崩壊するレビュー体制

事の発端は、圧倒的な出力能力の証明だ。

GoogleのプリンシパルエンジニアであるJaana Doganの発言が業界をざわつかせている。

彼女のチームが1年かけて構築した分散エージェントのシステム。

Claude Codeは、わずか3段落のプロンプトから1時間でそれを生成してしまった。

自然言語で指示を出し、大量のコードを即座に生成する。

いわゆる「Vibe coding」の波だ。

エンタープライズ企業の悲鳴を伝えている。

Anthropicのプロダクト責任者Cat Wuは、エンタープライズのリーダーたちから同じ質問を浴びせられていると語る。

「Claude Codeが大量のプルリクエストを出してくる。これをどうやって効率的にレビューすればいいんだ?」

コードの出力が増えた。

プルリクエストの数が爆発した。

人間のエンジニアによるレビューが完全にボトルネックとなり、コードの出荷がストップしている。

Anthropicのランレート収益はすでに25億ドルを突破した。

Anthropicはこの大渋滞を解消するため、Claude for TeamsおよびEnterprise向けに、AIによる自動レビュー機能をローンチした。

マッチポンプ感がすごい。Claude Codeで大量のコードを吐き出させて現場をパンクさせ、今度は「AIのコードはAIにレビューさせましょう」とエンタープライズ版を売り込む。自ら課題を作り出し、自ら解決策を売る。ビジネスとして強すぎる。

6つの専門エージェントによる包囲網

このレビュー機能の実態は、単なる一つの巨大なAIではない。

Claude Codeのプラグインとして提供されるこのツールは、6つの専門特化したAIエージェント群だ。

それぞれが独立した役割を持ち、多角的にコードを監査する。

各エージェントの役割分担が見えてくる。

1つ目は、コーディング規約とスタイルを監視するエージェント。

プロジェクトのCLAUDE.mdに記載されたルールを読み込み、違反がないかを徹底的にチェックする。

2つ目は、テストカバレッジを分析するエージェント。

単純な行数の網羅率ではなく、「振る舞い」のカバレッジを見る。

エッジケースやエラー条件の抜け漏れを、優先度付きで報告してくる。

3つ目は、サイレントフェイルを検出するエージェント。

catchブロックでのエラーの握りつぶしや、不適切なフォールバック処理。

実行時に問題が表面化しにくい、最も厄介なバグを専門に探し出す。

4つ目は、コメントとコードの乖離を見抜くエージェント。

大量のドキュメントコメントやdocstringsが、実際のコードの挙動とズレていないかを検証する。

残りのエージェントも、それぞれの専門領域でコードを睨みつける。

人間のチームレビューに近い体験を、一人で、しかも一瞬で得られる仕組みだ。

ターゲットで変わる「AIの性格」

ここで複数の報道を統合すると、非常に対照的な設計思想が浮かび上がる。

プラグイン版は「スタイルガイドやコーディング規約への準拠」を専門とするエージェントの存在を強調している。

しかし、全く違うことが語られている。

エンタープライズ向けの公式機能について、Anthropicは「スタイルよりも論理エラーに純粋にフォーカスする」と明言しているのだ。

開発者は、AIからの細かいスタイルの指摘にイライラする。

「すぐにアクションに移せない指摘」はノイズでしかない。

だからエンタープライズの自動連携では、スタイルを無視して最も優先度の高い論理エラーの検出に全振りしている。

一方で、個人やチームが手元で実行するプラグイン版では、規約のチェックも重要になる。

利用コンテキストによって、AIレビューの重点を意図的に変えている。

Anthropicは開発者のフラストレーションを完全に理解している。

1人開発で一番キツいのは、誰も自分のコードを疑ってくれないこと。ThreadPostのアーキテクチャを考えている時、論理の穴を指摘してくれる相手がいないのは本当に怖い。AIが「ここ、エラー握りつぶしてますよ」って突っ込んでくれるなら、精神的な負担は激減するはずだ。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

コードを書く時代から、監督する時代へ

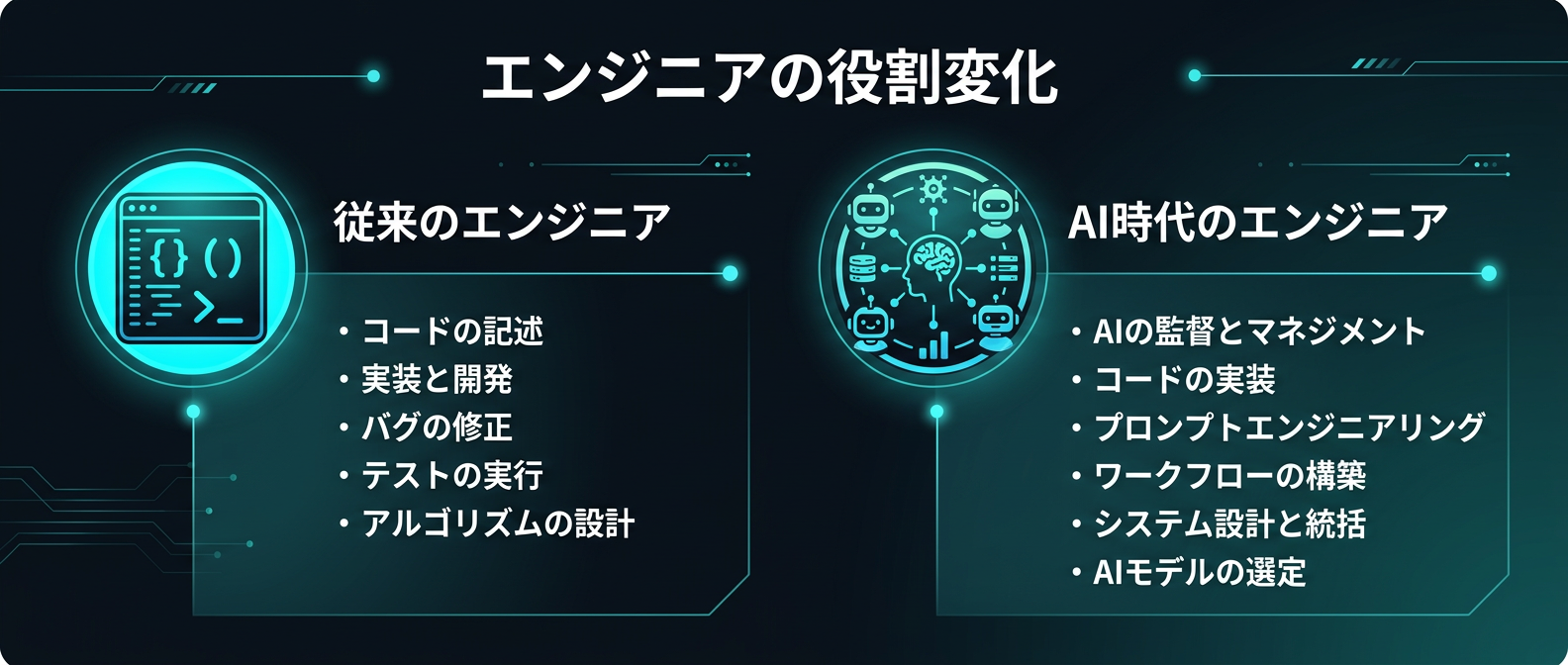

エンジニアの役割は、根底から変わった。

これまでは「コードを書くこと」が主戦場だった。

いかに速く、正確にタイピングし、ロジックを組み上げるか。

しかし、1時間で1年分のコードが生成される今、そのスキルの市場価値は変化している。

これからの主戦場は「監督」だ。

AIが生成した大量のコードと、別のAIが弾き出したレビュー結果。

この2つを突き合わせ、最終的な判断を下すのが人間の仕事になる。

AIは部分的な最適化には異常に強い。

しかし、システム全体を通したデータの流れや、根本的な論理の破綻を見抜くのはまだ甘い部分がある。

サイレントフェイルの恐ろしさを理解し、それを防ぐ設計ができるか。

そこがエンジニアの差別化ポイントになる。

また、複数のAIエージェントを適切にオーケストレーションするスキルも必須だ。

どのタイミングで、どのエージェントを走らせるか。

出てきた指摘をどうフィルタリングし、どう修正に繋げるか。

AIを「使う」のではなく、AIチームを「マネジメント」する感覚だ。

今すぐ慣れるべきは「AI同士の会話」

手元でClaude Codeを使っているなら、レビュープラグインの導入は検討の価値がある。

自分が書いたコード、あるいはAIに書かせたコードを、別のAIエージェントに監査させる。

この「AIがAIをレビューする」というフローに、今のうちから慣れておく。

指摘の中には、的外れなものもある。

ノイズに感じることもある。

しかし、人間同士のレビューだって最初はそうだ。

AIの特性を理解し、本当にクリティカルな指摘だけを拾い上げる嗅覚を養う。

それが、これからの開発スピードを決定づける。

AIのレビューは最初はノイズが多くてイライラするかもしれない。でも、人間だって最初は的外れな指摘をする。AIのスコアリング機能を使って「本当にヤバい指摘」だけを拾うようにすれば、結局は人間のレビュアーを待つより圧倒的に速い。

FAQ

Q1: Claude Codeのレビュープラグインはどのようにインストールすればいい?

npmを使ったグローバルインストールは現在非推奨となっている。

macOSやLinuxの場合は、curlコマンドで公式のインストールスクリプトを叩いてネイティブインストーラーから導入する。

Windowsの場合はPowerShell用のインストールスクリプトを使用する。

インストール後、/pluginコマンドでマーケットプレイスを開き、pr-review-toolkitを追加する流れだ。

Q2: エンタープライズ環境でプラグインを追加しようとするとエラーになる

組織のポリシーによって、追加できるマーケットプレイスが制限されている可能性が高い。

エラーメッセージの中に「Allowed sources」として許可リストが表示される。

その中にanthropics/claude-plugins-officialが含まれていれば、そこからインストールが可能だ。

許可リストにない場合は、社内の管理者に確認して制限を解除してもらう必要がある。

Q3: AIのレビューは誤検知やスタイルの指摘ばかりでノイズにならない?

Anthropicもその問題を強く認識している。

そのため、エンタープライズ向け機能ではスタイルを無視し、純粋な論理エラーの検出に特化する設計思想をとっている。

また、プラグイン版の各エージェントは、自分の指摘に対して「これは本当に問題か」を自己採点するスコアリング機能を備えている。

スコアの低い指摘は無視し、高スコアの深刻な問題から優先して対応することで、ノイズを大幅に減らすことができる。

まとめ

コード生成の爆発は、レビューの崩壊を生んだ。

AIが書いたコードは、AIに監査させるしかない。

この新しい開発フローを乗りこなす者が、これからのスピードを制する。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

ThreadPost 代表 / SNS自動化の研究者

ThreadPost運営。Claude Codeで1人SaaS開発しながら、海外AI最新情報を開発者目線で発信中。

@shintaro_campon関連記事

Google公式発表。Gemini 3.1 ProでAI開発はどう変わるのか。単なるチャットボットから脱却する理由

【2026年版】最新AIエージェント構築ツール3選|1人SaaS開発者が本気で比較

Anthropic公式が発表。DeepSeek等にClaudeが1600万回不正抽出された理由とAI開発への影響

【2026年版】最新AIエージェント比較3選|1人SaaS開発者が推す最強環境

【2026年版】Cursorで実現するAI駆動開発Tips10選|1人SaaS実践者が厳選

【2026年版】ChatGPT・Gemini画像生成AI5選|1人開発者が実務で使う

人気の記事

【2026年覇権交代】1億4,150万人が選ぶ「最強テキストSNS」と2つの高反応時間帯

エンゲージメント2倍!7100万件のデータから導くベスト投稿時間3つの法則

月収18万で廃業寸前だった大学中退フリーランスが「対象を絞っただけ」のメルマガ配信ツールで年商60億円を創った裏側

巨大企業の歯車として消耗していた2人の会社員が『ただの要望掲示板』を作ったら年商4.5億円。

1回25ドルのトークン消費。Claude Codeのマルチエージェント化が迫る、個人開発のハイブリッド運用。