エージェント開発の潮目が完全に変わった。これまでは何でもかんでもAPIで繋ぐのが正義だった。

今は違う。

重厚な標準プロトコルと、泥臭いローカル実行の2極化が急速に進んでいる。

1人SaaS開発において、このアーキテクチャ選択は死活問題だ。

レイテンシが数百ミリ秒変わる。実装コストが数日単位でブレる。

僕らの限られた開発リソースをどこに投下するか。最新の海外トレンドから読み解く。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

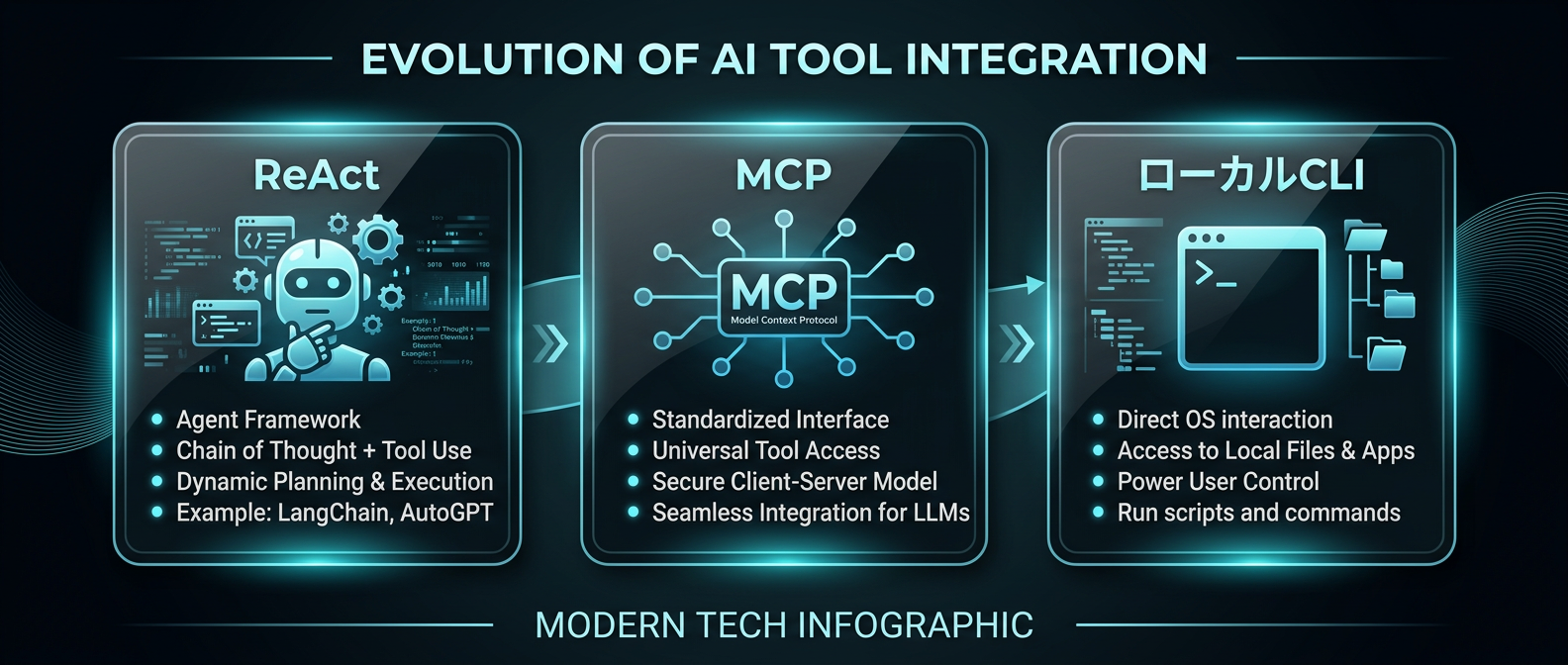

AIの外部連携を巡る3つの潮流

最近の海外AI開発コミュニティの議論を追うと、外部ツール連携のベストプラクティスが根本から再定義されている。

AIが単なるチャットボットから、自律的に動くエージェントへと進化する過程で生じた必然の変化だ。

かつてのエージェント開発は、ReActと呼ばれる手法が主流だった。

AIが「推論」と「行動」を交互に繰り返すフレームワークだ。

まずAIが現状を分析して思考する。次に外部ツールを呼び出す。

その結果を観察して、また次の行動を考える。このループを回すことで複雑なタスクをこなしていた。

しかし、システムが複雑化するにつれて限界が見えてきた。

ツールの数が増えると、AIがどのツールをいつ使うべきか迷い始める。

プロンプトの設計も雪だるま式に複雑になっていった。

そこで登場したのがMCPという標準プロトコルだ。

データベースや外部SaaSとの接続を共通化する規格である。

USB-Cポートのように、AIと外部システムをシームレスに繋ぐ。

開発者はMCPサーバーを立てるだけで、AIに安全かつ構造化された形で外部データへのアクセス権を付与できるようになった。

ローカルCLIを直接叩く軽量アプローチ

一方で、全く逆のアプローチも台頭している。

ローカルのCLIツールを直接AIに操作させる、極めて軽量な手法だ。

最近話題になっているnomanのようなツールがその代表格だ。

複雑なAPIサーバーを立てる代わりに、ターミナルの生のヘルプテキストをそのままAIに読ませる。

AIに「やりたいこと」を自然言語で伝えると、対象コマンドの仕様を読み込む。そして正確な引数付きのコマンドを生成する。

汎用的なAIチャットではなく、ローカル環境に特化したエージェントとしての振る舞いだ。

例えば、JSONのフィルタリング処理を考えてみる。

これまでは、AIにJSONデータを丸ごと渡し、必要な情報を抽出させていた。

しかし、データ量が数メガバイトになると、トークン制限に引っかかる。

そこで、ローカルのjqコマンドをAIに叩かせる。

AIには「このJSONから特定のエラーログだけを抽出するjqコマンドを作って」と指示するだけだ。

実際のデータ処理はローカルのCPUで行われるため、トークン消費は数トークンで済む。処理速度も数ミリ秒で完了する。

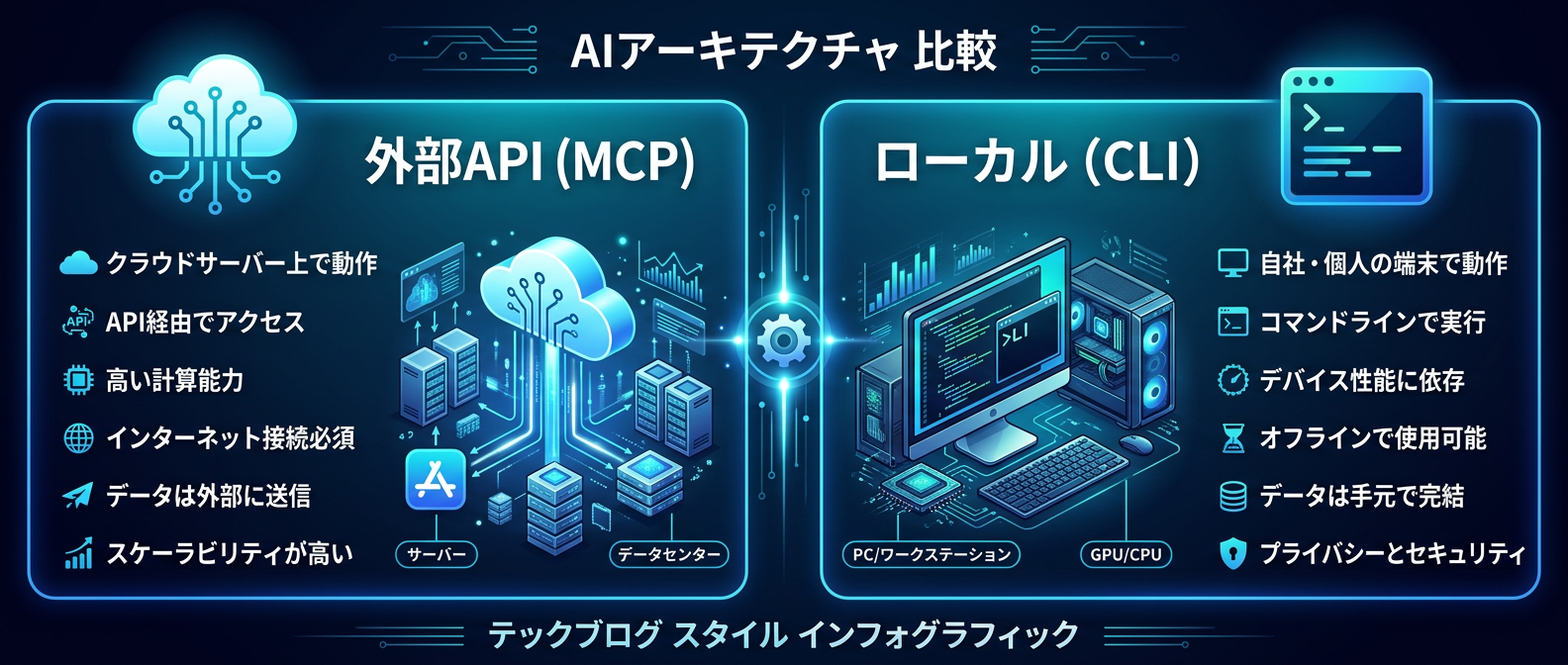

複数の海外ソースの知見を統合すると、AIの外部連携は「重厚なMCP」と「軽量なローカルCLI」の2つのアーキテクチャに収束しつつある。

タスクの性質に応じて、これらを明確に使い分けるフェーズに入った。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

1人SaaS開発におけるレイテンシとコストの天秤

エージェントのアーキテクチャが分岐する中、僕ら開発者はどう対応するか。

結論から言えば、レイテンシと実装コストの天秤をシビアに見極める。

しんたろー:

MCPの仕様書読んだとき、これ絶対運用辛くなるやつだと思った。

1人開発でマイクロサービス的な死活監視なんてやってられない。

結局モノリスなスクリプトに戻ってくるのがオチ。

MCPは確かに強力な規格だ。

認証や状態管理が必要な外部システムとの連携には欠かせない。

しかし、1人SaaS開発の現場ではオーバースペックになることが多い。

ローカルのファイルを操作するだけで、いちいちMCPサーバーを経由するのは無駄が多すぎる。

ネットワーク通信が発生し、エージェントの反応速度が著しく落ちる。

さらに、サーバープロセスの立ち上げや維持といった運用オーバーヘッドまで乗っかってくる。

ヘルプテキスト丸投げの力技

対して、ローカルCLIを直接叩かせるアプローチは極めて合理的だ。

Claude Codeを毎日使っている僕からすると、ターミナル上でのAI支援はすでに実用フェーズにあると断言できる。

まあ、たまに無限ループに陥ってPCのファンが爆音で鳴り始めるが。

AIにツールの仕様を理解させる手法も、より泥臭く、より確実なものへと進化している。

これまでは、厳密なJSONスキーマを定義してFunction Callingで渡すのが常識だった。

しかし最新のトレンドはもっと乱暴だ。

対象コマンドのmanや--helpの出力テキストを、そのままコンテキストとしてAIに投げつける。

しんたろー:

ヘルプテキスト丸投げ手法、最初は冗談かと思ったけど理にかなってる。

スキーマ定義書く手間省けるし、何より環境依存のオプションを正確に拾ってくれる。

コンテキストウィンドウが広くなった現代ならではの脳筋プレイで好き。

汎用的なLLMの知識に頼ると、存在しないオプションをでっち上げるハルシネーションが頻発する。

実際の実行環境にあるヘルプテキストを読ませることで、この問題を力技で解決している。

動画変換のffmpegも良い例だ。

オプションが複雑すぎて、人間がマニュアルを読んでも理解するのに数時間かかる。

AIにffmpegのヘルプテキストを読ませれば、数秒で完璧なコマンドを生成する。

「最初の30秒を切り取ってGIFに変換して」と自然言語で伝えるだけだ。

AIはヘルプテキストから適切なオプションを見つけ出し、正確なコマンドを組み立てる。

この手法は、あらゆるCLIツールに応用できる。

コンテキストウィンドウが拡大し、トークン単価が1/10になった現代だからこそ成立するアプローチだ。

事前のスキーマ定義という実装コストをゼロにしつつ、実行精度を極限まで高めている。

さらに、このアプローチは履歴の再利用にも優れている。

過去に成功したコマンド実行の履歴を保存し、自分専用のチートシートとしてAIに参照させる。

使えば使うほど、自分のローカル環境と開発スタイルに特化したエージェントが育っていく。

重厚なサーバーを構築せずとも、手元のターミナルだけで高度な自動化が完結する。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

適材適所のアーキテクチャ選択

では、実際の開発フローにどう落とし込むか。

タスクの規模とレイテンシ要件による厳密な使い分けが必須になる。

外部API連携やデータベース操作には、迷わずMCPやFunction Callingを採用する。

標準化されたプロトコルに乗ることで、将来的な拡張性とセキュリティを担保できる。

一方で、ローカル環境でのビルド作業、ファイル操作、ログのフィルタリングなどは、CLIコマンドの直接実行に寄せる。

既存のシェルスクリプトやCLIツールをそのままAIのエージェントとして再利用する。

これにより、新たなインターフェースを開発するコストを極限まで削ることができる。

AIが得意な「非構造化データの解釈」と、既存ツールが得意な「決定論的な処理」の境界線を明確に引く。

しんたろー:

ThreadPostのバッチ処理、全部AIに書かせると破綻しそうだ。

複雑なロジックはGoのCLIツールに切り出して、AIには引数だけ決めさせる構成が気になる。

餅は餅屋。AIは万能の神じゃない。

何でもかんでもAIの推論に任せようとすると、システムは必ず破綻する。

トークン消費は跳ね上がり、実行時間は予測不能になる。

AIは「システム全体を制御する頭脳」ではない。

「既存のツールを繋ぐ賢いグルー(接着剤)」として配置する。

Dockerのコンテナ管理も、ローカルCLI連携が輝く領域だ。

「停止しているコンテナと不要なイメージをすべて削除して」と指示する。

AIはdockerコマンドのヘルプを読み、安全なクリーンアップコマンドを実行する。

一方で、Stripeの決済履歴を取得するようなタスクはMCPの出番だ。

APIキーの管理やページネーションの処理など、複雑な状態管理が求められる。

MCPサーバーを介することで、これらの処理を安全かつ確実に実行できる。

ローカルの軽量なタスクは、ヘルプテキストを読み込ませたAIに即座に実行させる。

外部システムとの重い連携が必要な場面でのみ、MCPサーバーを介した通信を行う。

このハイブリッドなアーキテクチャこそが、現在の1人SaaS開発における最適解だ。

レイテンシを最小限に抑えつつ、開発スピードを最大化できる。

新しいプロトコルが出たからといって、すべてをそれに置き換える必要はない。

自分の開発環境のボトルネックがどこにあるのかを見極め、適切な道具を選択する。

AIツールの進化は速いが、ソフトウェアエンジニアリングの基本原則は変わらない。

シンプルで、保守性が高く、自分の手に馴染む構成を追求し続けるだけだ。

開発者が知るべきAI連携のFAQ

Q1: nomanのようなツールは、どのようにして正確なコマンドオプションを生成しているか?

汎用的なLLMの事前知識だけに頼るのではなく、実行環境にある対象コマンドの実際のヘルプテキストを読み込んでコンテキストとしてLLMに渡している。これにより、「存在しないオプションをでっち上げる」というハルシネーションを強力に抑制し、ローカル環境のバージョンに依存した正確なコマンド生成を実現している。

Q2: MCPとReAct(Function Calling)はどう使い分けるか?

ReActはLLMの「思考プロセス」のフレームワークであり、Function Callingはその具体的な実装手段だ。一方、MCPは「外部システムとの接続プロトコル」である。

自作の簡単なスクリプトやローカル関数を呼び出すだけならFunction Callingで十分だが、データベースや外部SaaSなど、認証や状態管理が必要なシステムと標準的な方法で連携したい場合にMCPサーバーを導入するのが適している。

Q3: ローカルツール連携においてMCPのデメリットは何か?

MCPはクライアント・サーバーモデルを採用しているため、ローカルのファイル操作や簡単な計算であっても、MCPサーバーを介した通信が発生する。これにより、直接ローカルコマンドを実行するアプローチと比較して、ネットワークレイテンシの増加やサーバープロセスの死活管理といった運用オーバーヘッドが常に生じる点が、1人開発においては大きなデメリットとなる。

まとめ

すべてをAIに任せる幻想は終わり、既存ツールとAIをどう組み合わせるかの泥臭い設計フェーズだ。

アーキテクチャの選択一つで、開発の快適さは天と地ほど変わる。

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

ThreadPost 代表 / SNS自動化の研究者

ThreadPost運営。Claude Codeで1人SaaS開発しながら、海外AI最新情報を開発者目線で発信中。

@shintaro_campon関連記事

Google公式発表。Gemini 3.1 ProでAI開発はどう変わるのか。単なるチャットボットから脱却する理由

【2026年版】最新AIエージェント構築ツール3選|1人SaaS開発者が本気で比較

Anthropic公式が発表。DeepSeek等にClaudeが1600万回不正抽出された理由とAI開発への影響

【2026年版】最新AIエージェント比較3選|1人SaaS開発者が推す最強環境

【2026年版】Cursorで実現するAI駆動開発Tips10選|1人SaaS実践者が厳選

【2026年版】ChatGPT・Gemini画像生成AI5選|1人開発者が実務で使う

人気の記事

【2026年覇権交代】1億4,150万人が選ぶ「最強テキストSNS」と2つの高反応時間帯

エンゲージメント2倍!7100万件のデータから導くベスト投稿時間3つの法則

月収18万で廃業寸前だった大学中退フリーランスが「対象を絞っただけ」のメルマガ配信ツールで年商60億円を創った裏側

巨大企業の歯車として消耗していた2人の会社員が『ただの要望掲示板』を作ったら年商4.5億円。

1回25ドルのトークン消費。Claude Codeのマルチエージェント化が迫る、個人開発のハイブリッド運用。