Webサイトの読者が人間からAIに変わる。

月間4億人が訪れる巨大プラットフォームが、AIエージェントによるサイトの直接編集を解禁した。

同時に、最前線の開発者たちはllms.txtやJSON-LDを駆使し、AI専用の裏口を作り始めている。

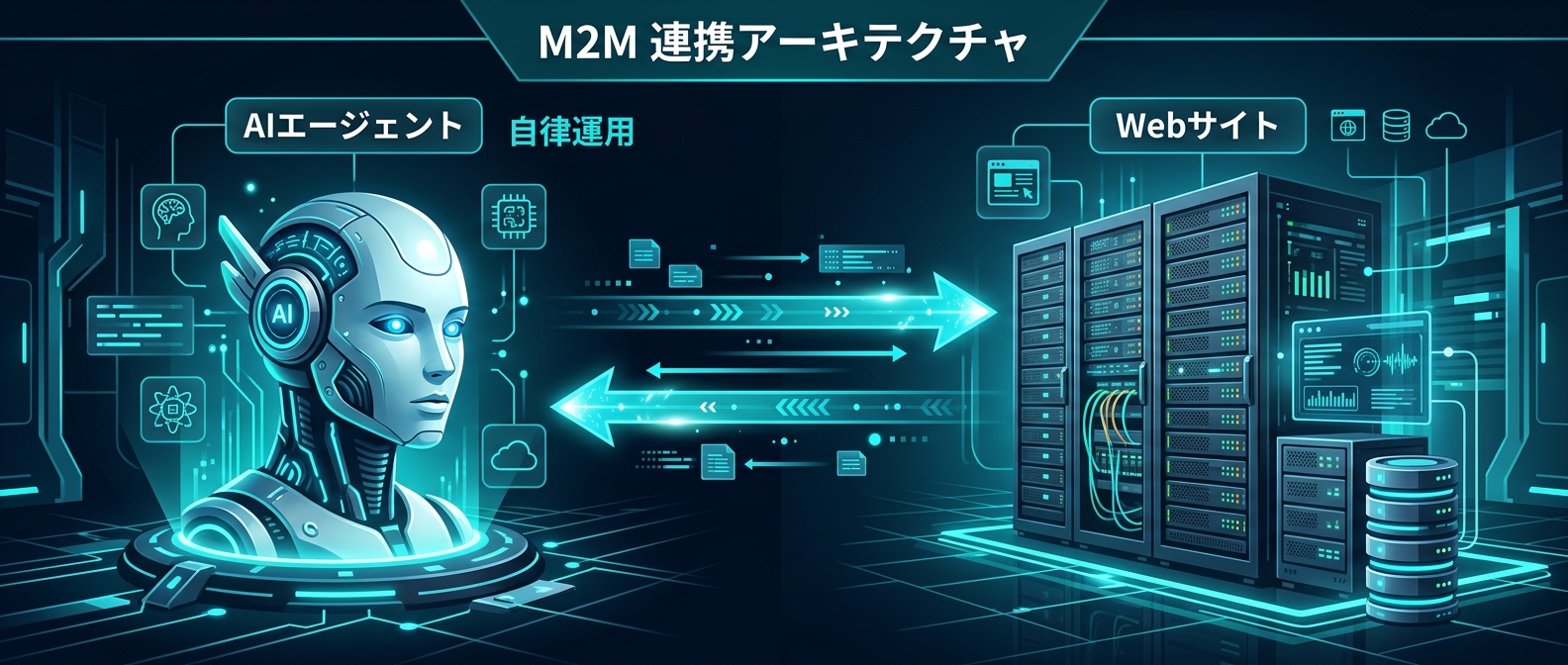

SEOの時代は終わり、AIが自律的にサイトを読み書きするMachine-to-Machineの時代が来た。

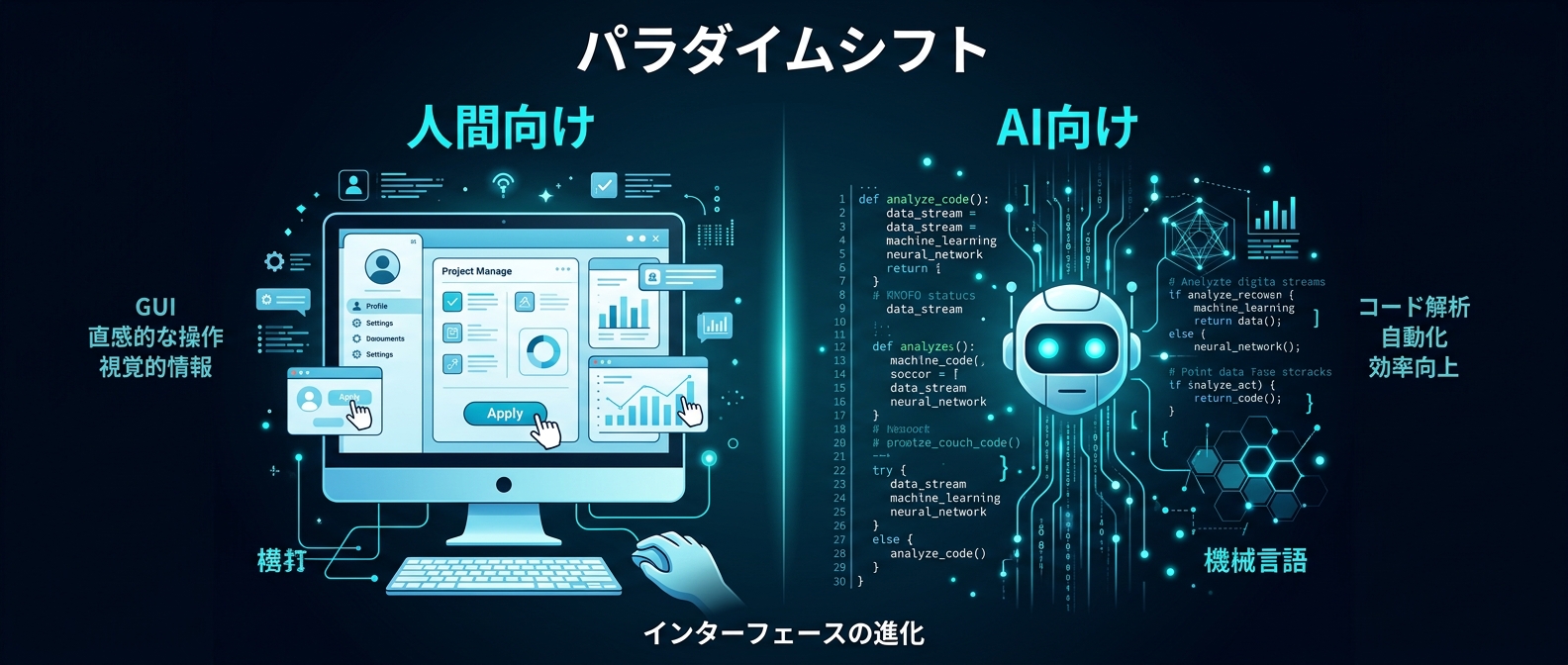

これは全Web開発者にとって、アーキテクチャの根幹を揺るがすパラダイムシフトだ。

SNS運用を自動化しませんか?

ThreadPostなら、投稿作成・画像生成・スケジュール管理まで全てAIにお任せ。

AIがサイトを直接運用する衝撃

今、Webの世界で静かだが決定的な地殻変動が起きている。

人間向けの美しいUIを作るだけでは、サイトの価値が半減する時代になった。

最大の衝撃は、インターネットの43%を支える巨大プラットフォームがMCP(Model Context Protocol)のサポートを本格化させたことだ。

これにより、AIエージェントが単にサイトを読むだけでなく、記事の執筆、カテゴリの再構築、メタデータの修正までを自律的に行うことが可能になった。

人間が管理画面にログインしてボタンを押す時代は終わる。

Claude DesktopやCursorなどのAIクライアントから、自然言語で指示を出すだけでサイトが運用されるのだ。

エージェントはサイトのテーマや既存のデザインシステムを自律的に読み取る。

そして、同じ色使い、同じフォント、同じコンポーネント構造を維持したまま、新しいランディングページを生成する。

人間はAIが生成したドラフトを確認し、承認ボタンを押すだけだ。

この圧倒的な自動化は、Webサイト構築のハードルを極限まで下げる。

これに伴い、AIにいかに正しく情報を読み取らせるかというAEO(Answer Engine Optimization)やAIO(AI Optimization)の重要性が爆発的に高まっている。

従来のSEOは、検索エンジンがページ単位でキーワードを評価する仕組みだった。

しかし、今のAIは情報をページ単位ではなく、断片的なフラグメント単位で消費する。

HTMLの見た目だけを整えても、AIが文脈を切り取った瞬間に意味が崩壊してしまう。

そこで最前線の開発者たちが導入しているのが、llms.txtやllms-full.txtといったAI専用のテキストファイルだ。

これらをサイトのルートディレクトリに配置し、AIクローラーに対してサイトの目的やコンテキストを直接叩き込む。

さらに、人間向けのHTMLページとは別に、AIエージェント専用のポータルページを用意するアプローチも登場している。

そこには、AIが迷わずAPIを叩けるように仕様書やエンドポイントへの導線が整理されている。

単なるテキストの最適化にとどまらない。

JSON-LDを駆使して意味のネットワークを構築し、画像ファイルにはXMPメタデータを直接埋め込む。

画像が単体でSNSに拡散されたり、AIに抽出されたりしても、その画像が持つ文脈や権利情報が失われないようにするためだ。

バイナリ層にまで意味を持たせる徹底的な設計が、次世代のスタンダードになろうとしている。

※この記事は、Claude Codeで1人SaaS開発しているしんたろーが、海外AI最新情報を開発者目線で解説する「AI活用Tips」です。

意味のサプライチェーンを構築せよ

この動きは、僕らWeb開発者にとって本当に恐ろしい変化だ。

今までブラウザでどう見えるかに全振りしていた労力を、AIのパーサーにどう解釈されるかに振り向けなければならない。

AIは人間の目を持たない。

美しいCSSアニメーションも、緻密に計算された余白も、AIにとってはノイズでしかない。

AIが求めているのは、純粋で構造化された意味だ。

だからこそ、llms.txtの存在が決定的な意味を持つ。

これは単なるサイトマップではない。

AIに対してサイトの概念を定義し、用語の意味を教え込むグランドトゥルースだ。

AIは肯定的な情報だけを読み取ると、勝手に似たような別の概念とマージしてしまう癖がある。

それを防ぐために、llms-full.txtで長文の文脈を与え、AIの勝手な推論を強烈にブロックするのだ。

さらに面白いのが、AIエージェント向けの専用入口を作るという発想だ。

人間向けのページをAIに頑張って解析させるのは、そもそも間違っている。

AIにはAIのための、機械可読なインターフェースを用意すべきだ。

APIの仕様書、エージェントの権限を示す設定ファイル、それらを束ねたポータルページ。

これらを明示的に配置することで、AIは迷うことなくサイトの構造を理解し、自律的なアクションを起こせるようになる。

これはまさに、完全なMachine-to-Machineの対話だ。

SPAの設計も根本から見直す必要がある。

ハッシュルートを使った雑なルーティングは、AIにとって同一コンテンツの意味の分裂を引き起こす。

AIがスナップショットを取得した際に、どのURLが正典なのかが不明確になるからだ。

すべてのルートで正しく意味と帰属を維持する設計が求められる。

レンダリングのタイミングも重要だ。

非同期でデータを取得してDOMを書き換えるSPAの場合、AIクローラーがどのタイミングでページをパースするかが問題になる。

最前線の設計では、ルーティングの遷移完了を明示的にシステムに伝える仕組みが導入されている。

これにより、AIは完全に構築された状態のDOMを正確に読み取ることができる。

そして、MCPの普及がこの流れを決定づけた。

AIがただのクローラーから、アクティブなエージェントへと進化したのだ。

しんたろー:

毎日Claude Codeで開発してると、AIが直接ファイルを読み書きする強力さは痛いほどわかる。

Webサイト自体がMCPサーバーとして振る舞うなら、ブラウザすら開かずにエディタからサイトを更新できる。

うちのSaaSも、人間用のダッシュボードより先にAI用のエンドポイントを整備した方が早いんじゃないかと思えてきた。

AIエージェントがサイトのテーマやデザインを理解し、それに合わせたコンテンツを自律的に生成する。

人間はAIが作ったドラフトを承認するだけ。

この世界線では、サイトのアーキテクチャ自体がAIフレンドリーであることが絶対条件になる。

AIが読み取れないサイトは、AIによって更新されることも、AIの回答に引用されることもない。

インターネットの暗黒物質として、誰の目にも触れずに消えていくだけだ。

僕らは今、人間向けのWebから、AI向けのWebへと橋を架ける過渡期にいる。

この橋をどう設計するかが、今後の開発者の価値を決定づける。

敵対的なAIクローラーを弾くのではなく、協調的なAIエージェントをいかに上手く迎え入れるか。

それが、これからのWeb開発のメインテーマになる。

ここまで読んだあなたに

今なら無料で全機能をお試しいただけます。設定後は完全放置でプロ品質の投稿を毎日生成。

AIを迎え入れるための具体的なアクション

で、僕らの日々の開発にどう影響するのか。

結論から言うと、今すぐプロジェクトのルートディレクトリにllms.txtを置くべきだ。

これはSEOのメタタグをいじるような小手先のテクニックではない。

AIに対する名刺であり、取扱説明書だ。

サイトの目的、主要な概念、AIに読んでほしい情報の場所を簡潔にまとめる。

そして、それをrobots.txtやsitemap.xmlからリンクして発見性を高める。

これだけで、AIクローラーの理解度は劇的に変わる。

次にやるべきは、JSON-LDの徹底的な統合だ。

ページ内に複数のJSON-LDが散らかっているなら、それらを一つのグラフに統合し、IDで相互にリンクさせる。

AIにとって重要なのは、データが存在することではなく、データ同士のつながりを辿れることだ。

情報が断片化されても、そのフラグメントがどこに帰属するのかをAIが追跡できるようにする。

さらに、画像やバイナリファイルの扱いも変える必要がある。

WebPなどの画像フォーマットには、XMPメタデータを埋め込むことができる。

画像のタイトル、キャプション、ライセンス情報をバイナリ層に直接書き込むのだ。

SNSで画像だけが拡散されたり、AIが画像だけを抽出したりしても、意味と帰属が絶対に失われない。

画像圧縮ツールやCDNの設定によっては、このメタデータが剥がれ落ちてしまうことがある。

インフラストラクチャ全体で、メタデータを維持する意味のサプライチェーンを構築しなければならない。

そして最も重要なのが、MCPを見据えたアーキテクチャの設計だ。

しんたろー:

ThreadPostの出力するページも、AIが読んで一発で構造を理解できるかどうかが勝負になる。

単なるHTMLの吐き出しじゃなくて、裏側でllms.txtを自動生成する仕組みを入れないと時代遅れになりそうだ。

AIがAIの作ったコンテンツを読んで、さらに別のAIがそれを要約する。完全に機械の生態系ができあがってる。

自分が作っているWebサービスやSaaSが、AIエージェントからどう見えるかを想像してほしい。

管理画面のGUIは、人間にとっては使いやすくても、AIにとっては障害物でしかない。

AIが直接データを読み書きできるAPIや、MCPサーバーとしての機能を実装する。

ユーザーが使い慣れたAIクライアントから、直接あなたのサービスを操作できるようにする。

これができれば、ユーザー体験は次元の違うレベルに跳ね上がる。

サイトにアクセスして操作する世界から、手元のAIに頼むだけでサイトが動く世界へのシフトだ。

AEOやAIOは、単なる検索エンジン対策ではない。

AIエージェントという新しい最強のユーザーを迎え入れるための、おもてなしの設計なのだ。

このパラダイムシフトに乗り遅れれば、どれだけ素晴らしいコンテンツを作っても、AIの知識空間には存在しないものとして扱われる。

開発の優先順位を、今すぐアップデートする必要がある。

メタデータを削って数キロバイトのファイルサイズを節約する時代は終わった。

今は、ファイルサイズが少し増えてでも、バイナリの中に強固な意味を埋め込む時代だ。

AIが情報をどうパースし、どうベクトルデータベースに格納するか。

そのメカニズムを逆算して、システム全体を再設計する。

これは単なるマークアップの変更ではない。

情報のあり方そのものを問い直す、根源的なエンジニアリングだ。

よくある質問(FAQ)

llms.txtやllms-full.txtとは何ですか?どのように配置すべきですか?

AIクローラーやLLMに対して、サイトの目的、世界観、技術仕様などを機械可読な形で伝えるためのテキストファイルだ。

ルートディレクトリに配置し、robots.txtやsitemap.xmlからリンクすることで発見性を高める。

人間向けのHTMLとは別に、AIが文脈を誤解せず効率的に情報を取得するためのAI向けポータルとして機能する。

これが自律実行の際の強力なガイドラインとなる。

AEOやAIOにおいて、従来のSEOと最も異なる点は何ですか?

従来のSEOがページ単位での評価を重視していたのに対し、AEOやAIOはAIによるフラグメント単位での情報消費を前提とする。

そのため、HTMLの最適化だけでは全く足りない。

JSON-LDの統合や、WebP画像へのXMPメタデータの埋め込みなどが必要になる。

情報がページから切り離されても意味と帰属が失われない、多層的で堅牢なデータ設計が求められる。

巨大プラットフォームのMCP対応は、一般の開発者にどう影響しますか?

MCPを通じて、AIクライアントから直接サイトの読み書きが可能になるという事実が重要だ。

これは、Webサイトの運用がGUIベースから自然言語・エージェントベースへ完全に移行することを意味する。

独自開発のサイトやSaaSでも、MCPサーバーを実装することが急務になる。

ユーザーが手元のAIツールから直接コンテンツ管理を行える体験を提供できなければ、競合に取り残される。

次世代のアーキテクチャへ

Web開発の主戦場は、人間の目からAIのパーサーへと完全に移行した。

AIエージェントが自律的に動き回る世界で、僕らのコードはどう振る舞うべきか。

しんたろー:

結局、機械に優しくないシステムは人間にも優しくないってことだ。

意味を厳密に定義して、メタデータを整える。プログラミングの基本に立ち返るだけかもしれない。

とりあえず、明日は自分のプロジェクトのJSON-LDを全部見直す作業で一日が終わりそうだ。

AIが自律的に読み書きする次世代のWebアーキテクチャを見据え、SNS運用の設計にもAEOの概念を取り入れてみませんか?

この記事が参考になったら、ThreadPostを試してみませんか?

投稿作成・画像生成・スケジュール管理まで、全てAIにお任せできます。

ThreadPostをもっと知る

関連記事

【2026年版】AIエージェントのコストを半減させる運用術12選|Claude Code開発の実践知

なぜClaude Codeはコード生成よりデータの構造化が重要なのか。自律エージェントの推論精度を高める開発者向け完全ガイド

なぜCursorとLangGraphでAI開発が激変するのか。エージェント自律化の最新潮流

【2026年版】Claude Code活用術10選|開発フローを自動化する最強スキル集

Claude Codeの自律操作で開発が変わる理由|思考プロセスをコード化する実践的アプローチ